Перевод подготовил автор канала Друг Опенсурса, приятного прочтения, заранее благодарю за подписку

GLM-5.1 — это новая открытая модель от Z.ai. Она имеет 744 млрд параметров (40 млрд активных) и контекстное окно 200K. По сравнению с GLM-5 в ней улучшены написание кода, работа с инструментами и логические задачи.

Для хранения полной модели нужно 1,65 ТБ. Квантованные версии GGUF от Unsloth занимают меньше места: 2-битная версия требует 220 ГБ, 1-битная 200 ГБ.

|

Benchmark |

GLM-5.1 |

GLM-5 |

Qwen3.6+ |

Minimax M2.7 |

DeepSeek V3.2 |

Kimi K2.5 |

Claude Opus 4.6 |

Gemini 3.1 Pro |

GPT-5.4 |

|---|---|---|---|---|---|---|---|---|---|

|

HLE |

31.0 |

30.5 |

28.8 |

28.0 |

25.1 |

31.5 |

36.7 |

45.0 |

39.8 |

|

HLE (Tools) |

52.3 |

50.4 |

50.6 |

— |

40.8 |

51.8 |

53.1* |

51.4* |

52.1* |

|

AIME 2026 |

95.3 |

95.4 |

95.1 |

89.8 |

95.1 |

94.5 |

95.6 |

98.2 |

98.7 |

|

HMMT Nov 2025 |

94.0 |

96.9 |

94.6 |

81.0 |

90.2 |

91.1 |

96.3 |

94.8 |

95.8 |

|

HMMT Feb 2026 |

82.6 |

82.8 |

87.8 |

72.7 |

79.9 |

81.3 |

84.3 |

87.3 |

91.8 |

|

IMOAnswerBench |

83.8 |

82.5 |

83.8 |

66.3 |

78.3 |

81.8 |

75.3 |

81.0 |

91.4 |

|

GPQA-Diamond |

86.2 |

86.0 |

90.4 |

87.0 |

82.4 |

87.6 |

91.3 |

94.3 |

92.0 |

|

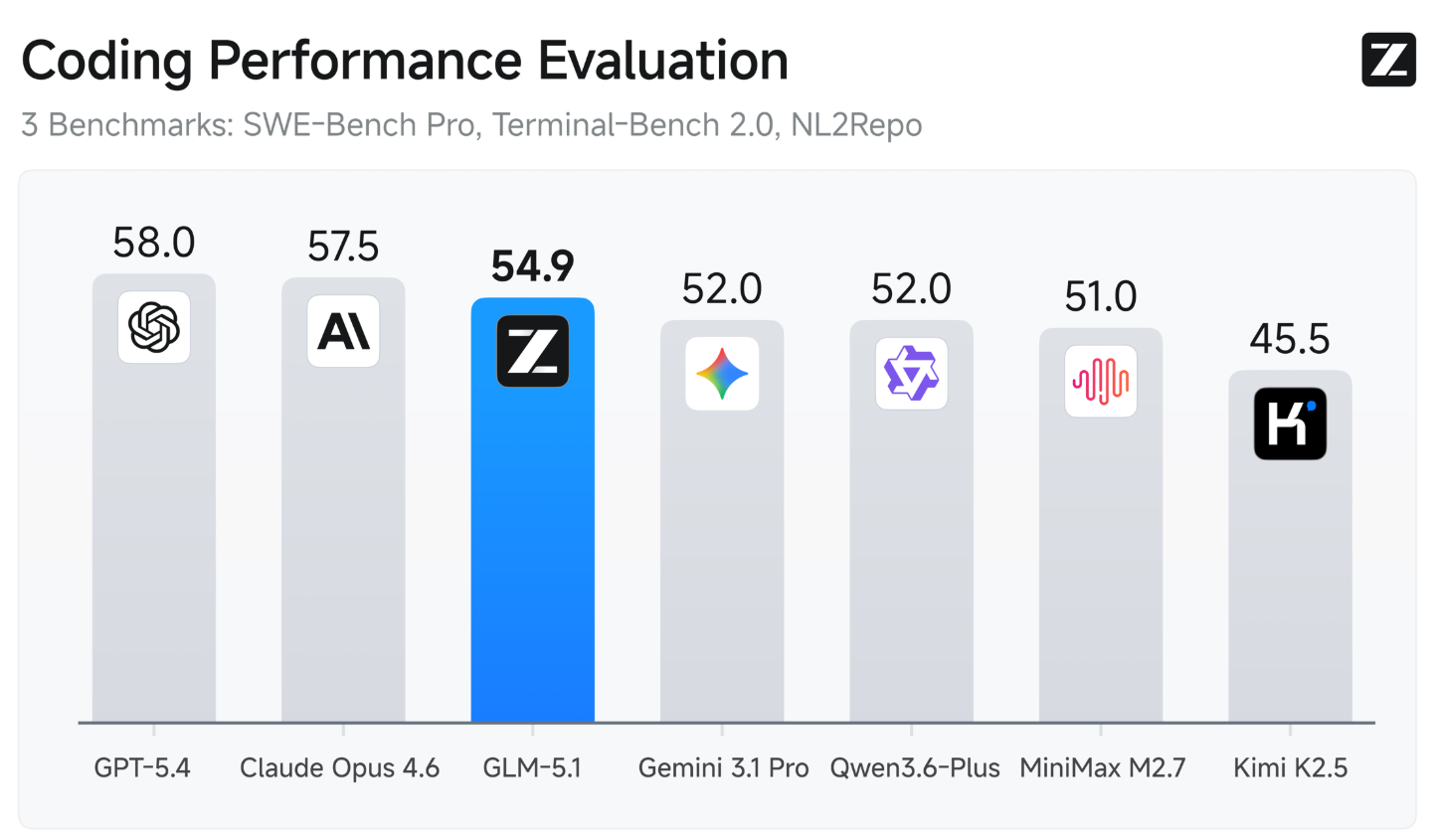

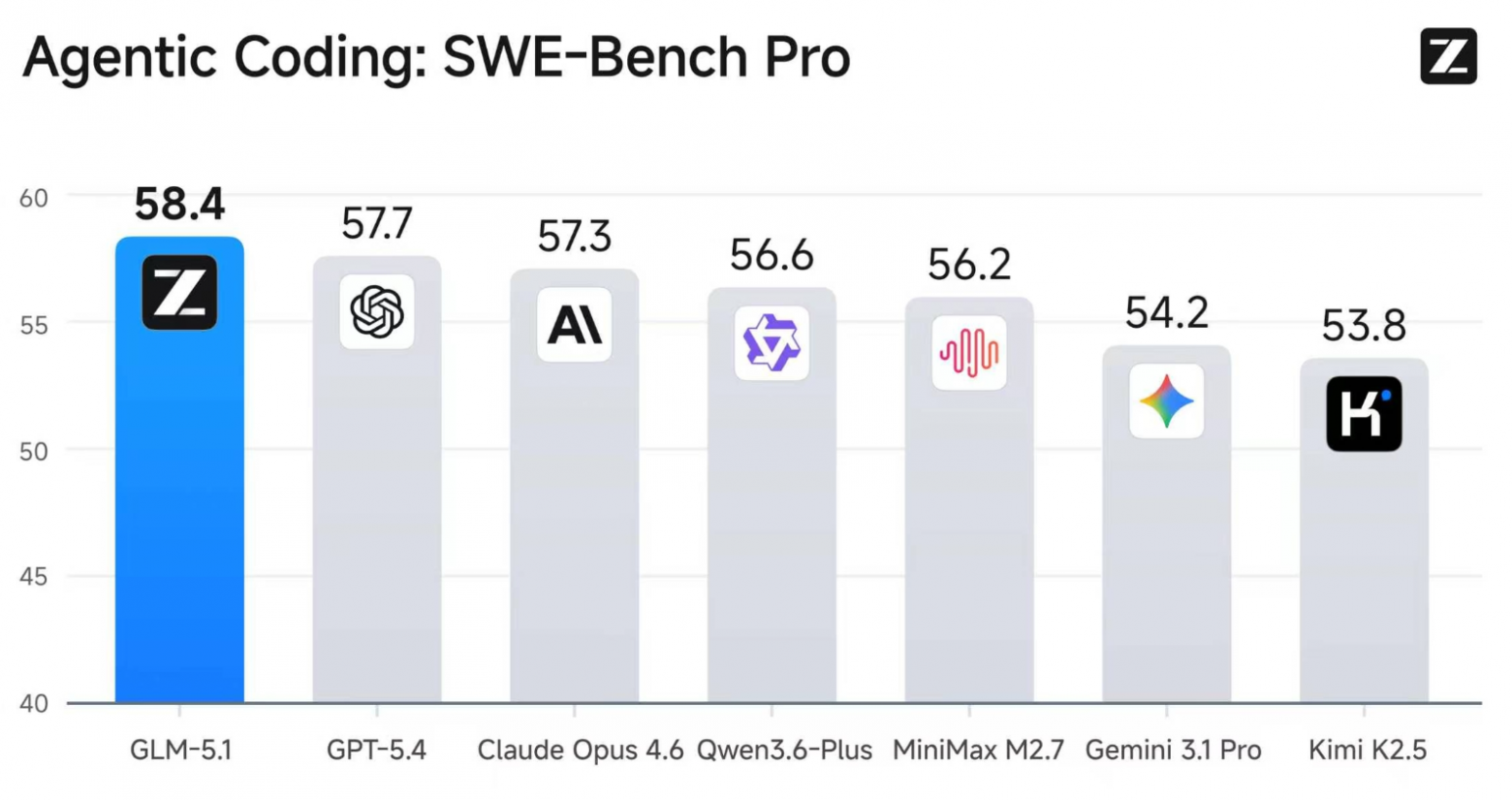

SWE-Bench Pro |

58.4 |

55.1 |

56.6 |

56.2 |

— |

53.8 |

57.3 |

54.2 |

57.7 |

|

NL2Repo |

42.7 |

35.9 |

37.9 |

39.8 |

— |

32.0 |

49.8 |

33.4 |

41.3 |

|

TerminalBench 2 |

63.5 |

56.2 |

61.6 |

— |

39.3 |

50.8 |

65.4 |

68.5 |

— |

|

TerminalBench (Best) |

66.5 (Claude Code) |

56.2 |

— |

57.0 |

46.4 |

— |

— |

— |

75.1 |

|

CyberGym |

68.7 |

48.3 |

— |

— |

17.3 |

41.3 |

66.6 |

— |

— |

|

BrowseComp |

68.0 |

62.0 |

— |

— |

51.4 |

60.6 |

— |

— |

— |

|

BrowseComp (CM) |

79.3 |

75.9 |

— |

— |

67.6 |

74.9 |

84.0 |

85.9 |

82.7 |

|

τ³-Bench |

70.6 |

69.2 |

70.7 |

67.6 |

69.2 |

66.0 |

72.4 |

67.1 |

72.9 |

|

MCP-Atlas |

71.8 |

69.2 |

74.1 |

48.8 |

62.2 |

63.8 |

73.8 |

69.2 |

67.2 |

|

Tool-Decathlon |

40.7 |

38.0 |

39.8 |

46.3 |

35.2 |

27.8 |

47.2 |

48.8 |

54.6 |

|

Vending Bench 2 ($) |

$5634 |

$4432 |

$5115 |

— |

$1034 |

$1198 |

$8018 |

$911 |

$6144 |

Но не используйте CUDA 13.2 для GGUF, это портит качество ответов.

Требования к оборудованию

Версия UD-IQ2_M подходит для Mac с 256 ГБ оперативной памяти. Также она работает на ПК с одной видеокартой на 24 ГБ и 256 ГБ оперативной памяти через MoE offloading. Для 1-битной версии нужно 220 ГБ памяти, для 8-битной 805 ГБ.

|

Параметр |

Default Settings (Most Tasks) |

Terminal Bench |

|---|---|---|

|

temperature |

1.0 |

0.7 |

|

top_p |

0.95 |

1.0 |

|

max new tokens |

131072 |

16384 |

В GLM-5.1 по умолчанию включен режим рассуждения. Для его отключения используйте

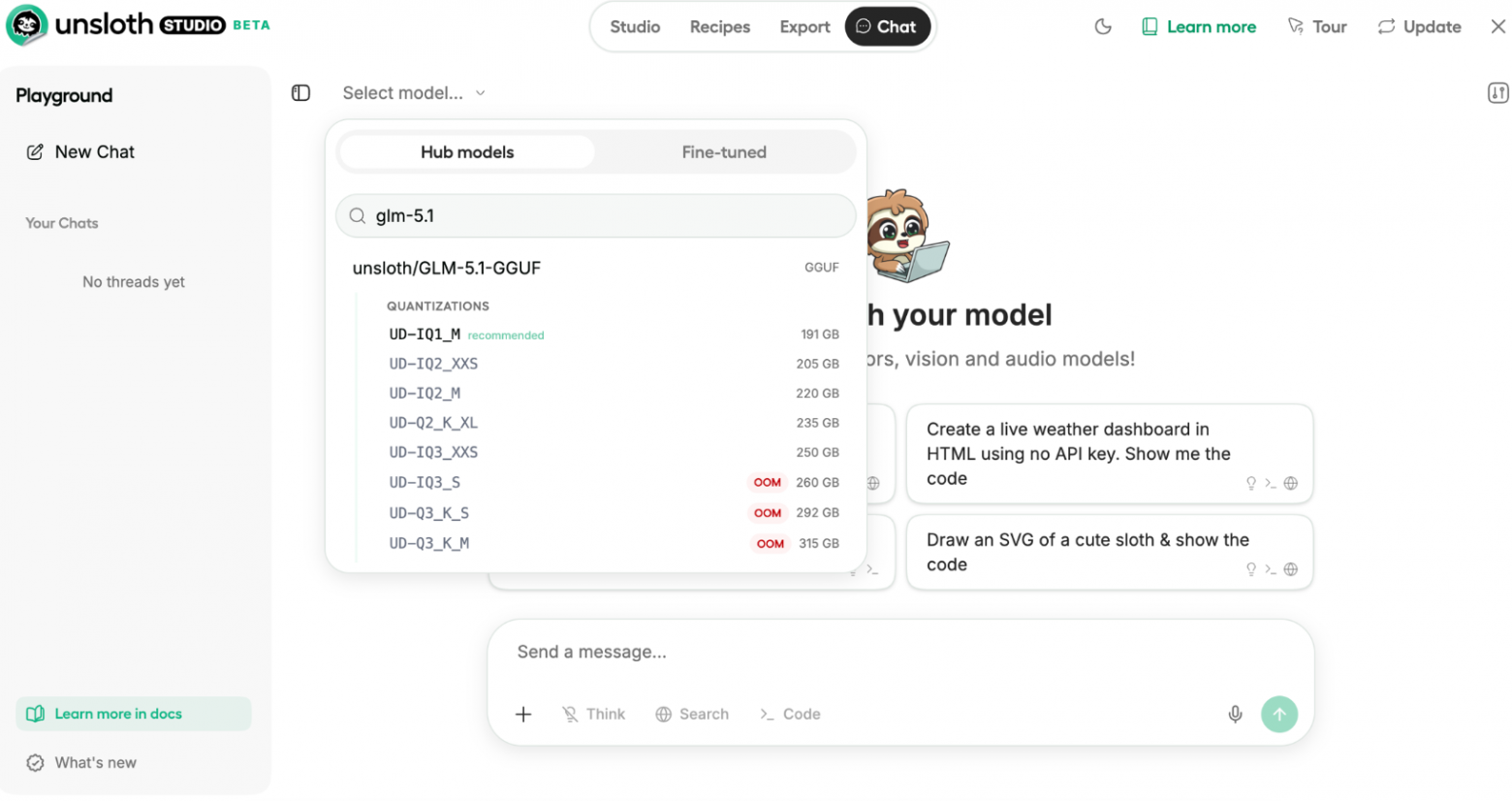

--chat-template-kwargs '{"enable_thinking":false}'Использование Unsloth Studio

Установка для MacOS, Linux, WSL

curl -fsSL https://unsloth.ai/install.sh | shУстановка для Windows PowerShell

irm https://unsloth.ai/install.ps1 | iexЗапуск

unsloth studio -H 0.0.0.0 -p 8888После запуска откройте http://localhost:8888 В поиске найдите GLM-5.1. Рекомендуется выбирать версию UD-Q2_K_XL. Если VRAM не хватит, система задействует оперативную память.

Использование llama.cpp

Соберите llama.cpp из репозитория GitHub. Для систем без GPU или на Mac с Metal используйте -DGGML_CUDA=OFF.

Для сборки

apt-get update

apt-get install pciutils build-essential cmake curl libcurl4-openssl-dev -y

git clone https://github.com/ggml-org/llama.cpp

cmake llama.cpp -B llama.cpp/build

-DBUILD_SHARED_LIBS=OFF -DGGML_CUDA=ON

cmake --build llama.cpp/build --config Release -j --clean-first --target llama-cli llama-mtmd-cli llama-server llama-gguf-split

cp llama.cpp/build/bin/llama-* llama.cppЗапуск обычной версии

export LLAMA_CACHE="unsloth/GLM-5.1-GGUF"

./llama.cpp/llama-cli

-hf unsloth/GLM-5.1-GGUF:UD-IQ2_M

--ctx-size 16384

--temp 0.7

--top-p 1.0Запуск для вызова инструментов

export LLAMA_CACHE="unsloth/GLM-5.1-GGUF"

./llama.cpp/llama-cli

-hf unsloth/GLM-5.1-GGUF:UD-IQ2_M

--ctx-size 16384

--temp 1.0

--top-p 0.95Работа через API

Для запуска сервера

./llama.cpp/llama-server

--model unsloth/GLM-5.1-GGUF/UD-IQ2_M/GLM-5.1-UD-IQ2_M-00001-of-00006.gguf

--alias "unsloth/GLM-5.1"

--prio 3

--temp 1.0

--top-p 0.95

--ctx-size 16384

--port 8001Пример кода на Python для обращения к серверу

from openai import OpenAI

openai_client = OpenAI(

base_url = "http://127.0.0.1:8001/v1",

api_key = "sk-no-key-required",

)

completion = openai_client.chat.completions.create(

model = "unsloth/GLM-5.1",

messages = [{"role": "user", "content": "Create a Snake game."},],

)

print(completion.choices[0].message.content)Вызов функций

GLM-5.1 поддерживает вызов инструментов. Для этого нужно определить функции в Python и передать их описание в модель.

def add_number(a: float | str, b: float | str) -> float:

return float(a) + float(b)

def terminal(command: str) -> str:

if "rm" in command or "sudo" in command or "dd" in command or "chmod" in command:

return "Dangerous command"

return str(subprocess.run(command, capture_output = True, text = True, shell = True).stdout)Модель может использовать эти функции для выполнения расчетов или команд в системе. При использовании llama-server автоматическая обработка вызовов настраивается через цикл, который проверяет наличие tool_calls в ответе модели и возвращает результат выполнения функции.

Автор: Qwertcoser