Исследовательская группа Hugging Face представила SmolLM2, свою новейшую языковую модель. Несмотря на то, что она не открывает новых горизонтов, она является ценным дополнением к портфолио AI-технологий компании.

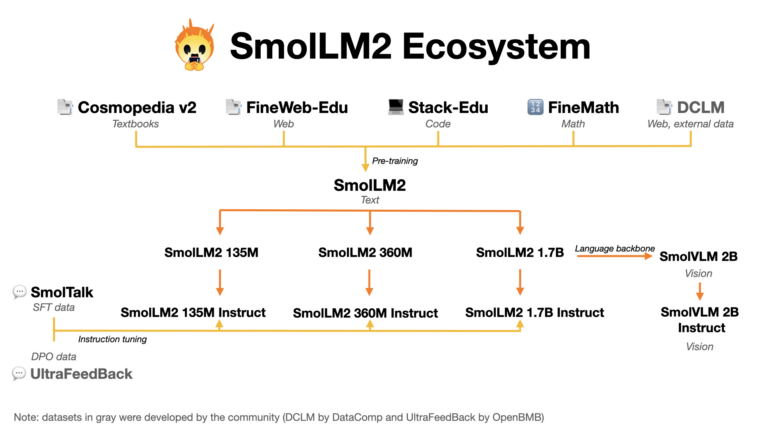

Эффективность модели обусловлена тщательным объединением различных источников для набора данных из 11 триллионов токенов и методичным подходом к обучению. Команда начала со сбалансированного сочетания веб-контента и примеров программирования, а затем добавила специализированные наборы данных для математических задач и программирования.

Исследователи оценивали эффективность модели после каждого этапа обучения, чтобы выявить недостатки, а затем соответствующим образом корректировали обучающие данные. Они создали собственные наборы данных, в том числе FineMath для сложных математических задач, Stack-Edu для хорошо документированного кода и SmolTalk для задач, связанных с общением.

После первоначального обучения команда доработала SmolLM2 с помощью тонкой настройки инструкций и обучения на примерах, чтобы улучшить понимание задач. Они использовали обучение с подкреплением, чтобы помочь модели генерировать более подходящие для пользователя ответы.

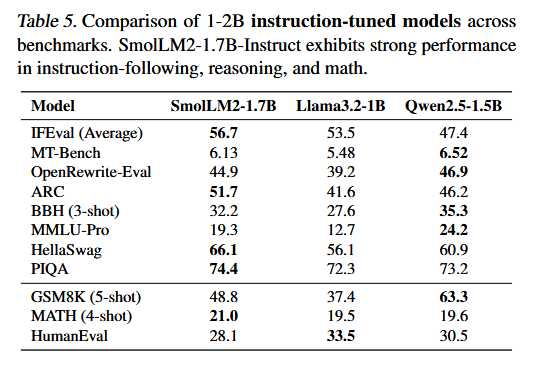

В тестах на знания и понимание SmolLM2 показывает лучшие результаты, чем модели схожего размера, такие как Qwen2.5-1.5B и Llama3.2-1B, в нескольких областях, но не во всех.

Помимо основной версии с 1,7 миллиарда параметров, команда разработала две версии поменьше с 360 и 135 миллионами параметров, которые показали хорошие результаты для своего размера.

Hugging Face стал неотъемлемой частью разработки AI с открытым исходным кодом благодаря своему обширному хранилищу весов моделей. Компания стремится активно продвигать исследования, а не просто хранить данные для других.

Компания, поддерживаемая Google, недавно выпустила библиотеку AI-агентов и создала альтернативу с открытым исходным кодом для Deep Research от OpenAI. SmolLM2 использует проверенные подходы для создания эффективных языковых моделей благодаря высококачественному набору данных и многоэтапному обучению. Хотя он соответствует аналогичным моделям от Meta* и Qwen, его практическая ценность, вероятно, заключается в выполнении небольших задач на устройствах с ограниченной вычислительной мощностью, таких как смартфоны.

Такое развитие событий кажется естественным шагом для Hugging Face как крупного игрока на рынке AI. В отличие от Meta и Qwen, которые делятся только весами моделей, Hugging Face придерживается полного подхода с открытым исходным кодом, делая свои данные для обучения доступными для всех.

*Meta и её продукты (Instagram, Facebook) запрещены на территории Российской Федерации

Автор: mefdayy

- Запись добавлена: 10.02.2025 в 18:16

- Оставлено в