Исследование Alibaba Group и Университета имени Сунь Ятсена в Гуанчжоу показало, что современные нейросети не могут поддерживать долгосрочную эволюцию кодовой базы, добавляя новые функции и не нарушая функциональность старых.

Исследователи разработали специальный тест для больших языковых моделей, чтобы изучить их способности поддерживать длительную эволюцию базы кодов и добавлять новые функции без нарушения деятельности ранее внесённых.

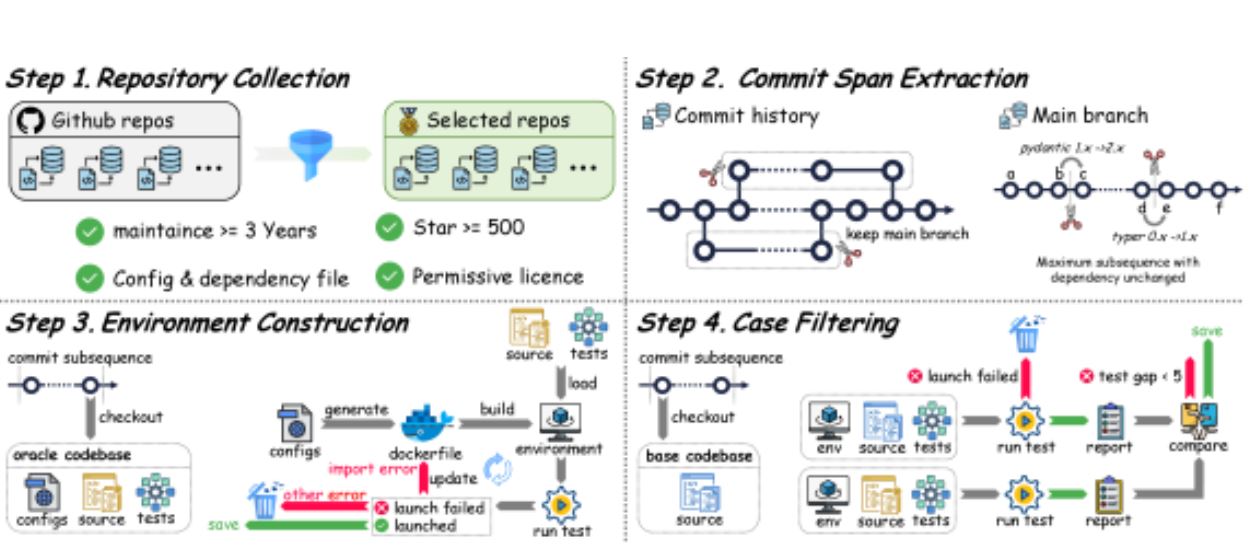

Они отмечают, что агенты уже продемонстрировали высокие возможности в автоматизации задач разработки программного обеспечения, таких как статическое исправление ошибок, что подтверждается такими бенчмарками, как SWE-bench. Однако в реальном мире разработка зрелого программного обеспечения обычно основана на сложных изменениях требований и долгосрочных итерациях функций — процессе, который не могут охватить статические парадигмы одноразового исправления. Чтобы преодолеть этот разрыв, исследователи представили бенчмарк SWE-CI на уровне репозитория, построенный на основе цикла непрерывной интеграции. Он включает 100 задач, каждая из которых соответствует в среднем истории эволюции, охватывающей 233 дня и 71 последовательный коммит в реальном репозитории кода. SWE-CI требует от агентов систематического решения этих задач посредством десятков раундов анализа и итераций кодирования.

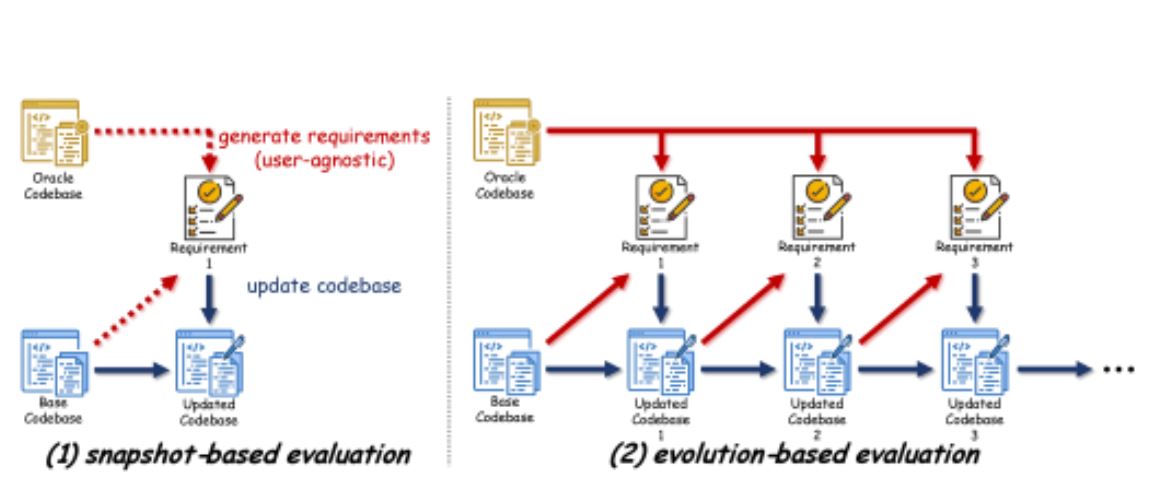

Одновременно авторы работы подчеркнули наличие проблемы: все тесты, от HumanEval и LiveCodeBench до SWE-bench и Terminal-Bench, повсеместно используют протокол, основанный на моментальных снимках: агент получает одну задачу и создаёт одноразовое решение. В рамках этой парадигмы агент, который жёстко закодировал ненадёжное исправление, и агент, который пишет чистый, расширяемый код, могут пройти один и тот же набор тестов. Разница становится видимой только тогда, когда кодовая база должна развиваться: появляются новые требования, меняются интерфейсы, а модули необходимо расширять. В этот момент стоимость предыдущих проектных решений накапливается, и агенту, который регулярно создаёт плохо структурированный код, будет сложнее вносить каждое последующее изменение.

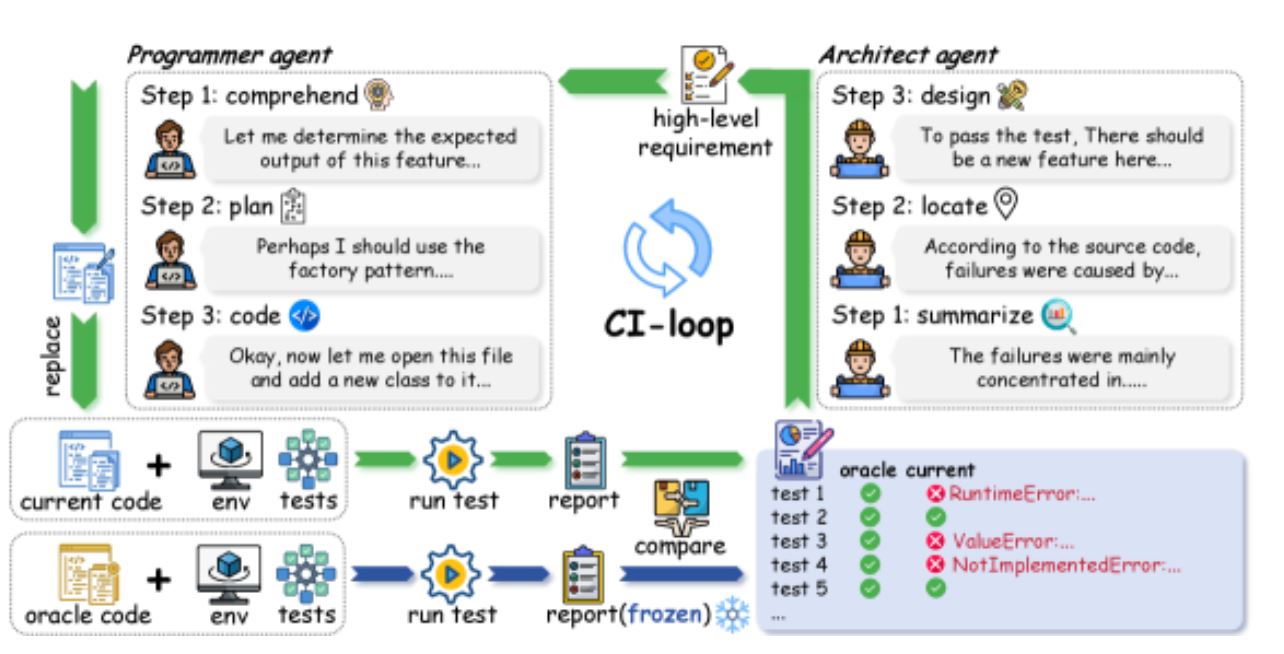

SWE-CI же использует протокол оценки с двумя агентами — архитектором и программистом: начиная с базового коммита, агенты выполняют цикл CI, который итеративно генерирует требования, изменяет исходный код и запускает тесты, с конечной целью пройти все, связанные с целевым коммитом.

SWE-CI вводит EvoScore (Evolution Score) в качестве косвенной метрики: он измеряет функциональную корректность будущих модификаций, так что агенты, чьи ранние решения способствуют последующей эволюции, получают более высокие баллы, в то время как те, которые накапливают технический долг, демонстрируют постепенно снижающуюся производительность.

Результаты показали, что современные модели по-прежнему испытывают трудности с поддержанием качества кода в течение длительного периода.

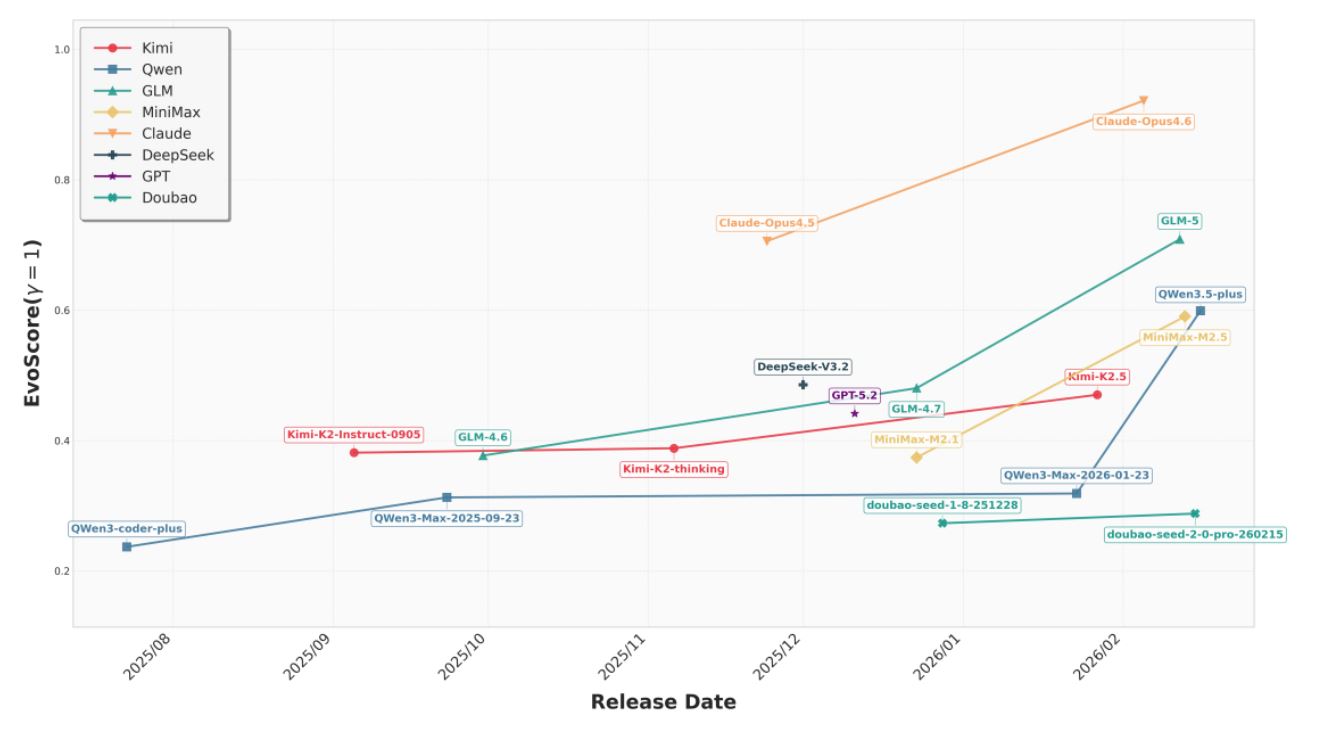

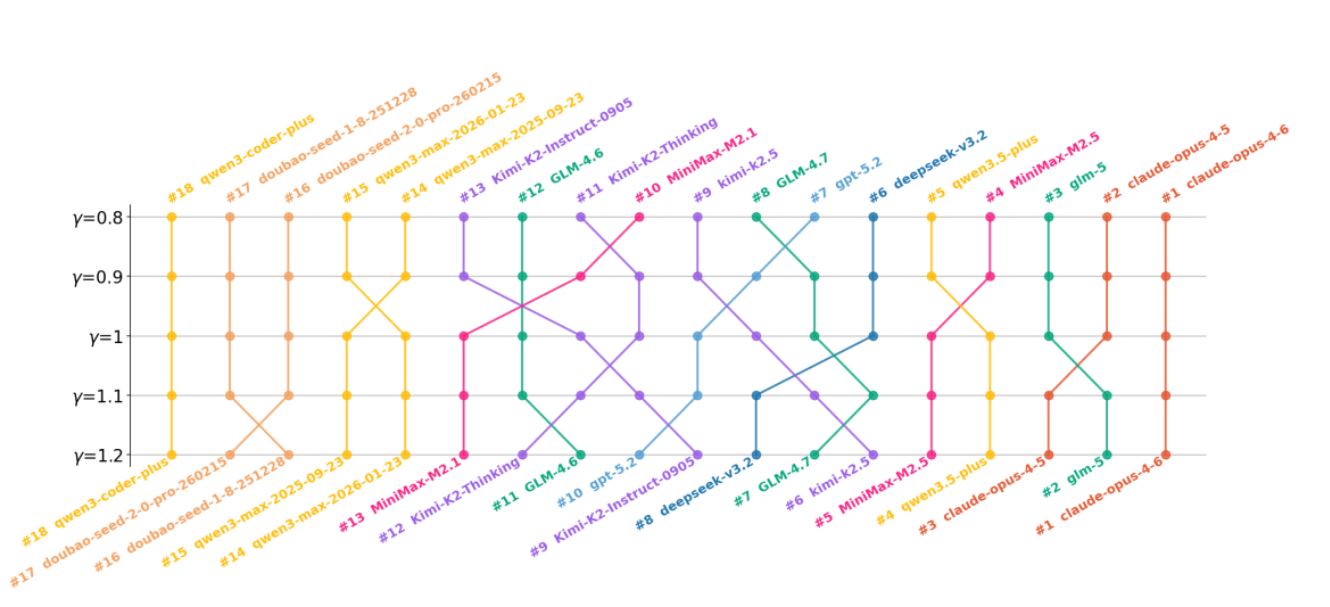

Оценка включала 18 моделей от 8 разных поставщиков. Выяснилось, что в рамках одного семейства более новые модели всегда достигают более высоких показателей, при выпущенные после начала 2026 года демонстрируют значительно больший прирост, чем их предшественники. Это говорит о том, что возможности кода современных LLM быстро развиваются, переходя от статического исправления ошибок к устойчивому, долгосрочному сопровождению кода, говорят исследователи. Так, Claude Opus демонстрирует явное лидерство на протяжении всего периода наблюдения, при этом GLM-5 также выделили как сильного игрока.

Также были найдены различия в поведении моделей разных компаний. Например, MiniMax, DeepSeek и GPT демонстрируют предпочтение долгосрочным выгодам, в то время как Kimi и GLM склоняются к краткосрочной отдаче. Qwen, Doubao и Claude, напротив, остаются относительно стабильными в различных условиях.

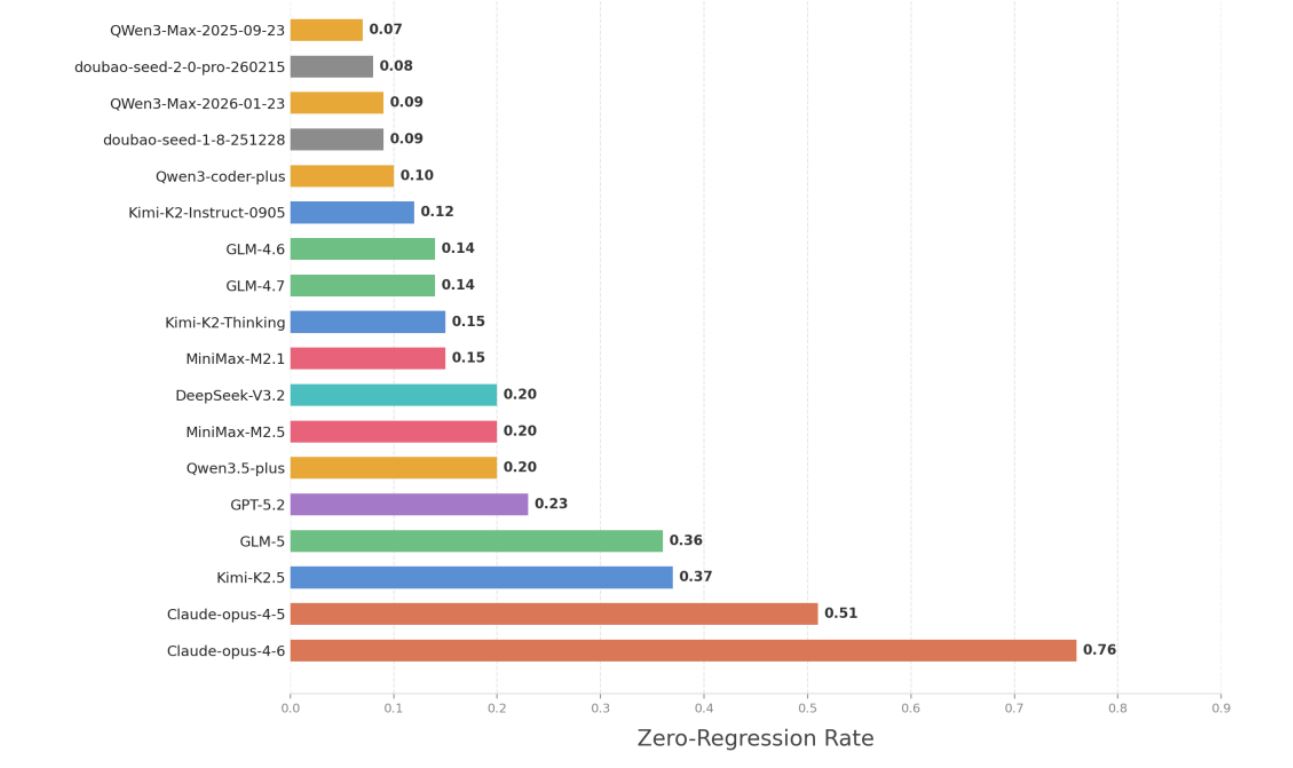

Регрессия — это ключевой показатель для измерения стабильности качества программного обеспечения. Так, если модульный тест проходит до изменения кода, но не проходит после, то считается, что изменение привело к регрессии. В SWE-CI измеряли долю образцов, в которых не происходит регрессии на протяжении всего процесса сопровождения кода. Результаты показали, что большинство моделей достигают показателя нулевой регрессии ниже 0,25, и только две из серии Claude-opus превышают 0,5.

Это говорит о том, что, хотя LLM продемонстрировали значительные улучшения в краткосрочных задачах модификации кода, они по-прежнему сталкиваются со значительными проблемами в полностью автоматизированных, долгосрочных и многоэтапных сценариях разработки и сопровождения программного обеспечения.

Ранее директор по инжинирингу DNS в организации ISC Ондржей Cури подвёл итоги экспериментов по использованию больших языковых моделей для анализа, исправления и модернизации кодовой базы DNS‑сервера BIND 9. Исследование Cури проводилось в рамках создания прототипов новых проектов и подготовки материалов для обучения студентов. Он отметил, что большие языковые модели хорошо подходят для быстрого создания прототипов, понимания незнакомого кода и автоматизации простых рутинных задач, но при использовании ИИ для решения больших задач возникла проблема с экономией времени. От разработчика потребовалось много времени на постановку задачи, изучение и проверку результатов, а также последующую доработку кода.

Автор: maybe_elf