Чат GPT воспринимается как обычный веб-интерфейс: открыл страницу, отправил запрос, получил ответ. Но за этим сценарием стоит длинная цепочка сетевых и прикладных компонентов. Если ограничение возникает хотя бы на одном из этапов, доступ к системе пропадает целиком.

В российском контуре эта тема стала заметной не из-за абстрактного интереса к ИИ, а из-за практики. Генеративные модели используют для анализа текста, черновой разработки, объяснения кода, структурирования информации и работы с документами. Когда такой инструмент перестаёт быть достижим по сети, вопрос быстро переходит из бытового в инфраструктурный.

Проблема в том, что обсуждение часто сводят к примитивной формуле: «есть VPN — есть доступ, нет VPN — нет доступа». Такая модель слишком грубая. В реальности между браузером и ИИ-моделью находятся DNS, маршрутизация, TLS, CDN, географические ограничения, антифрод-механизмы и серверная логика.

Поэтому полезно смотреть на тему не как на «открытие сайта», а как на задачу прохождения запроса через несколько независимых уровней. Такой взгляд сразу объясняет, почему один и тот же ресурс может быть недоступен по разным причинам и почему внешне одинаковая ошибка может означать совсем разные технические сценарии.

Как устроена блокировка Чат GPT на уровне сети

Где вообще может ломаться доступ

Ограничение может возникать в двух больших зонах:

-

на пути между устройством и удалённой инфраструктурой;

-

на стороне самой инфраструктуры, обслуживающей модель.

Это принципиально разные случаи. В первом соединение не доходит до удалённого узла или ломается по дороге. Во втором маршрут формально существует, но сервер отказывает уже на прикладном уровне.

Уровень DNS

Первый этап — разрешение доменного имени в IP-адрес. Если на этом уровне возникают ограничения, клиент либо не получает ответа, либо получает некорректный адрес, либо сталкивается с искусственно нарушенной резолюцией.

Внешне это выглядит банально: страница не открывается. Но с инженерной точки зрения проблема ещё даже не дошла до HTTP или API. Запрос не знает, куда именно подключаться.

Уровень IP и маршрутизации

Если DNS отработал, следующий шаг — попытка соединения с IP-адресом назначения. Здесь могут применяться фильтрация по диапазонам адресов, ограничение маршрутов, выборочные сбросы соединений, нарушение прохождения пакетов или деградация канала до практически нерабочего состояния.

Для браузера или приложения результат часто выглядит одинаково: таймаут, разрыв соединения, нестабильная загрузка. Но уже на этом этапе важно понимать, что проблема находится ниже прикладного уровня.

Уровень TLS и сетевых метаданных

Даже если IP-маршрут существует, соединение может ломаться при установлении TLS-сессии. Современный HTTPS скрывает содержимое трафика, но метаданные всё равно остаются видимыми: адрес назначения, некоторые параметры рукопожатия, SNI, особенности клиентского стека.

Именно поэтому блокировка часто строится не вокруг содержимого запросов, а вокруг признаков самого соединения. Это менее «глубокий» способ контроля, но для ограничения доступа к конкретным ресурсам его часто достаточно.

Уровень приложения

Даже полностью исправный сетевой путь не гарантирует доступ. Сервер может отвечать отказом по региональному признаку, по политике допустимых стран, по антифрод-проверкам, по корреляции IP-адреса и учётной записи или по другим внутренним правилам.

Это уже другой тип проблемы. В таком случае сеть «жива», TLS работает, HTTP-ответ приходит, но прикладная логика говорит, что доступ запрещён. Для диагностики это критическое различие.

Какие существуют технические способы доступа без VPN

Не весь трафик, а только нужный маршрут

Под «доступом без VPN» обычно имеют в виду не магию, а то, что меняется не весь сетевой стек устройства, а только путь конкретного запроса. То есть вместо полного туннеля для всех приложений используется более узкий механизм доставки трафика к удалённой точке.

Это важное различие. Классический VPN работает на уровне общего сетевого маршрута, а альтернативные схемы часто работают только для одного приложения, одного протокола или одного класса запросов.

Прикладные прокси

Один из самых распространённых принципов — промежуточный узел прикладного уровня. Клиент отправляет HTTP(S)-запрос не напрямую к конечной инфраструктуре модели, а к посреднику, который уже перенаправляет его дальше.

С точки зрения сети это означает замену точки выхода. Устройство не устанавливает полный туннель в другую сеть, а лишь использует другой узел как внешний инициатор прикладного запроса.

Обратные и прямые проксирующие схемы

Существуют схемы, в которых промежуточный узел выступает либо как прямой посредник для клиентского трафика, либо как обратный шлюз, скрывающий реальную топологию удалённой инфраструктуры. Для локальной среды такой узел выглядит как конечная точка общения, хотя фактически он является только прослойкой.

Это позволяет обойти часть сетевых ограничений, но переносит доверие к новой точке. С технической стороны задача решается, но появляется ещё один компонент, через который проходит трафик.

Серверный доступ через внешний backend

Ещё один принцип — вынесение взаимодействия с моделью из браузера в удалённую серверную часть. В этом варианте локальная сторона обращается только к промежуточному API, а тот уже общается с моделью от собственного имени.

Такой подход меняет саму архитектуру доступа. Прямого соединения между клиентом и моделью больше нет: есть только связь «клиент → промежуточная логика → модель».

Более сложные архитектуры

Встречаются и составные варианты:

-

раздельная аутентификация и выполнение запроса;

-

маршрутизация через несколько узлов;

-

асинхронные очереди между приёмом запроса и генерацией ответа;

-

распределение ролей между точками в разных сетевых контурах.

Во всех этих случаях суть одна и та же: доступ обеспечивается не прямым соединением, а архитектурой посредничества. Разница лишь в том, насколько глубоко эта архитектура встроена в прикладной стек.

Ограничения и риски таких способов

Дополнительная точка доверия

Любой промежуточный узел меняет модель угроз. Если запрос идёт через стороннюю логику, эта логика потенциально получает доступ к метаданным соединения, а иногда и к содержимому, если TLS завершается именно на ней.

Для текстовых запросов это уже чувствительно. Для кода, документов, внутренних описаний систем, конфигураций и фрагментов переписки — тем более.

Нестабильность и увеличение задержек

Каждое дополнительное звено в маршруте повышает:

-

задержку;

-

вероятность таймаута;

-

число точек отказа;

-

риск разрыва длинной сессии.

Для обычного веба это может быть терпимо. Для генеративной модели, которая отвечает потоком токенов и поддерживает длинный контекст, деградация канала заметна намного сильнее.

Проблемы совместимости с современными интерфейсами ИИ

Доступ к ИИ редко ограничивается одиночным запросом «вопрос — ответ». Часто используются:

-

потоковая выдача текста;

-

долгоживущие HTTPS-соединения;

-

WebSocket или похожие механизмы;

-

защита от автоматизированных обращений;

-

проверка fingerprint клиента;

-

корреляция сессий.

Промежуточная инфраструктура не всегда корректно пропускает такой трафик. Иногда базовый текстовый ответ ещё работает, а вложения, инструменты, потоковая генерация или длинные диалоги уже ломаются.

Изменчивость внешних условий

Даже если схема работает сегодня, это не означает устойчивости завтра. Достаточно изменить политику доступа, сертификаты, настройки CDN, маршруты, антифрод-правила или параметры балансировки — и поведение канала меняется.

Поэтому такие решения почти никогда нельзя считать постоянными. Они зависят от множества внешних параметров, которые не контролируются локально.

Как ИИ-модели работают в условиях ограничений

ИИ-система — это не один сервер

Распространённое заблуждение — представление о модели как об одном удалённом узле, к которому браузер подключается напрямую. На практике вокруг inference-части почти всегда существует дополнительная инфраструктура:

-

балансировщики;

-

слой аутентификации;

-

очереди запросов;

-

логирование;

-

фильтрация;

-

маршрутизация по вычислительным пулам;

-

кэширование вспомогательных данных.

Поэтому ограничение доступа затрагивает не один «сервер с ИИ», а всю связку компонентов.

Что означает кэширование в этом контексте

Кэширование в ИИ-системах не сводится к банальному хранению готовых ответов на вопросы. Обычно речь идёт о нескольких уровнях оптимизации:

-

кэш статических элементов интерфейса;

-

кэш токенов или сессионных атрибутов;

-

повторное использование части контекста;

-

дедупликация одинаковых обращений;

-

кэширование промежуточных артефактов маршрутизации.

Это снижает число повторных операций, но не устраняет необходимость в рабочем пути к вычислительным узлам. Если основной inference-контур недостижим, кэш помогает лишь частично.

Зачем нужны прокси-архитектуры вокруг модели

Прокси-слой перед моделью нужен не только ради сетевой достижимости. Он также решает прикладные задачи:

-

нормализует формат запросов;

-

ограничивает размер входного контекста;

-

распределяет нагрузку;

-

повторяет обращения при временных сбоях;

-

скрывает внутреннюю топологию вычислений;

-

управляет политиками доступа.

Когда прямой доступ ограничен, именно этот слой чаще всего становится основной точкой интеграции. Но вместе с этим он становится и главной точкой отказа.

Почему возникают распределённые запросы

Во многих системах путь одного запроса разбивается на этапы. Один компонент принимает запрос, другой проверяет права, третий выбирает вычислительный узел, четвёртый исполняет inference, пятый фильтрует или форматирует ответ.

В условиях ограничений это повышает гибкость архитектуры. Но есть и обратная сторона: диагностика становится сложнее, потому что ошибка может возникнуть не на входе и не на выходе, а внутри цепочки внутренних переходов.

Что это меняет для конечного качества ответа

Даже при формальной достижимости модели качество взаимодействия зависит от того, насколько стабильно работает вся цепочка. Ограничения могут приводить не только к отказу, но и к менее очевидным эффектам:

-

неполному ответу;

-

разрыву потоковой генерации;

-

потере части контекста;

-

ошибкам при загрузке вложений;

-

нестабильному времени отклика.

То есть «доступ есть» ещё не означает, что ИИ работает корректно с инженерной точки зрения.

Почему важно понимать техническую сторону, а не просто «включить VPN»

Одинаковый симптом не равен одинаковой причине

Со стороны всё выглядит похоже: страница не открывается, чат не отвечает, API возвращает ошибку. Но внутри это могут быть совершенно разные случаи:

-

DNS не разрешает домен;

-

IP-маршрут обрывается;

-

TLS не устанавливается;

-

сервер видит неподходящий регион;

-

антифрод отклоняет сессию;

-

прокси ломает потоковую передачу.

Без понимания уровней сети невозможно точно определить источник проблемы.

Вопрос не только в доступности, но и в безопасности

Когда в ИИ отправляются данные, речь идёт не о безобидной строке запроса. Внутрь часто попадают:

-

куски исходного кода;

-

документы;

-

описания архитектуры;

-

внутренние инструкции;

-

фрагменты переписки;

-

конфиденциальные данные.

Поэтому анализ должен включать не только достижимость, но и путь данных: где завершается шифрование, кто видит содержимое, что логируется и как долго это хранится.

Для ИИ критична стабильность сессии

Обычный сайт можно открыть даже через посредственный канал. Для генеративных моделей этого недостаточно. Здесь важны:

-

стабильная потоковая выдача;

-

корректная работа длинных контекстов;

-

поддержка вложений и инструментальных вызовов;

-

предсказуемое поведение длительных соединений.

Неподходящий маршрут может дать формальный доступ, но сломать сам сценарий использования.

Инженерный взгляд полезнее бытовой формулы

Подход «включить что-то и проверить, открылось ли» не объясняет природы ограничений. Инженерный подход раскладывает задачу по уровням:

-

разрешение имени;

-

достижимость IP;

-

установка TLS;

-

прикладной ответ;

-

поведение сессии;

-

границы доверия;

-

устойчивость архитектуры.

Именно такая декомпозиция позволяет понять не только получится ли соединение, но и какой ценой оно достигается.

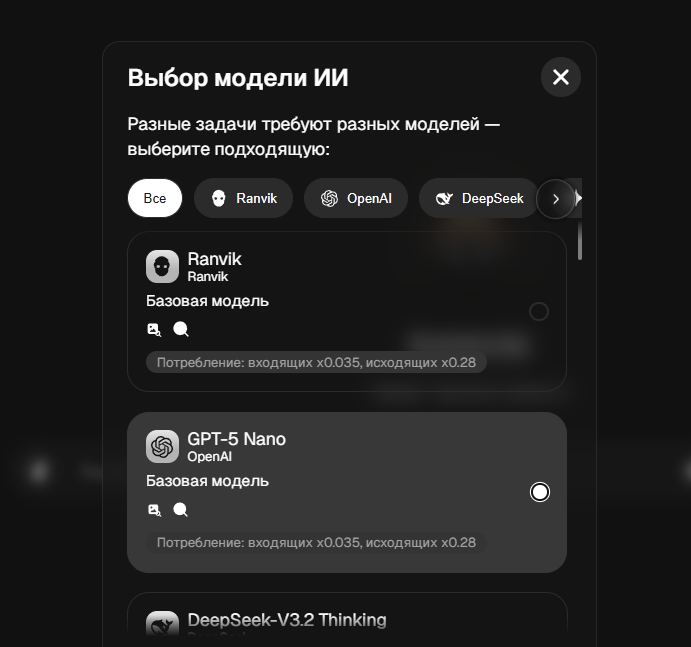

Другие возможности платформы RANVIK?

AI-генерация изображений — сервис позволяет создавать оригинальные изображения по текстовому описанию, улучшать качество фото, редактировать отдельные детали и быстро удалять фон.

Нейросети для работы с текстом — инструменты платформы подходят для написания уникальных материалов, редактуры, перевода, поиска идей и подготовки сценариев для разных задач.

AI-решения для видео — с помощью платформы можно генерировать видео по описанию, изменять объекты в кадре, добавлять надписи, анимацию и другие визуальные эффекты.

Бесплатный Ranvik AI — универсальная среда, объединяющая возможности для создания и обработки текстов, изображений, аудио и видео в одном месте.

Аудиосервисы на основе нейросетей — функционал сервиса помогает озвучивать тексты, создавать музыкальные фрагменты и генерировать треки с заданными характеристиками.

Оживление статичных изображений — технология позволяет превращать обычные фотографии в живые сцены с плавным движением и естественной динамикой.

Перевод текста в речь — сервис создаёт реалистичную озвучку с выбором тембра, интонации, эмоциональной подачи и стиля звучания.

Создание музыки с помощью AI — пользователи могут генерировать музыкальные композиции, задавая нужные параметры: жанр, стиль, настроение и звучание.

Готовые промпты для генерации изображений — платформа предлагает шаблоны запросов, которые помогают получать более точные, качественные и детализированные изображения.

Шаблоны промптов для видео — готовые формулировки упрощают создание эффектных, выразительных и детально проработанных видеороликов с использованием искусственного интеллекта.

Вывод

Доступ к Чат GPT из России — это не одна проблема и не один тип блокировки. Здесь пересекаются сетевые ограничения, политика удалённой инфраструктуры, особенности прикладных протоколов и архитектура самих ИИ-систем.

Технические способы доступа без классического VPN действительно существуют, но по сути это не «обход одной кнопкой», а разные формы посредничества в сетевом и прикладном слоях. Они меняют точку выхода запроса, схему маршрутизации и модель доверия.

У таких решений почти всегда есть компромиссы:

-

по задержкам;

-

по устойчивости;

-

по совместимости;

-

по безопасности данных.

Поэтому сам факт достижимости ещё ничего не говорит о качестве и надёжности взаимодействия с ИИ.

Чем лучше понятна техническая сторона вопроса, тем легче отделить сетевую достижимость от реальной работоспособности. Для инфраструктурных и инженерных задач это различие принципиально: одно дело — получить ответ, и совсем другое — понимать, через какую цепочку он был получен и какие ограничения в эту цепочку встроены.

Автор: VisionSoul