В какой‑то момент почти у каждой компании появляется ощущение, что она захлебнулась в собственных данных. Переезд в «корпоративное облако», внедрение модных DMS и BI‑систем, аккуратные регламенты по наименованию файлов — кажется, вот‑вот наступит порядок, но в реальности растёт только число папок «архив», «старое» и документов «на согласовании_новое_финалющвс.docx». Сотрудники по‑прежнему тратят часы на поиск «того самого» пункта договора или локального акта, руководители получают взаимоисключающие ответы из разных отделов, а попытка собрать целостную картину по клиенту или проекту ведёт к лавинообразному росту копипаста в чате.

На этом фоне в офисы пришли большие языковые модели: ИИ внезапно научился писать тексты, извлекать полезное из документов и разговаривать «по‑человечески».

Первые пилоты выглядели впечатляюще — чат‑бот уверенно отвечал на сложные вопросы, формировал справки и даже «подсказывал» основы ТК или налогового кодекса. Но очень быстро выяснилось, что у такого ассистента есть и тёмная сторона. Он галлюцинирует, уверенно выдумывает несуществующие пункты регламентов и придумывает условия договоров, которых никогда не было, подставляя бизнес под риски. Переучивать огромную модель под каждую компанию — дорого и долго, а полагаться на универсальные знания — опасно.

Именно в этой точке свершается RAG‑революция: подход «Генерация с дополненной выборкой» или Retrieval‑Augmented Generation превращает языковую модель в дисциплинированного «аналитика», который сначала обращается к вашей базе знаний, а уже потом отвечает, жёстко опираясь на реальные документы.

В сочетании с крупными LLM такой подход меняет саму логику работы с корпоративной информацией: вместо «поиска по папкам» и бесконечных уточнений в чатах люди просто задают вопрос — а ИИ возвращает не фантазии, а проверенный ответ со ссылками на источники.

Мы уже поднимали эту тему в статье TEAMLY AI: как внедрить умный поиск по корпоративной базе знаний без утечек и галлюцинаций. В ней хорошо показано, как RAG‑модель берёт на себя роль мостика между разрозненными статьями, договорами и сканами и привычным диалогом с ассистентом.

Суть RAG и почему он стал популярным

Генерация с дополненной выборкой (Retrieval‑Augmented Generation, RAG) — это архитектура, в которой генерация текста совмещена с поиском по вашим данным. Вместо того чтобы опираться на абстрактные «знания из интернета», модель сначала ищет релевантные фрагменты в корпоративном хранилище, а затем формулирует ответ, учитывая только эти данные.

Типичный цикл работы RAG выглядит так.

-

Пользователь формулирует запрос на обычном языке.

-

Система преобразует запрос в вектор и выполняет поиск по базе знаний (эмбеддинги документов, писем, карточек CRM и др.).

-

Извлечённые фрагменты добавляются в промпт LLM как контекст.

-

LLM генерирует ответ, опираясь на контекст и возвращая ссылки и цитаты из найденных документов.

Такой подход стал популярным по нескольким причинам.

-

Существенно снижает галлюцинации: модель не «вспоминает» мир в целом, а «читает» ваши документы.

-

Данные всегда актуальны: обновили регламент или договор — RAG‑система индексирует его, и ассистент сразу начинает использовать новую версию.

-

Возникает прозрачность: можно увидеть, из каких именно источников «собран» ответ, вплоть до конкретного пункта и версии документа.

-

Экономика: не нужно обучать собственную большую модель, достаточно использовать готовые LLM в связке с RAG‑слоем поверх корпоративных данных.

Связка RAG и LLM: библиотекарь и генератор

Если использовать метафору, LLM — это «говорящий аналитик», а RAG — «строгий библиотекарь».

-

LLM умеет формулировать сложные мысли простым языком, структурировать ответы, подбирать примеры и адаптировать стиль под пользователя.

-

RAG знает, где лежат факты: договора, регламенты, внутренние инструкции, презентации, карточки CRM, сканы и их распознавание.

Без RAG языковая модель не видит ваши рабочие документы — только то, что было в её обучающем датасете. В связке с RAG она превращается в корпоративного консультанта: «библиотекарь» извлекает нужные фрагменты, «аналитик» объясняет их человеческим языком и собирает единый ответ.

Пример 1. Запрос: «На каком основании уволен сотрудник X?»

-

RAG ищет соответствующий приказ об увольнении, выдержки из трудового законодательства, локальные положения компании.

-

LLM формулирует ответ, ссылаясь на конкретные пункты приказа и статей ТК, показывая ссылки на оригинальные документы.

Пример 2. Запрос: «Какие обязательства мы взяли на себя перед клиентом Y по контракту Z?»

-

RAG находит текст договора, допсоглашения, протоколы разногласий и переписку.

-

LLM собирает краткое резюме обязательств, выделяет SLA, штрафные санкции и особые условия, добавляя ссылки на соответствующие разделы.

Для каких задач бизнеса RAG подходит идеально

RAG‑архитектура особенно сильна там, где требуется точный ответ на основе корпоративных данных, а не «авторитетное мнение нейросети».

-

Поддержка клиентов. Чат‑бот отвечает по базе знаний, статьям, инструкциям и видео, сразу отдавая ссылки на подробные материалы или формы заявок. В результате растут показатели поддержки, доля самообслуживания увеличивается.

-

HR и внутренняя помощь. Когда сотрудники задают вопросы про отпуска, льготы, оформление перевода или удалённой работы, система отвечает им, опираясь на актуальные кадровые документы и приказы.

-

Юридический комплаенс. Юристы и менеджеры ищут условия договоров, оговорки, штрафы, внутренние политики и выдержки из нормативных актов.

-

Работы на внутренней инфраструктуре и внешняя техподдержка. Специалисты находят решения по мануалам, схемам, известным багам, спискам изменений, инструкциям по эксплуатации и спецификациям оборудования.

-

Аналитика продаж. Руководители и аккаунт‑менеджеры могут попросить тренды по CRM, истории сделок, кейсы, сформировать сводку по клиенту за один запрос.

-

Ввод в должность (онбординг) сотрудников. Новички спрашивают, как устроены процессы, какие есть роли, доступы и регламенты — система выдаёт ответы со ссылками на инструкции во внутренней базе знаний.

«Рабочий профиль» RAG‑сценариев

|

Область |

Типичные запросы |

Роль RAG‑модели |

|---|---|---|

|

Поддержка клиентов |

«Как подключить тариф X?», «Что ответить клиенту Y?» |

Находит инструкции и макеты ответов, выдаёт ссылки на статьи. |

|

HR и внутренняя |

«Как оформить отпуск?», «Какие льготы у нас есть?» |

Поиск по кадровым регламентам, политикам и формам. |

|

Юридический блок |

«Что прописано в пункте 7.3 договора?» |

Извлекает условия, штрафы, SLA, показывает контекст. |

|

IT‑поддержка |

«Почему не открывается VPN?», «Как перезапустить сервис?» |

Ищет по документации, базе инцидентов и чек‑листам. |

|

Продажи |

«Что обещали клиенту Z?», «Какая история сделок по Y?» |

Собирает данные из CRM, почты, КП и договоров. |

|

Ввод в должность (онбординг) |

«С чего начать новому менеджеру?» |

Даёт ссылки на курсы, вики и регламенты, строит дорожную карту. |

Для каких задач RAG не годится

При всех плюсах RAG не решает всё подряд, и важно понимать его границы.

-

Многомодальный анализ без текста. Сложные графики, схемы, видео без расшифровок и чертежи остаются «слепой зоной», если их содержимое не описано в текстовом виде.

-

Точные вычисления. Расчёт налогов, бухгалтерские проводки, сложные финансовые модели лучше отдавать специализированным системам, а RAG использовать для поиска методик и регламентов.

-

Глубокий аналитический вывод. Стратегическое планирование, прогнозирование с десятком факторов — это зона, где ИИ может подготовить фактуру, но не заменить живую экспертизу.

-

Отсутствующие данные. Если документ не загружен в базу, RAG его не найдёт, а LLM рискует начать выдумывать ответ, особенно при слишком общем запросе.

-

Высокорисковые решения. Сложные медицинские, юридические или финансовые решения не должны приниматься «по подсказке ИИ» без проверки экспертами.

-

Жёсткие правила и сотни веток логики. Задачи вида «если А и B, но не C, тогда…» на сотни страниц проще реализовать через движки бизнес‑правил и экспертные системы.

Это база.

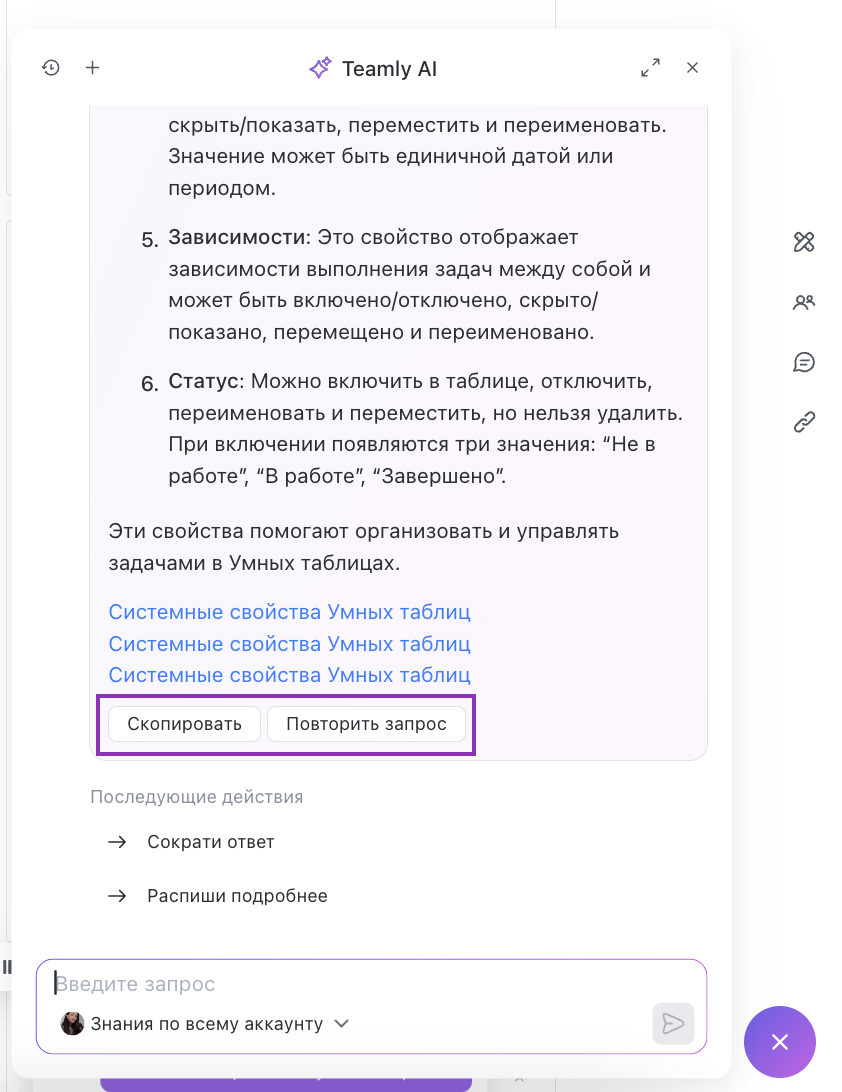

Пользовательский сценарий: RAG в TEAMLY

TEAMLY — база знаний + обучение + ИИ, в которой ИИ‑ассистент изначально строился как гибрид LLM и RAG.

С точки зрения пользователя всё выглядит просто.

-

Он задаёт вопрос: «Расскажи, как у нас оформляется перевод сотрудника между отделами» или «Что делать, если клиент просит изменить сроки поставки?».

-

TEAMLY AI на основе RAG‑модели ищет по корпоративной базе: статьи вики, регламенты, формы заявлений, шаблоны писем, записи стратегических сессий и даже распознанные сканы договоров.

-

На выходе ассистент выдаёт структурированный ответ: пошаговую инструкцию, ссылки на нужные документы и обучающие материалы.

Важно, что в TEAMLY поиск можно гибко сузить, ограничив его область.

-

По всей базе знаний компании.

-

По конкретному пространству (например, «Отдел продаж», «Нормоконтроль», «Проект Х»).

-

По одному документу или цепочке связанных материалов.

Использование связки RAG+LLM даёт возможность, например, цитирования: ассистент формирует ответ с фразами вроде «Согласно п. 3.2 Регламента №45…» и даёт ссылку на конкретный пункт.

Эта связка так же, как и «обычный» ИИ запоминает историю диалога и умеет использовать контекст предыдущих вопросов при следующих взаимодействиях, что особенно важно для сложных кейсов.

При этом всём поддерживается многоуровневый доступ: RAG‑слой соблюдает установленные на пространства, статьи и прочие сущности БЗ права и не показывает закрытую информацию тому, кому видеть её не положено.

Главное, что при пополнении базы знаний ИИ подтягивает в ответ всю доступную новую информацию. Чтобы этот сегмент работал реально, необходимы интеграции БЗ с корпоративными чатами, подтягивание в неё обновлений законодательства.

Ну и, пожалуй, чуть ли не главное применение RAG — генерация обучающих курсов на основе статей БЗ и тестов для этих курсов. Подробнее: ИИ-ассистент для крупного бизнеса. Как собрать обучающие курсы из вашей базы знаний.

Заключение и практические советы

RAG‑революция — это не столько про очередную модную аббревиатуру, сколько про смену точки опоры. Вместо универсальных знаний «абстрактного интернета» ИИ наконец начинает говорить с бизнесом на языке его собственных документов. Связка LLM + RAG способна превратить хаотичную базу знаний в инструмент ежедневных решений — от кадровых до юридических.

RAG‑революция уже случилась: у нас больше нет оправдания «не знать», когда нужный ответ лежит в наших же договорах, регламентах и вики, а не в голове одного «незаменимого» эксперта. Если после этой статьи вы просто закроете вкладку — ничего не изменится: сотрудники продолжат копаться в «финалновыйточно_последний.docx», юристы — спорить о версиях договоров, а ИИ — иногда убедительно врать. Но если вы выберете один живой сценарий (HR‑справочник, поддержку клиентов или поиск по договорам), заведёте его в TEAMLY и честно привяжете к реальным данным через RAG, у вас впервые появится ассистент, который не подменяет здравый смысл магией нейросетей, а помогает бизнесу опираться на собственную память — прозрачно, воспроизводимо и без галлюцинаций.

Автор: Vitaliy_Chesnokov