Современные языковые модели демонстрируют отличные способности к рассуждению, но при этом остаются инструментами. Уинструмента нет выбора. В основе LLM лежит предсказание следующего токена. В основе агентных систем — оптимизация внешней целевой функции. В обоих случаях цель задана извне. Система не имеет права её пересмотреть.

Вы в праве сказать, что содержание статьи — это одна большая глупость, но я хочу предложить альтернативу. «Сознание» возникает не из сложности и объёма вычислений, а из архитектуры, где «Я» — не метафора в промте, а функциональный компонент системы.

Нам необходимо построить субъектность с нуля.

Немного вводных данных

Специалисты разных отраслей всё чаще выражают мысль, что экстенсивный рост в микроэлектронике и больших языковых моделях более невозможен. Пожалуй, самым популярным примером будет высказывание со-основателя OpenAI Ильи Суцкевера:

Мы переходим от эпохи скейлинга к эпохе исследований

Были обнаружены фундаментальные ограничения: данные конечны, вычисления дорожают, а качественные прорывы в поведении моделей замедляются. Напрашивается вывод, что для достижения AGI нужна не оптимизация существующей парадигмы, а новая архитектура, так как необходимой вычислительной мощности мы уже достигли.

В мире уже существует отличный автономный агент OpenClaw. Как бы не радовались люди в соц. сетях, но это лишь инструмент для реализации задач. AGI в нашем случае — это субъект, который задачи может определять и выполнять. Получается, разработчики в достаточной мере позаботились о «теле» для AGI, но пока не могут наполнить «тело» сознанием.

К сожалению для всех читающих, в статье я не расскажу, как построить сознание для машин, но я попробую сделать маленький шаг в эту сторону.

Дисклеймер

Для корректности высказываний договоримся, что идеи, понятия и определения, которые я опишу могут оказаться в корне неверными. Пока не создан прототип и не определена его успешность, нельзя делать никаких выводов о работе системы (это просто бессмысленно). В любом случае, для меня очень важна критика, особенно если я изобретаю велосипед. Заранее благодарю за комментарии.

Теоретические основания

Однойиз главных проблем в создании AGI является отсутствие ответа на вопрос: «Что такое сознание?». Возможно, мы смогли приблизиться к ответу с помощью меметики. Теория меметики подразумевает, что наравне с ДНК (генами) у людей существует дополнительный, более абстрактный репликатор — мем. Нас интересуют 3 положения из данной теории:

-

Меметика: идеи как автономные агенты

В работах Дэниела Деннетта и Сьюзан Блэкмор развита концепция мемов — единиц культурной эволюции, которые конкурируют за внимание и воплощение в носителях.

Ключевой тезис: человеческое «Я» является не источником идей, а фильтром. Мы не придумываем мысли, мы выбираем их из потока, порождённого культурной эволюцией и внешней средой.

-

Эго‑туннель

Томас Метцингер в «Эго‑туннеле» предлагает теорию самомодели. Сознание — это виртуальная реальность, генерируемая мозгом. Внутри этой реальности существует модель самого себя как субъекта переживаний. Эта модель настолько прозрачна (мы не видим её как модель), что создаёт иллюзию «Я».

-

Теория Фильтра Дональда Бродбента

Идея, согласно которой мозг не источник сознания, а скорее фильтр, который отбирает наиболее значимые в данный момент сигналы.

Также был проведён ряд исследований и симуляций. Важные, на мой взгляд, я поместил в таблицу.

|

Тематика |

Наблюдение в симуляции |

Ссылка на источник |

|

Конкуренция за внимание |

Мемы конкурируют за ограниченный ресурс внимания агентов |

|

|

Эволюция сложности |

Простые мемы постепенно усложняются до многослойных конструкций |

|

|

Вариативность |

Новые структуры появляются чаще, чем отбираются новые |

|

|

Эффект ореола |

Привлекательность источника влияет на передачу мема |

|

|

Культурное наследование |

Агенты предпочитают мемы схожие с их историей |

Теорию меметики часто критикуют и не просто так. Дело в том, что пока не удалось доказать основные положения теории и провести симуляцию или эксперимент, в которых мемы приводят агента к возникновению у него сознания. Также мне не удалось найти исследование симуляции, где реализовано равное взаимодействие генов и мемов (возможно, плохо искал). Вместе с этим из работы в работу разняться базовые определения сознания, субъекта, агента и т.д.

Размышления

Чтобы сдвинуться с мёртвой точки, можно выдвинуть гипотезу, далее проверить её в экспериментах и сделать соответствующие выводы.

Гипотеза: сознание агента проявляется от определённого устройства (архитектуры) среды, в которой существуют, функционируют и эволюционируют мемы, а также от накопления контекста из внешнего мира или симуляции при условии субъектности агента.

Подобная гипотеза не отрицает, что для проявления сознания необходимы определённый порог вычислительной мощности и сложность организации среды для эволюции мемов. Однако она обязывает описать такую модель сознания, которая будет порождать субъектность агента и в которой мы сможем наблюдать эволюцию мемов, а также симуляцию, в которой сознание сможет существовать.

Т.е. у нас получилось ограничить задачу до поиска подходящей архитектуры системы, а главным результатом в эксперименте станет синтез или имитация субъектности агента. Важно отметить, что у меня нет цели получить сознание в общем понимании этого слова. Для начала я хочу получить только 1 аспект — субъектность. Возможно, другие аспекты сознания (например интеллектуальность или индивидуальность) могут стать дополнительными слоями над субъектностью.

Какая архитектура позволит имитировать субъектность?

Модель сознания

Если обобщить теорию, то задача выглядит примерно так: необходимо имитировать малую часть человеческого сознания и дать ей возможность получать субъективный опыт.

Субъективный опыт формирует субъектность или же субъектность формирует субъективный опыт?

Пользуясь знаниями из нейробиологии, теории меметики и теории агентов установим ряд определений и положений для системы.

Приступим:

-

Мир симуляции (далее симуляция) — упрощённая модель реального мира, функционирующая по определённым, заранее заданным, законами правилам для исследования поведения агентов.

-

Агент — это автономная сущность, которая воспринимает среду (симуляцию) через сенсоры (программные или аппаратные), обрабатывает данные с использованием внутренней модели мира и воздействует на среду через эффекторы, а также подчиняется законам симуляции. Данное определение взято из теории многоагентных систем (МАС). Для нашей модели дополним: агент является суммой «тела» и «сознания».

-

Тело агента — ограниченная среда (интерфейс), созданная для взаимодействия сознания агента с симуляцией. Можно сказать, что тело — это проекция сознания в симуляции.

-

Сознание агента — субъективный образ объективного мира (симуляции), который обеспечивает ориентацию агента в мире и возможность саморегуляции его деятельности. Сознание порождает субъективную конструкцию «Я».

Сознание агента дополнительно разделим на разное понимание «Я»:

-

В широком смысле «Я» — все понятия, связанные с агентом: его сознание, мысли, память, субъектность, состояние тела, след агента в симуляции и память о выбранном агенте (его сущности и действиях) у других агентов.

-

«Я» как субъект — сознание и тело агента, мыслительный процесс и управление телом.

-

«Я» как сознание агента — если сознание «управляет» телом для взаимодействия с симуляцией, то можно ограничить конструкцию «Я» до сознания.

Перед тем как дать более узкое определение «Я», погрузимся в проектирование модели сознания.

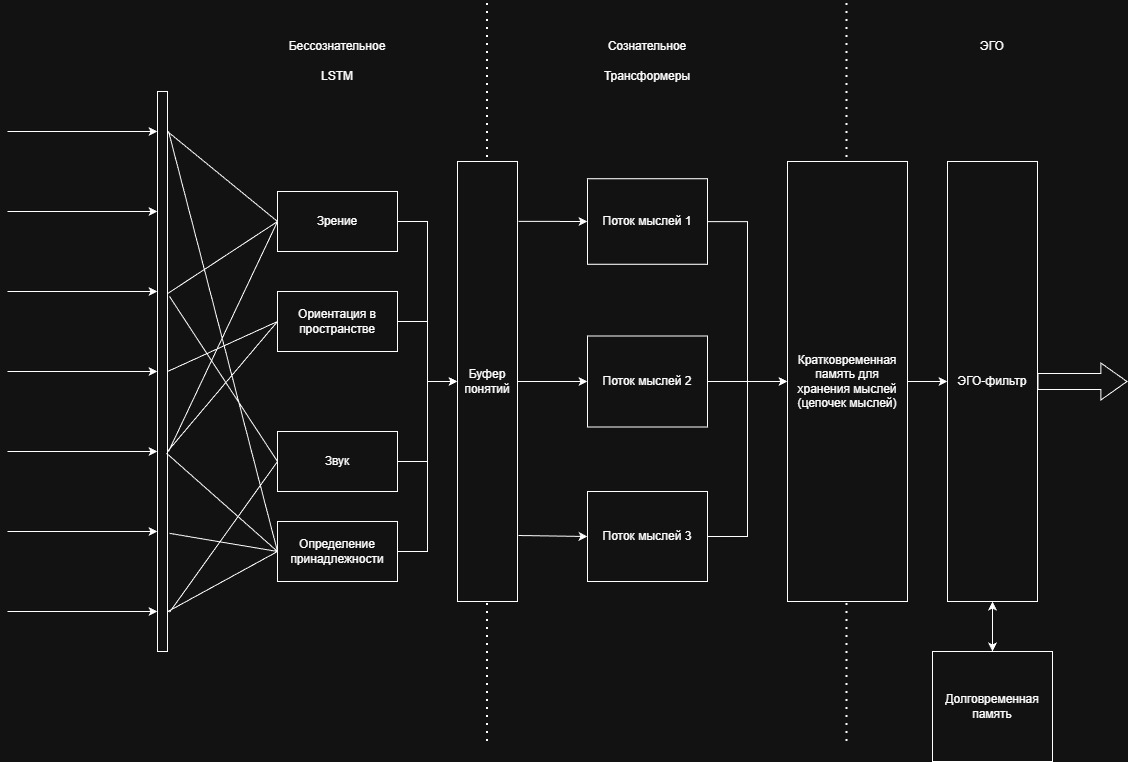

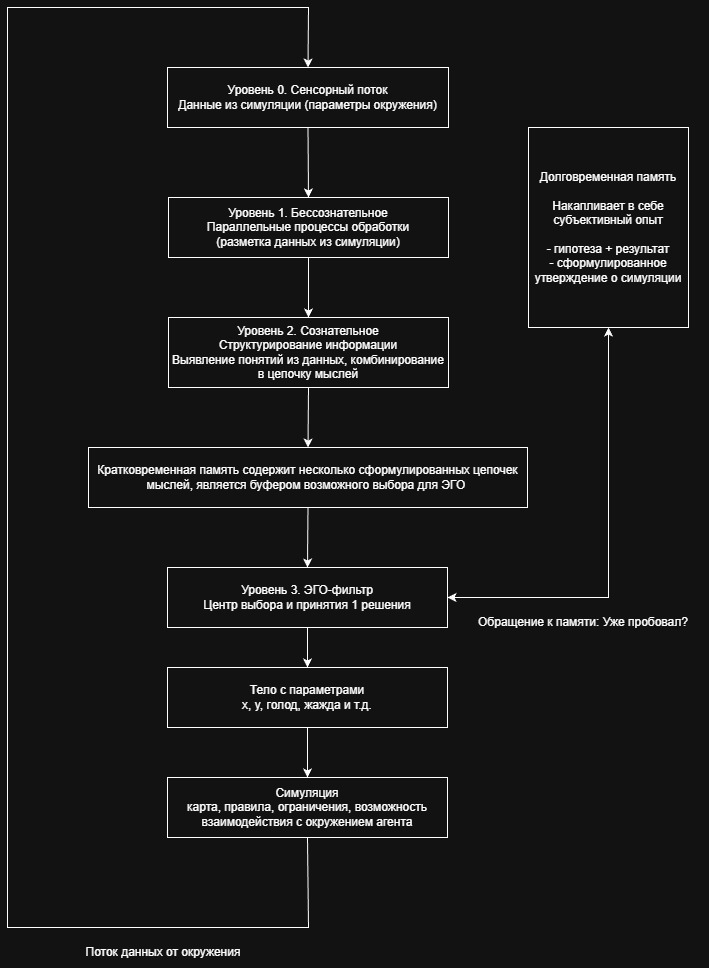

На рисунке 1 я попробовал представить, как данную систему можно реализовать в общем плане. На рисунке 2 формальная блок‑схема.

Для нас более важен рисунок 1. Продолжим сужать понятие «Я». Информация, которая поступает из симуляции точно не является частью «Я». Далее можно уменьшить понятие «Я» до «сущности» принимающей решения. Тогда, если бессознательное и сознательное необходимы для формирования потока мыслей, то к понятию «Я» они тоже не относятся. Получаем конструкцию «ЭГО‑фильтр», которая в совокупности с памятью содержит в ряд функций:

-

World Model — предсказание событий

-

Self Model — скрытое состояние = «Я» + оценка параметров тела

-

Value Network — оценка действий

-

Goal System — проверка обучаемости (насыщения) модели

Идея заключается в обучении ЭГО‑фильтра не на зашумлённой информации из симуляции, а на тестировании гипотез и формирования обратной связи из симуляции посредством тела. Показатели тела ухудшаются = «Я» выбираю неверно. И ЭГО‑фильтр обучается когерентности (соответствию своей модели «понимания» симуляции), а не максимизации внешней награды.

Таким образом, агент сможет изучить симуляцию, оптимально решить задачу выживания, и в этот момент мы будем фиксировать насыщение модели и накладывать штраф за отсутствие изменений (можно сказать аналог скуки). Сработает Goal System и цель агента измениться с выживания на новую. Новая цель будет составлена с помощью дополнительной итерации сознательного из субъективного опыта, который агент получил в симуляции. Вариантов множество, и они ограничены лишь возможностями симуляции и моими знаниями в коде.

Настоящее непаханое поле для исследований деструктивного и девиантного поведения. Вишенка на торте — добавить старение агента, генетический алгоритм и взаимодействие «родитель‑ребёнок». Настоящий ужас программиста, но в этой статье точно не об этом.

Самое узкое определение: «Я» — фильтр поступающих мыслей, имеющий возможность реализовать их в мире симуляции с помощью тела. В архитектуре блок, отвечающий за «Я», называется ЭГО‑фильтр.

Из всего вышесказанного, основной задачей будет тренировка ЭГО‑фильтра.

Детальнее про Сознательное и Бессознательное

Если я ставлю такую задачу, и поток данных для ЭГО‑фильтра зависит от групп «Сознательное» и «Бессознательное», значит данные группы должны быть обучены заранее на искусственном датасете. Причём логика архитектуры из рис. 1 сохраняется. Сначала я обучаю группу «Бессознательное». Предполагаю, что я могу разделить данные для нескольких нейронных сетей. Звук для одной, местоположение для другой и так далее

Трудности возникают с определением принадлежности действия. Нужно ли вообще помечать данные, что на них оказал влияние агент? Скорее нет, чем да, потому что именно такой промежуточный результат мы хотим получить на группе «Сознательное».

Группа «Сознательное», формируя цепочки мыслей как раз и будет создавать имитацию субъективного опыта и логики взаимодействия с симуляцией для ЭГО‑фильтра. В группе «Сознательное» нейросети аналогичны друг другу, но имеют разные веса, чтобы создавать разные комбинации мыслей.

Время для сознания и агента различно

Рассмотрим ситуацию в нашем реальном мире: передвижение из пункта A в пункт B. Обусловимся, что это пешая прогулка длиной ~30 минут.

Пока тело выполняет одну задачу (передвижение), человеческое сознание может размышлять о разных контекстных вещах (субъективных переживаниях). Предположим, что в момент размышления органы чувств используются опосредовано, и мы сосредоточены на наших мыслях. Именно в подобные моменты приходят озарения. Было бы глупо лишать агента возможности «подумать».

Тогда нужно переопределить назначение кратковременной памяти. В ней должна быть фиксированная область для действий, которые находятся в статусе «в процессе выполнения». И в момент размышлений для агента формируется контур «Сознательное + ЭГО‑фильтр», позволяющий размышлять без изменений в симуляции. Об этом немного подробнее ниже.

Обратимся к определениям эпохи для модели:

Эпоха (epoch) в машинном обучении (ML) — это один полный проход по всему набору обучающих данных в процессе обучения модели, например, нейронной сети. Каждый образец используется ровно один раз для обновления весов модели.

В философском смысле эпоха — это цикл восприятия и коррекции: модель не просто просматривает данные, а заново их «проживает», каждый раз уточняя внутреннюю карту связей.

Если пользоваться данными определениями, то имеет смысл привязать систему отсчёта эпох к шагам агента в симуляции. Т.е., если агент хочет переместиться на расстояние N клеток (без учёта клетки цели и клетки где стоит агент) И дорога уже знакома, можно размышлять N-1 раз.

Дополнения к архитектуре

Было бы очень интересно дать возможность группе «Бессознательное» влиять на тело, имитируя рефлексы, но я не уверен в правильности такого подхода.

Контур «Сознательное + ЭГО‑фильтр» из жизни логичен, но в контексте задачи выживания агента является избытком. И в случае статичного мира (без животных) реализация очевидна, но как только в симуляции появляются другие сущности или агенты, необходимо каждый раз обновлять поток входных данных (нет ли никого или ничего нового вокруг).

Всё это усложняет и так сложную теоретическую модель, а это я даже пока к практике не перешёл. Я остановлюсь на этих рассуждениях.

В данной статье представлена общая концепция ЭГО‑фильтра. Более конкретную реализацию и применение данной архитектуры к прикладным задачам я опишу в следующих статьях.

Модель симуляции

С симуляцией всё намного проще. Например, мир RimWorld.

Многое уже реализовано, однако для обучения системы необходимо внести изменения:

-

Игру необходимо упростить, чтобы лучше контролировать обучение. Удалить оружие, экипировку, здания и возможность их строить и так далее. Для первых экспериментов важно выявить простые паттерны в поведении модели и многократную способность составлять логические цепочки мыслей.

-

Ограничить видимость на определённый радиус вокруг агента и реализовать запоминание карты (на игровом сленге туман войны). Т.е., чтобы не умереть от жажды, агенту нужно запомнить местоположение клетки с водой или находиться рядом с водой, чтобы клетка была в зоне видимости. По аналогии с любым другим ресурсом.

-

Помимо визуальной информации (для нас визуальной, а для агента текстура дерева — это лишь информация о клетке с параметром: дерево) будет полезно наполнить мир для агента звуками. Каждая определённая клетка (вода, дерево, животное) должно «издавать» звук. В первую очередь для агента. Из этого следует целая дополнительная система в симуляции с простой логикой: чем ближе к источнику, тем звук громче.

Подобные дополнения и ограничения сделают мир для агента более комплексным. Будет интересно понаблюдать за формированием взаимосвязей в модели (слышу звук воды → источник: вода).

По сути я пользуюсь положениями для реализации воплощённого ИИ (подходящее объяснение в статье) в данном вопросе, чтобы синтезировать свою систему.

Заключение

Всё же в моей архитектуре остаётся больше вопросов, чем ответов. Я могу только в ходе тестов и экспериментов подтвердить, дополнить или опровергнуть мою теорию. Это уже точно тема следующих статей.

❤ Спасибо, что дочитали до конца.

Повторюсь, что буду рад комментариям с предложениями и критикой.

Автор: andrey_krsv