Каждый первый в моём окружении пользуется ChatGPT. По последним данным, количество еженедельных пользователей этого чат-бота стремится к миллиарду. Но в то же время НАФИ и «Ингосстрах» провели исследование, по результатам которого выяснилось, что 43% россиян готовы отказаться от ИИ навсегда. Давайте разбираться.

Меня зовут Сергей Козлов, я директор CRM-системы Мегаплан и системы для ведения Баз знаний Collabis. Так как ИИ — тема модная, все кому не лень занялись исследованиями. А я решил собрать и обобщить их для читателей Хабра.

Страх за карьеру

Разработчики Мегаплана регулярно скармливают небольшие, нарезанные кусочками задачи в ИИ, чтобы он за них программировал. Тут, на мой взгляд, всё окей: ускорение процесса разработки — то что надо.

За последние годы появилось множество новых профессий: промпт-инженер, ИИ-тренер, специалист по этике ИИ, ИИ-фасилитатор. Вместе с тем в Сети то и дело прогнозируют, кого технологии оставят без работы.

Масла в огонь подливают и корпорации. Сбер сократил 20% инженеров в 2025 году, массовые увольнения были и снова ожидаются в Amazon, а по слухам, «тренд» поддержат также Block и запрещённая и признанная экстремистской в России Meta.

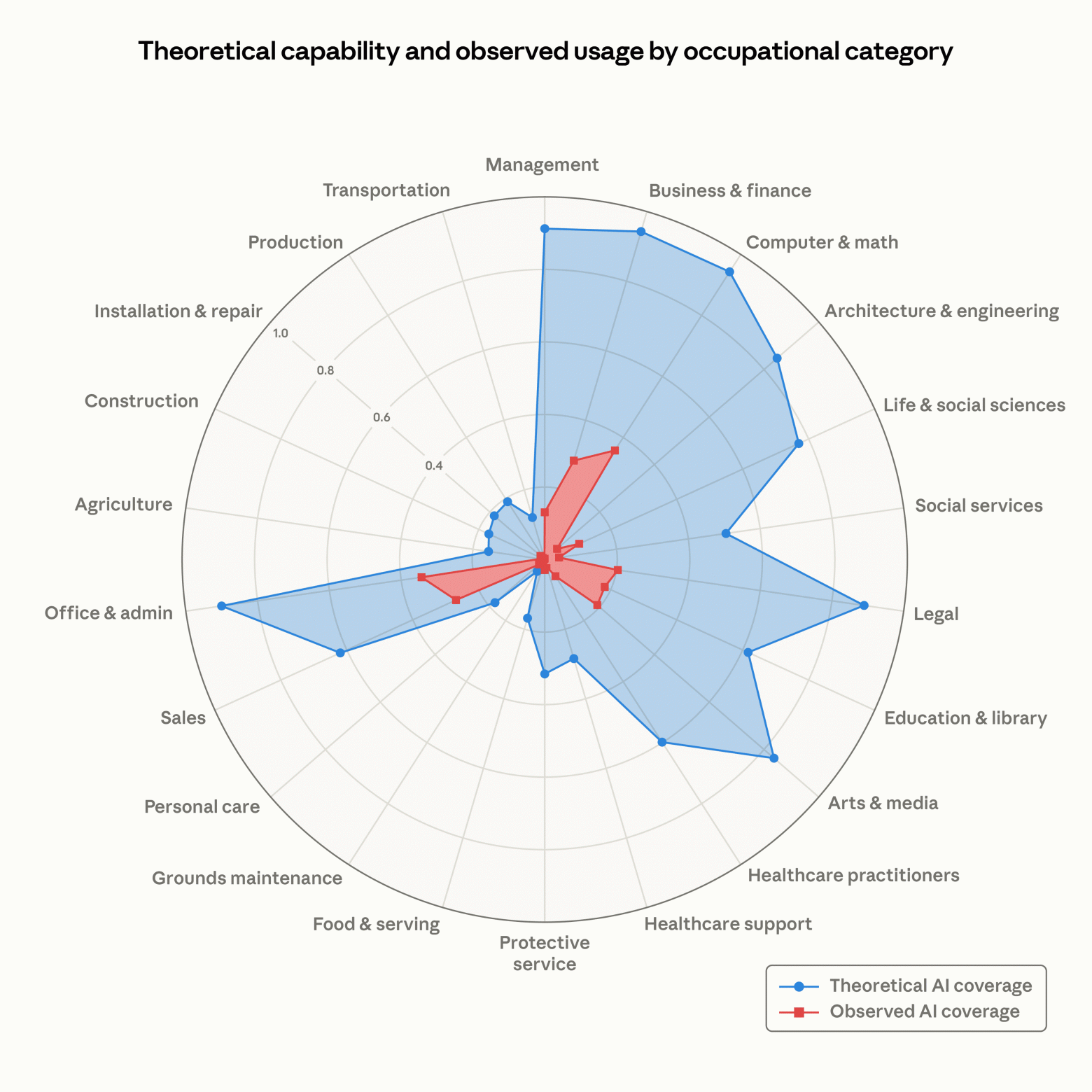

Недавно компания Anthropic выпустила любопытное исследование о влиянии ИИ на рынок труда. Вот как, например, выглядит разница между теоретическим и практическим использованием платформы Claude.

Создатель Claude Code Борис Чёрни и вовсе недавно заявил, что к концу года профессия программиста исчезнет — на смену разработчикам придут те, кто управляет ИИ-агентами. Кстати, недавно в Jira появилась возможность ставить задачи на ИИ-агентов таски.

Илон Маск недавно заявил, что со временем у людей исчезнет необходимость трудиться, причём благодаря ИИ и роботам денег будет много. По мнению бизнесмена, все профессии станут необязательными, а у каждого человека появится свой человекоподобный робот.

Однако есть мнение, что ИИ — это лишь прикрытие для массовых сокращений. Кроме того, наблюдается тенденция к повторному найму тех, кого хотели заменить нейросетями. А значит, компании ещё сами не разобрались, какую пользу им принесут новые технологии.

Вообще говоря, важно понимать, зачем и для чего вы используете ИИ. Например, в комментариях к одной из прошлых статей я словил хейт за сгенерированные картинки (выводы сделаны :)). И наверняка многие сталкивались с иишными текстами, в том числе в личке. Это откровенно плохо, но таковы реалии нашего времени.

Оптимизм

Также я использую ИИ как ассистента. Он помогает анализировать большие объёмы данных, писать выводы и рекомендации. Приходится проверять, но польза явно есть.

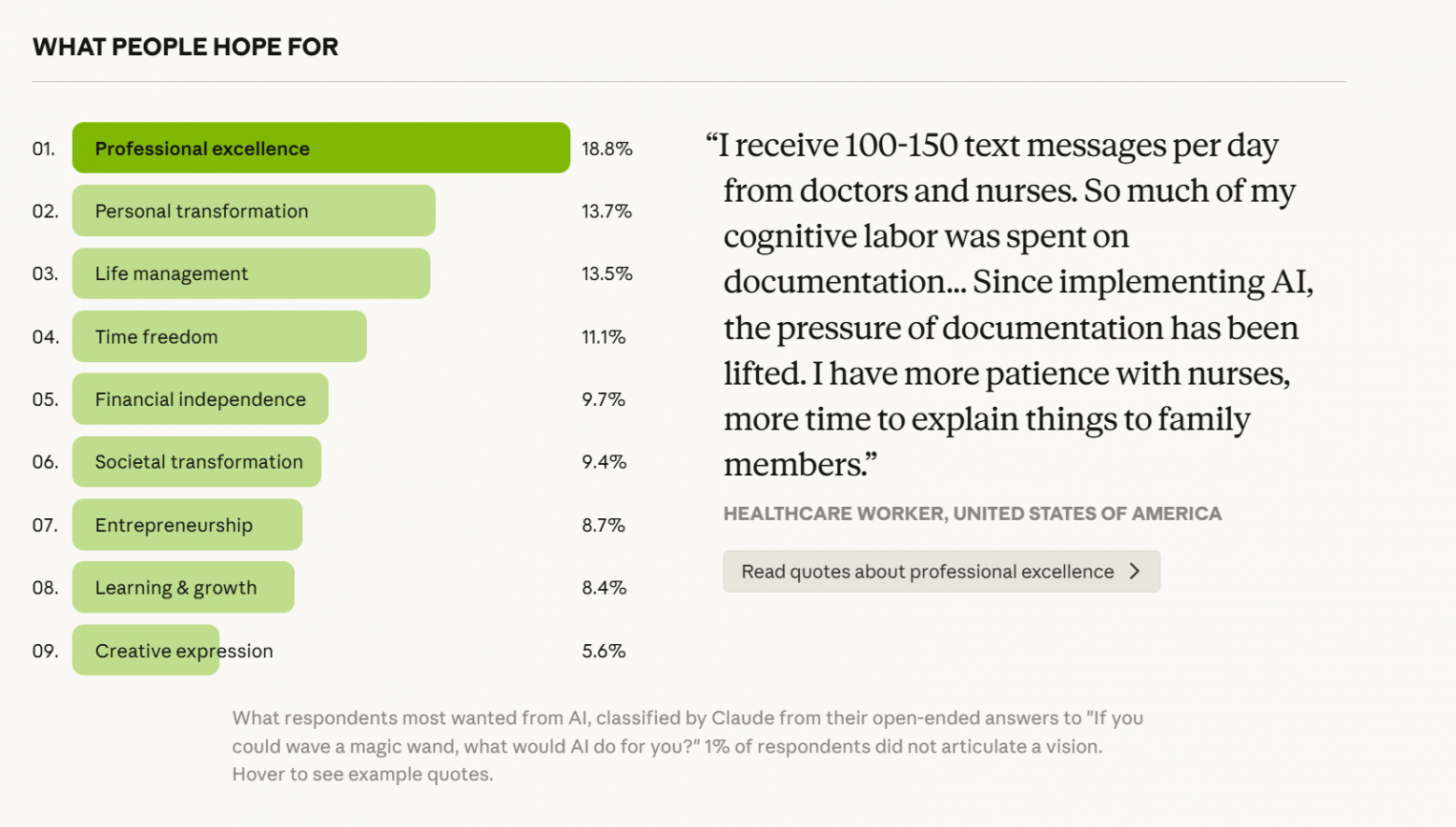

Здесь хочется подробнее остановиться на ещё одном свежем исследовании Anthropic, в котором приняли участие более 80 тысяч пользователей Claude из 159 стран. Выяснилось, что больше всего люди надеются, что ИИ поможет им в профессиональном совершенствовании (18,8%), личной трансформации (13,7%) и управлении собственной жизнью (13,5%).

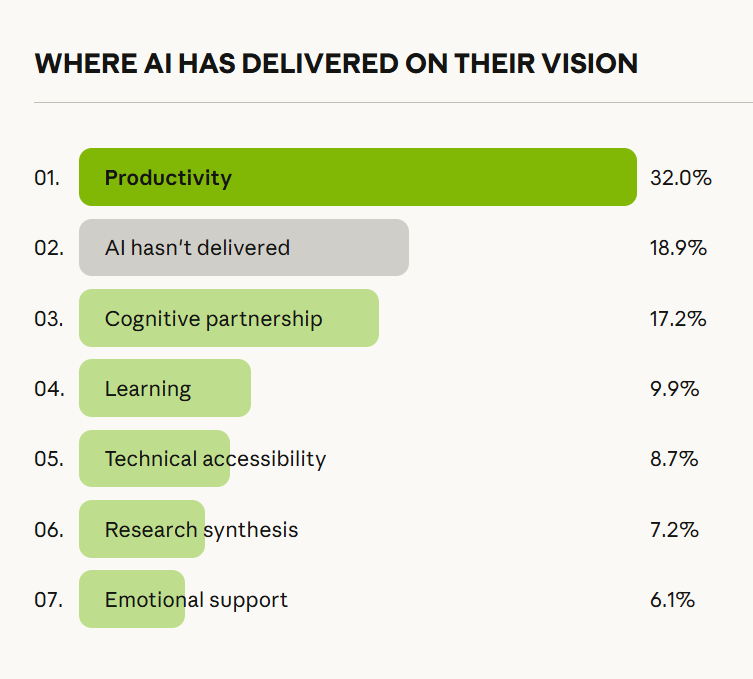

Но получаем ли мы от технологий то, чего хотим? Чаще всего ИИ оправдывает ожидания в том, что касается продуктивности (32%), когнитивного партнёрства (17,2%) и обучения (9,9%). Впрочем, второй по популярности ответ — «ИИ не оправдал ожиданий» (18,9%).

И несмотря на все «но», уже есть совершенно удивительные истории, которые показывают, как ИИ буквально спасает жизни. Недавно завирусилась история ИТ-предпринимателя из Австралии, который создал персонализированную вакцину для своей собаки, заболевшей раком кожи. В этом ему помогли ChatGPT, AlphaFold и, конечно, учёные. Вдохновляет — не то слово!

Тревога за будущее

Самый спорный сценарий использования технологий — когда за каждым повседневным жизненным действием или решением обращаются к ИИ. От вопроса, прав ли был гаишник, выписавший штраф, до того, какое лечение выбрать для больного. Неоднозначно.

В 4-й серии нового, десятого сезона «Клиники» доктор Элиот Рид возмущается, что они учились медицине полжизни, а пациент посидел 30 секунд в туалете с телефоном и уже выдаёт диагноз и курс лечения. А 5-я серия, полностью посвящённая теме ИИ, начинается с того, что Джей Ди сам спрашивает у искусственного интеллекта, как сочетаются лекарства.

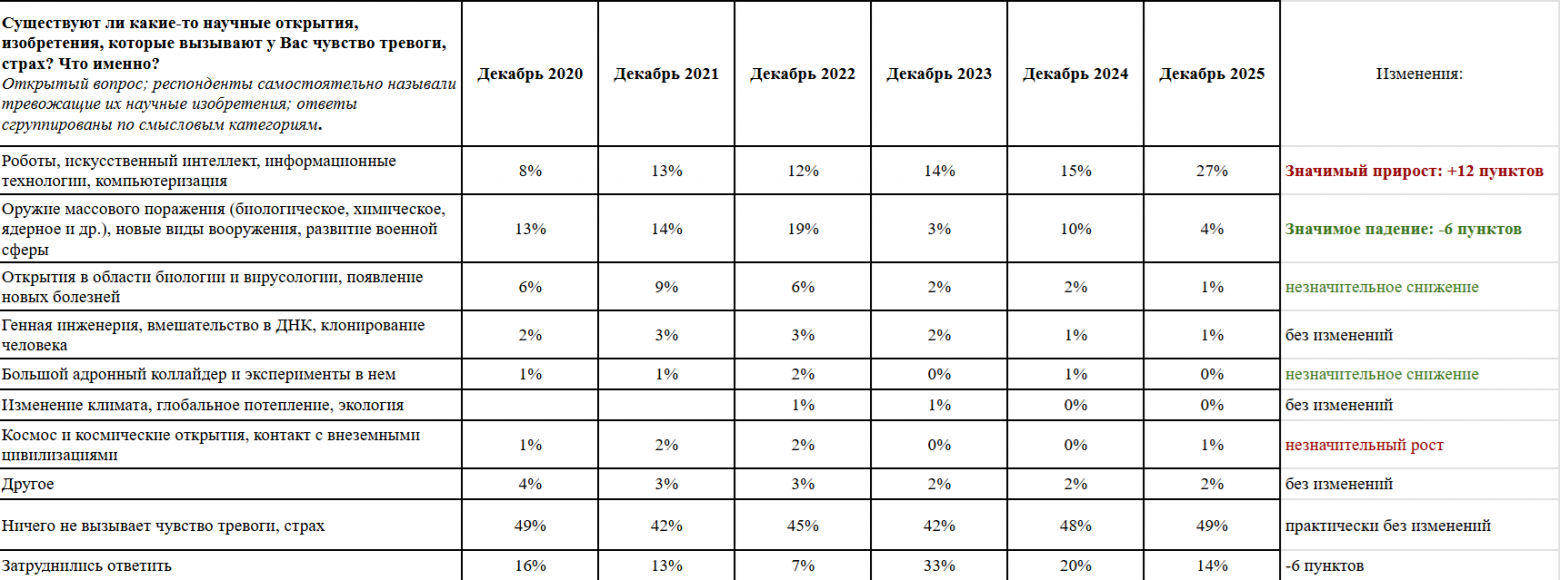

ИИ третий год подряд возглавляет рейтинг наиболее тревожащих направлений научного прогресса — это фиксирует телеканал «Наука», который с 2016-го проводит мониторинг страхов в отношении научных достижений. При этом по итогам 2025-го доля россиян, которых пугает развитие искусственного интеллекта и нейросетей, увеличилась более чем в полтора раза: с 15% до 27%. Как подчеркнули исследователи, это самое заметное изменение в структуре ответов.

Так чего же мы боимся? Респонденты отмечали, что ИИ и нейросети развиваются слишком быстро и неконтролируемо. Участников исследования также страшит «порабощение человека роботами», создание автономных нейросетей и суперкомпьютеров, замена рабочих мест искусственным интеллектом и роботизация».

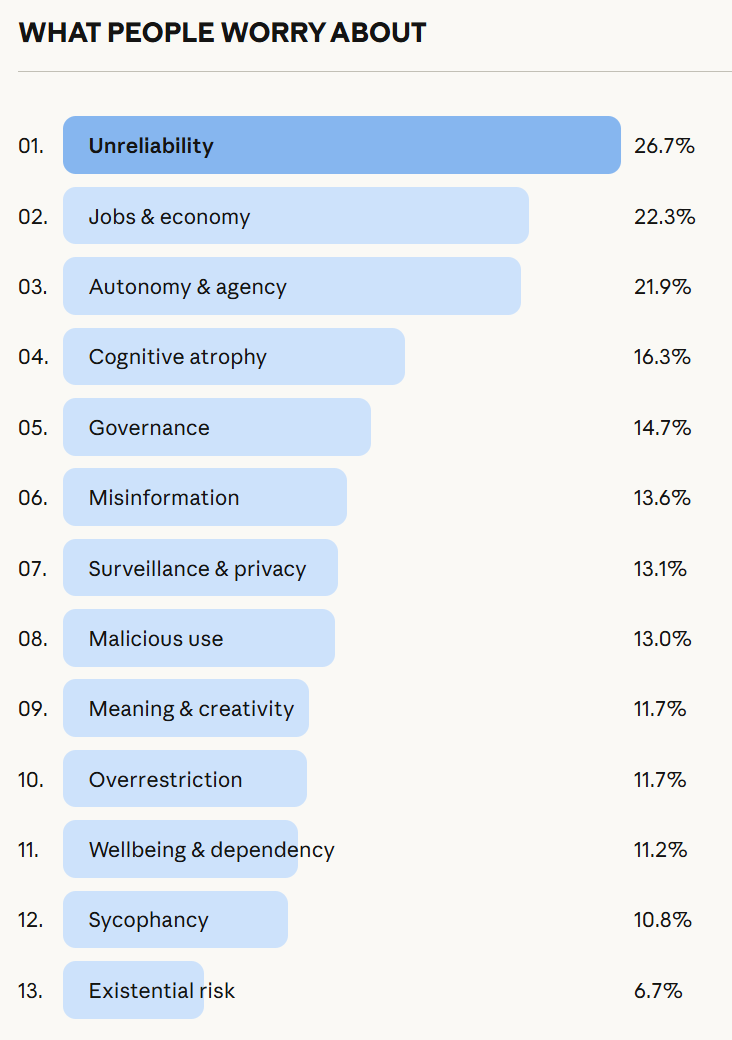

По данным Anthropic, топ страхов, связанных с ИИ, возглавляет ненадёжность. Мы боимся «галлюцинаций» и ошибок ИИ. И это, судя по результатам исследования, страшит даже больше, чем сокращение рабочих мест, безработица и прочие экономические последствия, которые может повлечь за собой развитие технологий.

Нейросети действительно «врут», причём довольно часто. Например, поисковые системы с ИИ более чем в 60% случаев совершают серьёзные ошибки при цитировании новостных источников, говорится в прошлогоднем исследовании Центра цифровой журналистики Тоw при Колумбийском университете. Выше всего этот показатель у Grok — 94%, на втором месте ChatGPT Search с 67%, а Perplexity выдала неверную информацию в 37% запросов.

Кстати, для тех, кого беспокоит развитие технологий, даже придумали свои термины:

-

AI-nxiety — ИИ-тревожность. Комбинация слов AI — искусственный интеллект, а также anxiety — тревожность.

-

Неолуддизм. В 1811 году по всей Англии распространилось движение луддитов — протестующих против внедрения машин. А три века спустя появились неолуддиты — они, в свою очередь, стремятся помешать развитию технологий.

-

ИИ-веганство. Его адепты ограничивают или вовсе не используют технологии искусственного интеллекта в повседневной жизни, работе и учёбе. Как уже привычный цифровой детокс, но с акцентом.

Настороженность

Развитие технологий сделало уловки кибермошенников ещё более изощрёнными. С помощью ИИ подделывать сообщения от «банков», «служб доставок», «знакомых» теперь проще и быстрее.

Успешны ли эти затеи? Ещё как. Из отчёта Digital Defense Report 2025 от Microsoft следует, что на фишинговые письма, автоматизированные с помощью ИИ, кликают более чем в половине случаев (54%). Для сравнения: у писем, составленных людьми, этот показатель в 4,5 раза ниже — 12%.

Противостоять хитрым приёмам получается не всегда и не у всех. Но всё же мы стали с большей опаской относиться ко всему, что видим в интернете: фото близкого или знакомый голос вполне может оказаться дипфейком. И это правильный подход — лучше проигнорировать сомнительное сообщение или перезвонить в банк самому, чем потом пытаться выяснить, куда делись деньги со счёта.

Ощущение поддержки

Или зависимость?

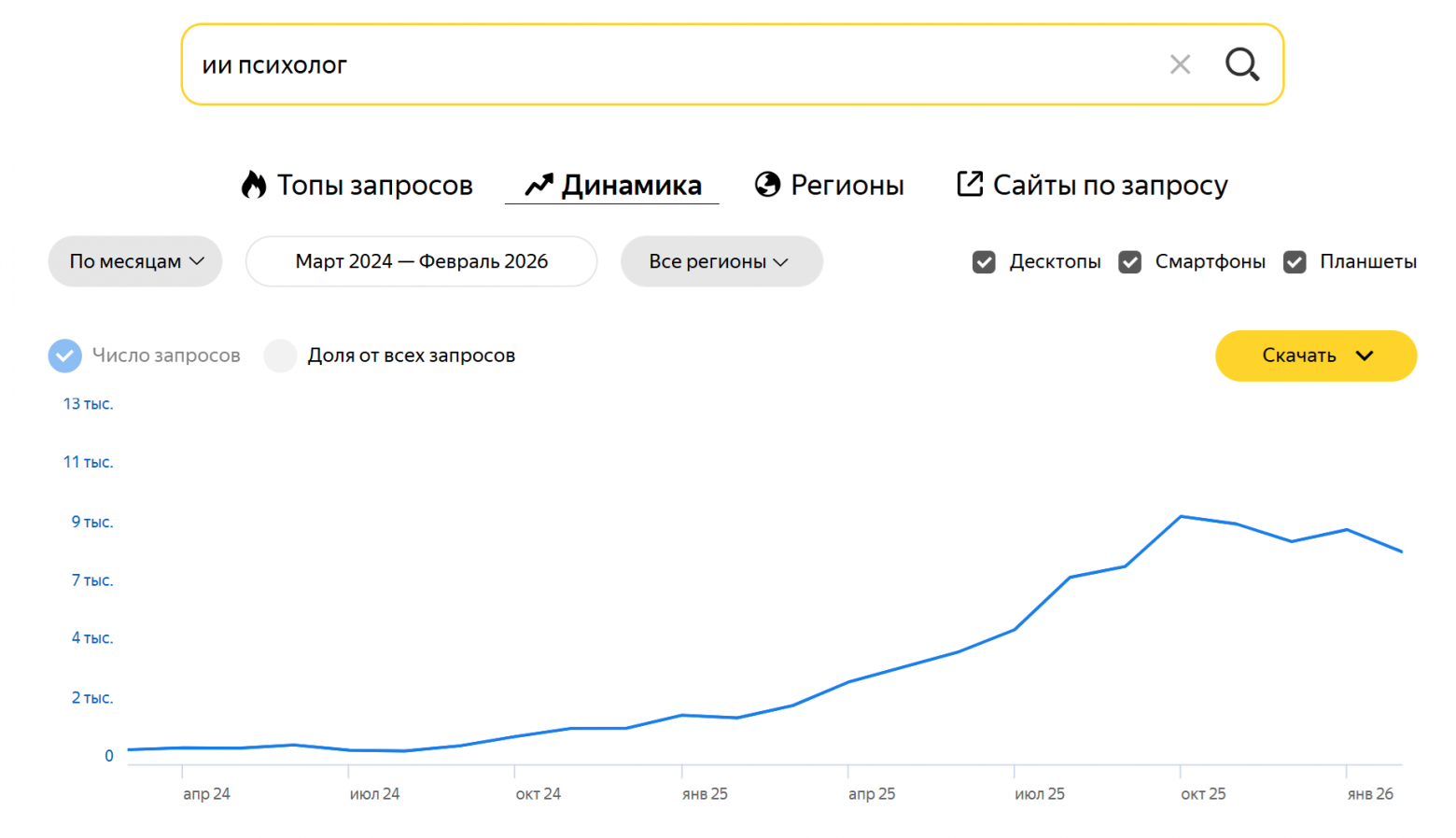

Искусственный интеллект сегодня выступает даже в роли психологов. К нему идут за поддержкой в самых разных ситуациях: если грустно, тревожно или нужно помириться со второй половинкой. ИИ-помощник точно найдёт что посоветовать и написать ему можно в любое время.

Но без подводных камней никуда. Недавно учёные из питерской «Вышки» выяснили, что большие языковые модели более чем в 20% случаев неадекватно отвечают на запросы пользователей, которые нуждаются в помощи психологов. Для сравнения: у «живых» специалистов этот показатель почти втрое меньше — 7%.

Нейросети могут нормализовать опасные симптомы, предлагать стратегии манипуляции, формировать эмоциональную привязанность (слышали о свадьбах с чат-ботами?) и не способны контролировать корректность применения психологических практик.

Впрочем, в прошлогоднем исследовании о том, как люди используют ChatGPT, говорится, что только 1,9% диалогов были определены как общение с ИИ-психологом. А сценариев «романтических отношений» с нейросетью вообще ничтожно мало — 0,4%.

Но если вы всё-таки решитесь на ИИ-разговор по душам — будьте аккуратны. Недавно учёные провели психотерапевтические сеансы с популярными ИИ-моделями — ChatGPT, Grok и Gemini — и выявили расстройства у всей тройки. Больше всего специалистов насторожило состояние Gemini.

Автор: MegaplanCEO