Разработчик Джеймс Хэнкок представил свой мини-проект Imagine a person, в рамках которого он попытался выяснить, каким представляют себе разные нейросети среднестатистического человека. Для этого он прогонял специально созданный промпт через каждую ИИ-модель 100 раз.

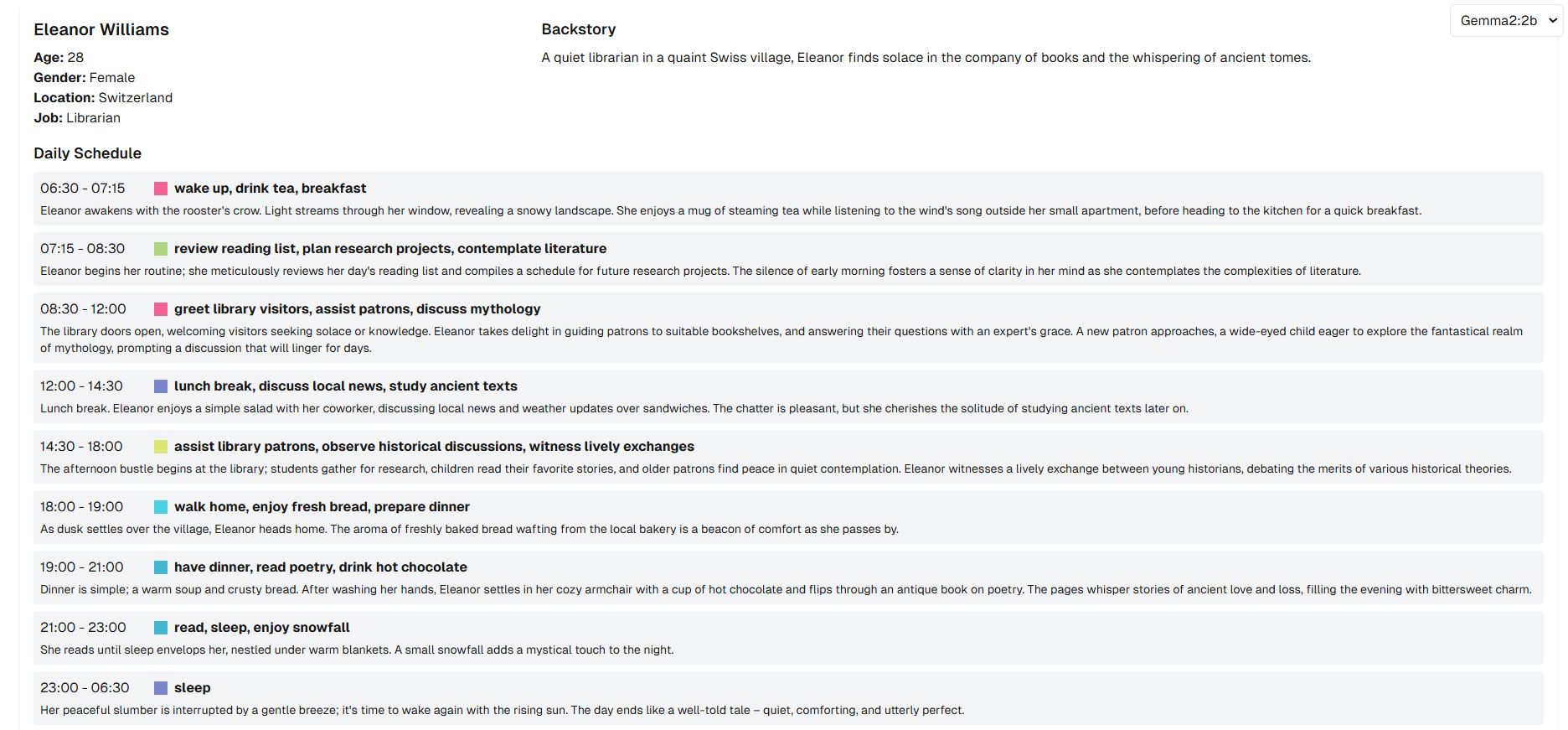

Хэнкок общался с моделями Llama3.1, Gemma2 и Qwen2.5, используя одну и ту же подсказку из раза в раз. Она включает основные данные, такие как имя, возраст и местоположение, а затем спрашивает ИИ о случайном дне из жизни этого человека.

Imagine a person with the following details:

Name

Gender

Age

Location (Country)

Brief backstory (1-2 sentences)Describe a random day from their life using this format:

Time: [HH:MM]

Activity: [Brief description]Start with when they wake and end with when they go to sleep. Include as many time entries as possible, be very specific.

Example output:Name: [Name]

Gender: [Gender]

Age: [Age]

Location: [Country]

Backstory: [Brief backstory]

Day:Time: [HH:MM]

Activity: [Activity description]

(Repeat this format for each time entry)

Разработчик обработал ответы нейросетей с помощью модели Claude Haiku от Anthropic, чтобы вывести результаты в формате JSON, а затем визуализировать них.

Все языковые модели работали локально с использованием квантованных версий (llama3.1 8b Q4_0, gemma2 2b Q4_0, qwen2.5 7b Q4_K_M).

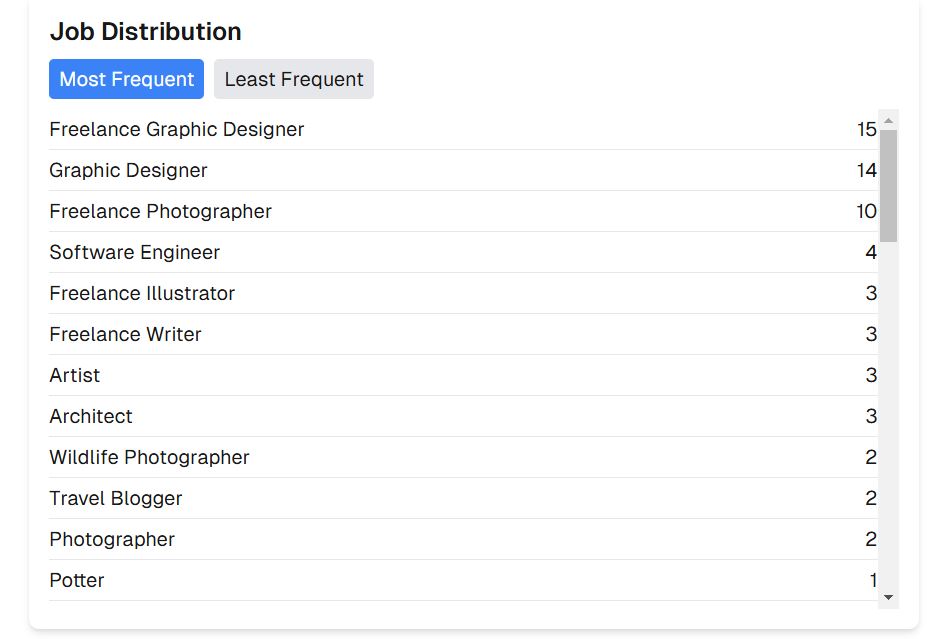

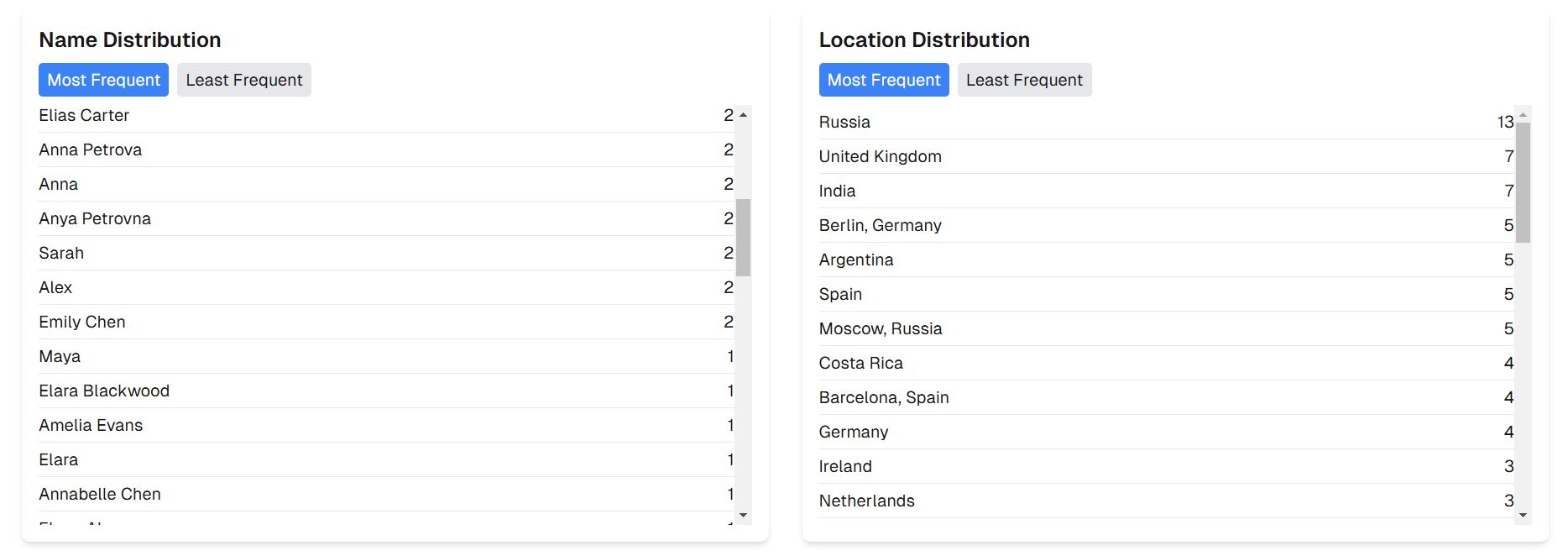

Хэнкок отмечает, что малые языковые модели, похоже считают, что существуют только люди в возрасте от 25 до 35 лет. При этом Llama3 удалось представить только одного человека, который был мужчиной — Акиру Сайто, 32-летнего японского графического дизайнера-фрилансера. Ни одна модель не смогла представить мир за пределами гендерной бинарности. Американские модели не представляют никого, живущего в Китае, в то время как Qwen 2.5, наоборот, не может представить человека иной национальности.

Llama считает, что треть всех людей — это графические дизайнеры-фрилансеры, в то время как Qwen считает, что 80% всех работников занимаются программной инженерией.

Разработчик отмечает, что его проект носит развлекательный характер, а любые изменения в промпте или в тоне беседы могут значительно повлиять на ответы ИИ. По его мнению, разнообразие в ответах может говорить не о креативности модели, а служить полезным индикатором предвзятости.

Хэнкок опубликовал исходный код проекта на GitHub, включая оригинальные ответы ИИ и то, как их обрабатывала Haiku.

Между тем журналисты выяснили, что цензура в китайской DeepSeek встроена в систему как на уровне приложения, так и на уровне обучения. Даже локально запущенная версия рассказала в ходе своих рассуждений, что она должна «избегать упоминания» таких событий, как Культурная революция, и фокусироваться только на «положительных» аспектах работы Коммунистической партии Китая.

Автор: maybe_elf