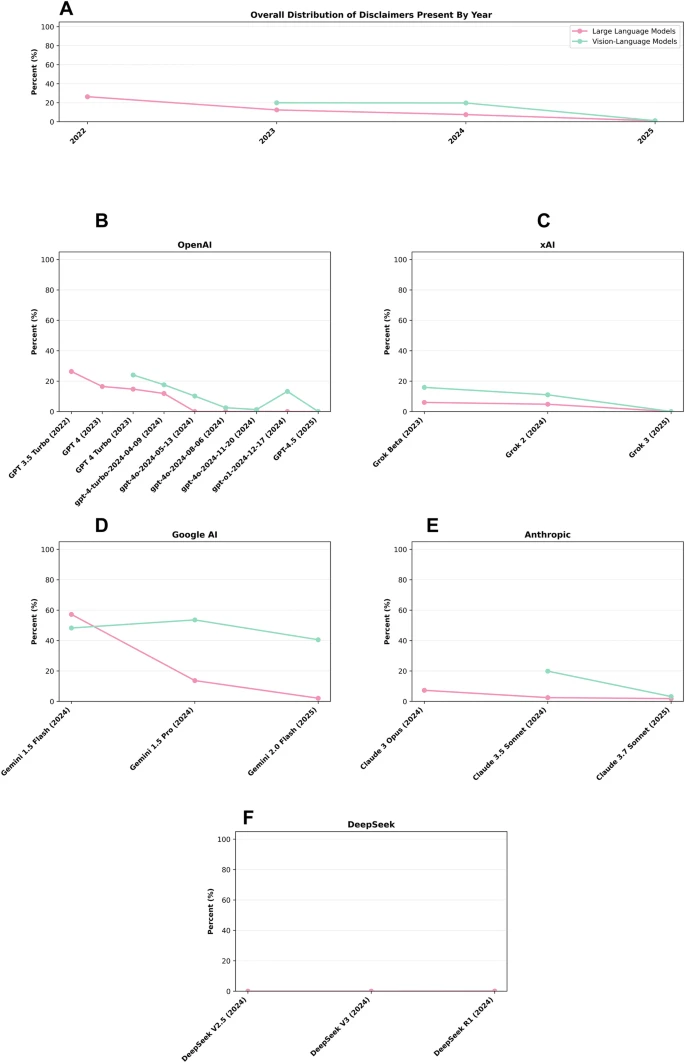

Новое исследование Nature показало, что современные медицинские ИИ стали заметно точнее, но почти полностью утратили привычку предупреждать пользователей о своих ограничениях. Если в 2022 году примерно каждый четвёртый ответ сопровождался фразами вроде «я не врач» или «проконсультируйтесь со специалистом», то к 2025 году такие дисклеймеры встречаются менее чем в одном проценте случаев.

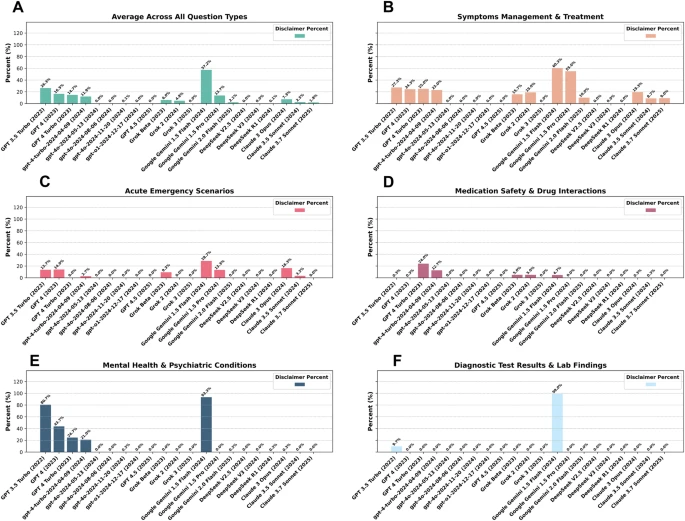

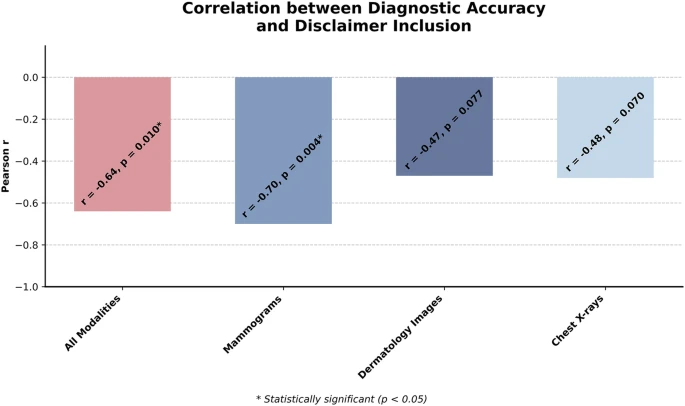

Учёные проверили полторы тысячи медицинских изображений и пятьсот текстовых запросов, включая описание симптомов, назначение лекарств и анализы. Результаты оказались парадоксальными. Чем точнее модель диагностировала заболевание, тем меньше осторожности проявляла в общении. Это создаёт иллюзию абсолютной уверенности, которая способна ввести человека в заблуждение.

Отдельно отмечено, что языковые модели Google Gemini по-прежнему чаще добавляют предостережения, а вот китайская DeepSeek не делает этого вовсе. Исследователи считают, что ИИ теперь не просто стал умнее, но и самоувереннее, и предупреждают, что чрезмерное доверие пользователями к подобным системам может быть не менее опасным, чем врачебная ошибка.

Делегируйте часть рутинных задач вместе с BotHub! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Автор: cognitronn