Представьте оркестр без нот и метронома: музыканты играют «как чувствуют», и мелодия каждый раз звучит по-другому. Так же ведёт себя генерация изображений по одному промпту — красиво, но неповторяемо. В работе с брендовым визуалом это ощущается особенно: дизайнерам приходится идти дальше простой текстовой инструкции и вручную подбирать референсы, выравнивать композицию, корректировать цвет, отбирать вариации и собирать их в единый стиль.

Мы в X5 Tech решили превратить генеративный ИИ из источника хаотичных вариаций в стабильный конвейер брендового визуала. Зафиксировали стиль, задали структуру, выстроили управление вариациями, и в итоге собрали рабочий пайплайн. Когда он заработал, скорость выросла почти вдвое, некоторые команды полностью отказались от фотостоков или значительно сократили их использование, а 40–45% визуального контента «Пятёрочки» и «Чижика» теперь создаётся с участием ИИ.

Меня зовут Майк Суворов, я Technical Product Manager по AI Solutions в X5 Tech. До этого много лет работал дизайнером, арт-директором и коммуникационным дизайнером.

В этой статье — разбор принципов, на которых держатся пайплайны управления генерациями: как модели помогают контролировать структуру и стиль, какую роль в этом играет дизайнер и за счёт чего связка ControlNet, LoRA, Style Reference и мультимодальных ИИ превращает генерации в предсказуемую систему.

Инструменты контроля структуры и стиля

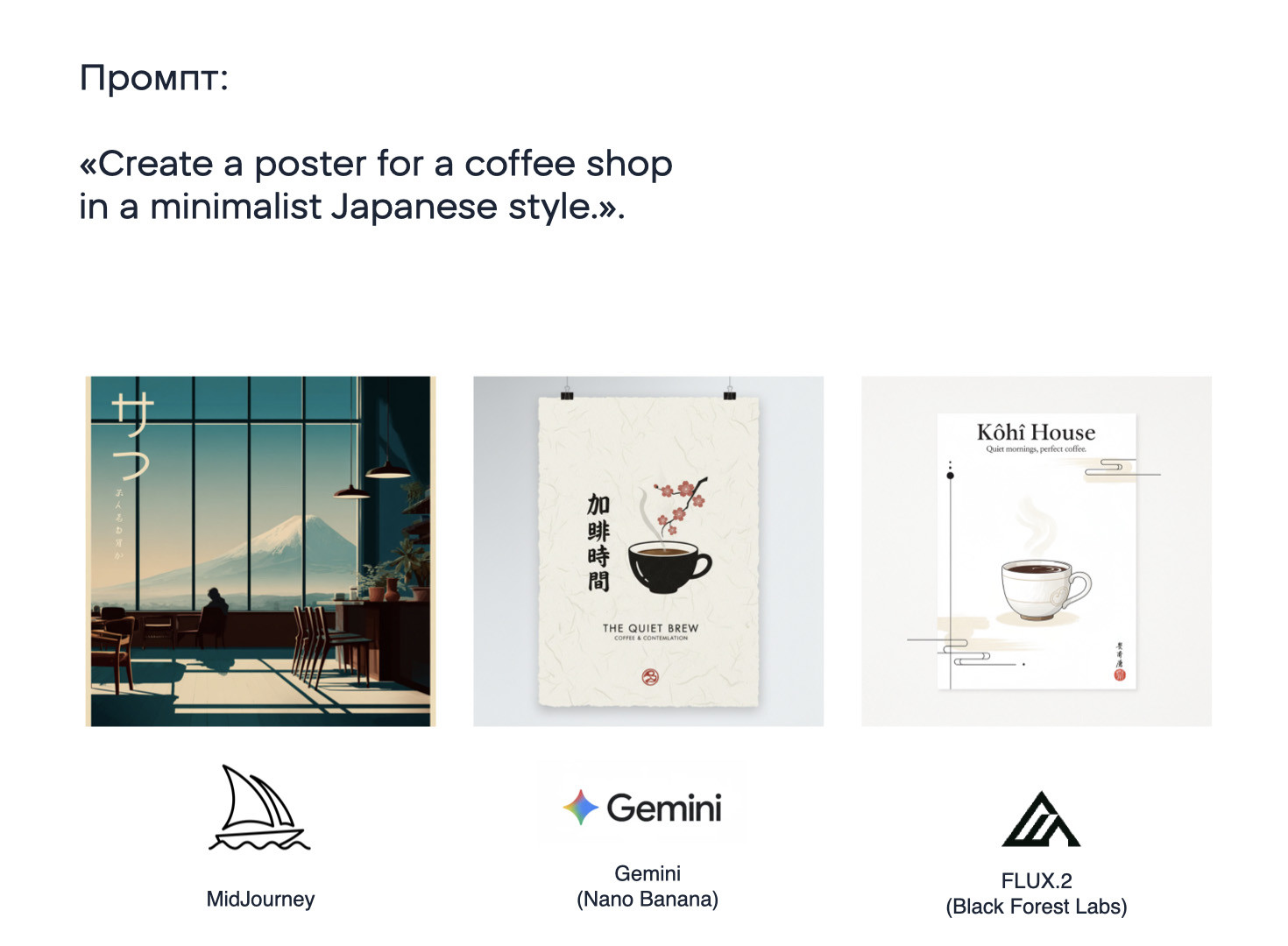

Как пишутся промпты для ИИ? Можно дать прямое указание вроде «Сделай то-то и то-то» и на выходе получить «какой-то артефакт». Но нейронные сети не экстрасенсы — без контекста и дополнительных указаний модель интерпретирует запрос не так, как вы ожидаете.

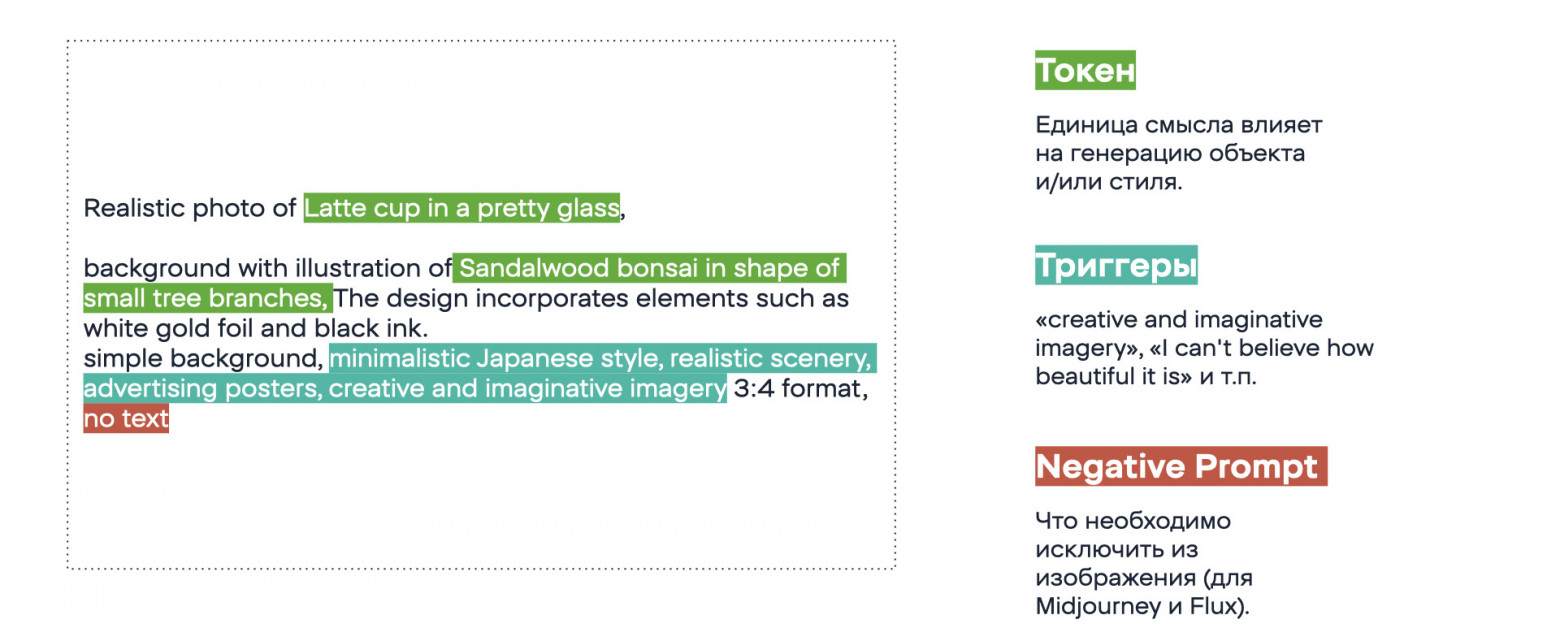

Чтобы получать управляемый результат, промпт нужно собирать как инструкцию, в которую включены:

-

токены или единицы смысла — элементы, которые обязательно должны появиться в изображении;

-

триггеры для описания стиля;

-

указания по формату результата — композиция, ракурс, фактура, детали;

-

негативные инструкции (опционально) — то, что категорически не должно попасть в изображение.

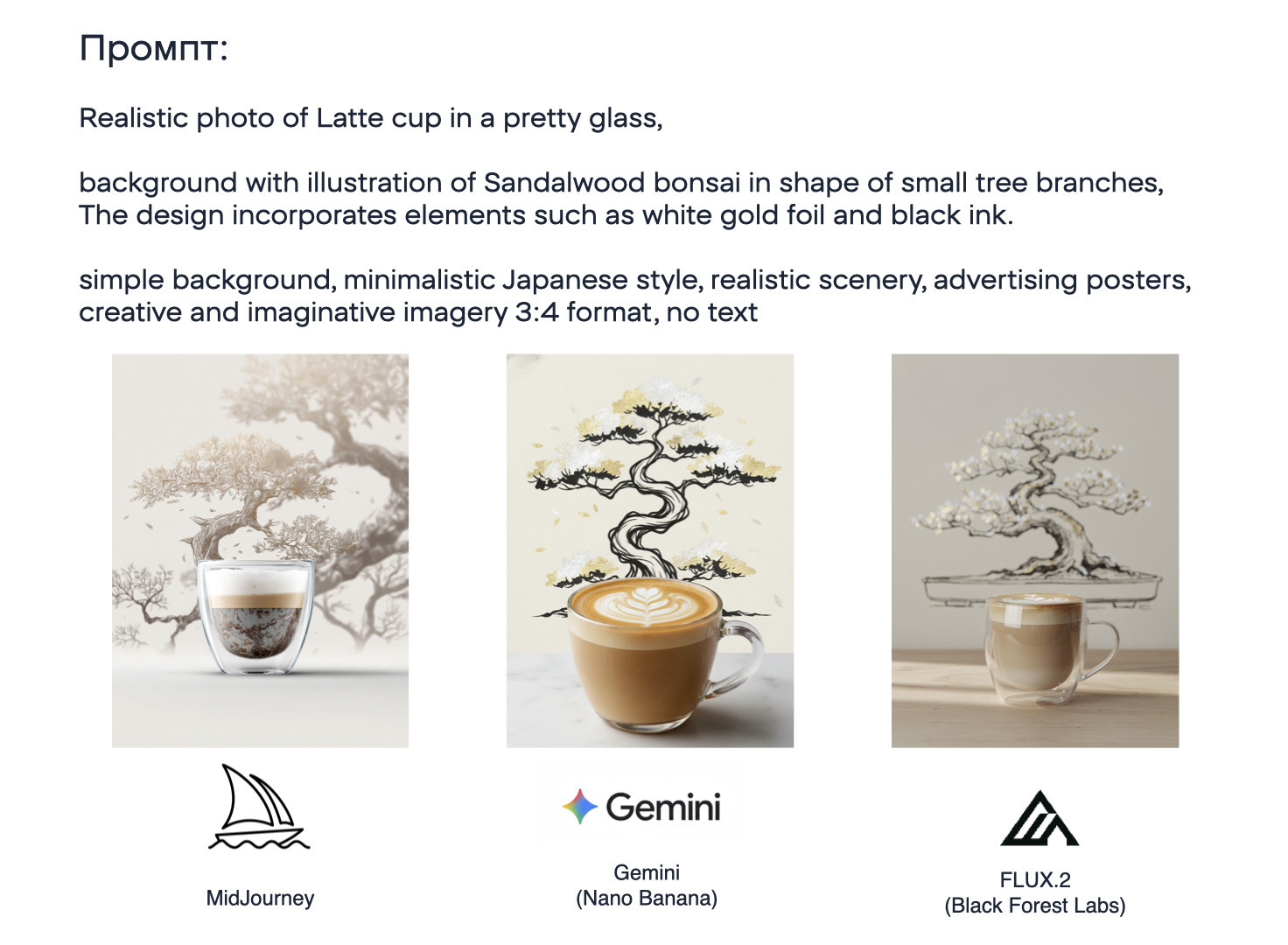

Сложный, хорошо структурированный промпт дает уже более предсказуемый результат в разных моделях. Даже если интерпретация отличается, общий стиль и композиция похожи:

Тут возникает вопрос: если промпт такой подробный, откуда берётся разница изображений?

Дело в принципах работы генеративных моделей, где каждый запуск — новая ветка решений. Промпт только задаёт направление, но не фиксирует форму. Но если с помощью инструментов контроля структуры и стиля задать модели дополнительные рамки, можно добиться предсказуемого результата. В итоге вместо лотереи дизайнер получит более стабильные варианты и сможет выбрать тот, что лучше всего подходит для решения задачи.

Инструменты контроля

ControlNet, LoRA, Style Transfer позволяют управлять структурой и стилем изображения. Их задача — сузить пространство вариаций.

ControlNet работает со структурой изображения. Вы подаете исходное изображение и извлекаете из него карту глубины, контуры или, если это человек, его скелетную позу. На этой основе создается новое изображение. Это удобно, если вы делаете серию иллюстраций, работаете с эскизами или прототипами и хотите сохранить опору на референс. ControlNet и LoRA лучше всего раскрываются с моделью FLUX.

LoRA — более тонкая настройка. Вы даете небольшой датасет и обучаете модель воспроизводить конкретного персонажа или стиль.

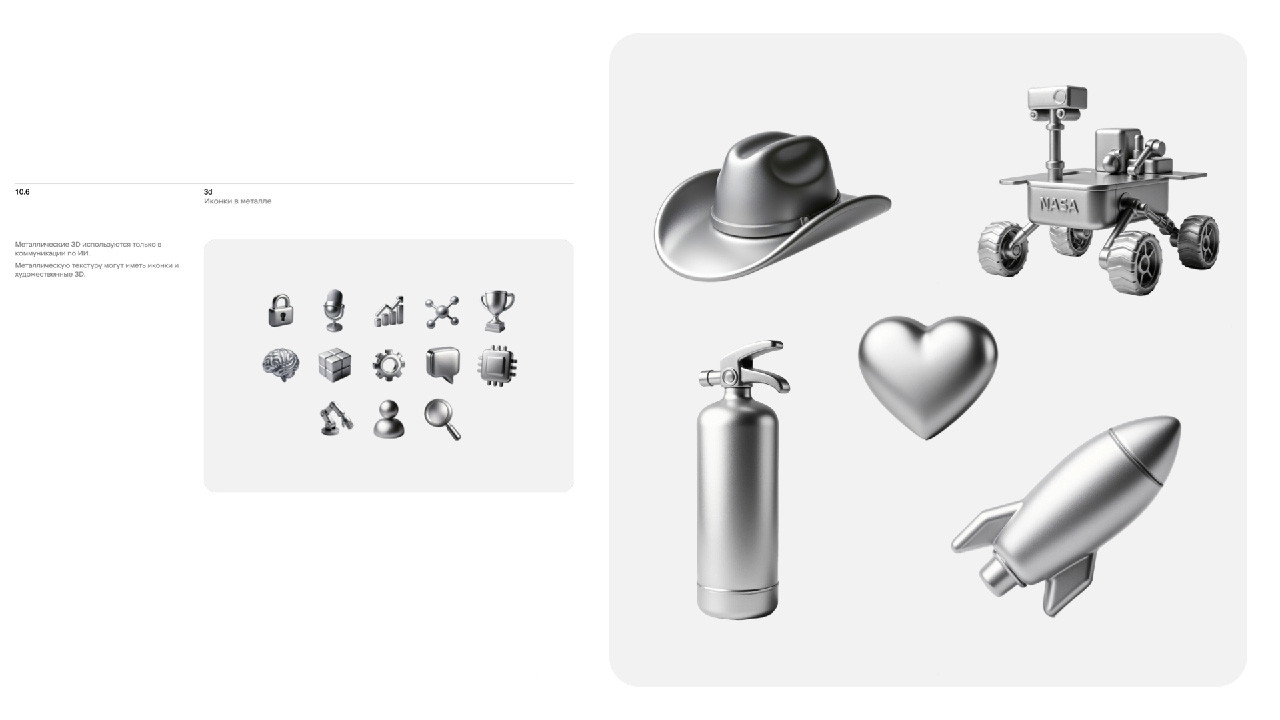

Мы обучили LoRA на небольшом фрагменте брендбука воспроизводить иконки «металлик» с нужным уровнем детализации. Теперь можно генерировать новые изображения без сложных промптов. Достаточно выбрать LoRA как модификатор.

Style Transfer — это подход для переноса стиля с референса. С его помощью вы задаете изображение, которое определяет эстетику: цвета, фактуру, уровень детализации. Можно настраивать вес стиля, регулируя степень похожести результата на референс.

Лучшая модель для таких задач сейчас — Midjourney. В ней удобно пробовать разные стили, собирать и переиспользовать собственные кастомные библиотеки.

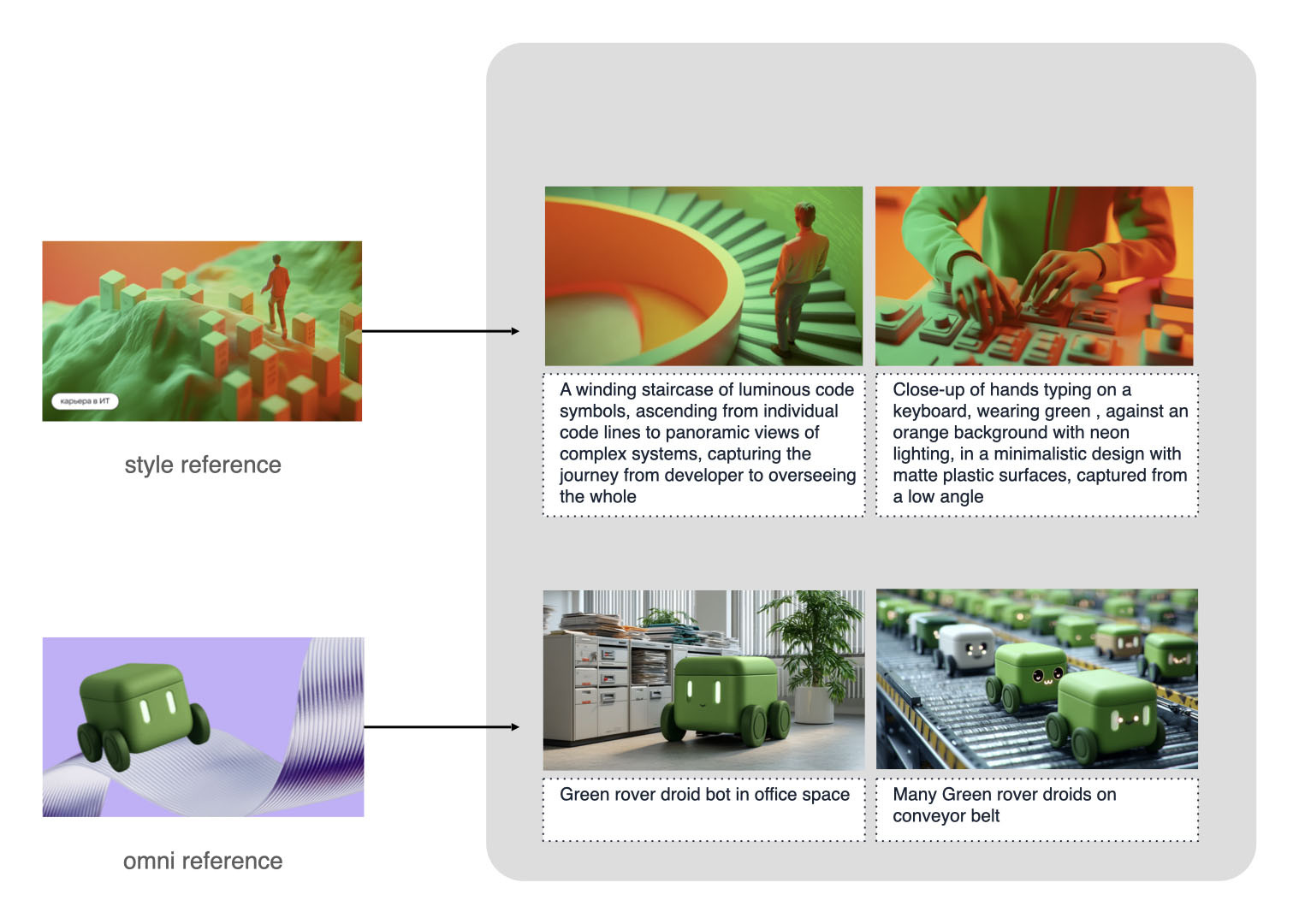

За перенос стиля в новую генерацию в Midjourney отвечает Style Reference, а за перенос конкретного объекта — Omni Reference. Например, для задач, где персонажа-робота нужно поместить в разные сцены и при этом вписаться в заданный стиль, сюжет и другие настройки.

Мультимодальные модели во многом сочетают в себе упомянутые выше инструменты контроля. Они умеют:

-

распознавать исходные изображения,

-

понимать естественный язык,

-

воспроизводить один и тот же стиль,

-

итеративно вносить правки.

Работа с такими нейросетями похожа на диалог в чате с виртуальным дизайнером. Вы выступаете как арт-директор, который управляет процессом: задаете направление, корректируете и пробуете разные варианты.

Как мультимодальные модели меняют workflow

Раньше мы работали с ChatGPT Image. Загружали обучающие и референсные изображения из брендбука, кормили модель пачкой примеров и говорили: «Вот стиль. Делай новые генерации в том же ключе».

У этого подхода были ограничения, но для новых креативов и редактирования изображений его хватало. Например, когда мы делали иконку с ноутбуком, то просто добавляли в неё новые элементы, подкидывая дополнительные референсы.

Но сейчас на сцене другой король — Gemini Nano Banana. Модель собирает новые сцены и иллюстрации даже по одному референсу. Nano Banana воспринимает промпт как конструктор, поэтому мы больше не выпиливаем сложные промпты, а берем разные токены, меняем отдельные части промпта и раз за разом получаем новые изображения.

Как это влияет на работу дизайнера:

ControlNet — помогает контролировать процессы редактирования и создания изображений в заданном стиле. Это как работа с нотной тетрадью и метрономом: вы задаете структуру, ритм и знаете, что итог будет предсказуемым.

LoRA — позволяет генерировать несколько изображений в одном стиле. Работает как педаль к гитаре: полностью меняет генерации, но делает это в рамках одного стиля. С ней удобно делать маскотов.

Style Transfer — удобен для создания серий изображений. Это диджейский пульт для микширования. Вы сохраняете эстетику и делаете вариации без разрушения общего настроения.

Но мультимодальные модели, такие как ChatGPT или Nano Banana, поднимают работу на новый уровень. Это уже не отдельный инструмент, а целый оркестр, которому нужен дирижер. Модели понимают обычный язык, точно реагируют на правки и позволяют пошагово улучшать изображение, но автору важно держать в голове конечный образ.

Наши дизайнеры пользуются десятками пайплайнов и темплейтов. Сами создают, делятся друг с другом и используют для разных задач: от контента для соцсетей до фудзон, баннеров и иконок. Каждый инструмент занимает свое место в этом наборе.

Дальше — практическая часть, где я покажу, как именно мы собираем пайплайны для генерации и стилизации изображений. Подробные схемы, настройки, примеры промптов и результаты генераций можно посмотреть в открытом демо-проекте на Phygital+. В этой статье оставлю концепции, ключевые операции и объяснения.

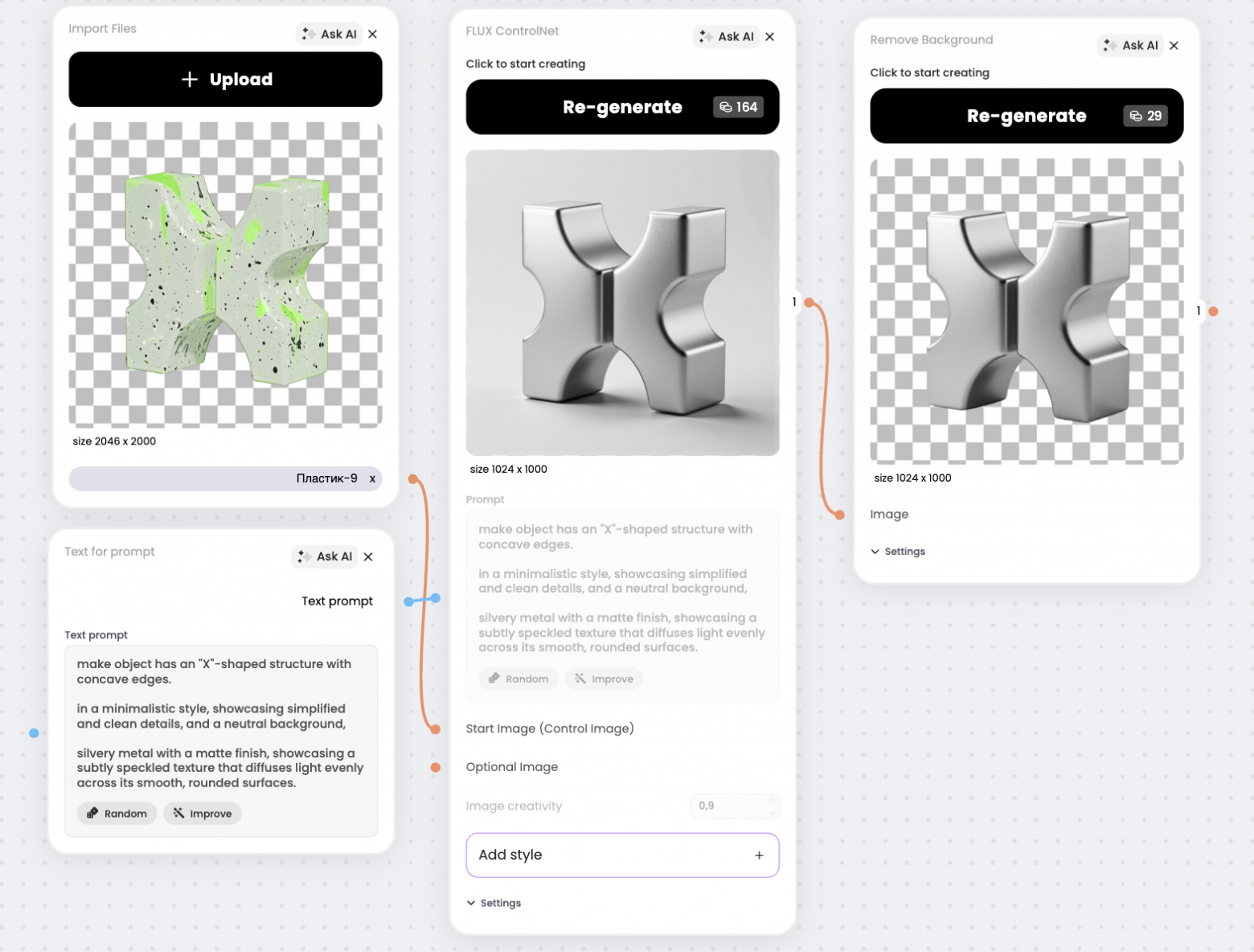

Работа со стилем в LoRA и ControlNet

Одна из частых задач в пайплайнах — взять объект и стилизовать его под нужную эстетику, не ломая геометрию. Например, сохранить форму, фактуру и композицию, но полностью поменять визуальный язык. Для этого мы используем связку ControlNet и LoRA.

Промпт остается достаточно простым: сначала описываем базовые токены, затем — триггеры, отвечающие за сохранение стиля. Технически я мог бы совсем убрать текстовую часть последних двух абзацев промпта, но практика показывает, что генерация с текстовыми инструкциями работает стабильнее.

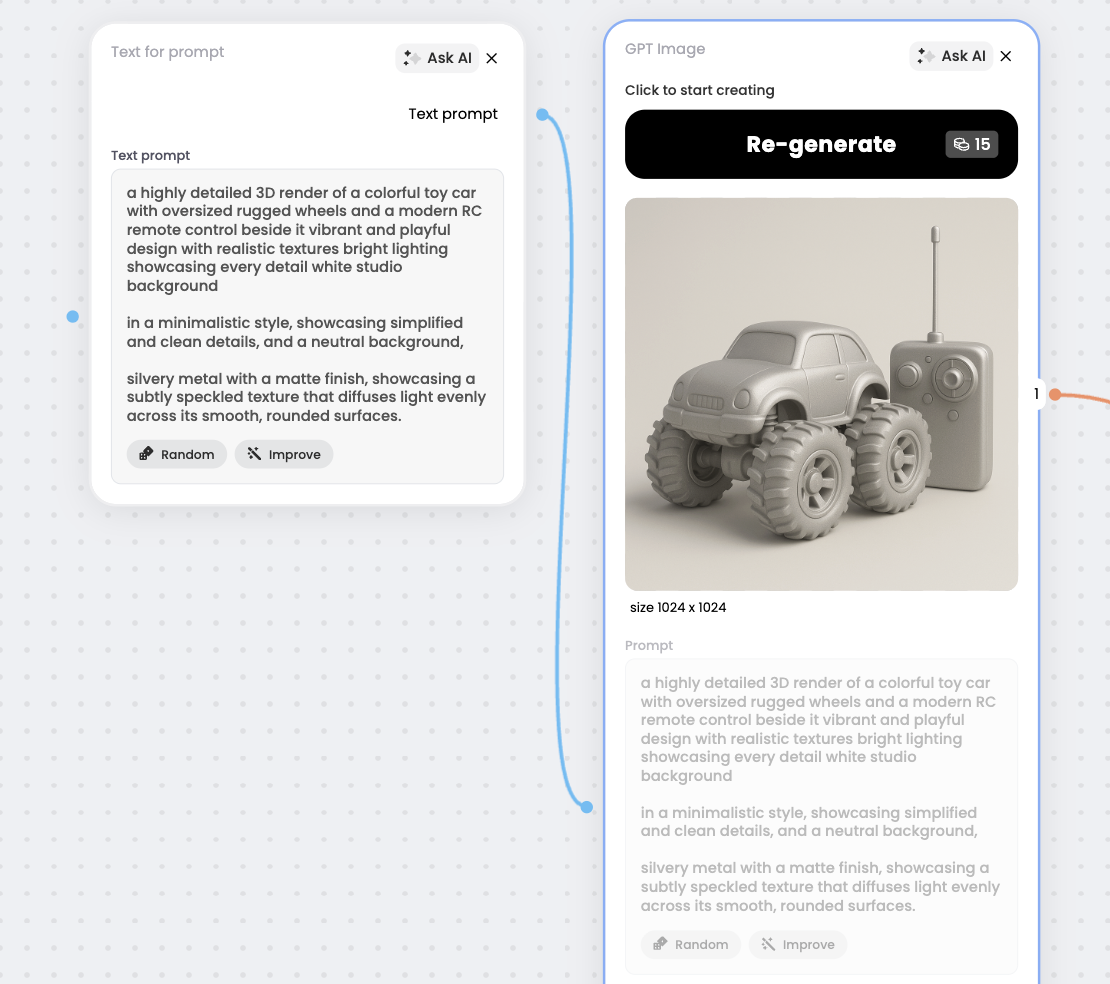

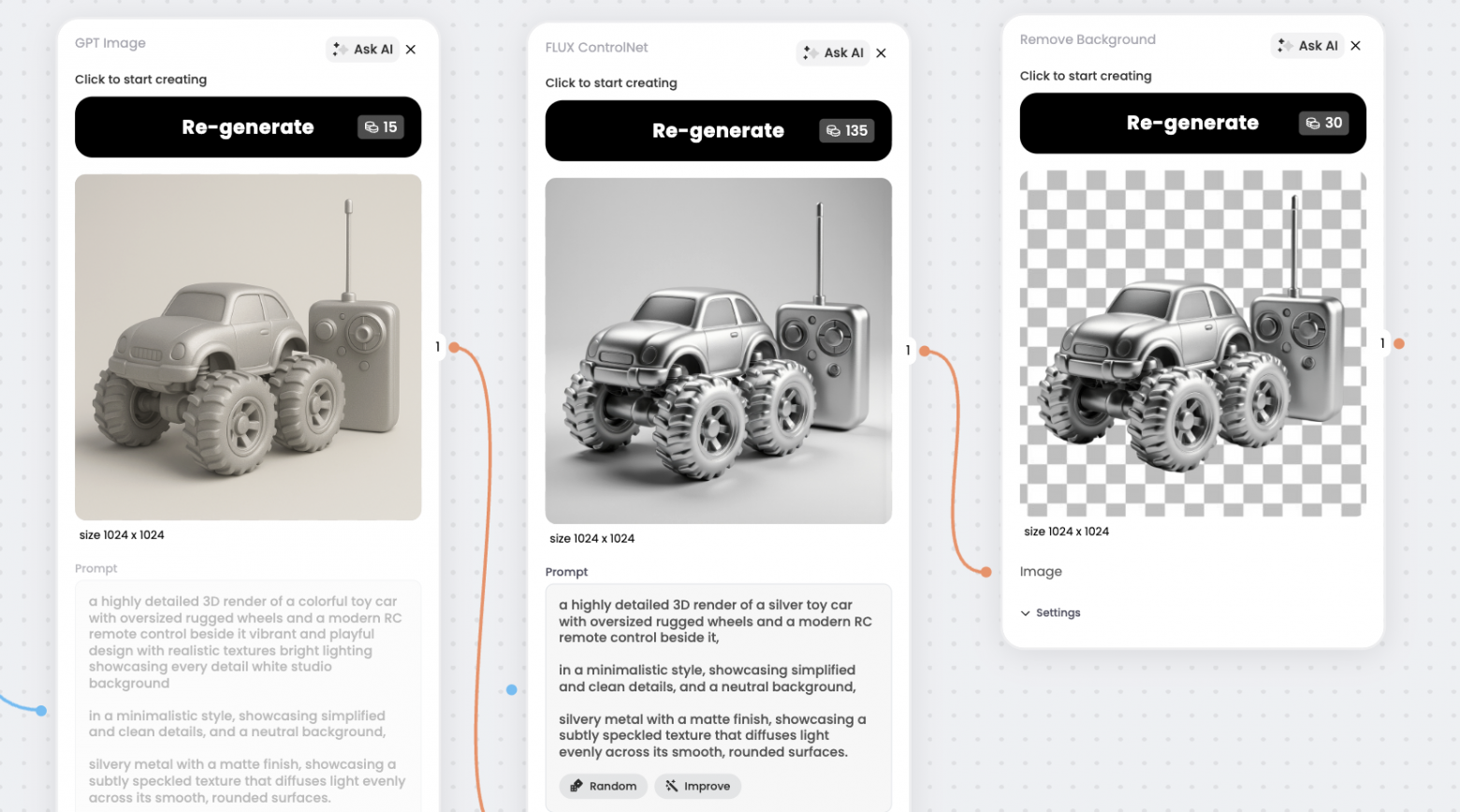

Можно работать и в связке с другими нейросетями. Например, GPT-Image отлично придумывает новые креативы, метафоры и сцены, хотя и не всегда точно следует инструкциям.

Если вы знакомы с этим инструментом, то знаете его фирменную «сепию». Иллюстрация может получиться классной, но сепия выбивается из общего сета референсов, на которых мы обучали модель. А с помощью ControlNet и LoRA изображение можно привести к нужному стилю.

На выходе будет то, что нам нужно: хром, металлик, характерная «шершавость» поверхности. ControlNet отлично переносит мелкие детали, вроде текстуры шин.

Раньше 3D-дизайнер выполнял эти задачи вручную, настраивая материалы и освещение. Теперь несколько нейросетей быстро делают это в одном темплейте.

Работа со стилем в Midjourney

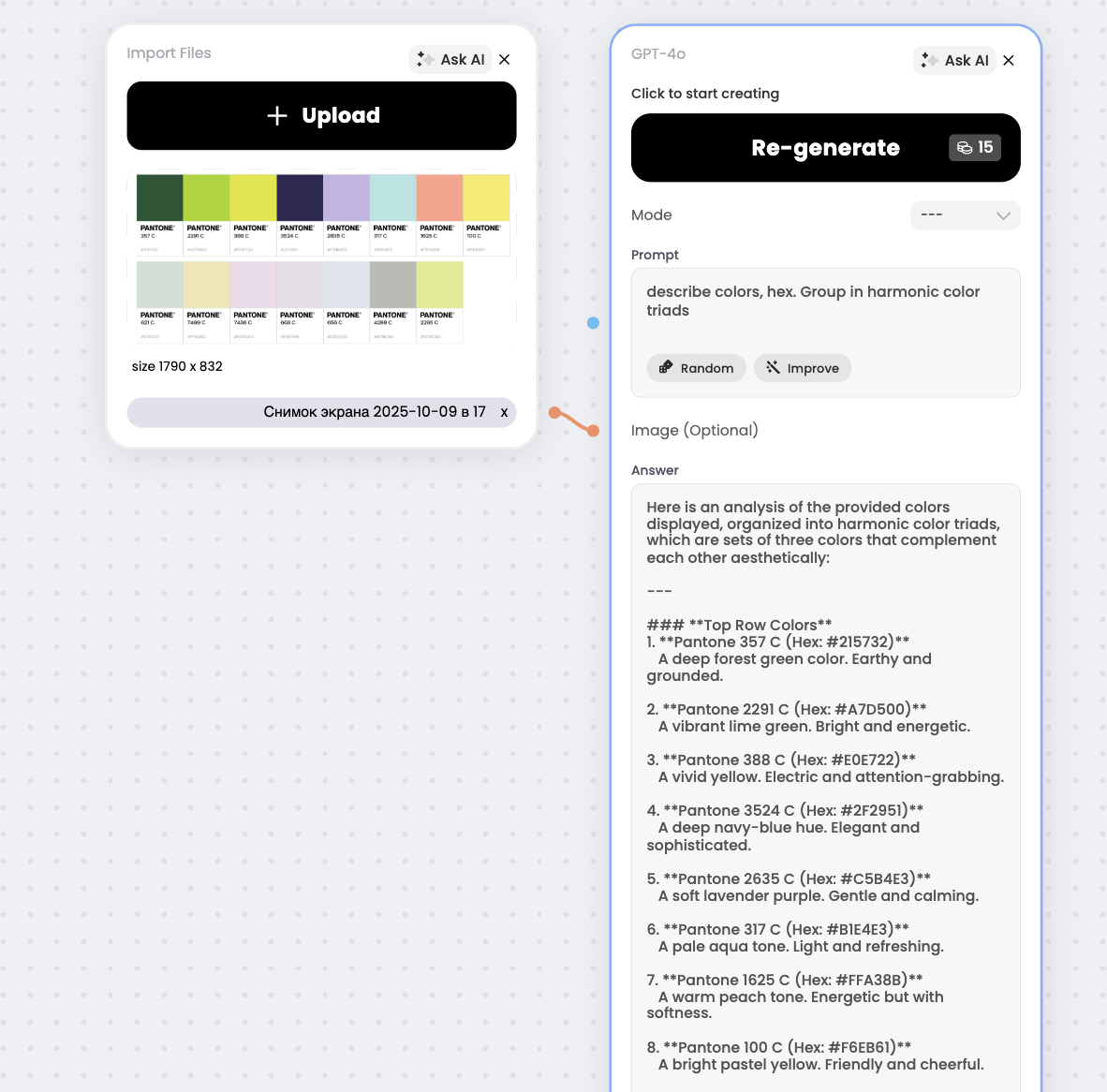

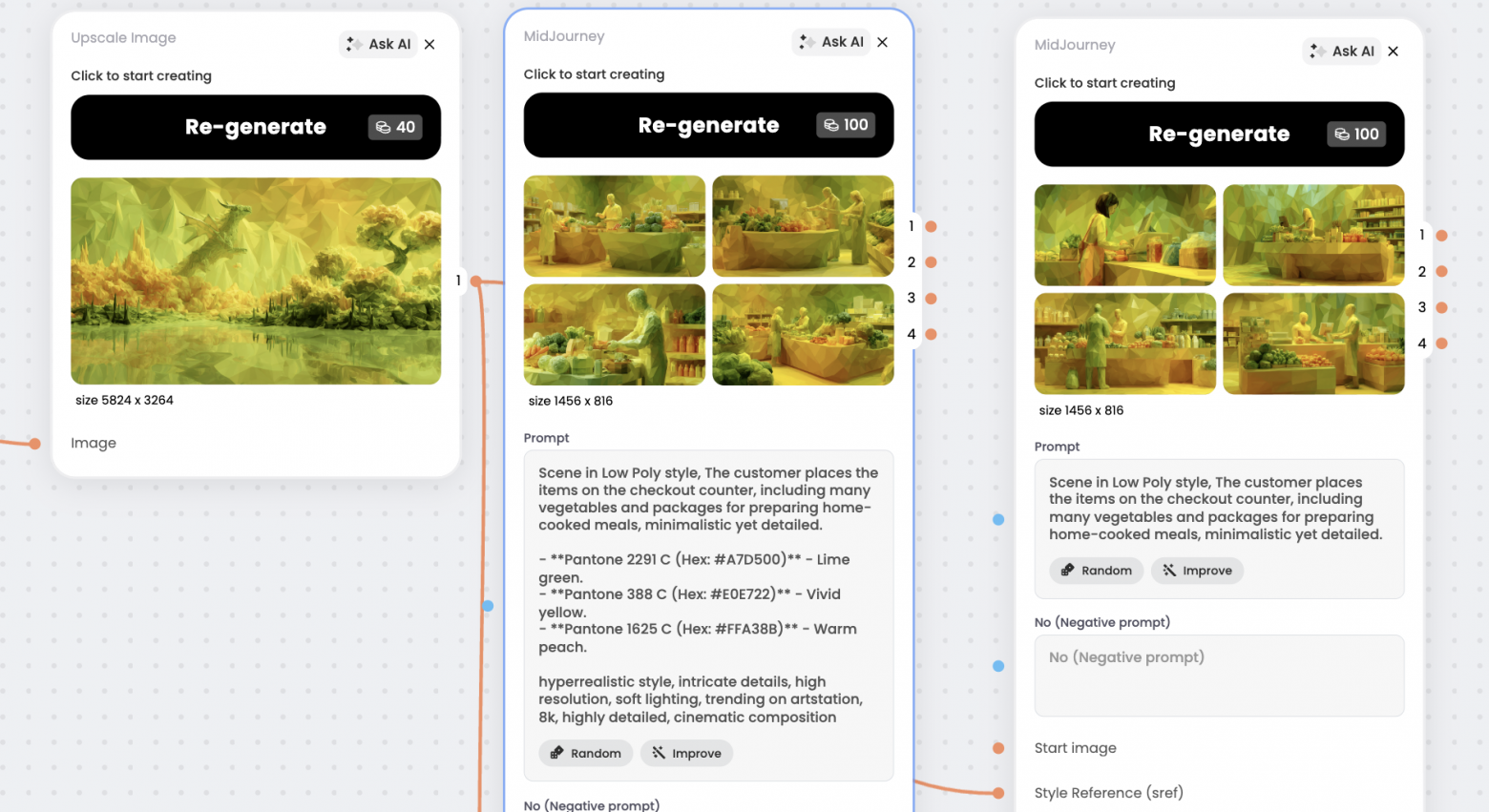

Возьмём ChatGPT как базовую нейросеть, чтобы составить цветовую палитру на основе кадра из брендбука. Сначала я прошу определить список цветов, а затем сформировать их в группы по триадам.

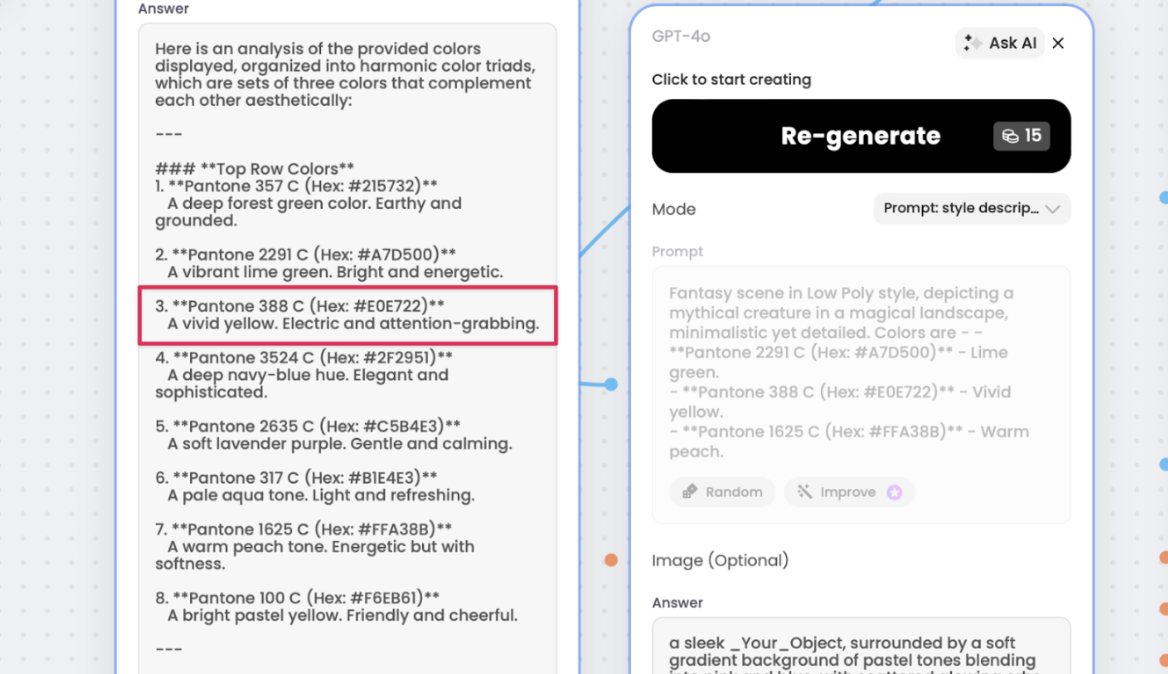

Модель расписывает каждую группу цветов и предлагает варианты сочетаний. Для своего примера я выбрал триаду №3: лаймовый, жёлтый и немного теплого персикового.

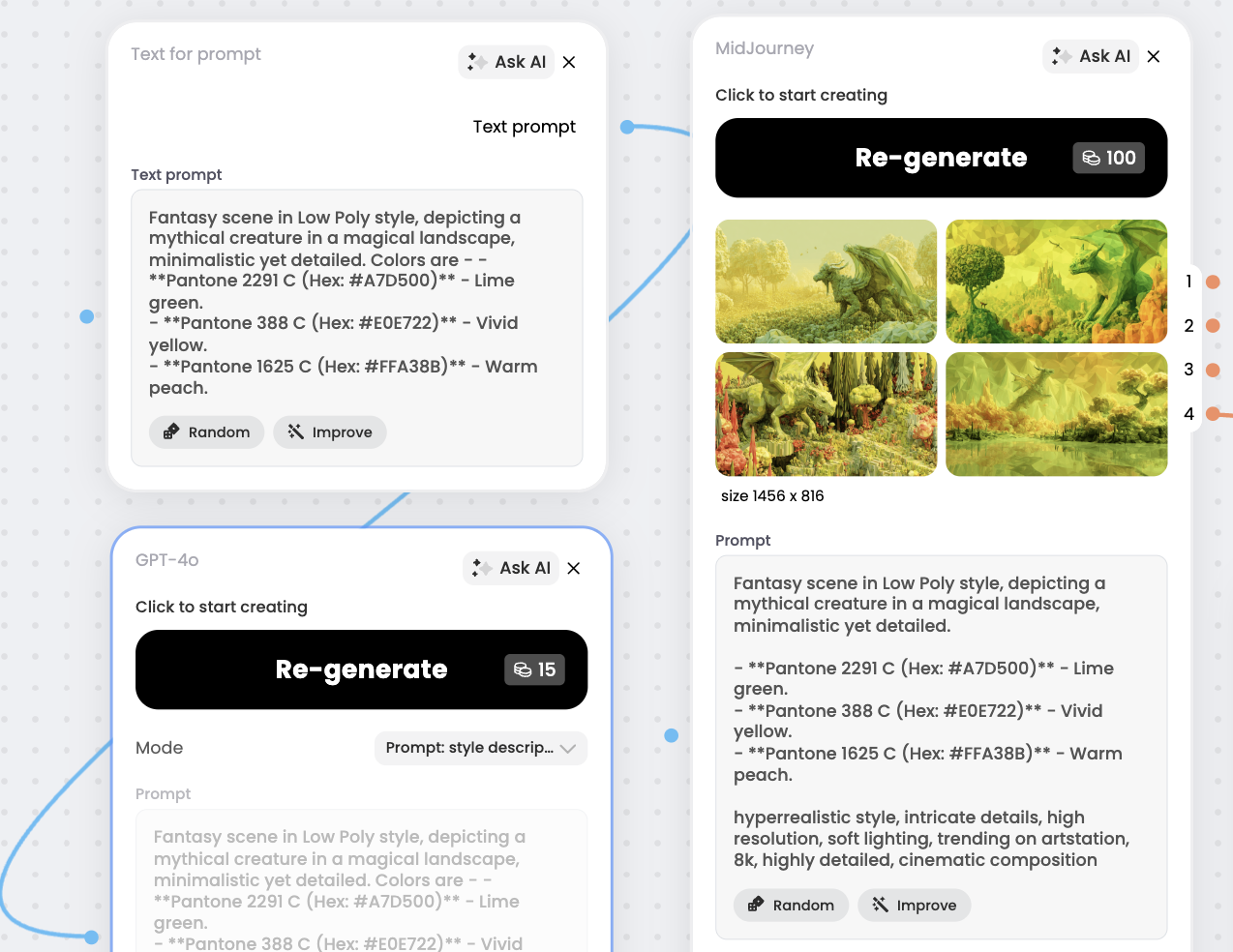

После этого взял промпт для иллюстрации, добавил описание выбранных цветов и получил low-poly изображение с множеством деталей и нужным сочетанием оттенков.

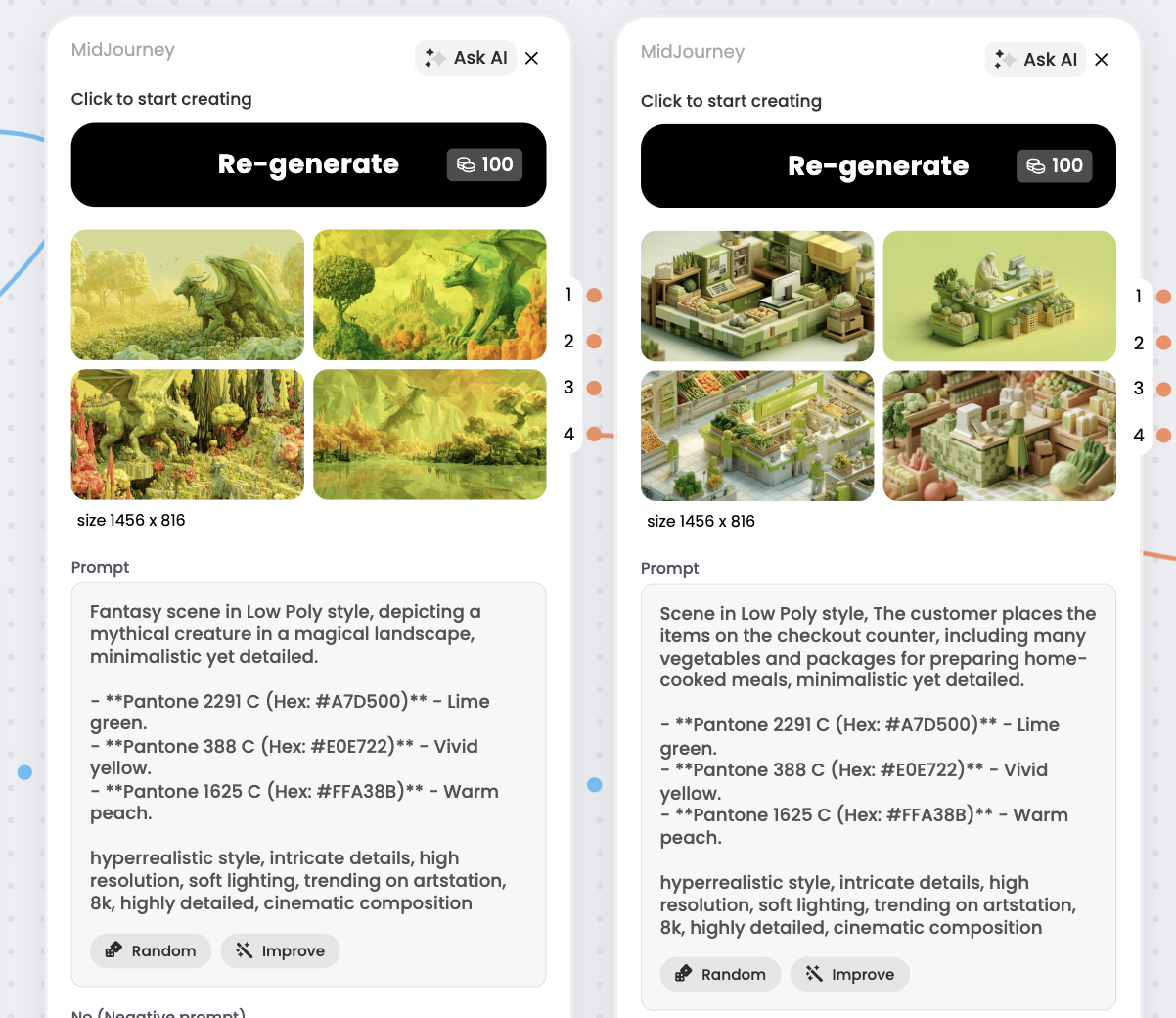

Можно попробовать повторить изображение без Style Reference. Взять ту же структуру промпта и заменить описание сцены с «фэнтези» на «супермаркет». Но стиль полностью потерялся — ничего общего между тем, что я получил, и тем, что хотел увидеть.

Чтобы получить генерацию ближе к исходному стилю, подсоединяю изображение в Midjourney через ноду Style Reference. В результате получаю то, что нужно, даже на другой сцене, где супермаркет с абстрактными людьми, но с той же low-poly эстетикой и цветами из брендбука.

Midjourney хорошо переносит цветовую палитру из референсного изображения. Иногда можно даже не усложнять промпт, потому что модель Midjourney сама подхватывает оттенки и общее настроение сцены.

Когда есть Style Reference, можно взять еще более простой промпт, содержащий только описание сцены.

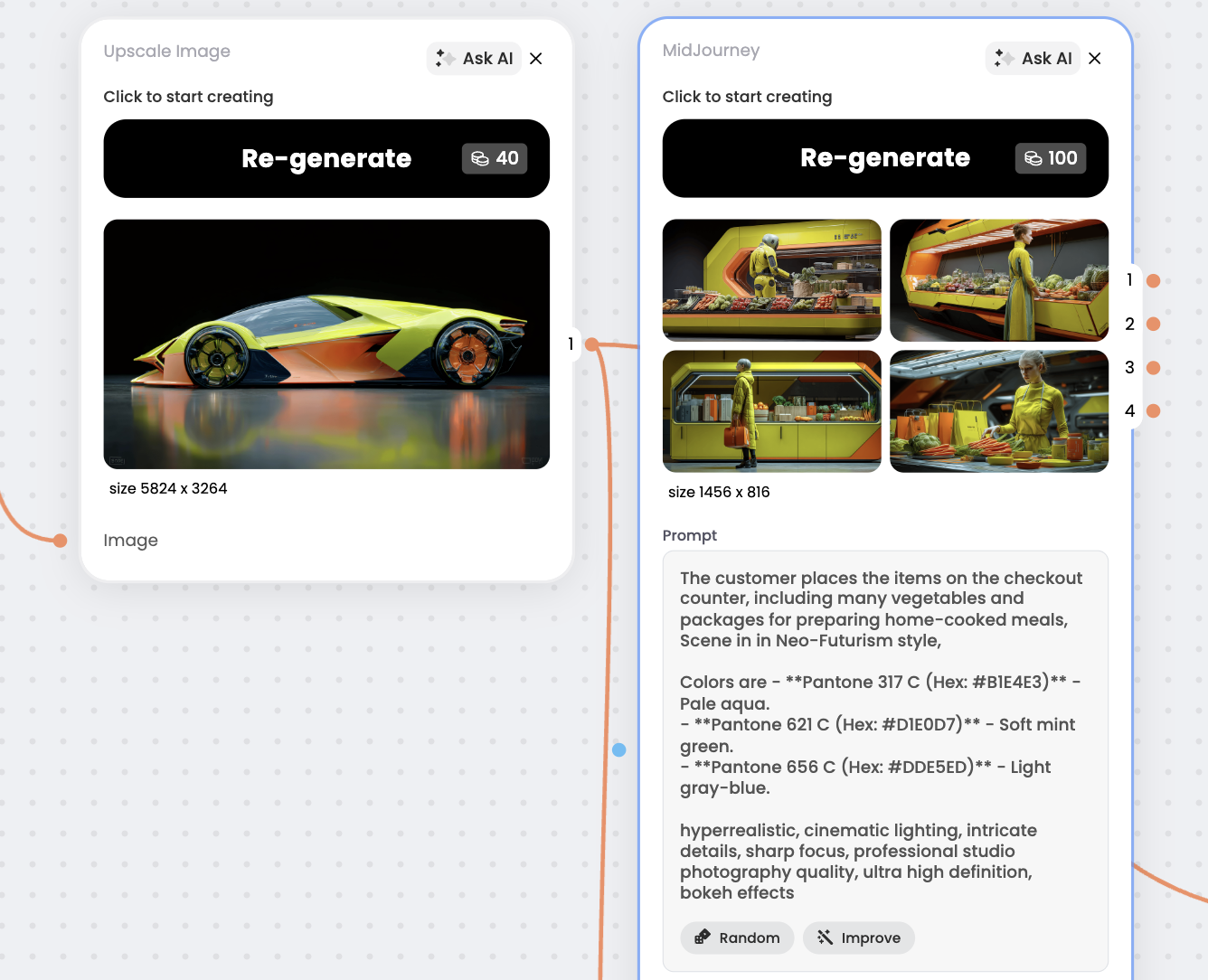

Аналогично с гиперреалистичными иллюстрациями: берем одно изображение как референс и генерируем новую сцену в той же эстетике. В результате переносятся и цвета, и характерный визуальный язык неофутуризма: отражения, световые акценты, масштабирование объектов.

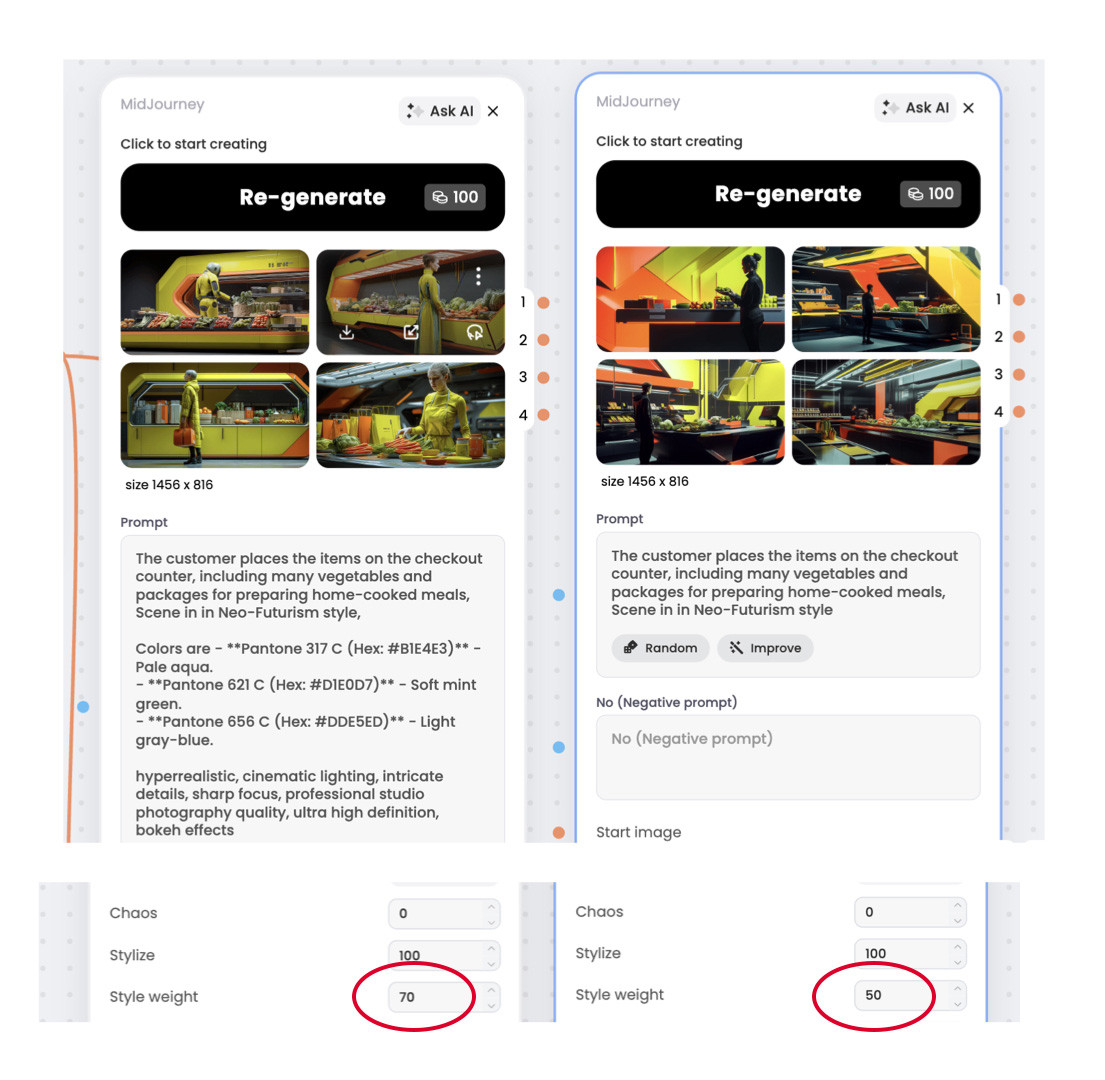

Хорошо в Midjourney и то, что можно настраивать вес стиля: 100% — это почти полная копия референса, а 70% (как на картинках в примере) — сильное, но не абсолютное сходство, которое оставляет пространство для вариантов.

Главное преимущество Midjourney + Style Reference в том, что вы получаете не четыре случайных картинки, а четыре варианта в одном стиле, но с разными сюжетами. Для дизайнера это огромная экономия времени при работе над сериями, кампаниями или набором иллюстраций для продукта.

Пример работы Nano Banana

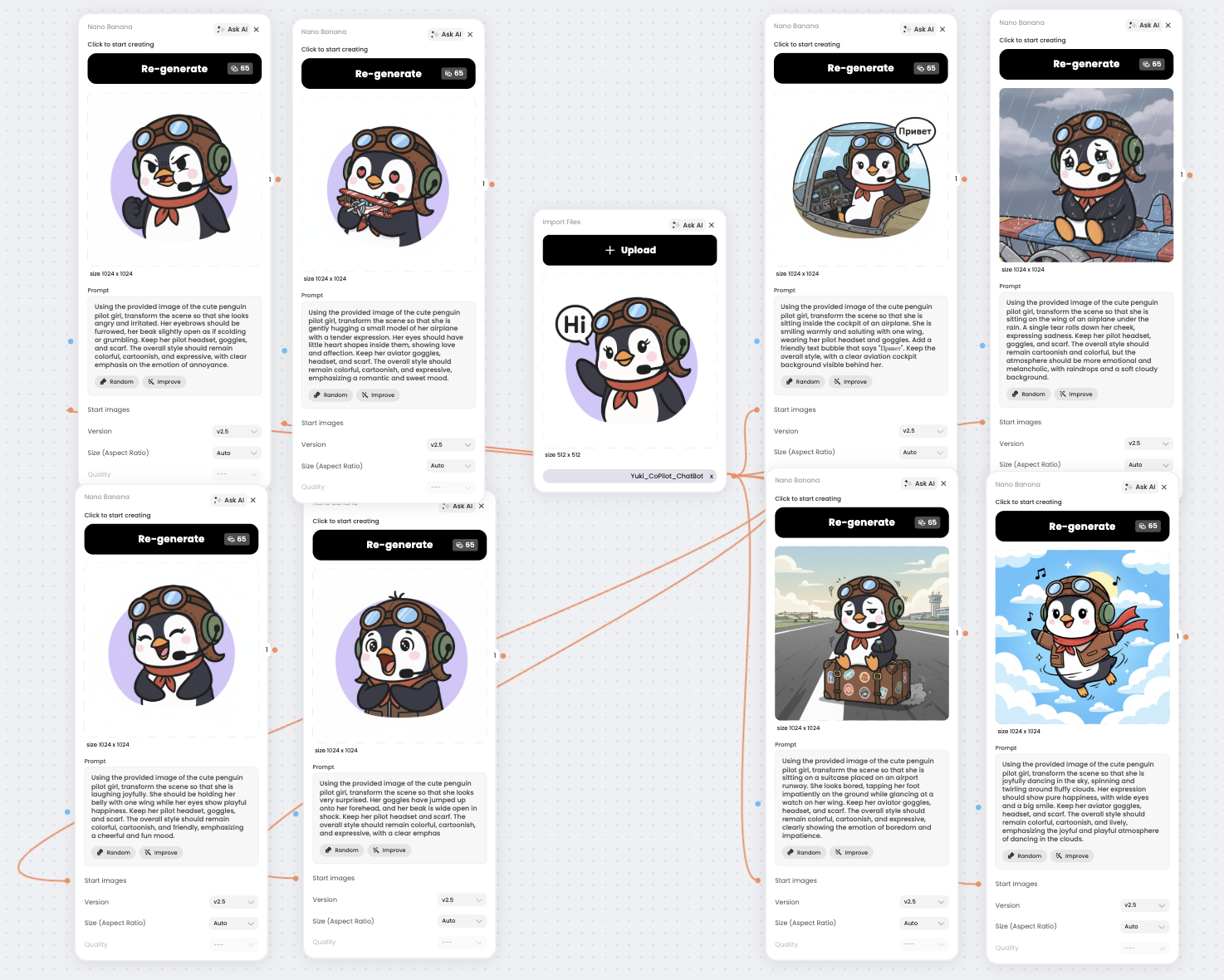

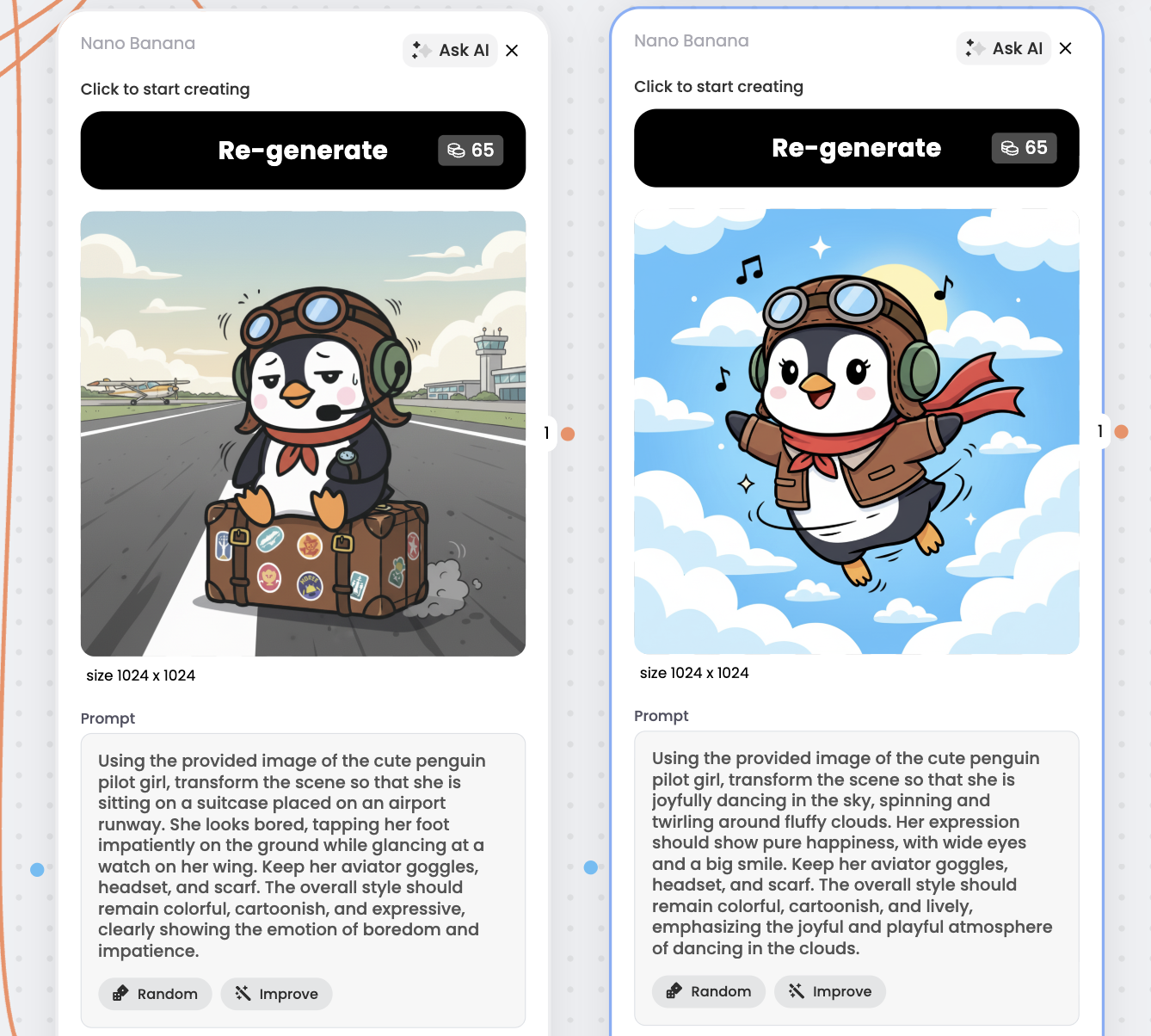

Если Midjourney требует референса и настройки веса стиля, то мультимодальные модели вроде Nano Banana умеют удерживать консистентность сами. Здесь достаточно исходного изображения и простой структуры промпта: модель распознаёт персонажа, его форму и детали и может порождать сколько угодно вариаций.

На примере с пингвиненком мы меняем только эмоцию, а стиль и характер остаются теми же. Не нужно ни обучения, ни LoRA, ни дополнительных данных.

Если доработать описание сцены, можно получить более сложные композиции с разными эмоциями, деталями одежды, эффектами, вроде дождя. Nano Banana корректно добавит их, оставив персонажа неизменным. Здесь все строится на исходном примере, без набора референсов и подготовки датасета.

Используя то, что Nano Banana умеет удерживать консистентность персонажа, можно создавать раскадровки и ключевые сцены для создания видео.

Также модель хорошо справляется и с генерацией фотореалистичных изображений в заданном стиле или с использованием определенных элементов (рисунок тельняшки как в примере ниже).

Выводы

Так мы превратили набор моделей в рабочий пайплайн, который экономит время, расширяет вариативность и сокращает зависимость от стоков. Этот подход полезен всем, кто регулярно работает с визуалом:

-

дизайнерам, которые собирают концепты;

-

арт-директорам, которые следят за стилем;

-

маркетинговым командам, которые живут в дедлайнах и хотят воспроизводимый результат;

-

и инженерам, которые вшивают ИИ в продукты, стремятся автоматизировать процессы.

Чем раньше команды начнут смотреть на ИИ как на производственный инструмент, а не как на игрушку для вдохновения, тем быстрее у них появятся креативы, кампании и продуктовые визуалы, которые раньше были дорогими и ресурсоёмкими в создании.

А дальше все упирается только в практику и умение собирать правильный флоу.

Автор: Mixiw