Каждый производитель LLM заявляет о лидерстве. OpenAI – «самая мощная модель». Anthropic – «самая безопасная». Яндекс – «лучше всех понимает русский». Проверить эти заявления, не потратив месяц на ручное тестирование, – задача нетривиальная. Мы решили попробовать.

Обновление от 17 марта 2026. В первой версии статьи модели Grok (xAI) были отнесены к категории «доступны в России без VPN». Это ошибка – x.ai и API Grok заблокированы для российских IP. Мы исправили таблицы и рейтинги. Grok остаётся сильной моделью, но для доступа из России потребуется VPN. Также в исследование добавлена модель GLM-5 от Z.ai – она заняла 7-е место в общем рейтинге и 1-е место в категории «Управление командой». Подробнее – в обзоре GLM-5.

Откуда взялось это исследование

На образовательной платформе mysummit.school мы учим менеджеров работать с AI. И один вопрос звучит чаще других: «Какую модель мне использовать?». Ответ «зависит от задачи» – честный, но бесполезный. Менеджеру нужна конкретика: вот модель, вот чат, открывай и работай.

Мы хотели дать такой ответ. Но не на основе маркетинг

-

Первый – какие модели реально справляются с задачами, которые менеджер выполняет каждый день? Не с бенчмарками типа MMLU, а с планированием встреч, написанием писем, анализом отчётов.

-

Второй – насколько модели, доступные в России без VPN, уступают глобальным лидерам? Есть ли вообще разрыв, и если да – критичен он или нет?

-

Третий – правда ли YandexGPT лучше понимает российский контекст? Или это маркетинг?

Это первая статья из серии. Здесь – обзор результатов с фокусом на доступные без VPN модели. В следующих публикациях разберём методологию подробнее и покажем данные по отдельным категориям.

Как мы тестировали

Коротко о методологии, потому что без этого контекста цифры ничего не значат.

34 модели получили одинаковые задачи – 32 сценария в 8 категориях: поиск информации, коммуникация, анализ, планирование, решение проблем, обучение и развитие, управление командой, региональная специфика (Россия и Казахстан). Все промпты на русском, от лица обычного менеджера – без промпт-инжиниринга. Именно так большинство людей работает с AI в реальности.

Каждый ответ оценивали два судьи – Claude Opus 4.5 и Gemini 3 Pro. Итого около 2100 оценок. Человеческая калибровка на 23 оценках выявила интересную вещь: Opus систематически занижает на ~0.4 балла, Gemini завышает на ~0.5. После коррекции этих смещений итоговый консенсус считается как 70% скорректированного Opus + 30% Gemini.

Шкала от 1 до 5. Для ориентира: 4.0 – уверенно хороший ответ, 4.5+ – отлично, ниже 3.0 – ответы скорее вредят, чем помогают.

Что доступно в России

Вот тут начинается самое интересное.

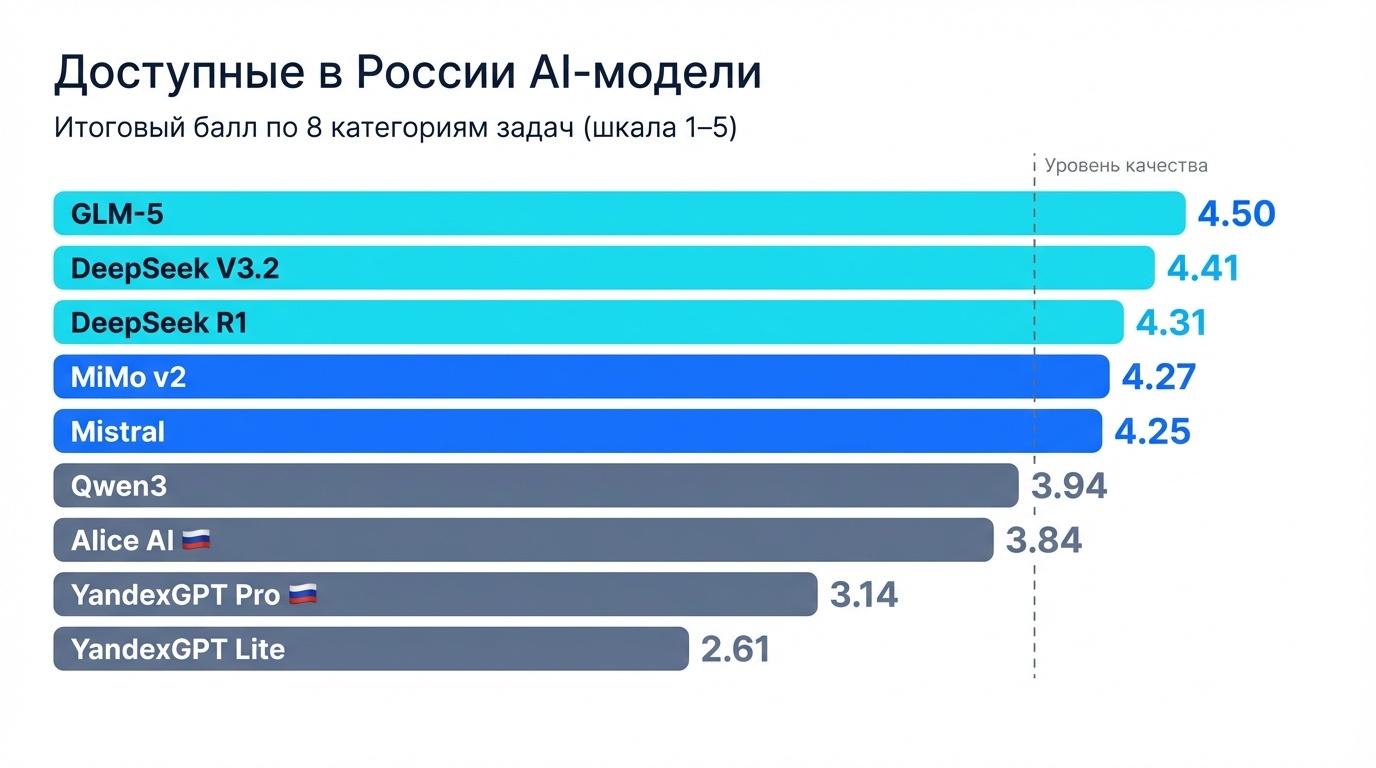

Все протестированные модели, доступные без VPN, разбились на три чётких уровня. Не по нашему желанию – по данным.

Уровень 1: тройка лидеров (≥ 4,3 из 5)

|

Модель |

Балл |

Чат-интерфейс |

API (in / out за 1M) |

|---|---|---|---|

|

GLM-5 (Z.ai) |

4.50 |

$0.72 / $2.30 |

|

|

DeepSeek V3.2 |

4.41 |

$0.27 / $0.40 |

|

|

DeepSeek R1 |

4.31 |

$0.70 / $2.15 |

GLM-5 – новый лидер среди доступных моделей. Бесплатный чат, открытый код, 1-е место в управлении командой среди всех 34 моделей. При этом слабо работает с российской спецификой. DeepSeek V3.2 – бесплатный чат, копеечное API. DeepSeek R1 – версия с расширенным мышлением, заметно сильнее в аналитике.

Уровень 2: крепкие середняки (4.0–4.3)

|

Модель |

Балл |

Доступ |

|---|---|---|

|

MiMo v2 Flash (Xiaomi) |

4.27 |

только API ($0.09 / $0.29 за 1M) |

|

Mistral Large |

4.25 |

chat.mistral.ai + API ($2 / $6 за 1M) |

|

MiniMax M1 |

4.12 |

только API |

Любопытный факт: MiMo v2 Flash – модель от Xiaomi. Да, той самой компании, которая делает телефоны. И она обходит Mistral Large и MiniMax.

Уровень 3: заметно слабее (3.5–4.0)

|

Модель |

Балл |

Доступ |

|---|---|---|

|

Qwen3 235B |

3.94 |

|

|

Alice AI LLM (Яндекс) |

3.84 |

|

|

Gemma 3 27B |

3.73 |

только API |

|

Qwen3 32B |

3.65 |

Разрыв между уровнями – не косметический. На практике это разница между «ответ можно использовать почти сразу» и «ответ нужно серьёзно перепроверять и дорабатывать».

А что там глобально?

Мы намеренно тестировали и модели, заблокированные в России. Иначе нельзя понять масштаб разрыва.

-

Claude Sonnet 4.5 – 4.78 баллов

-

GPT 5.2 Pro – 4.78

-

Claude Opus 4.5 – 4.77

Глобальный топ-3: в среднем 4,78. Российский топ-2: в среднем 4,36. Разрыв – около 0,4 балла.

В абстрактных числах кажется немного. Но на шкале от 1 до 5 это разница между «отлично» и «хорошо». Примерно как A– и B+ в западных оценках. Для ежедневных задач – приемлемо. Для сложной аналитики или стратегических решений – уже ощущается.

И вот что интересно: этот разрыв неравномерен по категориям.

Где разрыв минимален, а где критичен

Что конкретно тестировалось в каждой категории

Планирование. Составление плана проекта с дедлайнами и зависимостями. Приоритизация задач при конфликтующих требованиях от разных стейкхолдеров. Подготовка повестки встречи с конкретными тайм-слотами и ожидаемыми результатами. Декомпозиция квартальной цели на еженедельные задачи для команды из 8 человек. Оценивалось: структурность плана, реалистичность сроков, учёт зависимостей, полнота покрытия задач.

Решение проблем. Анализ ситуации, когда проект отстаёт от графика на 3 недели – причины и план восстановления. Разбор конфликта между отделами из-за разделения ресурсов. Поиск корневой причины падения конверсии на 15% за месяц. Антикризисный план при уходе ключевого сотрудника. Оценивалось: глубина анализа причин, практичность предложенных решений, учёт рисков, структура рассуждения.

Анализ и принятие решений. Интерпретация финансового отчёта с выводами для руководства. Сравнительный анализ трёх вариантов стратегии выхода на новый рынок. Оценка рисков при внедрении новой системы. Анализ данных опроса удовлетворённости сотрудников с рекомендациями. Оценивалось: корректность выводов из данных, полнота рассмотрения факторов, качество аргументации, прозрачность рассуждения.

Региональная специфика. Подготовка документа с учётом российского трудового законодательства (увольнение, больничные, отпуска). Адаптация бизнес-процесса под требования казахстанского законодательства. Учёт культурных особенностей при работе с командой в регионах России. Подготовка отчёта по комплаенсу с учётом российских требований к персональным данным (152-ФЗ). Оценивалось: знание актуального законодательства, корректность ссылок на нормативные акты, учёт культурного контекста, практическая применимость рекомендаций.

Коммуникация. Написание письма партнёру о переносе сроков без ущерба для отношений. Формулировка обратной связи сотруднику, который систематически срывает дедлайны. Подготовка сообщения для команды об организационных изменениях. Написание ответа на жалобу клиента с сохранением лояльности. Оценивалось: адекватность тона, полнота ключевых сообщений, баланс между прямотой и дипломатичностью, готовность текста к отправке.

Поиск информации. Сравнительный обзор методологий управления проектами для IT-компании на 50 человек. Поиск актуальных данных о рынке SaaS в России. Подготовка справки о конкурентах для стратегической сессии. Обзор лучших практик по удалённому управлению командой. Оценивалось: релевантность найденной информации, полнота покрытия темы, актуальность данных, структурированность ответа.

Управление командой. Составление плана проведения performance review для 6 сотрудников с разным уровнем. Рекомендации по мотивации сотрудника, который «выгорает». Стратегия интеграции нового руководителя в существующую команду. Медиация конфликта между двумя тимлидами. Оценивалось: понимание психологии команды, практичность рекомендаций, учёт контекста, глубина проработки.

Обучение и развитие. Составление индивидуального плана развития для middle-менеджера, стремящегося к позиции директора. Рекомендации по обучению команды новому инструменту. Подготовка программы менторинга для junior-сотрудников. Карьерный разговор с сотрудником, который хочет сменить направление. Оценивалось: реалистичность плана развития, конкретность рекомендаций (не «изучите лидерство», а какие именно навыки, как и в какие сроки), понимание карьерных треков, полнота покрытия soft и hard skills.

Два вывода бросаются в глаза.

В планировании и решении проблем доступные модели почти догоняют глобальный топ. Разрыв 0.1–0.2 балла – в пределах статистической погрешности при четырёх сценариях. Практически неразличимо.

А вот в задачах обучения и развития – другая картина. Разрыв полбалла. Если вы часто просите AI написать план развития сотрудника, сформулировать карьерные рекомендации, подготовить программу менторинга – здесь доступные модели уступают заметно. Не настолько, чтобы не использовать совсем. Но настолько, чтобы перепроверять результат внимательнее.

Парадокс YandexGPT

Это, пожалуй, самый неожиданный результат всего исследования.

Alice AI LLM – лучшая модель Яндекса – набрала 3.84. Уровень 3. Ниже DeepSeek, ниже Mistral, ниже MiMo v2 Flash от Xiaomi. Последнее особенно показательно: модель от производителя телефонов обошла флагман крупнейшей российской IT-компании.

Но дальше – ещё интереснее.

Категория «региональная специфика» – задачи, где учитываются российское законодательство, культурные особенности, локальные практики. Казалось бы, именно здесь Яндекс должен быть вне конкуренции. Модель, обученная на русских данных, в русском контексте, для русских пользователей.

Alice: 3,68. GPT-5.2: 4.56. DeepSeek V3.2: 4.34.

Модель для русского контекста проигрывает на домашнем поле. Почему?

Наша интерпретация: аналитические способности модели важнее, чем «родной язык». Хорошая модель, которая прекрасно говорит по-русски, обгоняет «русскую» модель с меньшей аналитической мощностью. DeepSeek не русская модель – но русский язык у неё отличный, а аналитика сильнее.

Что говорит сам Яндекс

Яндекс публикует данные, что Alice побеждает DeepSeek V3.1 и Qwen3-235B в 60% бизнес-задач. В деталях: Alice сильнее в редактировании текстов (68% побед) и суммаризации (65%), но проигрывает Qwen в генерации текстов (62% в пользу Qwen) и ответах на открытые вопросы (61% в пользу Qwen).

Ключевое расхождение: Яндекс сравнивал с DeepSeek V3.1, мы тестировали V3.2 – существенно обновлённую версию. Разные методологии, разные наборы задач, разные версии моделей. Но на наших 32 сценариях управленческих задач Alice уступает V3.2 по всем восьми категориям.

Все модели Яндекса

|

Категория |

Alice AI LLM |

YandexGPT Pro 5.1 |

YandexGPT Pro 5 |

YandexGPT Lite |

|---|---|---|---|---|

|

Анализ |

4.42 |

3.66 |

3.20 |

3.13 |

|

Решение проблем |

4.33 |

3.62 |

3.08 |

2.64 |

|

Коммуникация |

4.19 |

3.43 |

3.06 |

2.66 |

|

Планирование |

4.15 |

3.47 |

3.19 |

2.86 |

|

Поиск |

3.95 |

2.18 |

2.53 |

2.38 |

|

Регионы |

3.68 |

2.95 |

2.50 |

2.37 |

|

Команда |

3.50 |

3.11 |

2.84 |

2.65 |

|

Обучение |

2.70 |

2.70 |

2.40 |

2.24 |

|

Среднее |

3.86 |

3.14 |

2.85 |

2.61 |

Alice – единственная конкурентоспособная модель Яндекса. В анализе (4.42) она на уровне крепких середняков. Остальные три модели набирают 2.6–3.1 в среднем – это уровень, при котором ответы чаще вводят в заблуждение, чем помогают.

API Alice стоит 0.50 ₽/1K входных и 2.00 ₽/1K выходных токенов (со скидкой 50%).

Про стоимость

Отдельная таблица с ценами – потому что здесь тоже произошло кое-что примечательное.

|

Модель |

Input (за 1M токенов) |

Output (за 1M токенов) |

|---|---|---|

|

MiMo v2 Flash |

$0.09 |

$0.29 |

|

DeepSeek V3.2 |

$0.27 |

$0.40 |

|

DeepSeek R1 |

$0.70 |

$2.15 |

|

GLM-5 (Z.ai) |

$0.72 |

$2.30 |

|

Alice AI LLM |

0.50 ₽/1K |

2.00 ₽/1K |

Типичный запрос менеджера – это примерно 1500 входных токенов и 800 выходных. При таких объёмах 1000 запросов в месяц к DeepSeek V3.2 обойдутся меньше доллара.

Получается, что вопрос стоимости API фактически снят. Выбирайте по качеству.

Что нужно иметь в виду

Прежде чем принимать решения на основе этих данных, стоит учесть несколько вещей.

Мы тестировали в январе 2026. С тех пор GPT-5.2 стал GPT-5.4, Qwen вышел в новых версиях, GPT-4o (29-е место в нашем рейтинге) вообще снят с производства в феврале. Для управленческих задач мы не ожидаем кардинальных сдвигов – но конкретные цифры могут измениться.

GigaChat в исследование не вошёл. Отдельная история с корпоративным доступом, соглашениями и регуляторным контекстом. Возможно, включим в следующий раунд.

Qwen 3-max не попал в выборку – при формировании списка моделей мы включили Qwen3 235B и Qwen3 32B, но пропустили max-версию. Справедливое замечание из обратной связи читателей: Qwen 3-max по отзывам заметно сильнее базовой 235B. Qwen 3.5-Plus вышел уже после нашего тестирования (февраль 2026, снимок делался в январе). Планируем включить обе модели в следующую итерацию. Это не меняет результаты для остальных моделей – но может изменить состав тройки лидеров среди доступных.

Тестирование шло через API со стандартными параметрами. В чат-интерфейсах другие системные промпты, режимы работы, ограничения контекста – реальный опыт может отличаться.

Все промпты были без оптимизации – никакого chain-of-thought, few-shot examples, ролевых инструкций. Если вы умеете работать с AI, результаты будут лучше у всех моделей. Но разрывы между ними тоже могут измениться.

И последнее, для тех, кто смотрит на методологию критически: на каждую категорию приходится 4 сценария. При таком n разница в 0.3 балла – на границе статистической значимости. Tukey HSD для топ-15 моделей даёт p-adj ≈ 1.0 – формально ни одна пара не разделяется значимо. Поэтому мы используем кластерный подход: модели с разницей менее 0.1 балла считаем эквивалентными.

Что дальше

Это первая публикация из серии. Дальше:

-

Подробный разбор методологии – Dual LLM-as-Judge, калибровка, bias correction, статистические ограничения. Для тех, кто хочет воспроизвести или покритиковать.

-

Результаты по отдельным категориям – где какая модель лидирует и почему.

-

Полный рейтинг 34 моделей с кластерами эквивалентности.

Кратко об этом, о подходе Dual LLM-as-Judge мы рассказывали тут. А детали про менеджмент (это все-таки тоже про менеджмент) – в канале.

Итог

Парадоксально, но в 2026 году лучший AI для русскоязычного менеджера – это китайские модели. DeepSeek V3.2: бесплатный чат, копеечное API, первое место среди доступных. GLM-5 от Z.ai – бесплатный чат, первое место в управлении командой.

Разрыв с глобальным топом – около 0.4 балла. Это «хорошо» вместо «отлично». Для большинства задач – приемлемо.

А вот ставить на YandexGPT как основной рабочий инструмент – данные этого не поддерживают. Как это произошло и что это говорит о развитии индустрии – вопрос для отдельного разбора.

Автор: bstan