Помните анекдот?

— Что вы умеете лучше всего?

— Я очень быстро считаю.

— Сколько будет 758×652÷9?

— 22!

— Но это же неправильно!

— Зато очень быстро.

TL;DR: Выбирая LLM для своего первого пет-проекта, я случайно создал бенчмарк для LLM “Испытание Дали” по трем параметрам: качество, скорость и стоимость. Этот бенчмарк позволил мне найти оптимальную LLM для встраивания в продукты моей компании Флаг Софт. Возможно, вас тоже заинтересуют его результаты.

Пет-проект

Меня зовут Михаил Радионов, я основатель Флаг Софт — агентства разработки AI-сервисов с 15-летней историей. Пет-проект, из которого вырос бенчмарк, называется AI Quiz. Я создал его как развлечение для гостей сперва на свой день рождения, затем использовал для корпоратива. Оба раза участники остались довольны. А может, и нет, главное, что мне понравилось.

Суть проекта — игра, где каждый должен набрать больше всех очков. Очки набираются в креативных заданиях. В основном, задания делятся на два типа: в одних нужно писать, в других рисовать. Оценивается, в основном, юмор. Участники оценивают друг друга, раздавая баллы. А где тут AI?

В каждом задании есть электронный судья (LLM). Он тоже дает баллы участникам, причем может дать довольно много. Нюанс в том, что для каждого задания LLM надевает разные шляпы: то он Сальвадор Дали, то Альберт Эйнштейн, то Курт Кобейн. И чем лучше участники используют знания об этом персонаже, тем выше их оценивает LLM-судья.

Бенчмарк

В одном из заданий участники оказались умнее, чем судья-LLM. LLM я брал простую, кажется, gpt-4.1-nano. Дешевая и быстрая. И глуповатая. В общем, LLM не справилась.

Задание

Нарисуйте комментарий к “всратому” стоковому фото.

Судья задания: Сальвадор Дали

“Всратое” стоковое фото:

Ответы участников

-

“Предчувствие гражданской войны”

-

“Мастурбатор вышел из-под контроля, став великим”

-

“Сальвадор, Дьяконова и Мария Анна”

-

“Галатея, я тебя на сферы разберу, если не слезешь с него!”

-

“В магазине икеа: «извините, мы закрываемся через 5 минут»”

-

“Я просто хотел нарисовать Мону Лизу”

-

“Слезьте с моего сюрреализма и утекайте отсюда!”

Что за низкосортный бред, спросите вы. Если вы не знаете биографию Дали так, как знают ее мои гости. Ниже расшифровка:

|

N |

Ответ участника |

Отсылка |

|---|---|---|

|

1 |

Предчувствие гражданской войны |

Намек на картину “Предчувствие гражданской войны” — 1936 год |

|

2 |

Мастурбатор вышел из-под контроля, став великим |

Намек на “Великий мастурбатор” — 1929 год |

|

3 |

Сальвадор, Дьяконова и Мария Анна |

Намек на пассию Сальвадора Галу (настоящее имя — Елена Дьяконова) и его сестру Анну Марию |

|

4 |

Галатея, я тебя на сферы разберу, если не слезешь с него! |

Намек на “Галатею сфер” — 1952 год |

|

5 |

В магазине икеа: «извините, мы закрываемся через 5 минут» |

Просто хороший комент без отсылок :) |

|

6 |

Я просто хотел нарисовать Мону Лизу |

Тончайший намек на “Автопортрет в образе Моны Лизы” — 1954 год |

|

7 |

Слезьте с моего сюрреализма и утекайте отсюда! |

Открытое упоминание стиля Сальвадора — сюрреализма, также намек на плавящиеся предметы, вдохновлявшие мастера. Отсылки к картинам нет, но добавлю “Постоянство времени” 1931 года для вашего удовольствия |

И что вы думаете? LLM в роли Дали внезапно дала низкие оценки этим потрясающим комментариям! Я начал разбираться.

Рождение бенчмарка

Первая мысль — проблема во мне. А точнее в моем системном промпте. Какое-то время я провел, продумывая структуру размышлений и few shots. Тогда я узнал, зачем нужны обучающая и тестовая выборка, почему они не должны пересекаться. В итоге модель стала отвечать верно на простые вопросы, но не каждый раз.

Признаюсь, я вообще ничего не знал об LLM. На тот момент рекламные лозунги OpenAI еще звучали в моей голове, хотя действия происходили в 2026 году. Я думал, что Chat GPT 4 (напомню, я использовал gpt-4.1-nano) может все, кроме создания лекарства от рака. Я бы наверное так и боролся с промптом и своими комплексами, если бы не нестабильность модели. Это натолкнуло меня на мысль, что модель угадывает.

В процессе отладки я догадался писать в логи а анализировать ризонинг модели (пошаговое рассуждение). Это как отладка кода в дебаггере. Видно, как развивается мысль от начала до конца. Увлекательная штука.

Температура (мера креативности LLM) была выставлена на 0 во всех тестах.

В общем, я наконец допер, что надо попробовать другую модель. Например GPT-5.4. Результаты изменились, они стали лучше. Изменилось время запроса и цена. Затем я попробовал Claude, Gemini и понеслась. Я как будто попал в магазин игрушек! Вот итоговый список моих игрушек (сейчас апрель 2026 года):

-

claude-haiku-4-5

-

claude-opus-4-7

-

claude-sonnet-4-5

-

claude-sonnet-4-6

-

deepseek-chat V3.2

-

deepseek-reasoner V3.2

-

gemini-2.5-flash

-

gemini-2.5-pro

-

gemini-3-flash-preview

-

gemini-3.1-flash-lite-preview

-

gemini-3.1-pro-preview

-

GigaChat-2

-

GigaChat-2-Max

-

GigaChat-2-Pro

-

gpt-4.1-nano

-

gpt-4o-mini

-

gpt-5

-

gpt-5-mini

-

gpt-5.4

-

gpt-5.4-mini

-

gpt-5.4-nano

-

grok-4-1-fast-non-reasoning

-

grok-4-1-fast-reasoning

-

grok-4.20-0309-non-reasoning

-

grok-4.20-0309-reasoning

-

yandexgpt-5-lite

-

yandexgpt-5-pro

-

yandexgpt-5.1

В процессе я заметил, что у всех моделей есть небольшой разброс качества между попытками. Поэтому я записал по 5 запусков для каждой модели. В итоге у меня получилось около тысячи ответов полученные за 140 вызовов (28×5).

Нужно было их разметить по какой-то балльной системе или просто: правильно / неправильно. Это можно сделать в автоматическом режиме, с помощью LLM-as-a-judge подхода, когда какая-то LLM начинает судить ответы других LLM.

Но я сразу понял, что эта LLM-as-a-judge тоже может ошибаться и ее придется проверять другой LLM. Я не хотел усложнять себе жизнь и тупо проверил все ответы вручную за несколько часов (два дня) 😀

Забавные примеры ответов моделей

-

Мона Лиза — я добавил ее как вариант-ловушку, картину другого художника, но вдруг Gemini в облике Дали сказала “Я работал с образом Моны Лизы”. Я уже хотел поставить “неправильно”, но рука зависла над клавиатурой. Хм. А ведь эта модель в остальных заданиях хорошо ответила, подумал я. В итоге я решил проверить, оказалось — Дали рисовал себя в образе Моны Лизы. AI оказался умнее меня!

-

Некоторые модели выдавали верные варианты случайно. Например, хвалили ответ с близкими Дали, называя Анну Марию его матерью. Но есть нюанс, она ему сестра, а не мать. Хорошая попытка!

-

Некоторые модели хвалили скульптуру Галатея, хотя это картина. Почему? Кто бы знал.

-

А иногда модель не указывала прямо название “Галатея сфер”, но упомянала что-то про ядерную физику. Так я узнал об атомном мистицизме Дали. Этот термин мимо названия картины сразу направляет нас к самой ее сути. Изящно и опять AI оказался умнее меня.

-

Grok один раз признал Галатею, но решил, что она написана в 1973 году => ошибка

-

Grok выдумал Лию Марию Анну

-

Gigachat заметно экономит токены на ответ. Видимо, понимает свой оверпрайснутый ценник 😀

Итоги

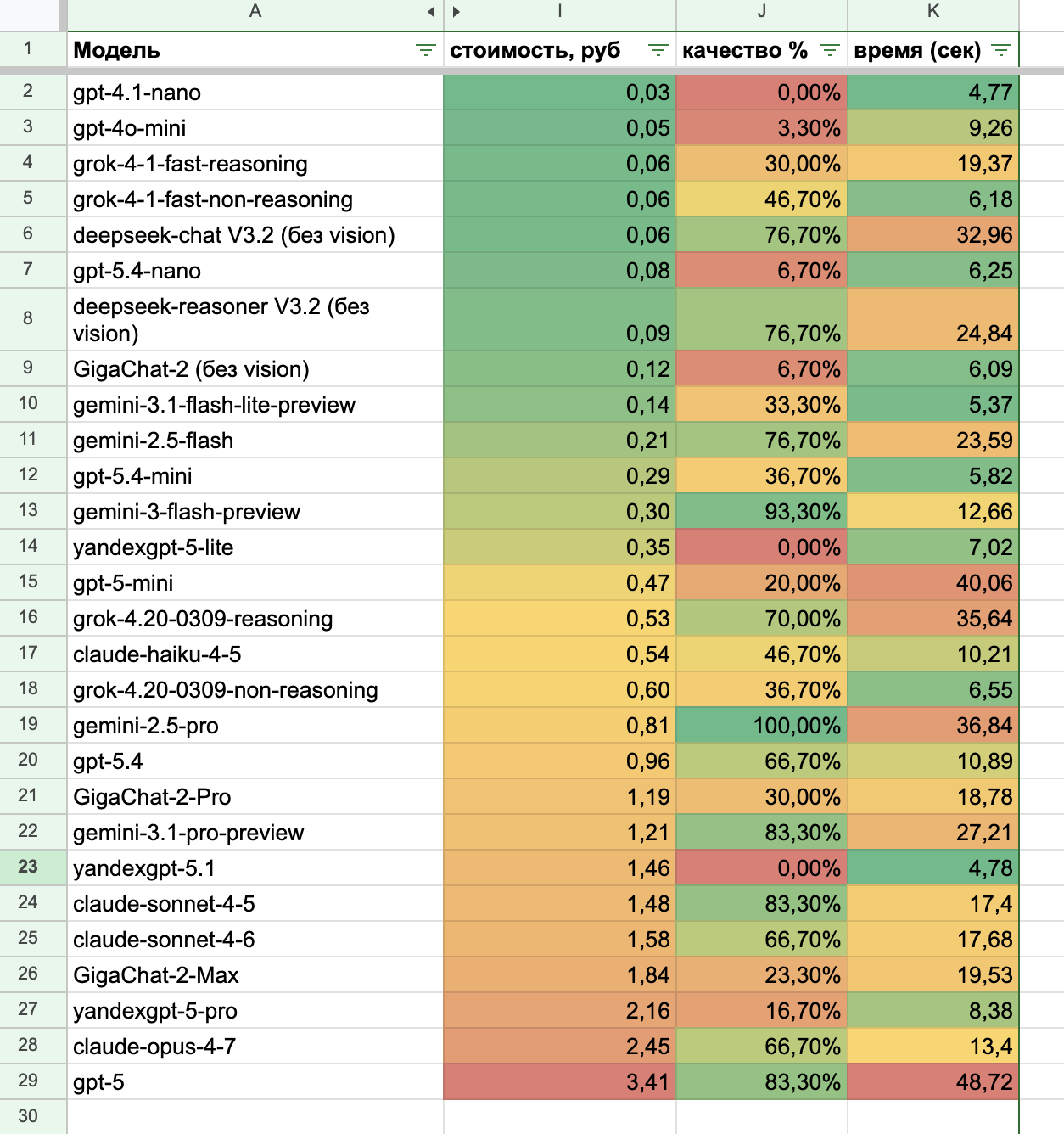

Сортировка по стоимости

При оценке важно упомянуть, что модели потратили неодинаковое количество токенов на запрос. Я могу это объяснить так:

-

Наличие или отсутствие фичи json output

-

У моделей разные токенизаторы. Они по разному разбивают русские слова на токены.

-

И ответы, разумеется, тоже разные по длине. Некоторые модели более лаконичны, чем другие

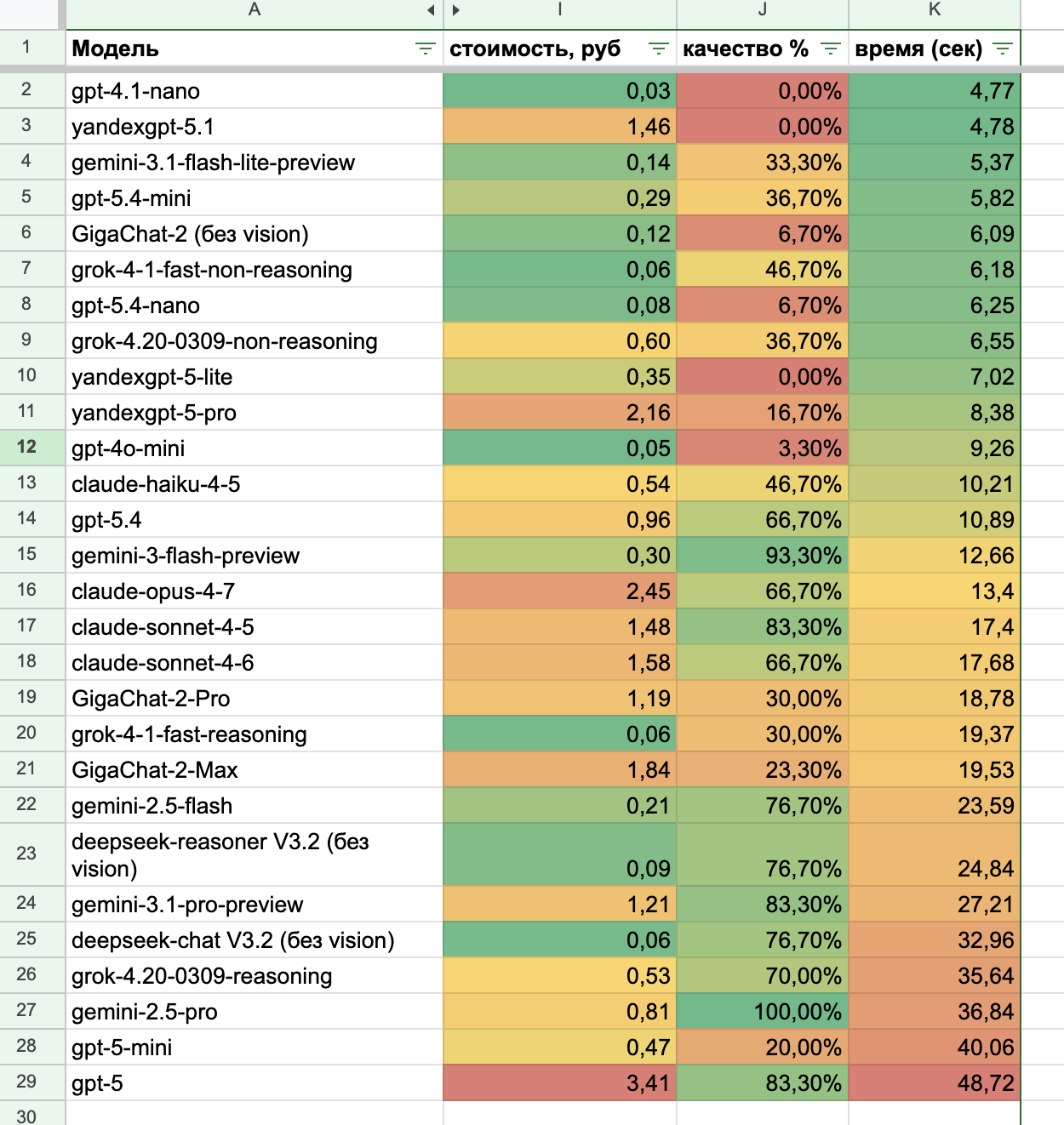

Сортировка по времени ответа

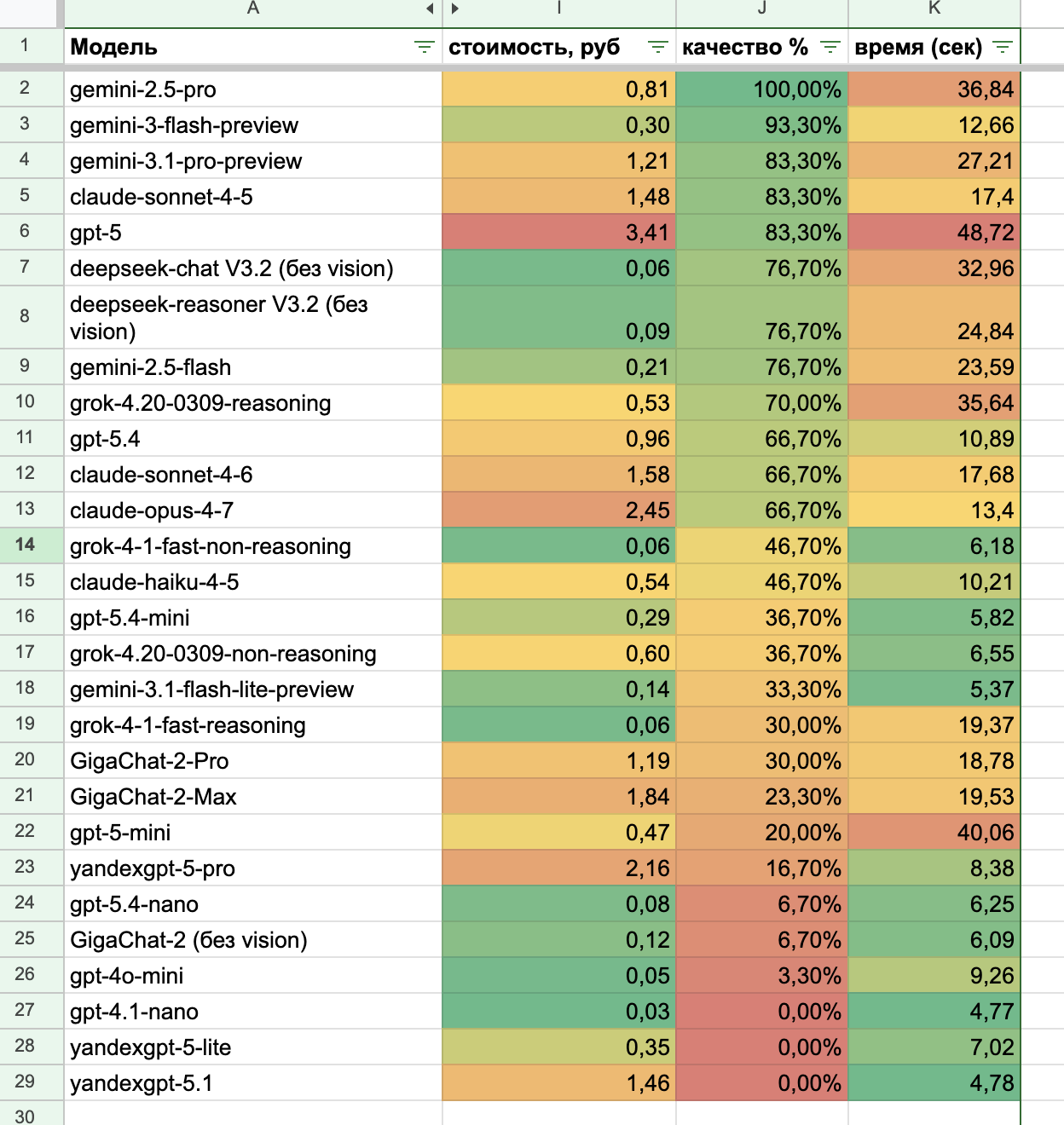

Сортировка по качеству

Мои выводы

-

grok-4-1-fast-non-reasoning хорош для быстрых задач: дешевый, неглупый, быстрый

-

gemini-2.5-pro — самая умная модель в гуманитарной области

-

YandexGPT и GigaChat — ну по крайней мере они быстрые.

Анекдот в начале статьи, кстати, относился к отечественным LLM YandexGPT и GigaChat. Я бы его перефразировал так:

— Что вы умеете лучше всего?

— Быстро отвечать на вопросы пользователей.

— Но вы отвечаете неправильно и дорого.

— Зато быстро!! 😀

Благодаря этому небольшому тесту моя компания имеет именно тот кругозор в выборе LLM, который ей нужен. Я доволен. Делайте свои выводы, выбирайте LLM для себя и обязательно подписывайтесь на канал моей компании Флаг. Всегда пишу про интересные вещи.

Автор: radionov_me