Ещё несколько лет назад в крупных компаниях роль «центра управления ИТ-инцидентами» часто закрывали тяжёлые решения enterprise-класса ITOM/Event Management — те самые «NOC-платформы», которые собирали события из десятков источников, коррелировали их и превращали в управляемые инциденты (например, решения уровня BMC/IBM/Micro Focus). После 2022 года многие из этих платформ оказались недоступны или резко усложнились в эксплуатации — и предприятия остались с зоопарком доменных мониторингов (метрики, логи, APM, сеть, безопасность), но без единого управленческого слоя для бизнеса: приоритизации по влиянию, общей корреляции/дедупликации, единого инцидентного контура и расчетного SLA. Казалось бы, сейчас мы наблюдаем всё, но факт в том, что не управляем ИТ-ландшафтом в целом. Упор на автономию команд и разрозненные инструменты приводит к «разрывам» в управлении: нет единой картины при инцидентах, SLA считаются в табличках, корреляция событий происходит «в головах людей», интеграции держатся на 1–2 специалистах, а построение CMDB и моделей ИТ-ландшафта часто игнорируется. В этой статье мы постараемся переосмыслить роль зонтичного мониторинга, и докажем, что это не ещё один мониторинг, а важный архитектурный слой.

Мы предлагаем сменить ракурс: считать зонтичный мониторинг слоем системного управления ИТ поверх прочих систем мониторинга. Такой слой обеспечивает единый контур: общую модель сервисов и КЕ, централизованную корреляцию и приоритизацию инцидентов, сквозной инцидент-менеджмент с автоматическими сценариями автоматизации и отчёты по SLA. Это не отменяет свободного выбора инструментов командами — но объединяет их возможности ради управляемости и прозрачности.

Подход подтверждают кейсы внедрения зонтичного мониторинга в X5 и автоматизации мониторинга в НЛМК: они подключили к “зонту” миллионы объектов из десятков систем, автоматизировали построение ресурсно-сервисных моделей и сократили время устранения инцидентов на 30-40%.

Экономически «слой управления» окупается снижением времени простоя во время восстановления (MTTR) и трудозатрат инженеров. Модель расчёта показывает: при снижении MTTR даже на 20–30% по ключевым инцидентам можно сэкономить десятки миллионов руб. в год. К тому же за счёт единой платформы уменьшается нагрузка на дежурные службы и устраняются «ручные» расходы на поддержку десятков интеграций (несколько FTE годовых) и риск «забытых» систем. В статье мы приведем методику оценки 5-летнего TCO (формула + пример расчёта на наборах параметров) и практический чек-лист зрелости (12 пунктов + матрица уровней).

Решить проблему разрозненности наблюдения без пересаживания всех в одну платформу позволяют не новые дашборды, а архитектурный уровень контроля зонтичной системой мониторинга. Цели статьи — дать CIO и архитекторам язык для таких решений, показать примеры и метрики успеха, и объяснить, как постепенно построить «зонт» над существующими системами, не «ломая» автономность команд.

Этот материал — взгляд команды, которая за последние годы участвовала в десятках внедрений зонтичного мониторинга в российских компаниях разного масштаба — от распределённого ритейла и промышленности до финансового сектора и госсистем. Мы видели проекты, которые давали кратный эффект, и видели проекты, которые буксовали. Поэтому ниже — не идеальная архитектура, а практические выводы: что реально работает, где возникают риски, и какие управленческие решения критичны для успеха.

Важно сразу обозначить границы применимости. Зонтичный слой управления ИТ нужен не всем. Если у вас небольшая компания с 5–10 сервисами, нет SLA-критичности для бизнеса, нет режима 24×7, отсутствует on-call модель и сервисная связность относительно проста — скорее всего, полноценный зонтик вам пока не нужен. В таких условиях достаточно хорошо настроенных доменных мониторингов и дисциплины инцидент-менеджмента. Зонтик становится экономически и организационно оправданным тогда, когда появляется масштаб, многокомандность, зависимость бизнеса от цифровых сервисов и стоимость часа простоя измеряется не тысячами, а миллионами рублей. Именно для таких областей применения и написана эта статья.

Больше мониторингов, хороших и разных

Ведущие ИТ-директора слышат это часто: у нас много систем мониторинга, но нет общей картины. ИТ-инфраструктура раздута, но при значительном инциденте, который может затрагивать несколько зон ответственности, у каждого — своя правда. Один видит перегрузку сети, другой — сбой БД, третий — провал транзакций.

Нагрузка на дежурные службы тоже растёт: рабочие группы достают из разных источников логи и графики, сводят события вручную и теряют время на распри, кто исправит проблему. SLA «достраиваются» вручную по итогам периода и не работают как живой инструмент. Интеграции между системами часто держат 1–2 незаменимых специалиста: в любой момент может что-то пойти не так и прервётся работа части контура. CMDB часто выполняет роль бутафорского списка — вне процессов и часто без привязки к реальным сервисам. В таких условиях бизнес-сервисы кажутся «прозрачными», когда система доступна, но при сбоях никто не скажет точно, какова стоимость простоя в рублях, где надо смотреть в первую очередь и кто ответственный.

Эти сценарии типичны для традиционной зрелости мониторинга российских крупных компаний: метрики собираются разрозненно в командах, но не используются как часть общей модели управляемости. Решение локальных проблем в режиме тушения пожаров не уменьшает их повторяемость. Слой управления ИТ-ландшафтом меняет подход: он фокусируется не на панели с алертами и не на технических дашбордах, а на процессах и бизнес-контексте.

Представьте, что в ночь акции на сайте крупного ритейлера разыгрался «шторм алертов»: Prometheus наметил рост задержек, Zabbix сообщил о нехватке памяти в кластере, а лог-система отразила рост ошибок в очереди. Разгадать проблему помогла ночная встреча дежурных и архитектора: оказалось, что в памяти упало кэширование, что подбросило дедлайны оплат. В едином слое это бы обработалось как один «критический инцидент», а не три разных события.

Или еще один пример. На предприятии в понедельник утром засигналили SCADA. Оператор увидел ошибки датчиков, сетевики — всплеск трафика, админ — предупреждение UPS battery low, а в ERP начали появляться задержки по операциям. На самом деле это был один инцидент, который проявился разными симптомами: из-за проблем с питанием (или деградации ИБП) часть оборудования стала нестабильно работать и перезагружаться. Это дало:

-

ошибки и таймауты по датчикам (SCADA видит “датчик умер”),

-

шторм переподключений и повторных пакетов (сеть видит “аномальный трафик”),

-

сбои в данных и цепочках процессов (ERP видит “задержки”).

Проблема не в том, что люди «плохо работали». Проблема в том, что каждая команда видела свой экран и свой симптом, и никто не мог быстро ответить.

Ни один текущий инструмент мониторинга сам по себе не формирует общую картину влияния на бизнес, крупным компаниям приходится констатировать:

-

Слишком много «точек зрения». Разные инструменты дают разные контексты данных. Один алерт в Prometheus, другой – в APM, третий – уведомление в Тимз или Экспресс.

-

Нет общей модели сервисов. OpenTelemetry и Kubernetes дают стандартный формат сигналов, но у каждой системы своя абстракция «что мониторить». Нужна единая модель сущностей: сервисы, конфигурационные единицы (КЕ) и связи между ними. Без неё невозможно автоматически связать «что упало» и «кого это коснулось».

-

Оргструктура не изменилась. Команды привыкли держать свои инструменты: инфраструктурщики — Zabbix, DevOps — Prometheus, прикладники — свой APM. Нет роли «архитектора мониторинга», чтобы сказать «кто за что отвечает». В результате изменения в ландшафте (новый сервис, новый проект) требуют десятков согласований и часто не реализуются в совокупной модели.

-

Технический долг растёт. Экосистема связанных open source решений, опутанная интеграциями, собственные скрипты проверок, отчетов, постепенно становятся «скрытым продуктом» внутри ИТ. Такая «сборка» без владельца быстро превращается в клубок проблем: каждый патч или миграция оборачиваются трёхдневной доработкой, а обновлять стек наблюдаемости становится дороже любых согласованных ранее бюджетов.

Таким образом, набор мониторингов не решает стратегическую задачу: как управлять сложной ИТ-средой. Решить это помогает именно архитектура — слой зонтичного мониторинга или слой управления ИТ.

Идеальная архитектура слоя управления ИТ-ландшафтом

Слой управления ИТ-ландшафтом — это управленческий контур, который превращает разрозненные сигналы из десятков доменных систем в три вещи, необходимые CIO: единые инциденты, управляемый SLA/SLO и координацию дежурных служб. В идеальной архитектуре этот слой состоит из трёх компонентов, каждый из которых делает свою работу и не пытается быть “универсальным комбайном”:

-

Зонтик – ядро данных, отвечает за объединение и управленческий контекст;

-

AIOps – интеллектуальные корреляции, автоматизации и подсказки, отвечает за инсайты, аномалии и снижение шума;

-

ITSM/On-call – контур исполнения и дисциплины, отвечает за то, чтобы решения исполнялись по правилам: роли, эскалации, SLA, аудит, постмортем.

Ядро слоя — зонтик. В архитектурном смысле зонтик — это шина между источниками наблюдаемости и управленческими решениями. Он может, но не обязан быть самым глубоким в метриках или самым удобным в трассировках — этим занимаются доменные инструменты. Зонтик обязан быть лучшим в другом: в сведении разнородных сигналов к единому управляемому событийному и сервисному контексту. Его минимальный набор функций выглядит так: приём данных из множества источников (через коннекторы/API), нормализация сигналов к единой канонической модели (чтобы “ошибка датчика”, “alarms from Prometheus” и “incident from APM” стали сопоставимы), привязка сигналов к модели сущностей и сервисов (РСМ/CMDB/граф влияния), корреляция и группировка в “ситуации”, приоритизация по влиянию на сервис (impact), формирование управляемых инцидентов по единым правилам, маршрутизация и эскалации в дежурные службы, и расчёт SLA/SLO “из системы”, а не вручную. На практике именно связка “сервисная модель + корреляция + единые правила инцидентов” и делает зонтик слоем управления, а не витриной.

Чтобы зонтик работал в реальном Enterprise, ему нужно корректно обращаться с разными типами данных.

-

События и алерты — это его “родной язык”: он должен принимать их из Zabbix/Prometheus/Alertmanager/APM/сетевых и security-систем, дедуплицировать, связывать по контексту, подавлять шум (понимать сервисные режимы, “дребезг” и типовые проблемы), и превращать поток сигналов в понятные ситуации и инциденты. Подключать новые системы надо не с помощью сложных интеграций, а на лету с помощью готовых интеграций или с помощью нескольких строк кода в интерфейсе.

-

Метрики зонтик принимать должен, но с правильной ролью: как правило, не хранить “сырые” временные ряды и не конкурировать с существующей TSDB, а поднимать наверх агрегированные управленческие показатели (SLI/“golden metrics”: latency p95/p99, error rate, availability, saturation) и использовать их для расчёта SLA/SLO, определения деградаций и приоритизации. Если нужно унифицировать политики, зонтик может хранить “эталонные правила” (например, SLO-порог для критичных сервисов) и раскатывать их вниз в доменные системы — пороги исполняются внизу, а стандарты и консистентность задаются сверху.

-

Логи зонтик должен собирать эффективно, но без дублирования: он интегрируется с существующим коллектором (OpenSearch/ELK/Loki и т.п.), использует лог-события как источники сигналов (например, рост ошибок) и прикрепляет к инциденту ссылки/выдержки, обеспечивая доказательность RCA без попытки заменить поисковый движок.

-

Трейсы (OpenTelemetry) зонтик обязан поддерживать как стандарт интеграции и контекста, но и здесь важно не перепутать роли: специализированные APM/trace-backends хранят и анализируют спаны, а зонтик потребляет либо алерты/агрегаты по сервисам, либо ссылки на конкретные проблемные трейсы (trace_id), чтобы ускорить RCA. Это даёт огромный эффект: при инциденте не нужно “рыться” по всем системам — инцидент уже содержит гипотезу, impact и указатели на доказательства. И наконец, топология/сервисная модель — обязательный слой контекста: зонтик должен иметь хотя бы “минимально достаточную” РСМ для критичных сервисов, иначе он превратится в очередную ленту алертов без управляемости.

Очень важна роль AIOps в этой архитектуре — но не “заменить инженеров” и не “прикрутить ML ради галочки” в поисках хайпа, а сделать управляемость масштабируемой. В зрелом виде AIOps закрывает четыре группы задач.

-

Снижение шума: дедупликация, кластеризация, подавление флаппинга, группировка алертов в ситуации, контекстная фильтрация с учётом работ и изменений.

-

Корреляция и причинность: выявление вероятной первопричины и построение цепочек “cause → symptoms” на основе графа зависимостей, исторических паттернов и данных изменений (change awareness).

-

Прогноз и раннее предупреждение там, где есть данные: обнаружение аномалий, предиктивные сигналы деградации, автоматическое выделение “необычного” поведения сервиса по SLI.

-

Ускорение действий: рекомендации runbook, автозаполнение контекста инцидента, автоматическая сборка краткого executive-summary, а в связке с корпоративной LLM-платформой — понятные объяснения “что случилось и почему мы думаем, что это вот здесь”, плюс ChatOps-сценарии (“покажи состояние сервиса”, “кто on-call”, “какие изменения были перед инцидентом”). Ключевой принцип: AIOps работает хорошо только тогда, когда у зонтика есть сервисный контекст и дисциплина инцидентов; без этого любой ML превращается в генератор сомнительных гипотез.

Третий компонент — ITSM/On-call, и он критичен: без него “слой управления” остаётся аналитикой без исполнения. Здесь должны жить единые правила: что считается инцидентом, когда открываем P1/P2, кто владелец, как запускается инцидент, где war-room, как ведётся журнал действий и протокол, как считается время реакции и восстановления, как закрывается и фиксируется постмортем, как учитываются сервисные окна работ. В идеале зонтик не конкурирует с ITSM, а интегрируется: создаёт/обновляет тикеты, поднимает дежурных, прикладывает контекст и доказательства, контролирует SLA и обеспечивает аудит. Именно поэтому слой управления — это “зонтик + AIOps + ITSM”, где зонтик остаётся ядром, AIOps усиливает интеллект, а ITSM превращает это в управляемую практику.

Практический вывод для выбора системы простой: редко когда всё это хорошо реализовано “в одном продукте”. Попытка купить монолит “и мониторинг, и AIOps, и ITSM” обычно заканчивается либо компромиссами, либо сопротивлением команд (“нас заставляют жить в чужой системе”), либо провалом внедрения из-за замены привычных доменных инструментов. Более устойчивый паттерн для Enterprise — федеративная архитектура: доменные мониторинги остаются, ITSM остаётся, а вы выбираете сильный зонтик, который умеет нормально интегрироваться и содержит базовые AIOps-функции (шумоподавление, корреляция, ситуационное управление, change-awareness), а продвинутые AIOps/LLM-возможности подключаете модульно, по мере зрелости данных и процессов.

Если выбирать “что важнее”, то для CIO приоритет таков: сначала зонтик с сервисной моделью, корреляцией и едиными правилами инцидентов, затем — AIOps как усилитель, и только потом — расширения по глубокой наблюдаемости, которые логичнее держать в доменных системах. Это и есть идеальная архитектура: много автономного мониторинга внизу, но единая управляемость наверху.

Как это выглядит технически: канонический «сигнал», дедупликация и привязка к сервису без “идеальной CMDB”

1) Каноническая структура события в зонтике

Разные входные потоки (события, алерты, метрики, текстовые сообщения) приводятся к управленческой сущности «Сигнал», которая “концентрирует в себе информацию о проблеме, полученную из разных источников”. Monq поддерживает получение из внешних систем событий, алертов, метрик и любой текстовой информации и подключение по push/pull, API/REST/SOAP/БД.

Ниже пример “канонического” набора полей как практичная модель:

{ "signal_id": "SIG-2026-03-001234", "signal_type": "DB.Latency|Network.PacketLoss|SCADA.SensorTimeout", "status": "OPEN|INVESTIGATING|MITIGATED|RESOLVED", "lifecycle_stage": "DETECTED|TRIAGED|IN_WORK|MONITORING|CLOSED", "severity": "P1|P2|P3|P4", "first_seen": "2026-03-01T09:11:25Z", "last_seen": "2026-03-01T09:19:40Z", "source_systems": [ {"name":"Prometheus/Alertmanager","source_event_id":"..."}, {"name":"Zabbix","source_event_id":"..."}, {"name":"APM/OTel","trace_id":"..."} ], "affected_cis": [ {"ci_id":"CI-STORE-04231", "ci_type":"Store", "role":"SERVICE"}, {"ci_id":"CI-DB-CLUSTER-7", "ci_type":"DBCluster", "role":"RESOURCE"} ], "service_impact": { "service_id":"SVC-Checkout", "impact":"DEGRADED|DOWN", "business_criticality":"A|B|C" }, "dedup_key": "SVC-Checkout|DBCluster-7|DB.Latency|region=MSK", "correlation_group": "INC-2026-03-00077", "owner": {"team":"SRE.Checkout","oncall_schedule":"SRE-Checkout"}, "evidence_links": [ {"type":"metrics","link":"..."}, {"type":"logs","link":"..."}, {"type":"trace","link":"..."} ], "actions": [ {"type":"runbook","name":"DB latency triage"}, {"type":"notify","channel":"war-room"}, {"type":"create_ticket","itsm":"..."} ]}

Почему это “правильная” структура именно для зонтика: она не пытается хранить все метрики/логи/трейсы, но фиксирует управленческое ядро — что случилось, что затронуто (КЕ/сервис), насколько критично, кто владелец, куда эскалировать, где доказательства. Типизация Сигналов как раз и задаёт статусную модель, жизненный цикл и атрибутивный состав, а связь Сигнала с КЕ влияет на «Здоровье» КЕ.

2) Пример правила дедупликации (логика, не код)

В зонтике правила корреляции и дедупликации данных в Сигналы можно описывать “по любым параметрам” (например, через low-code/визуальные сценарии). Логика дедупликации, которая хорошо работает в enterprise, обычно такая:

Правило “одна проблема — один сигнал”

-

Приводим входные алерты/события к каноническим полям: service_id, ci_id, event_type, environment, region, symptom_class.

-

Формируем dedup_key = service_id + primary_ci + event_type + environment + region.

-

Если в течение окна T (например, 15 минут) приходит новый алерт с тем же dedup_key, мы:

-

не создаём новый сигнал, а обновляем существующий (продлеваем last_seen)

-

повышаем severity по правилу “max severity wins”

-

накапливаем “evidence” (ссылки на метрики/логи/трейсы)

-

считаем количество повторов (useful для noise scoring)

-

Правило анти-флаппинга

-

Если сигнал “открывается/закрывается” N раз за короткий период, переводим его в режим flapping, не создаём новый инцидент, а маршрутизируем на отдельный triage (иначе вы убьёте on-call).

Правило “maintenance aware”

-

Если КЕ/сервис находится в окне работ, сигнал не эскалируется как P1/P2, но продолжает фиксироваться для последующего анализа (важно для честного SLA). При этом видно его влияние на вышестоящие сервисы по РСМ, что показывает владельцам этих сервисов причину их проблем – деградация не из-за аварии, а в результате плановых работ.

Смысл: дедупликация не “прячет проблемы”, она делает поток управляемым — превращает бурю алертов в устойчивый объект управления.

Хорошо, когда такие правила преднастроены и их не надо выдумывать при каждом внедрении. Очень хорошо, когда все подобные правила зашиты в контент-паки для каждого типа объекта мониторинга, будь то виртуализация, оборудование или прикладное ПО.

3) Как привязать алерт к сервису без “идеальной CMDB” (labels/ownership/нейминг)

Возражение CIO «у нас нет CMDB/РСМ, поэтому зонтик не взлетит» — типично. На практике зонтику почти никогда не нужна “идеальная CMDB всего предприятия”. Ему нужна минимально жизнеспособная ресурсно-сервисная модель (MVP) для критичных сервисов.

Зонтичный мониторинг поддерживает построение CMDB и ресурсно-сервисной модели на базе данных из разрозненных источников, включая ручное и автоматизированное наполнение CMDB и построение РСМ, управление жизненным циклом КЕ и связями. А также low-code сценарии для актуализации CMDB, построения РСМ и управления моделями “Здоровья”.

Практический паттерн “без идеальной CMDB” выглядит так:

-

Связи по ответственным

Используем то, что уже есть почти везде:

– team/service labels в Prometheus / Kubernetes (app, namespace, owner, service)

– теги в APM

– группы поддержки в ITSM

Это и есть первичная привязка «алерт → команда». -

Связи по влиянию

Фиксируем небольшой реестр критичных сервисов (5–10) и простое правило нейминга:svc=checkout, svc=erp, svc=scada-line-3

Даже если инфраструктура меняется, сервис как объект управления остаётся. -

Связи по ресурсам

Для инфраструктурных сигналов выбираем “primary CI” по устойчивому идентификатору:fqdn/host_id/cluster_id/asset_id/serial

В зонтике «КЕ — любой объект, состояние которого нужно контролировать», а типизация КЕ задаёт модель данных и жизненный цикл; связи КЕ позволяют выстроить РСМ. -

Минимальная модель (РСМ)

На старте вам не нужно описывать всё: достаточно связей типаService → DBCluster → Storage/Network

и пары ключевых зависимостей. Дальше модель растёт по мере подключения источников и инцидентов. -

Контроль слепых зон: “покрытие” как управленческий KPI

Если мониторинг “плохой”, зонтик должен не “страдать”, а показывать покрытие мониторингом по КЕ/сервисам. В зонтике прямо заявлена метрика “по каждому объекту наблюдения с расчетом покрытия мониторингом” в оперативном центре.

Это превращает разговор “у нас всё плохо” в управляемый бэклог: каких сигналов не хватает, где нет метрик/событий, где нет владельца, какие сервисы слепые.

Почему подход “соберём на open-source” не работает

Идея кажется здравой: взять зрелые open-source инструменты — Zabbix, Prometheus, ELK, Grafana — связать их пайплайнами, добавить немного собственной логики и получить корпоративный мониторинг без лицензионных расходов и вендор-лока. В первые 6–12 месяцев это действительно может выглядеть рационально. Но в масштабе крупной организации ключевой вопрос — не «работает ли», а «масштабируется ли управляемость».

В 80% компаний open-source сборка держится не на архитектуре, а на 2–3 “героях”, которые знают, где что склеено. Они помнят, почему в Alertmanager стоит именно такой routing, какой скрипт синхронизирует события с ITSM, где костыль для дедупликации и почему его «лучше не трогать». Это не признак непрофессионализма — это естественный результат эволюции системы без единого владельца слоя управления. Но в этот момент платформа перестаёт быть архитектурой и становится персональной памятью конкретных людей.

Главный риск неприятный, но честный: в enterprise проблема редко в технологиях — она в воспроизводимости управления. Если наблюдаемость перестаёт работать без конкретных инженеров, значит, у вас нет управляемого слоя — у вас есть хрупкая инженерная конструкция. Любой отпуск, увольнение или просто усталость “героя” превращаются в фактор MTTR. В какой-то момент оказывается, что время восстановления зависит не от SLA и не от зрелости процессов, а от того, доступен ли нужный человек в мессенджере.

Самый болезненный вопрос, который стоит задать себе: если завтра уйдут два ключевых инженера, через сколько дней вы восстановите правила корреляции, дедупликации и приоритизации инцидентов? Если ответ измеряется неделями — у вас нет слоя управления ИТ. У вас есть самосборка, которая держится на людях, а не на архитектуре.

Пока ИТ держится на героях, бизнес зависит от их настроения и графика отпусков.

Open-source прекрасно масштабирует сбор данных. Но он не масштабирует ответственность автоматически. Бесплатная лицензия не уменьшает эффект автобуса. Иногда она его увеличивает.

В open source сборке каждый инструмент имеет своего владельца: одна команда отвечает за метрики, другая за логи, третья — за ITSM, четвёртая — за CMDB. Но нет владельца слоя управления целиком. Нет продуктового управления мониторингом как функцией. Нет версии платформы, нет дорожной карты, нет SLA на сам контур наблюдаемости. Любое изменение — это совещание, а не управляемое обновление. Через 2–3 года такой стек начинает жить по принципу «работает — не трогай». Через 4–5 лет он превращается в организационный технический долг с накопленными инфраструктурными, ИБ и функциональными разрывами.

Второй миф — «open source бесплатно». Бесплатна лицензия. Не бесплатны люди, интеграции и апгрейды. Типичный контур поддержки самосборки требует 2–3 FTE: разработка коннекторов, тестирование, поддержка версий, разбор инцидентов, обновление API. При средней полной стоимости специалиста 300–350 тыс. ₽ в месяц это 10–12 млн ₽ в год только на зарплаты. Плюс инфраструктура (которая иногда более требовательна к ресурсам), плюс скрытый код интеграций, который никто кроме внутренних инженеров не понимает. Каждый апгрейд Kubernetes, Grafana или Elastic становится мини-проектом с регресс-тестированием. Добавим “эффект автобуса” — и получаем операционный риск, который нельзя застраховать.

Но главный фактор — это не прямые затраты, а экономика простоев. Если у компании 30 серьёзных инцидентов в год со средней длительностью 4 часа, а час простоя стоит 2 млн ₽, годовой ущерб составляет 240 млн ₽. Снижение MTTR на 20–30% за счёт единой корреляции, ресурсно-сервисной модели и автоматизации даёт экономию в десятки миллионов рублей в горизонте нескольких лет. Именно здесь самосборка чаще всего проигрывает: она может собирать метрики, но редко обеспечивает системное сокращение времени восстановления, так как наблюдаемость – не управление.

Важно также развести два часто путаемых подхода — слой управления ИТ-окружением (“зонтик”, или ITOM+AIOps) и просто «серийная платформа наблюдения + настройка». В первом случае речь идёт о целостной архитектуре слоя управления ИТ: единая ресурсно-сервисная модель, централизованная корреляция и дедупликация, управление инцидентами, SLA, автоматизация и контур исполнения как часть общей системы. Это управленческий слой, который интегрирует доменные мониторинги и задаёт стандарты. Во втором случае — это просто установка коммерческого инструмента (например, лог-менеджмента или APM, таких как, Dynatrace, Elastic, New Relic) и его локальная настройка под конкретную задачу без построения единого управленческого контура. Такой инструмент может быть мощным и удобным, но не обязательно формирует единый слой управления для бизнеса.

Ниже — упрощённое сравнение подходов на горизонте 5 лет (цифры иллюстративные, порядок величин для enterprise-среды):

Разница между “платформой наблюдения” и слоем управления — в масштабе управляемости. Первая решает функциональную задачу (сбор логов, APM, алертинг). Вторая выстраивает единый управленческий контур для всего ИТ-департамента: общие правила создания инцидентов, общую сервисную модель, единую корреляцию и единую панель для CIO.

Именно поэтому через несколько лет эксплуатации становится очевидно: open-source отлично работает на уровне команды, но на уровне всего ИТ-ландшафта стоимость хаоса чаще всего выше стоимости контроля.

«Мы не готовы к зонтику» — самая дорогая отговорка в ИТ

Когда разговор заходит о слое управления ИТ-ландшафтом, почти всегда звучит одна из двух фраз: «мы не готовы» и «у нас мониторинги плохие, сначала надо их настроить». Обе выглядят как аргументы про зрелость. На практике это один и тот же феномен: дефицит конфигурационного знания, недоверие к CMDB/РСМ и архитектурный дрейф — реальная система меняется быстрее, чем её успевают описывать. CIO делает логичный, но ошибочный вывод: “если модели нет и мониторинг местами слабый — мы не можем строить управляемость”.

Проблема в том, что фраза «мы не готовы» — не нейтральная позиция. Это выбор жить дальше в режиме ручной корреляции, героизма и непредсказуемого MTTR. Если перевести на язык бизнеса, смысл примерно такой: мы принимаем потери от простоев и деградаций как норму, потому что менять операционную модель сложнее, чем терпеть хаос. И это ловушка зрелости: компании ждут идеальной модели и идеальных мониторингов, чтобы начать управлять, но зрелость появляется только в процессе управления, а не до него.

Отговорка про “плохие мониторинги” звучит особенно часто — и она тоже логична: “зачем зонтик, если внизу дырки?” Но здесь важно различать: доменные мониторинги отвечают за глубину наблюдения в своём контуре, а зонтик отвечает за управляемость всего ландшафта. Если мониторинги действительно плохие, зонтик как раз и нужен, чтобы это стало видно системно, измеримо и приоритезировано. Хороший зонтик должен показывать степень покрытия мониторингом: какие сервисы и конфигурационные единицы вообще не наблюдаются, где нет метрик/событий/синтетики, где алерты не связаны с сервисами, где нет владельцев, где нет правил инцидентов. То есть зонтик не “маскирует плохой мониторинг”, а делает дыру видимой и позволяет поставить её в бэклог как управляемую задачу, а не как бесконечную боль “когда-нибудь надо улучшить мониторинг”.

Ключевой сдвиг, который снимает обе отговорки: перестать воспринимать зонтик как “большой проект по построению идеальной CMDB и идеальной РСМ”. Правильная практика – строить сначала MVP зонтичного мониторинга: вы начинаете с минимально достаточной ресурсно-сервисной модели для 5–10 бизнес-критичных сервисов, вводите единые правила инцидентов и эскалаций, считаете SLA хотя бы по верхнему уровню, и параллельно получаете объективную картину: где мониторинг покрывает критичное, а где нет. Даже 60–70% точности модели уже дает эффект: уменьшается шум, появляется impact-приоритизация, сокращается время “до понимания”, а значит падает MTTR. А дальше модель “выращивается” — частично автоматикой из источников, частично уточняется по итогам инцидентов, частично стабилизируется владельцами сервисов. В этот момент “плохие мониторинги” перестают быть абстрактным аргументом и превращаются в конкретные пункты: вот сервисы без наблюдения, вот домены без событий, вот критичные цепочки без синтетики — и у каждого пункта появляется владелец, срок и эффект.

Именно поэтому низкая зрелость и слабое качество мониторингов — не причина отказаться от зонтика, а главный аргумент начать. Потому что без управленческого слоя вы не улучшите мониторинг системно: у вас не будет единого “что важно”, единого SLA-контекста, единой приоритизации и общего языка между доменами. А с управленческим слоем вы, наоборот, получаете управляемую программу повышения зрелости: сначала критичное, затем важное, потом всё остальное — и всё это подчинено снижению MTTR и прозрачности SLA, а не бесконечному “улучшаем мониторинг ради мониторинга”.

Экономика “порядок величин”: TCO/ROI на 5 лет (пример, который можно пересчитать под себя)

Возьмём вводные: средний SLA 99,6%, 5 бизнес-критичных сервисов, стоимость простоя 2 млн ₽/час на сервис.

1) Сколько стоит текущий SLA 99,6% в простое

-

В году: 365 × 24 = 8760 часов

-

Downtime при SLA 99,6%: 0,4% × 8760 = 35,04 часа/год на один сервис

-

Для 5 сервисов: 35,04 × 5 = 175,2 часа/год

-

Деньги: 175,2 × 2 млн ₽ = 350,4 млн ₽/год потерь от простоя (порядок величин)

2) Что даёт “зонтик” в модели (консервативно)

Предположим, что за счёт корреляции/дедупликации, правильной маршрутизации на on-call, привязки к CMDB/РСМ и runbook-подсказок вы снижаете суммарный downtime на 25% на выбранных критичных сервисах (это примерно эквивалент роста SLA с 99,6% до ~99,7%, потому что downtime падает с 0,4% до 0,3%).

-

Экономия в год: 350,4 млн ₽ × 25% = 87,6 млн ₽/год

3) TCO “зонтика” (пример структуры затрат)

-

Год 1 (внедрение): 30 млн ₽

(лицензия+поддержка 12, внедрение 10, инфраструктура 3, внутр. ресурсы 5) -

Годы 2–5 (эксплуатация): 18 млн ₽/год

(лицензия+поддержка 12, инфраструктура 3, внутр. ресурсы 3)

Чтобы не завышать эффект, считаем что в 1-й год достигается только 50% целевого эффекта (пока модель сервисов/РСМ “созревает”).

4) Итого за 5 лет:

-

Экономия: 394,2 млн ₽

-

Затраты: 102,0 млн ₽

-

Чистый эффект: +292,2 млн ₽

-

ROI (5 лет): (394,2 − 102,0) / 102,0 = 2,86 → 286%

-

Окупаемость: в 1-й год, примерно 30 / 43,8 ≈ 0,69 года ≈ 8 месяцев

Важно: это модель только по downtime. Обычно дополнительно (и тоже в деньгах) проявляются: снижение “шума” (меньше дежурств/перегрева команды), меньше ошибок на эскалациях, быстрее RCA, лучше управляемость SLA/SLO и отчётность. Если включить это — ROI обычно становится ещё лучше.

Цифры иллюстративны. В реальных проектах эффект варьируется от 10 до 40% в зависимости от зрелости.

Чек-лист: как CIO оценить зрелость управляемости

Ниже — практические вопросы и проверки, которые помогут понять, есть ли у вас слой управления или только набор мониторингов.

-

Владелец «зонтичной системы». Назначен ли ответственный за архитектуру мониторинга и единую систему (с полноценными ресурсами) или каждая команда по-тихому лепит свою часть большого зоопарка?

-

Единая модель сервисов (РСМ) и владельцы. Есть ли утверждённая модель ИТ-сервисов и КЕ (CMDB/РСМ)? Кто за неё отвечает? Как ведётся обновление данных?

-

Централизованный сбор событий. Наличие единого Data lake/шины или брокера (Kafka, ES) для всех алертов? Или данные по-прежнему «пляшут» в разных системах и чатах?

-

Единый реестр инцидентов. Существует ли общее место (ITSM/инцидент-система) с централизованным приоритетом? Или дежурная смена регистрирует инциденты везде (1С, SimpleOne, ITSM360, Jira, ServiceNow, почта)?

-

Приоритизация по влиянию. Есть ли формальный механизм (или хотя бы матрицы рисков), определяющий приоритеты инцидентов через цифровую модель (SLA/BAU-критичность)? Или «откуда громче завизжало, то и чинят»?

-

Готовность базы знаний. Есть ли библиотека отработанных процедур (инструкций) для типовых отказов? И использует ли её система для быстрого восстановления?

-

Автоматизация рутинного. Много ли ручной работы (скрипты, ручные восстановления)? Сколько автоматизировано? (Например, восстановление миграции БД, рестарт сервисов).

-

Мониторинг среды vs SLA. Насколько метрики «видят» бизнес? Является ли SLA* живой метрикой (отчет идёт из системы)? Или его собирают «сотрудники ИТ» вручную?

-

Эффект автобуса. Вы можете вспомнить ключевых людей на которых держится сеть, инфра или мониторинг? К чему приведёт их потеря?

-

Обновления и развертывания. Как часто обновляются компоненты информационных систем? Есть ли план тестирования и отката в ходе изменений?

-

Отказоустойчивость слоя контроля. Насколько эта система критична? Защищён ли она от сбоев (клоновые узлы, репликация)?

-

План роста. Что произойдёт, если через год появятся вдвое больше систем/сервисов/хостов? Способна ли архитектура выдержать масштаб без пропорционального роста работы?

Такая проверка выявит слабые места. Лучший сценарий — если на все пункты есть утвердительный ответ, причём модели данных/сервисы актуальны, а инциденты ведутся через общий процесс. Даже несколько «нет» означают, что система в зоне риска и её стоит усилить.

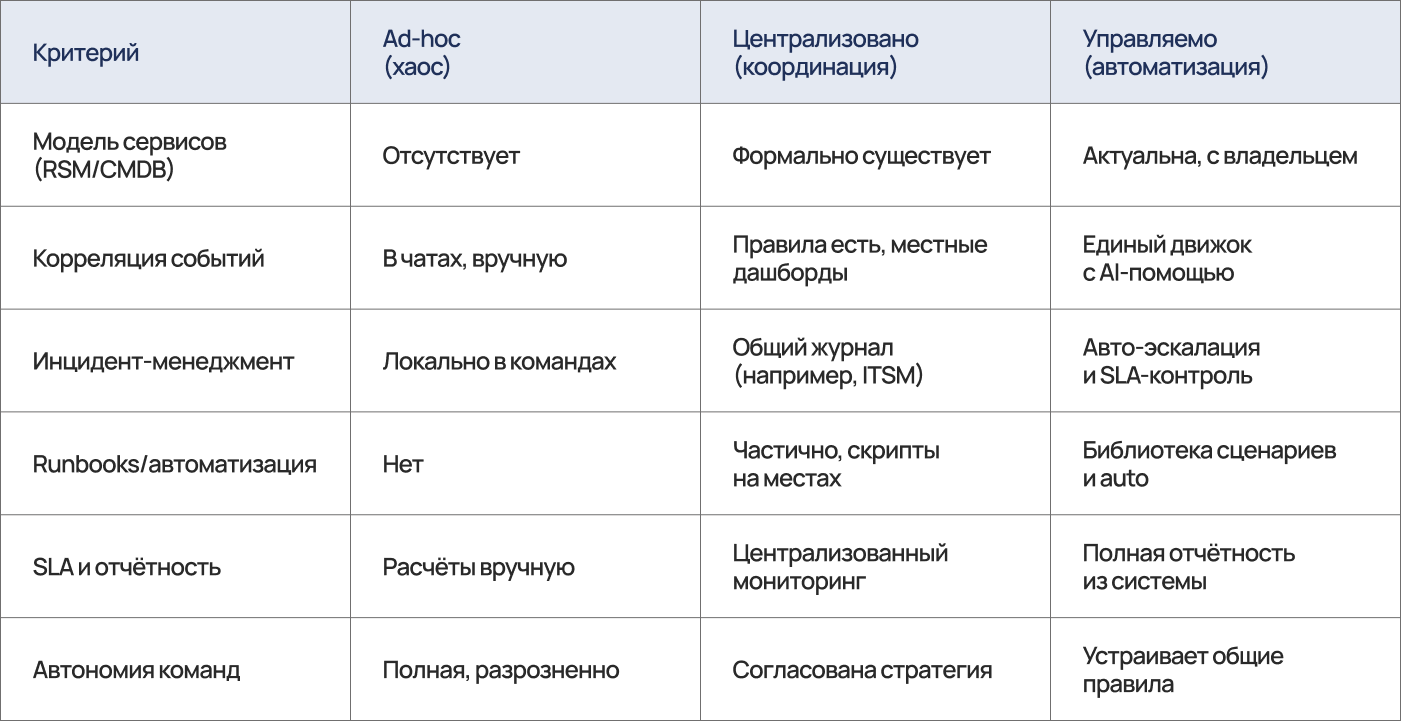

Дополнительно приведём матрицу зрелости (Ad-hoc / Централизовано / Управляемо) для ключевых аспектов. Например:

Заключение

Вопрос больше не в выборе очередной технологии мониторинга. Вопрос в том, есть ли у компании слой управления ИТ-ландшафтом или только набор разрозненных инструментов. Концепция «зонтичного мониторинга» не отвергает DevOps и open-source; наоборот, она интегрирует их в единую систему управления. При этом мониторинга может и должно быть много, но автономность команд не должна превращаться в отсутствие координации. Именно «управляемый слой» связывает разрозненные данные и процессы, снижает риски и переводит мониторинг в управленческую плоскость.

Проведите архитектурную сессию и ответьте на ключевые вопросы из чек-листа, попробуйте посчитать сколько стоит простой ваших наиболее критичных бизнес-сервисов, сколько обходятся бизнесу ваши ежегодные потери на основе реального SLA. Если у вас нет слоя управления ИТ, то попробуйте провести пилот на 2-3 наиболее критичных бизнес сервисах.

План такого пилота может выглядеть так:

Неделя 1 — определить управляемый контур (не «всё сразу»):

Выберите до 5 критичных сервисов (те, где больнее всего простой). Опишите 3–5 базовых SLI на сервис: доступность, latency (p95), error rate, saturation, продуктовые метрики. Зафиксируйте “что считается деградацией” на уровне сервиса.

Неделя 2 — собрать единый поток сигналов и правила инцидентов:

Подключите события/алерты из 2–3 ключевых источников (например, Zabbix + Prometheus/Alertmanager + APM/логи как доказательство). Введите единые правила: когда открываем инцидент, кто владелец, когда эскалируем, где будет вестись протокол и устранение. Настройте дедупликацию/корреляцию “одна проблема — один сигнал”.

Неделя 3 — добавить минимальную связность вместо “идеальной CMDB”:

Постройте MVP ресурсно-сервисной модели: для каждого сервиса укажите 3–5 ключевых ресурсов/зависимостей (DB, очередь, LB, cluster, сеть/ЦОД). Цель недели — влияние: чтобы зонтик мог ответить “какие сервисы реально страдают” и “что вероятная первопричина”.

Неделя 4 — сделать управляемость измеримой и полезной для руководства:

Соберите первый SLA/SLO-отчёт “из системы” по 5 сервисам (с учётом окон работ). Оцифруйте 2 сценария устранения (типовые P1/P2) и привяжите их к инцидентам. Введите метрику покрытия мониторингом: где мониторинг покрывает сервис/ресурс, а где слепые зоны — и превратите это в бэклог улучшений.

Результат 30 дней: один “управляемый контур” (5 сервисов), единые инциденты и эскалации, первая сервисно-ресурсная связность, SLA из системы, два runbook и понятная карта дыр мониторинга — без попытки «перестроить всё ИТ за квартал».

После плана пилота важно заранее зафиксировать критерии успеха и метод расчёта, иначе обсуждение скатится в субъективное “стало лучше/хуже”. Минимальный набор метрик на 30 дней:

-

Noise rate (шум):

Noise = Alerts_total / Signals_total

Цель: снижение noise в 2–5 раз (зависит от исходного хаоса). -

Доля алертов, дошедших до человека:

Human_touch = Alerts_to_oncall / Alerts_total

Цель: значимое снижение за счёт дедупликации/корреляции. -

MTTA (время до реакции):

MTTA = time(first_response) − time(signal_created)

Цель: снижение на 15–30% (особенно в ночных инцидентах). -

MTTR (время восстановления):

MTTR = time(service_restored) − time(signal_created)

Цель: −10…−30% на выбранном классе сервисов. -

Incident quality:

% инцидентов с заполненным impact/owner/service (из CMDB/RSM)

% инцидентов, где создан постмортем/причина указана -

Степень покрытия зонтика:

Coverage = Services_with_RSM / Services_in_scope

Цель: 10–20 ключевых сервисов в пилоте с актуальной моделью.

Правило честности: сравнивать нужно одинаковые типы инцидентов (major/critical) и одинаковый контур (те же команды/сервисы), иначе метрики будут “плясать” от сезонности и параллельных изменений.

Мониторинг в конечном счёте должен стать слоем управления и элементом улучшения операционной эффективности, а не болью поддержки и центром затрат.

Автор: NuGan