Всем привет! Меня зовут Дмитрий, я архитектор продукта и занимаюсь развитием APM-платформы.

Работаю с мониторингом производительности приложений давно и часто сталкиваюсь с одним и тем же вопросом — зачем платить за коммерческие APM-платформы, если есть стек с открытым исходным кодом вроде Prometheus и Grafana?

В статье попробую разобрать это с практической точки зрения: где начинаются реальные сложности, как меняется стоимость владения системой и почему одни команды остаются на open-source, а другие переходят на готовые платформы.

Отправная точка

Многие команды выбирают устойчивый стек из open-source продуктов: Prometheus, Grafana, Loki, Jaeger/Tempo, потому что система наблюдаемости будет выстроена под свои задачи и требования — вплоть до уровня архитектуры и хранения данных.

В то же время, когда речь идёт о мониторинге сложных, распределенных систем и более быстром внедрении, APM-платформы (Application performance monitoring and observability) предлагают другой подход: готовый продукт с уже встроенной корреляцией данных, автоматизацией и минимальной настройкой.

Важно зафиксировать ключевой момент, что на практике мониторинг и наблюдаемость — уже не столько про сбор данных. Метрики, логи и трассировки научились собирать давно и довольно надёжно. Основная сложность возникает, когда нужно связать эти данные между собой и понять влияние на систему и пользователей.

Именно здесь появляется разница между набором инструментов и единой платформой наблюдаемости. Буду сравнивать по четырем ключевым метрикам: функциональные возможности, скорость развертывания, поддержка и адаптация к изменениям.

1. Контекст данных: единая система против набора инструментов

Ключевое различие между APM и набором open-source инструментов кроется в архитектуре данных. APM-решения изначально построены на концепции унифицированной наблюдаемости — единой платформы, где трассировки, метрики и логи существуют в общем контексте.

В чем это проявляется на практике?

Когда в продакшене падает микросервис, инженеру с APM не нужно открывать три разных вкладки: Grafana для графиков контейнеров, Jaeger для поиска трейсов и Kibana для чтения логов. Платформа автоматически коррелирует эти данные. То есть мы видим не всплеск задержки на дашборде, а конкретный трейс неудачного запроса и строчка лога с exception прямо в карточке этого трейса.

Дополнительно алгоритмы анализа сокращают объём ручного поиска и быстрее локализуют первопричину. Это не замена инженера, а уменьшение количества ручной корреляции данных.

С открытым стеком (например, Prometheus + Grafana + Loki + Tempo) такая связка возможна, но требует серьёзных усилий по настройке. Нужно вручную настраивать проброс trace_id во все компоненты логирования, следить за совместимостью версий и писать специфические запросы PromQL/LogQL.

Связность данных в этом случае становится отдельной инженерной задачей. А что делать с вендорскими продуктами, легаси системами? Как тут подключить и забрать Prometheus? Как внедрить trace id без доступа к коду?

Как это выглядит на инцидентах

Давайте посмотрим на классический путь разбора инцидентов при использовании open-source решений и APM.

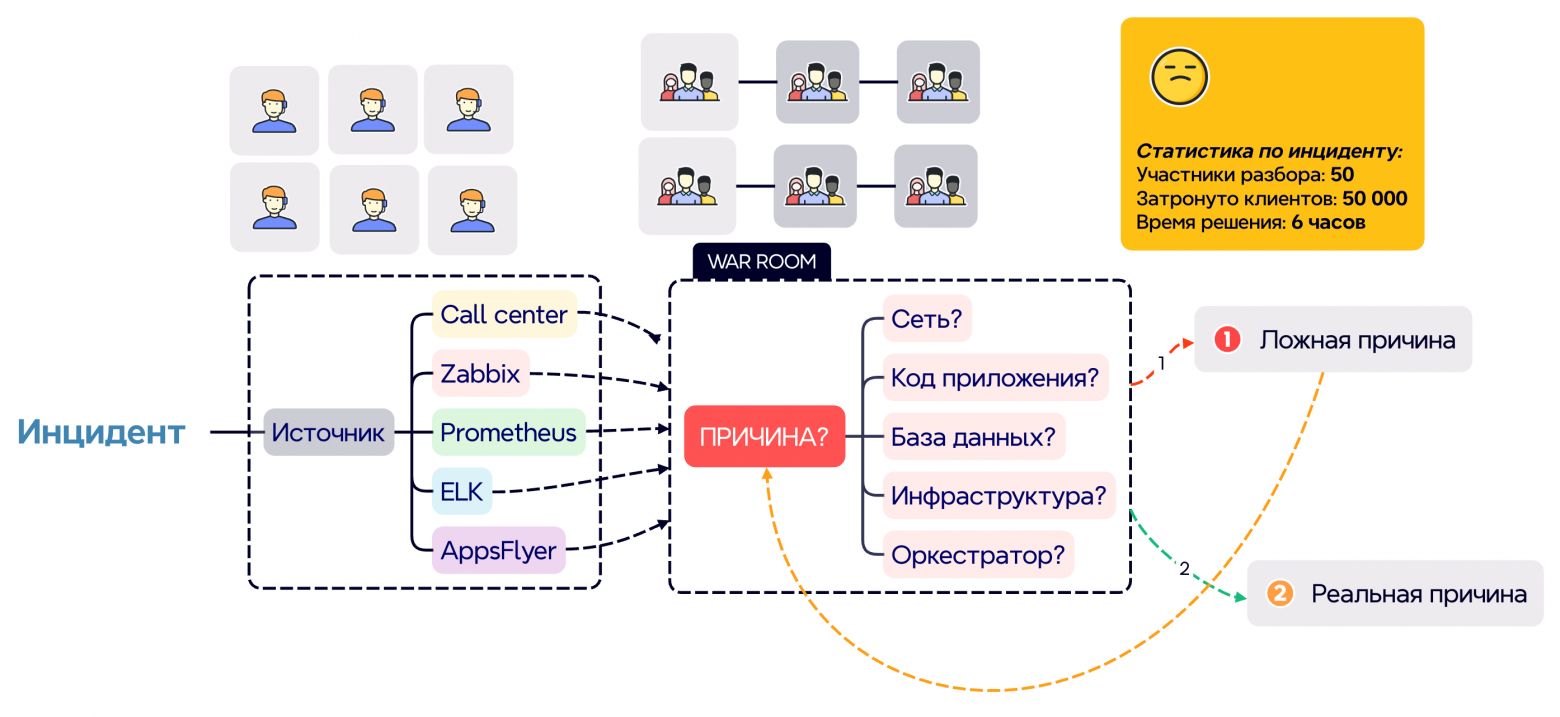

Старт инцидента: с open-source у нас множество источников информации, есть настроенные на какой-то порог триггеры, но невозможно предусмотреть все варианты. И триггером тогда может стать обращение пользователей напрямую в колл-центр. То есть на входе мы имеем инцидент, который уже задел клиентов.

Далее долгий изнуряющий путь через war room, где обсуждаются разные гипотезы. Инфраструктура, сеть, база данных, код приложения и внешние зависимости могут давать похожие симптомы. В результате сетевики, разработчики, девопсы, инфраструктурщики, безопасники анализируют только свою часть телеметрии, а восстановление полной картины требует ручной корреляции данных между несколькими системами.

Последовательная проверка гипотез и переключение между инструментами иногда приводит к ситуации, когда устраняются последствия, а не первопричина. При этом инцидент только набирает свои обороты. Конечно, через какое-то время корневая причина будет найдена. Но для этого потребуется условно 50 сотрудников, за время инцидента пострадает 50 000 клиентов, опять же условных, и на решение проблемы уйдет примерно 6 часов.

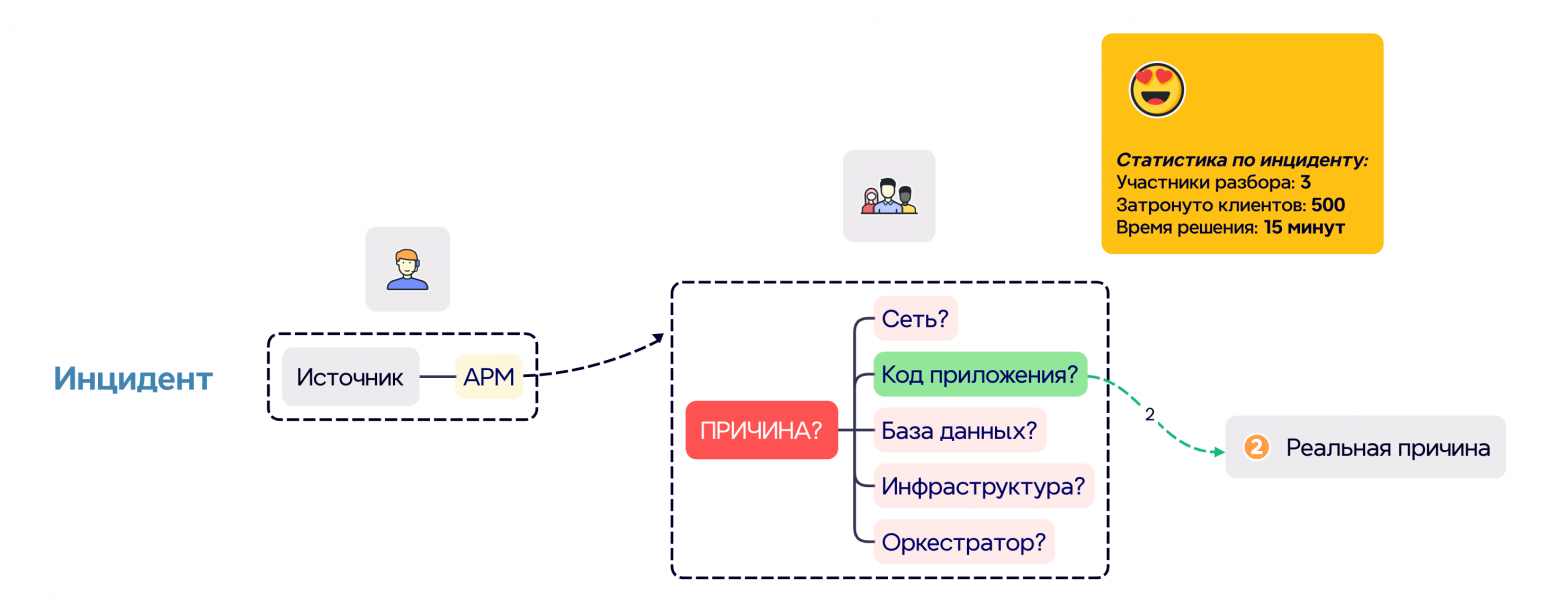

А теперь давайте посмотрим, как меняется жизненный путь инцидента, когда используется платформа APM и наблюдаемости с ИИ-анализом сбоев.

У нас изначально есть единый источник информации – APM-система, в которой уже собраны данные по работе инфраструктуры, коду приложений, пользовательскому опыту, логи, метрики систем, баз данных, сетевого оборудования. Все данные обрабатываются централизованно и на их основе создаются базовые линии, отклонение от них будет сигналом к возникновению проблемы. А затем подключается искусственный интеллект, который делает анализ влияния данного инцидента и, главное, ищет первопричину. То есть уже есть детальное описание деградации, её влияние на информационные системы и бизнес-процессы, а также корневая причина происходящего.

При этом не требуется сбор сотрудников с лозунгом «горит!» для совместного разбора. Исправлять ситуацию будут только ответственные.

Мне понравилась фраза от одного из заказчиков, отражающая всю суть платформ APM в части разбора инцидентов: «APM как честный и независимый арбитр».

Ну, и давайте посмотрим на условные цифры статистики по инциденту – в разборе участвовало 5 сотрудников, затронуто 500 клиентов, время решения – 15 минут. Массовый сбой предотвращен.

2. Скорость развертывания: часы против недель

Здесь разрыв наиболее очевиден. Установка open-source — это инженерная задача, которая может затянуться на спринт или даже месяц, особенно в условиях строгих compliance-требований.

Для разворачивания APM нужно установить один агент на хост или подключить библиотеку в приложение. Современные платформы предлагают zero-touch instrumentation — технологию, которая автоматически обнаруживает сервисы, базы данных и очереди, начиная собирать данные без правок конфигурационных файлов вручную. В течение нескольких часов после подключения вы получите полноценную карту сервисов и дашборды.

Чтобы запустить open-source, нужно развернуть кластер Kubernetes для Prometheus, настроить Alertmanager, поднять Grafana, настроить хранилище для логов (Elasticsearch или Loki), разобраться с операторами для управления всем этим хозяйством. Затем прописать аннотации для сбора метрик в каждом pod’е, настроить сервис-дискавери и только потом начать строить дашборды. Все эти действия резко увеличивают операционную деятельность.

При этом если у зрелой команды уже есть Helm/Terraform — они развернут быстрее, но до скорости запуска APM ещё очень далеко.

На самом деле, скорость внедрения — это не только вопрос удобства. Это ещё и время до получения полезных данных, количество инженерных часов и стоимость поддержки изменений.

3. Время на актуализацию: скрытая цена поддержки

Сторонники open-source часто апеллируют к экономии на лицензиях, забывая о TCO (Total Cost of Ownership). Поддерживать собственный мониторинг в актуальном состоянии — это постоянная работа.

Отдельный аспект, который часто недооценивается при выборе open-source подхода, в том, что меняется роль самой команды. На практике, собирая стек из Prometheus, Grafana, логирования и трассировок, компания начинает не просто использовать инструменты, а фактически развивать собственный продукт мониторинга внутри себя.

Это означает:

-

необходимость проектировать архитектуру мониторинга

-

поддерживать совместимость компонентов

-

развивать функциональность

-

обеспечивать надежность и масштабируемость.

По сути, команда берет на себя роль вендора. И нужно собирать и формировать команду прямо под весь стек open-source, в итоге штат дорогих специалистов «пухнет».

При этом у такого «внутреннего продукта» появляются все классические проблемы:

-

отсутствие единого roadmap

-

зависимость от конкретных инженеров

-

накопление технического долга

-

сложность масштабирования

-

вопросы уязвимости и безопасности.

Именно здесь начинается главный инженерный компромисс.

Проблема обновлений. Выход новой мажорной версии Kubernetes или миграция с Ingress на Gateway API могут сломать самописные экспортеры Prometheus. Нужно следить за changelog’ами десятков утилит (kube-state-metrics, node-exporter, promtail), своевременно обновлять Helm-чарты и тестировать совместимость на staging-окружении. Это время, которое senior-инженеры тратят не на разработку продукта, а на обслуживание инфраструктурной «сантехники».

Мы со стороны вендора видим, как APM снимает этот груз. Так как берём на себя ответственность за совместимость агентов с новыми версиями языков программирования и фреймворков. Обновление библиотеки-агента и серверной части APM происходит автоматически – нужно только закачать новое обновление и спокойно наблюдать за процессом.

Готовую платформу мониторинга администрируют 2 человека. Вот поэтому с APM модель принципиально иная — команда может сосредоточиться на развитии своего основного продукта, так как использует мониторинг, в котором архитектурные решения уже приняты и развитием функциональности занимается вендор.

4. Адаптация под изменения: маневренность против жесткости

Бизнес требует скорости. Допустим, команда решила переписать монолит на микросервисы или добавить новый язык программирования (например, перейти с Python на Go для высоконагруженных участков).

В open-source это означает новый виток настройки:

-

поиск и настройка экспортера для Go

-

актуализация конфигурации трассировщика (Jaeger/Zipkin)

-

унификация сбора логов в новом формате.

Если команды разных сервисов используют разные подходы к логированию и тегированию метрик, получается сборка технологий, где каждый смотрит только в свой угол.

APM работает в рамках уже заданной модели. Платформа поддерживает десятки языков и фреймворков «из коробки». Смена стека сведется к подключению нового агента, который автоматически начнет отправлять данные в ту же самую платформу. Service Map перестроится автоматически, показывая новые связи. Не нужно переучивать команду работе с новыми инструментами — интерфейс и принцип поиска ошибок остаются неизменными.

Более того, APM-решения позволяют внедрять практики Policy as Code для мониторинга. Можно описать SLO (Service Level Objectives) и система сама будет следить за их соблюдением при любых изменениях инфраструктуры.

Цена разных подходов

По мере развития системы вопросы внедрения постепенно отходят на второй план, а на первый выходит стоимость владения и поддержки.

Стоимость APM-платформ — это прямые и понятные затраты «здесь и сейчас». С открытым исходным кодом расходы распределены по времени и менее очевидны, например, зарплата высококвалифицированных специалистов, время на внедрение, поддержку и последующую адаптацию. При этом эффект от использования APM заметен на этапе диагностики инцидентов — сокращается время на поиск причин, а значит и восстановление системы ускоряется.

Конечно, с готовыми платформами есть риск привязки к поставщику. Однако в обмен компания получает экспертизу, техническую поддержку, регулярные обновления и своевременное закрытие уязвимостей — всё то, что в open-source полностью ложится на команду внутри (это и расписал в пункте 2).

Сложность освоения также присутствует в обоих подходах. Однако APM-платформы обычно предлагают единый интерфейс и стандартизированные сценарии диагностики, снижающие порог входа.

Так «бесплатность» open-source оказывается условной: компания инвестирует значительные ресурсы в построение и обслуживание собственных решений без внешней поддержки и гарантированного уровня сервиса.

Если обобщить различия, картина становится более наглядной.

APM помогает выявлять деградацию и предупреждает о сбое до того, как они повлияют на пользователей, тогда как open-source чаще фиксирует факт — красный график после поломки. И нет необходимости администрировать большое количество компонентов (Prometheus, системы хранения, визуализации и логирования) — команда может сосредоточиться на бизнес-задачах.

Путь от упавшей бизнес-транзакции к конкретным строкам кода или SQL-запроса в APM, как правило, занимает несколько минут за счет встроенной корреляции данных. В open-source потребуются дополнительные настройки и поддержка связей между несколькими системами. Дополнительно становится прозрачной связка между бизнес-процессами и технической реализацией: от деградации SLO можно перейти к конкретному трейсу и первопричине в рамках одного интерфейса.

Open source и APM — это не выбор между «правильным» и «неправильным» решением, а два разных инженерных подхода к наблюдаемости.

В первом случае компания получает полный контроль над системой и возможность настраивать её под свои задачи, но берёт на себя развитие системы как внутреннего продукта — со всеми затратами на поддержку, совместимость и эволюцию.

Во втором — использует готовую платформу, где большая часть задач уже решена: от корреляции данных до обновлений и поддержки.

По мере усложнения инфраструктуры основная стоимость начинает смещаться в сторону работы с данными — их связывания, интерпретации и поиска причин. И чем больше компонентов участвует в системе, тем дороже обходится ручная корреляция между ними.

В итоге разница между подходами сводится к тому, кто отвечает за систему наблюдаемости. В open-source эта зона ответственности полностью остаётся внутри команды — от архитектуры до эксплуатации. С готовой системой APM часть этой ответственности переносится на зрелый продукт и его поставщика.

Автор: AmidN