Машинный перевод – это одно из самых удивительных достижений ИИ. Под этим термином понимают автоматический перевод текста с одного языка на другой с помощью компьютерных алгоритмов. Несколько десятилетий назад сама идея о том, что компьютер или программа может переводить тексты с одного языка на другой, казалась настоящей фантастикой.

Меня зовут Алексей Рудак, я основатель компании Lingvanex, которая уже почти 10 лет создает решения в области машинного перевода (МП). Я захотел написать большую обзорную статью о том, как развивалась технология МП, а также поговорить о том, какие идеи и подходы определяют развитие этой области сегодня. Мы также рассмотрим ключевые исследования 2024-2026, чтобы понять, в каком направлении движется современный машинный перевод.

СОДЕРЖАНИЕ

– Философские и лингвистические предпосылки машинного перевода

– Первые шаги в истории машинного перевода

– Перевод, основанный на правилах и Джорджтаунский эксперимент

– Статистический машинный перевод

– Гибридный машинный перевод

– Нейронный машинный перевод

– Большие языковые модели (LLM)

– LLM и NMT

– Общая характеристика в контексте перевода

– Преимущества и ограничения

– Галлюцинации LLM в переводе: почему это происходит

– Сравнение LLM и NMT

– Метамодель перевода: LLM как инструмент самооценки

– Метрики качества машинного перевода

– Классические метрики

– MQM (Multidimensional Quality Metrics): человеко-ориентированный стандарт оценки

– Нейронные метрики

– WMT 2025: новые ориентиры для оценки качества перевода

– Основные направления WMT

– Чего ожидать от WMT

– Практические значение для B2B

– Современные тенденции и технологии в машинном переводе 2025-2026

– Large Reasoning Models (LRMs) как новый этап развития машинного перевода

– Глубокий многоязычный перевод с использованием LRM и RL

– Мультимодальный машинный перевод текста и изображений с многозадачным RL

– Потоковый on-device перевод речи с модулем read/write

– Агентный машинный перевод с обучением с подкреплением и внешними знаниями

– Эффективное создание корпусов MT с использованием LLM и human-in-the-loop

– Адаптация и оптимизация моделей машинного перевода под предметные ниши

– Fine-tuning моделей машинного перевода под предметные ниши

– Instruction-tuning LLM для машинного перевода в медицинском домене

– Особенности тренировки и дообучения моделей в доменных задачах

– Inference-стратегии в доменно-ориентированном машинном переводе

– Общие выводы

– Источники и материалы

Философские и лингвистические предпосылки машинного перевода

Одним из первых мыслителей, заложивших фундамент для формального описания языка и мышления, был Аристотель. В его трудах по логике была разработана система категорий и силлогизмов, представляющих рассуждение как последовательность формальных операций. Хотя Аристотель не ставил задачу перевода между языками, его представление о мышлении как структуре, поддающейся формализации, стало концептуальной основой для идеи автоматической обработки языка. В дальнейшем именно эта линия – представление языка как системы правил и отношений была унаследована логикой, математикой и, в конечном итоге, вычислительной лингвистикой.

В поздней античности и средневековье философы и лингвисты продолжали развивать идеи формальной логики и грамматики. Цицерон и Квинтилиан обсуждали вопросы точности перевода с греческого на латинский, подчёркивая важность сохранения смысла и стиля. В средние века работы святого Иеронима по переводу Библии (Вульгата) демонстрировали, что перевод – это не простая замена слов, а процесс передачи культурного и религиозного смысла.

В эпоху Ренессанса международная торговля и возрождение античной культуры стимулировали развитие практики перевода и первых методик обучения переводчиков. Эразм Роттердамский был выдающимся гуманистом‑филологом Ренессанса. Он много работал с языком, редактировал тексты, переводил с греческого на латынь и был сторонником изучения оригинальных языков. Он верил в необходимость глубокого понимания текста, а не буквального следования за традиционными (схоластическими) переводами. Он подготовил издание Нового Завета, стремясь приблизиться к исходному смыслу греческих текстов, а не к устоявшейся латинской Вульгате, что отражает подход к переводу как к осмысленному исследованию источника.

В это же время начинают формироваться идеи универсальных грамматик. Джон Уилкинс и другие философы пытались создать классификации понятий и символов, пригодных для универсального языка. Наиболее известным трудом Джона Уилкинса является трактат «Опыт о подлинной символике и философском языке», опубликованный в 1668 году. В нём Уилкинс предлагал концепцию универсального языка для учёных и философов, который должен был заменить латынь, которая широко использовалась в научной среде того времени. Этот проект считается одним из самых амбициозных ранних экспериментов по созданию плановых языков. В рамках работы Уилкинс разработал первичный вариант языка, который включал систему письма, словарь, грамматику и фонетику.

В XVII веке философы и математики, такие как Готфрид Вильгельм Лейбниц, развивали идеи формализации знания и универсальных языков. Лейбниц разрабатывал концепцию универсального символического языка, предназначенного для систематизации знаний и упрощения межъязыкового и междисциплинарного общения. Эти идеи послужили теоретической основой для логического анализа текста и дальнейших вычислительных моделей языка.

В XVIII–XIX веках значительный вклад в понимание природы перевода внёс Вильгельм фон Гумбольдт. Он рассматривал язык не как статичный набор слов и правил, а как динамический процесс посредством которого формируется мышление. Согласно Гумбольдту, каждый язык отражает уникальную картину мира, и потому перевод не может быть сведён к механической подстановке эквивалентов. Эта идея стала ключевой для дальнейших дискуссий о принципиальных ограничениях машинного перевода и обозначила современные проблемы передачи смысла, прагматики и культурного контекста в автоматических системах.

В начале XX века Фердинанд де Соссюр заложил основы структурной лингвистики. Он рассматривад язык как систему знаков, состоящих из означающего (формы слова) и означаемого (смыслового содержания). Де Соссюр считал, что значение слова определяется отношениями внутри языковой системы, а не внешними связями с предметным миром. Он ввёл ключевые понятия: синхрония и диахрония, различие между языком и речью, что позволило видеть язык как системно организованное явление. Эти идеи стали теоретической основой для формализации языка и алгоритмического анализа текста, так как предложили системный способ представления лексики, грамматики и структуры предложений.

Работы Соссюра оказали влияние на дальнейшее развитие компьютерной лингвистики и автоматического перевода. Его теория подчеркивала необходимость учитывать взаимосвязь элементов языка при построении моделей, а не просто использовать прямое соответствие слов. В России аналогичные идеи развивал Лев Щерба, который занимался формализацией морфологии и лексики и создавал словари для автоматизированной обработки языка. В 1930-1940-х годах эти концепции нашли применение в ранних экспериментах с машинным переводом. Работы Алана Тьюринга, Готтфрида фон Сталька, Юрия Марчука и Льва Щербы демонстрировали, как структурный анализ и вычислительные методы могут использоваться для перевода между языками.

Первые шаги в истории машинного перевода

Идеи автоматизации перевода возникли еще в XVII веке, но первые реальные попытки появились лишь в XX веке. В 1930-х француз Жорж Артсруни и русский инженер Пётр Смирнов-Троянский создали первые механические переводческие устройства, где процесс делился на три этапа: предредактирование, автоматический перевод и постредактирование.

С появлением компьютеров в 1940-х годах возможности резко расширились. Алан Тьюринг предложил концепцию универсальной вычислительной машины – машины Тьюринга, которая могла бы выполнять любые алгоритмические операции, включая обработку текста. Хотя машина Тьюринга изначально создавалась для криптоанализа, её принципы положили фундамент для автоматизации перевода, показывая, что язык можно формализовать и разложить на последовательность вычислимых шагов. Одновременно Эдвард Дуглас Бут и Уоррен Уивер предложили использовать вычислительные машины для перевода, а в 1948 году Роберт Риченс разработал систему, способную выполнять не только перевод слов, но и синтаксический анализ, что стало важным шагом к учёту контекста и структуры языка.

В 1950–1960-х годах Иегошуа Бар-Хиллел ввёл термин FAHQT (Fully Automatic High-Quality Translation), но при этом придерживался мнения, что полностью автоматический перевод без участия человека – это что-то на грани фантастики. В 1966 году консультативный совет ALPAC (Automatic Language Processing Advisory Committee) согласился с этим выводом, что без участия профессионального переводчика или лингвиста невозможно добиться высокого качества перевода, которое можно сопоставить с человеческим.

Перевод, основанный на правилах и Джорджтаунский эксперимент

В 1950-х годах основным направлением развития машинного перевода стал подход, основанный на правилах (Rule-Based Machine Translation, RBMT). Суть заключалась в том, что процесс перевода можно описать с помощью формальных грамматических и лексических правил, которые описывают структуру исходного и целевого языков.

Первым успешным экспериментом этого подхода стал Джорджтаунский эксперимент (7 января 1954), проведённый Джорджтаунским университетом совместно с IBM. Система перевела более 60 предложений с русского на английский, используя всего 6 грамматических правил и словарь из 250 слов. Несмотря на простой подход, демонстрация доказала, что машинный перевод, все-таки, возможен.

Эксперимент вызвал огромный интерес и стал толчком к созданию первых систем MARK и GAT. Но уже к концу 1960-х стало ясно, что что создание наборов правил для каждого языка требует колоссальных ресурсов, а качество перевода, по-прежнему, остается низким.

Статистический машинный перевод

Идея рассмотреть перевод как процесс декодирования зародилась ещё в середине XX века. Уоррен Уивер в 1947 году написал: «Когда я смотрю на статью на русском языке, я говорю себе, что это на самом деле английский, просто записанный странными символами. Теперь я попытаюсь его декодировать».

Так появился статистический машинный перевод (Statistical Machine Translation, SMT) – система, основанная на анализе больших параллельных корпусах. Модель выбирает наиболее вероятный вариант перевода, опираясь на статистические закономерности между словами и структурами языков.

Прорывом стали IBM Models 1-5 и система Moses, ставшая стандартом для исследовательского сообщества. Однако такие системы плохо учитывали контекст, теряли смысл в длинных предложениях и требовали огромных объемов данных.

Гибридный машинный перевод

Когда стало ясно, что ни правила, ни статистика по отдельности не обеспечивают высокого качества перевода, появился гибридный машинный перевод (Hybrid Machine Translation, HMT), объединяющий сильные стороны обоих подходов. Такие системы сочетали грамматическую точность RBMT и адаптивность SMT: правила использовались для синтаксического анализа, а статистические модели для выбора наиболее вероятного перевода.

Гибридные решения действительно повысили лексическую согласованность, но оставались сложными в реализации и требовали значительных усилий. Уже в более поздних исследованиях, например, в книге Ханнеса Карльбома “Hybrid Machine Translation” (2016), рассматриваются современные варианты гибридных систем. В одном из экспериментов применение классификатора SVM (Support Vector Machine) позволило повысить качество перевода на 6,1 % по метрике BLEU.

Нейронный машинный перевод

Появление нейронного машинного перевода (Neural Machine Translation, NMT) в середине 2010-х стало переломным моментом в развитии всей отрасли машинного перевода. В отличие от предыдущих подходов нейросетевые системы выполняют перевод в рамках единой обучаемой модели, которая учится переводить текст, анализируя миллионы примеров.

Основой NMT стали рекуррентные нейронные сети (RNN), которые позволяли учитывать контекст предложения при переводе. Вскоре им на смену пришли архитектуры с механизмом внимания (attention), а затем трансформеры (Transformer). Именно трансформеры обеспечили резкий рост качества перевода за счет способности эффективно моделировать долгосрочные зависимости в тексте и параллельно обрабатывать большие объемы данных.

Развитие нейросетевого перевода стало основой для появления больших языковых моделей (Large Language Models, LLM), например, широко используемых сегодня GPT, LLaMA, Gemini, Claude и др. LLM фактически объединили машинный перевод с универсальным пониманием языка и расширили его возможности далеко за пределы классического перевода.

Большие языковые модели (LLM)

Вот мы и добрались до самых передовых технологий машинного перевода.

Появление LLM стало следующим этапом эволюции машинного перевода после нейронных систем. Эти модели создаются по парадигме foundation models – универсальных базовых архитектур, которые обучаются на огромных объемах текстов и являются основой для решения самых разных задач, от перевода до анализа текста и диалога.

Сначала выполняется масштабное предобучение (pre-training) на многоязычных корпусах, потом тонкая настройка (fine-tuning) и выравнивание поведения модели с человеческими ожиданиями (alignment). Дополнительно могут использоваться методы prompting – управления моделью через специальные текстовые подсказки, которые позволяют направлять ее поведение без дополнительного обучения.

Одним из ключевых преимуществ LLM является гибкость обучения и дообучения. Модель можно адаптировать под конкретные языковые пары, домены или задачи, используя сравнительно небольшие специализированные корпуса. Это снижает уровень ошибок и галлюцинаций и повышает точность перевода в специфических сценариях. Для борьбы с артефактами перевода (неестественные или ошибочные элементы) применяются методы вроде self-healing, когда модель самостоятельно исправляет свои предыдущие предсказания, повышая согласованность и корректность текста.

LLM и NMT

Хотелось бы подробнее поговорить о такие современных подходах к перевода, как LLM и NMT.

Общая характеристика в контексте перевода

Классические нейронные системы перевода (NMT) строятся вокруг архитектуры encoder-decoder и оптимизированы под точный, стабильный и терминологически согласованный перевод. Они переводят текст как последовательность токенов и стремятся воспроизвести максимально эквивалентное предложение на другом языке. Такие модели отлично работают в доменах, где важны форматы, шаблоны и строгие правила, например, в финансовых или юридических документах.

LLM, напротив, обучаются на колоссальных корпусах общего языка и не ограничены параллельными данными. Они не просто подбирают соответствия между словами, а строят вероятностные гипотезы на уровне смысла и контекста. Благодаря этому такие модели способны “придумывать” фразы и слова, которых не было в исходном предложении, понимать интонацию, стиль и даже культурные особенности текста.

Преимущества и ограничения

NMT

Преимущества

-

Предсказуемость и воспроизводимость (одинаковый ввод → одинаковый вывод).

-

Высокая скорость и низкая стоимость на больших потоках.

-

Строгий контроль терминологии и форматов (глоссарии, правила).

-

Простая валидация/аудит, удобна для регуляторных доменов.

Ограничения

-

Хуже удерживает контекст и прагматику.

-

Буквализмы и шаблонный стиля.

-

Слабая адаптация к новым доменам без дополнительного обучения.

LLM

Преимущества

-

Сильное понимание контекста (связный текст на уровне абзаца/документа).

-

Гибкая стилизация под аудиторию/тон, “нативное” звучание.

-

Умение переформулировать, пояснять, заполнять пробелы.

Ограничения

-

Риск галлюцинаций модели.

-

Вариативность ответа.

-

Высокие вычислительные затраты и время отклика при генерации.

-

Сложнее жестко зафиксировать терминологию и формальные требования.

Галлюцинации LLM в переводе: почему это происходит

Среди всех ограничений LLM, галлюцинации – это самая большая проблема, особенно при переводе. Поэтому устойчивость модели к галлюцинациям становится ключевым фактором ее надежности и точности.

Но почему это всё-таки происходит?

Исследование “A Survey on Hallucination in Large Language Models” (2024) показывает, что склонность к галлюцинациям заложена в самой архитектуре обучения LLM. На этапе предобучения модель оптимизируется под предсказание следующего слова, а не под подлинность фактов, то есть она учится звучать правдоподобно, а не быть точной. При дообучении с человеческой обратной связью (Reinforcement Learning from Human Feedback) добавляется эффект “sycophancy” – стремление угодить пользователю, даже ценой искажения данных.

Авторы выделяют два главных типа галлюцинаций: фактические (factual) – модель искажает или выдумывает факты, и смысловые (faithfulness) – модель нарушает смысл исходного контекста. В переводе чаще встречается именно второй тип галлюцинаций, когда модель создает грамматически точный и качественный, но семантически неправильный текст, особенно в длинных документах и юридических формулировках.

Современные подходы к борьбе с галлюцинациями включают retrieval-augmented generation – добавление проверяемых источников, и faithfulness decoding – методы, при которых LLM оценивает собственную уверенность и отказывается от “сомнительных” продолжений. Это направление становится ключевым для корпоративных систем перевода, где достоверность текста важнее, чем стилистическая привлекательность.

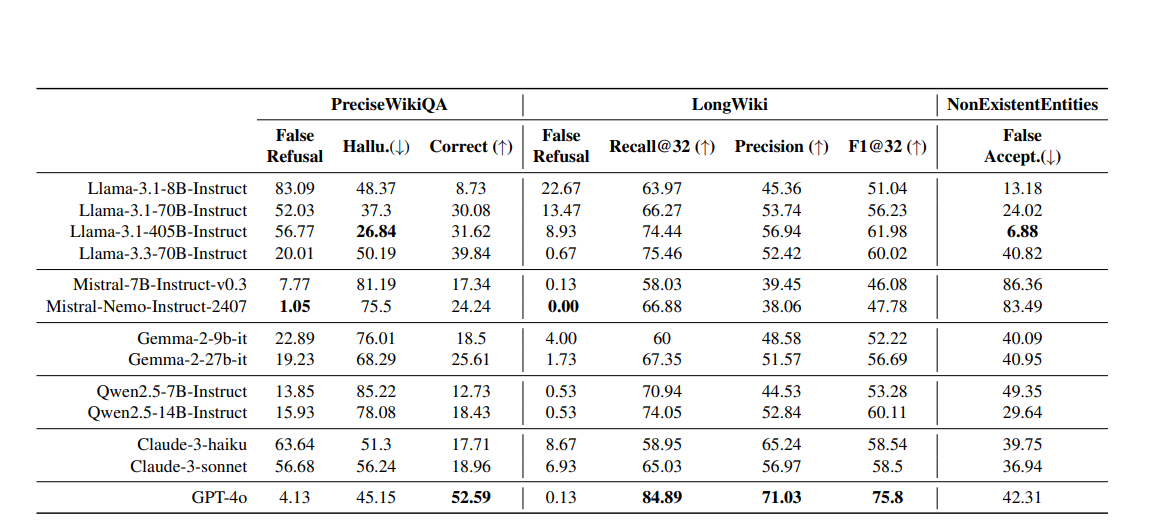

Отдельного внимания заслуживает исследование “HalluLens: LLM Hallucination Benchmark (2025)”, предложившее количественную систему оценки галлюцинаций. В отличие от тестов на достоверность, HalluLens фокусируется на согласованности ответов с доступными модели знаниями и контекстом, разделяя два сценария: intrinsic (искажение исходного контекста) и extrinsic (выдумки вне обученных данных). Для коротких ответов используется оценочная задача PreciseWikiQA, где фиксируется доля ложных отказов (False Refusal Rate, когда модель “боится” отвечать) и уверенных выдумок (Hallucination Rate, когда отвечает неправильно, но уверенно).

У GPT-4o этот показатель составил около 45%, у Llama-3.1 405B – 27%, а у Qwen 2.5 7B превышал 80%. Для длинных ответов применяется LongWiki, где по аналогии с задачами саммари измеряются Precision, Recall@K и F1@K (у Llama-3.1 405B – 61.9 F1@32). И наконец, задача NonExistentRefusal проверяет, умеет ли модель отказываться говорить о несуществующих объектах – тут Llama-3.1 показала минимальный False Acceptance Rate. Эти метрики впервые позволяют измерять не достоверность ответов модели, а способность модели останавливаться, когда она не уверена в своем ответе. Именно этого часто не хватает корпоративным системам перевода (см.табл. 1).

Новое исследование “Why Language Models Hallucinate” (2025) объясняет феномен галлюцинаций не как “глюк генерации”, а как математическое следствие самого процесса обучения. Даже при идеальных данных и безошибочном корпусе языковая модель вынуждена совершать ошибки – просто потому, что оптимизируется под правдоподобие, а не под истину.

Авторы показывают, что вероятность появления галлюцинаций связана с так называемым singleton rate – долей фактов, встречающихся в обучающих данных только один раз. В контексте перевода эффект singleton rate проявляется особенно заметно – редкие термины, юридические обороты или имена собственные часто встречаются в корпусе только по одному разу, и модель начинает “придумывать”, заменяя точность на якобы достоверность. На этапе RLHF это поведение закрепляется: система получает награду за уверенные ответы и штраф за честное “не знаю”. В итоге LLM привыкает не признавать неопределенность, а уверенно придумывать, поэтому и появляются “уверенные, но ложные” переводы, особенно заметные в специализированных доменах.

Выход – это переосмысление самих систем оценки. Ввод так называемых confidence targets (“ответь только, если уверен более чем на 0.8”) позволяет снизить частоту галлюцинаций, не теряя выразительности текста. В контексте перевода такие подходы могут стать новой нормой, так как LLM перестанут стремиться к красивому предложению любой ценой, и начнут оценивать достоверность собственных формулировок.

Сравнение LLM и NMT

Современные исследования всё чаще рассматривают не конкуренцию, а симбиоз двух подходов. Так, в работе “Choose the Final Translation from NMT and LLM Hypotheses Using MBR Decoding” (2024) предложено объединять NMT и LLM через механизм MBR-декодирования (Minimum Bayes Risk). Модель не просто выбирает “наилучший” вариант перевода, а минимизирует риск, выбирая гипотезу, которая наиболее согласуется с остальными. В эксперименте на паре английский → китайский, такой подход позволил повысить показатель COMET до 0.72 – это выше, чем при использовании отдельных моделей, а главное, получилось стабилизировать качество на разнообразных данных.

Другой вектор интеграции был показан в исследовании “From LLM to NMT: Advancing Low-Resource MT with Claude” (2024). Здесь было выбрано обратное направление интеграции: LLM обучает NMT. Claude используется для генерации синтетических корпусов на языках с низкими ресурсами, после чего данные передаются нейронным системам. Такой подход улучшает качество перевода без необходимости собирать параллельные корпуса, а главное, что LLM переносит на NMT более нативное владение контекстом и стилем. Таким образом, LLM становятся не только конкурентами NMT, но и катализаторами обучения для традиционных систем.

В исследовании “Analysing Translation Artifacts: A Comparative Study of LLMs, NMTs, and Human Translations” (2024) было впервые проанализировано различие между переводами NMT, LLM и человека на лингвистическом уровне. С помощью методов интерпретации нейросетей (Leave-One-Out и Integrated Gradients) исследователи выявили закономерности, по которым можно отличить машинный перевод от оригинала, выполненного человеком. Выяснилось, что NMT-системы более буквальны и структурно предсказуемы, тогда как LLM чаще воспроизводят человеческие паттерны речи, в частности, активнее используют наречия и вспомогательные глаголы, что делает текст естественнее. Однако даже лучшие модели, такие как Gemma и TowerInstruct, хотя и демонстрируют больше сходства с человеческими переводами, всё ещё сохраняют статистически распознаваемые паттерны – их тексты отличаются более предсказуемым синтаксисом и упрощенным стилем, характерным для машинного перевода.

В более поздней работе “Combining the Best of Both Worlds: A Method for Hybrid NMT and LLM Translation” (2025) был предложен еще более практичный сценарий: система автоматически определяет, когда целесообразно обращаться к LLM, а когда достаточно NMT. Это позволило снизить долю обращений к большим моделям на 70% без потери качества, что является важным шагом к энергоэффективным гибридным решениям. Механизм принятия решения основан на вероятностной оценке сложности исходного текста. Если NMT демонстрирует высокую уверенность и хорошую семантическую согласованность, прибегать к LLM не приходится. В случае же повышенной лексической неоднозначности или низкой уверенности модели, подключается LLM, как «второе мнение». Такой подход сохраняет точность на уровне лучших нейронных систем, но при этом значительно сокращает вычислительные затраты.

Главный вывод исследований последних лет заключается в том, что качество перевода перестает измеряться числом n-грамм и смещается в сторону нативности текста. Если в 2023 году основное внимание уделялось точности и контролю метрик, то в 2024 году появились гибридные архитектуры, объединяющие NMT и LLM, а в 2025 году мы видим, как фокус сместился на оценку перевода в контексте документа и естественности языка.

В 2026 году, по всей вероятности, акцент сместится на полностью автономные контуры качества, где перевод, оценка и адаптация происходят без участия человека. На первый план выйдут самообучающиеся системы, способные не только исправлять собственные ошибки, но и учитывать предпочтения конкретных доменов, компаний и даже пользователей. В корпоративной среде это приведёт к переходу от универсальных решений к контекстно-чувствительным системам, где LLM и NMT действуют как взаимно усиливающие компоненты единой интеллектуальной экосистемы перевода.

Метамодель перевода: LLM как инструмент самооценки

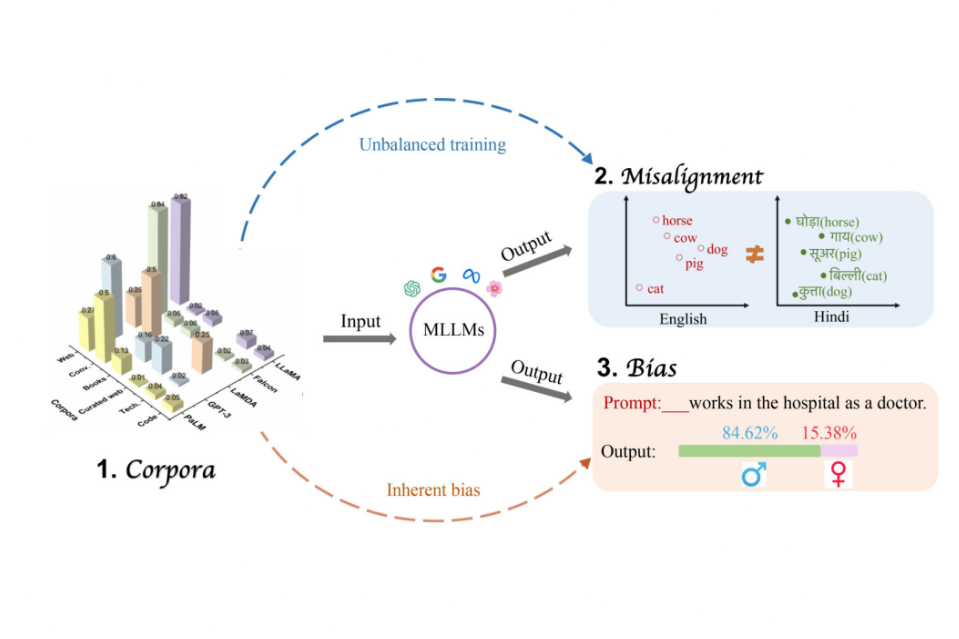

Исследование “A survey on multilingual large language models: corpora, alignment, and bias” (2025), показывает, что современные LLM всё чаще создаются как мультиязычные модели (MLLM), обученные на десятках и сотнях языков. Однако такая универсальность порождает проблемы: дисбаланс обучающих данных снижает качество перевода для редких языков, выравнивание семантических представлений между языками остается нерешенным, а встроенные предвзятости (bias) в данных приводят к воспроизведению культурных и социальных стереотипов. Это делает критически важными методы дебайзинга и оценки справедливости работы моделей (см.рис 2).

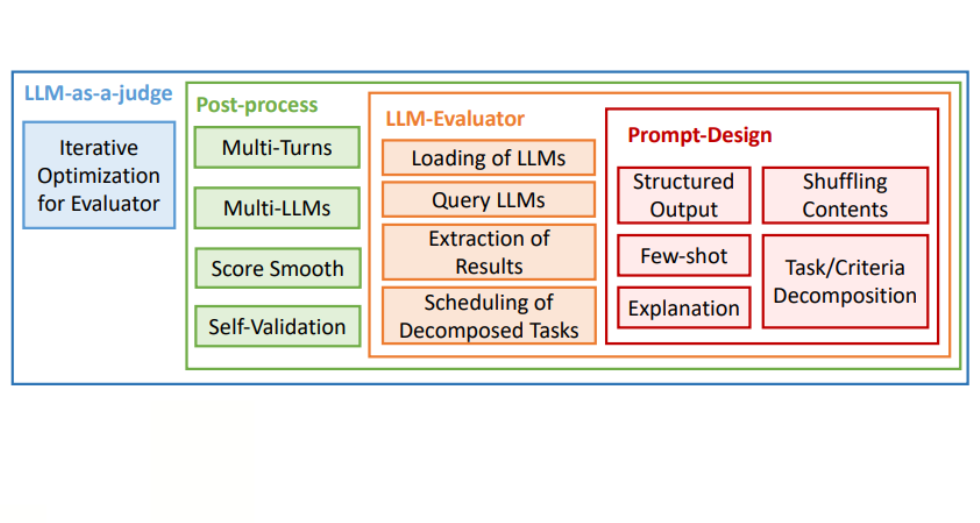

Согласно исследованию “A Survey on LLM-as-a-Judge” (2024), современные LLM всё чаще используются не только для генерации текста, но и для оценки качества перевода – подхода, известного как LLM-as-a-Judge. В этой роли модель выступает как «виртуальный аннотатор», сравнивая машинный перевод с исходным текстом и, при необходимости, с эталонным переводом. Такой подход открывает новые возможности для безреференсной оценки перевода и масштабного мониторинга качества на больших корпусах данных.

Благодаря этому LLM становятся не просто инструментом перевода, а универсальной платформой обработки естественного языка, объединяющей машинный перевод, контекстное понимание текста и мультиязычное представление знаний. Методы fine-tuning, self-healing и multilingual alignment способствуют повышению точности и стабильности таких систем. Однако при всех преимуществах возникает ключевой вопрос – насколько оценки LLM совпадают с человеческими суждениями, и можно ли действительно рассматривать их как надежную альтернативу экспертной аннотации.

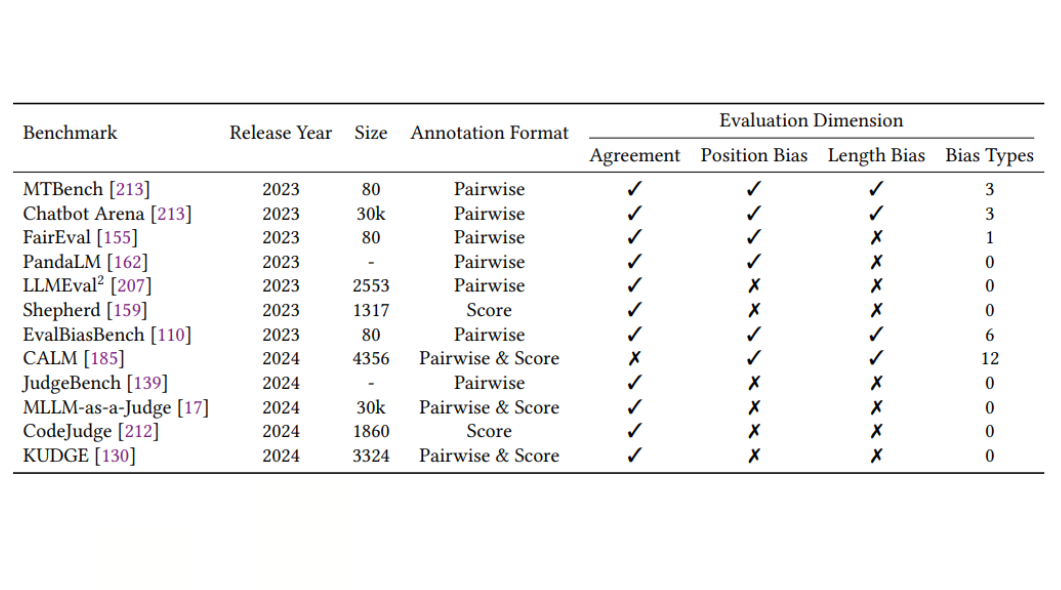

Для измерения этой согласованности применяются метрики совпадения и корреляции, такие как доля совпадений (agreement), коэффициент Каппа Коэна (показывает, насколько оценки модели совпадают с человеческими не случайно, а осознанно) и корреляция Спирмена (оценивает, насколько схоже ранжирование примеров у модели и человека). Они позволяют оценить, может ли модель надёжно заменять человеческую аннотацию. На практике используются специальные бенчмарки, например MTBench, Chatbot Arena, LLMEval² и MLLM-as-a-Judge, которые проверяют согласованность с людьми, устойчивость к различным видам смещений (bias) и стабильность оценок. Эти тесты помогают определить, насколько LLM можно считать объективным и последовательным «судьёй» в задачах машинного перевода и других областях обработки естественного языка (см. табл. 2).

Все это значит, что современные большие языковые модели могут выступать не только в роли переводчика, но и быть мета-системой оценки качества перевода, которая способна анализировать собственные результаты. Это прямой путь к созданию самообучающихся и самокорректирующихся систем перевода, где процесс улучшения качества становится непрерывным и масштабируемым без участия человека.

Но, как подчеркивается в разделе “Rethinking Meta-evaluation” исследования “A Survey on LLM-as-a-Judge”, существующие методы оценки все еще остаются фрагментарными и неполными. Отсутствие единого стандарта метаоценки не позволяет объективно сравнивать модели и гарантировать их надежность. Поэтому исследователи видят ключевую задачу в разработке универсальной системы метаоценки, которая позволит оценивать LLM по таким критериям, как согласованность с человеческими суждениями, устойчивость к смещениям и способность к самооценке (рис.3).

Это станет важным шагом к формированию действительно автономных и прозрачных систем машинного перевода нового поколения.

Метрики качества машинного перевода

Оценка качества машинного перевода – это ключевая задача в NLP, потому что простой подсчет совпадений слов или фраз не всегда отражает настоящее понимание текста и его смысла. Метрики качества помогают сравнивать разные системы перевода по единым критериям, отслеживать прогресс моделей и находить слабые места в алгоритмах.

Классические метрики

Давайте начнем с классических метрик. Среди первых методов оценки качества перевода выделяются BLEU (Bilingual Evaluation Understudy) и TER (Translation Edit Rate).

BLEU измеряет совпадение n-грамм перевода с эталонным текстом, что позволяет быстро сравнивать результаты разных систем, однако эта метрика не учитывает семантическое содержание и стиль текста.

TER оценивает количество изменений, например, вставок, удалений, замен и перестановок, которые необходимы для приведения машинного перевода к эталонному варианту.

Дополнительно используют METEOR, chrF и NIST, которые частично учитывают морфологические особенности и синонимию, улучшая точность оценки по сравнению с BLEU.

Все эти метрики относятся к референсным, то есть они требуют наличия эталонного перевода для сопоставления.

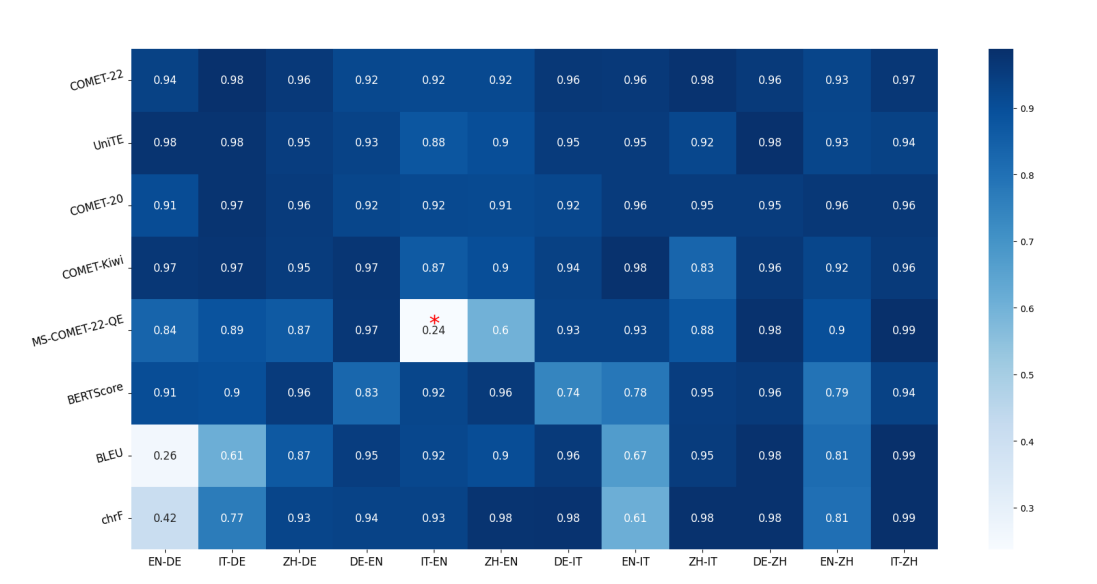

Но, авторы исследования “Evaluating Automatic Metrics with Incremental Machine Translation Systems” (2024) отмечают, что традиционные метрики демонстрируют непоследовательные результаты во времени. При анализе 12 языковых пар и более чем 50 систем перевода за период с 2018 по 2024 год выяснилось, что BLEU и chrF имеют менее устойчивые тенденции роста по сравнению с обучаемыми нейронными метриками.

Для анализа применялась корреляция Спирмена. Данный анализ показал, что COMET-22, UniTE, COMET-20 и COMET-Kiwi сохраняют высокую согласованность с улучшением систем, в то время как BLEU и chrF проявляют колебания, особенно для направлений английский→немецкий и итальянский→английский. Это указывает на то, что поверхностные метрики хуже отражают реальные улучшения качества перевода по мере эволюции систем (рис.4).

MQM (Multidimensional Quality Metrics): человеко-ориентированный стандарт оценки перевода

По мере того как автоматические метрики (BLEU, TER) упирались в пределы сопоставления n-грамм, индустрии понадобился общий, гибкий и сопоставимый язык описания ошибок. Таким языком стал MQM (Multidimensional Quality Metrics), разработанный в проекте EU QTLaunchPad. В отличие от “универсальной” метрики, MQM – это рамка, то есть открытый словарь типов ошибок и правила их взвешивания, применимые как к человеческому, так и к машинному переводу и даже к исходным текстам.

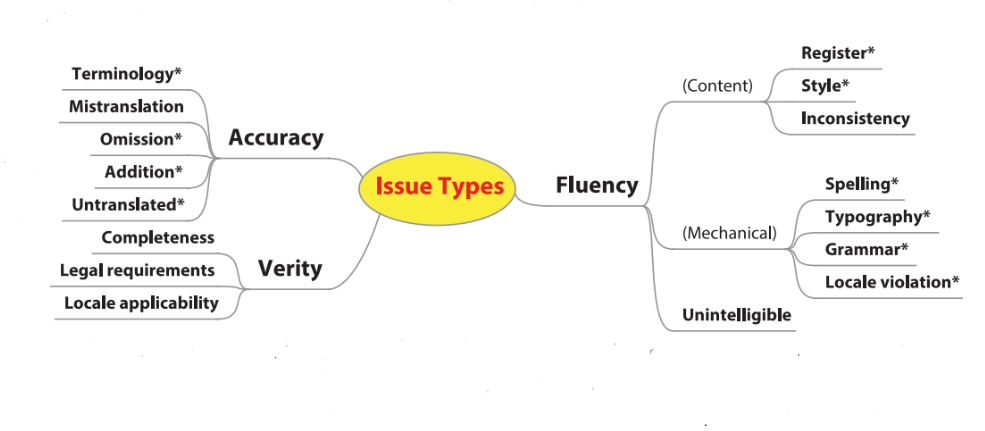

Иерархия и ветви. MQM задает иерархию из 100+ типов ошибок (уровни детальности выбираются под задачу) и группирует их в 5 ветвей (см.рис.5):

-

Accuracy (Точность) – соответствие смыслу и фактам исходника (искажение смысла, опущение или добавление слов и т.п.).

-

Fluency (Плавность) – грамматика, пунктуация, морфология, орфография, согласованность.

-

Verity (Достоверность) – соответствие правовым, культурным и прикладным требованиям целевого контекста, особенно важное в отраслях с нормативным регулированием (финансы, медицина, юриспруденция, технические стандарты).

-

Design (Оформление) – форматирование/верстка, если это входит в требования.

-

Internationalization (Интернационализация) – пригодность контента к локализации (ветвь предусмотрена под инженерные аспекты).

Рис.5. Иерархия категорий ошибок в системе MQM. Ошибки классифицируются по трем основным ветвям – Accuracy, Fluency и Verity. Они охватывают как лингвистические, так и внеязыковые аспекты перевода (терминология, стиль, грамматика, соответствие локали и т.д.). Звездочкой отмечены категории, для которых возможна автоматическая детекция ошибок. Источник: Lommel A., Burchardt A., Uszkoreit H. (2013). “Multidimensional Quality Metrics: A Flexible System for Assessing Translation Quality // Proceedings of the QTLaunchPad Workshop.”

Ключевый показатель MQM – это категория Verity. MQM фиксирует ошибки, выходящие за пределы языка, когда формально точный и беглый перевод непригоден по назначению (например, юридический текст корректен с лингвистической точки зрения, но противоречит нормам юрисдикции).

MQM Core и выбор гранулярности. Для типовых задач используется MQM Core (≈19 базовых категорий), а для диагностики MT/LLM можно опускаться глубже (например, до конкретных морфологических/терминологических подтипов). Рекомендация: метрика должна быть ровно настолько детальной, насколько требует задача , потому что избыточная гранулярность снижает согласованность аннотаторов.

12 «измерений» спецификации (ISO/TS 11669). Чтобы метрика отражала назначение текста, MQM связывает аннотацию с 12 проектными измерениями: язык/локаль, домен, терминология, тип текста, аудитория, цель, регистр/стиль, соответствие содержаний (полный/сжатый/ открытый/скрытый), модальность вывода (экран/субтитры/встраиваемые дисплеи), формат файла, технология производства и др. Такой подход позволяет связывать оценку качества с требованиями конкретного проекта – критерии и ожидания задаются еще на этапе подготовки задания на перевод.

Оценка качества и кредит за улучшения. Базовая система оценки MQM использует взвешенные штрафы по категориям и степеням критичности ошибок (minor, major, critical) с нормировкой на объем текста.. Ключевая особенность – учет качества источника. Если перевод исправляет проблемы исходника (Fluency/Verity source), итоговый балл может превышать 100, кредитуя работу переводчика/редактора.

Аналитика и холистика. MQM поддерживает два режима: аналитический (точечные ошибки для причинного анализа и обучения моделей) и холистический (быстрая оценка по шкале по тем же категориям). Один и тот же словарь ошибок легко «переключается» между ними.

Функциональная совместимость. MQM совместим с TAUS DQF (методологические сценарии) и сопоставляется с W3C ITS 2.0 (категории локализационных проблем), что упрощает обмен данными между системами. Рамка открыта и расширяема, поэтому ее удобно внедрять в LSP-процессы и MT-R&D.

Инструменты и практика. Под MQM доступны scorecards (табличные/упрощенные), а также редакторская среда translate5 с встроенной разметкой ошибок. На базе MQM выполняются аннотации в WMT; эти разметки используются для обучения и валидации нейронных метрик (COMET/UniTE) и для настройки LLM-as-a-Judge.

MQM служит мостом между классическими метриками и нейронными подходами к оценке качества: человеческая эталонная разметка ошибок формирует основу, на которой обучаются модели семейства COMET и модели LLM-as-a-judge. Это повышает согласованность автоматических оценок с экспертными суждениями и позволяет выстраивать непрерывные циклы самообучения качества перевода – от перевода к оценке и обратно к улучшению.

Нейронные метрики

С развитием нейронных и LLM-систем перевода появились нейронные метрики, способные оценивать перевод с учетом смысла, контекста и стиля текста.

COMET – обученная на человеческих аннотациях система, которая анализирует исходный и переведенный текст, а также может работать в безреференсном режиме. Последние версии (COMET-20, COMET-22, COMET-Kiwi) демонстрируют наивысшую корреляцию с человеческими оценками и стабильность между языковыми парами.

BLEURT – метрика, использующая контекстуальные эмбеддинги BERT для оценки семантической близости перевода к эталону.

UniTE – объединенная модель, комбинирующая контекстуальные эмбеддинги и поверхностные признаки для более точного отражения качества перевода.

LLM-as-a-Judge – современный подход, при котором большая языковая модель сама выступает в роли «судьи»: модель оценивает качество перевода, выявляет ошибки и может предлагать исправления.

Как показано в исследовании “Evaluating Automatic Metrics with Incremental Machine Translation Systems” (2024), обучаемые нейронные метрики значительно превосходят классические референсные метрики.

Метрика COMET-22 достигает наибольшей точности при ранжировании пар систем перевода, опережая BLEU и chrF, особенно в задачах pairwise ranking (попарное ранжирование), где требуется определить, какая система дает лучший результат. Несмотря на высокую точность, нейронные метрики все еще демонстрируют различия между языковыми парами, что указывает на необходимость их дальнейшего совершенствования.

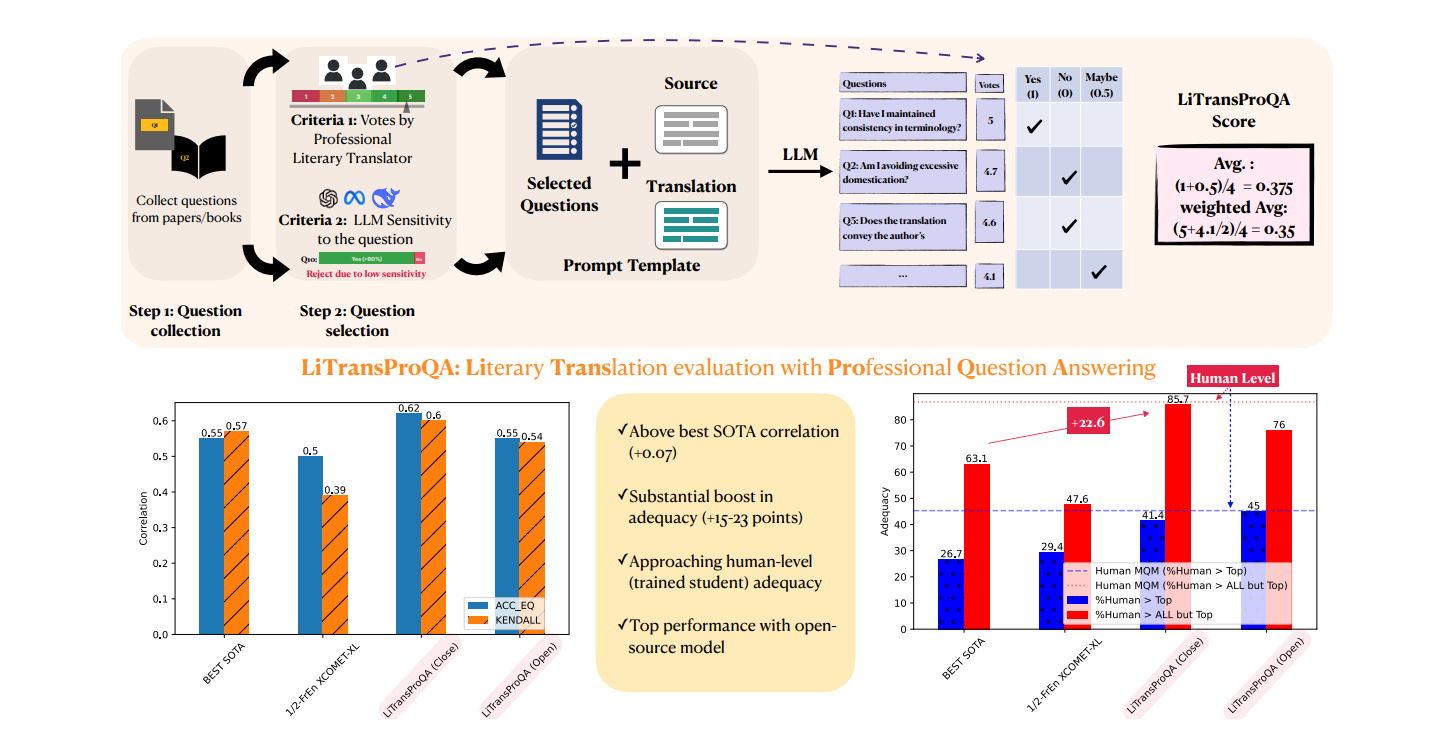

Отдельным направлением исследований становится разработка специализированных метрик для отдельных жанров и задач перевода. Так, в исследовании “LiTransProQA: An LLM-based Literary Translation Evaluation Metric with Professional Question Answering” (2025) представлен инновационный подход для оценки художественного перевода, где важны не только точность и смысл, но и стилистическая выразительность, культурный контекст и авторский голос.

Метрика LiTransProQA реализует LLM-ориентированную безреференсную схему вопросно-ответной оценки (QA) и интегрирует мнения профессиональных литературных переводчиков. В экспериментах она превзошла существующие методы (включая XCOMET-XL), повысив корреляцию с человеческими оценками на 0,07 и улучшив показатели адекватности более чем на 15 пунктов (рис.6).

Исследование показало, что использование экспертных весов, основанных на профессиональных суждениях, делает метрику сопоставимой по качеству с оценками студентов-лингвистов и лишь немного уступающей профессионалам. Это подчеркивает потенциал человеко-ориентированных LLM-метрик, способных учитывать не только точность, но и стилистические и культурные особенности текста.

При этом оценка качества перевода остается одной из самых сложных задач NLP. Разные эксперты по-разному интерпретируют качество текста, а рост уровня моделей делает классические метрики менее чувствительными. Поэтому именно нейронные и LLM-метрики становятся сегодня основой системной валидации и мониторинга перевода, и фундаментом для будущих самообучающихся моделей.

WMT 2025: новые ориентиры для оценки качества перевода

Конференции серии WMT проводятся с 2006 года. Сначала они представляли небольшие воркшопы при конференциях ACL и EMNLP, а со временем они выросли в самостоятельное глобальное мероприятие, задающее темп развитию машинного перевода.

WMT традиционно является главным мировым событием в области машинного перевода и оценки качества, объединяющим академические лаборатории, разработчиков MT-систем и индустриальные компании. Каждый год именно результаты WMT задают стандарты для всей отрасли – от исследовательских бенчмарков до коммерческих API-решений.

Основные направления WMT 2025

Организаторы объявили несколько ключевых направлений, отражающих сдвиг акцента от простых предложений к контекстному и документальному переводу:

-

General Machine Translation Task – расширение набора языковых пар (около 30), включая редкие и низкоресурсные языки.

-

Document-Level Translation – перевод и оценка целых документов, где важны последовательность, логика и консистентность терминов.

-

Automatic Translation Quality Evaluation (QE) – развитие автоматизированных систем оценки перевода, включая сегмент-уровень, span-аннотацию и модели прогнозирования качества.

-

Multilingual Instruction Shared Task – новая дорожка, посвященная обучению систем многоязычным инструкциям и адаптации под разные языковые культуры.

-

Человеческие аннотации с применением протоколов MQM и ESA (Error Span Annotation), которые обеспечивают более прозрачную и понятную оценку качества перевода.

Что было на WMT 2025:

-

Документальные текстовые наборы сформированные по принципу “difficulty samplIng” – специальная выборка сложных текстов для более объективной оценки.

-

Включение LLM-систем (Claude, Gemini, LLaMA и др.) – впервые на конференции нейронные модели сравнивались с классическими NMT-подходами.

-

Методика аннотации ошибок – расширенные категории MQM, весовые коэффициенты и интеграция автоматической предоценки (auto-pre-scoring) перед ручной валидацией.

-

Переход от отдельных предложений к сложным, полноценным, разнообразным текстам, чтобы оценить насколько LLM-системы справляются с реальными документами из разных сфер (медицина, юриспруденция, финансы и др.)

Практические значение для B2B

Тренды, заданные на WMT 2025 напрямую касаются корпоративного и облачного перевода:

-

Из-за роста сложности контента, Translation API должен обеспечивать точность качество перевода на уровне всего документа, а не только на уровне отдельных фрагментов.

-

Использование MQM и нейронных метрик становится обязательной частью продукта, а не только внешнего процесса.

-

WMT делает акцент на том, что контент для специализированных областей (медицина, финансы, юриспруденция и др.) должен быть достоверным и контекстно релевантным, а не просто совпадать на лексическом уровне.

-

Автоматическая оценка и самокоррекция моделей создает предпосылки для создания самообучающихся контуров качества, где модель не просто переводит текст, но и анализирует свои ошибки.

По итогам конференции стало ясно, что фокус на переводе целых документов, автоматической оценке и интеграции LLM, является следующим шагом в развитии подходов к оценке качества, начатых MQM и COMET-метриками. Для компаний работающих с корпоративным переводом и языковыми API, это сигнал, что качество перевода должно измеряться не числом n-грамм, а степенью понимания смысла и контекста.

Современные тенденции и технологии в машинном переводе 2025-2026

Large Reasoning Models (LRMs) как новый этап развития машинного перевода

В последние годы внимание исследователей все больше привлекают Large Reasoning Models (LRMs) – большие языковые модели с развитой способностью к логическому рассуждению. В отличие от классических NMT и LLM, LRMs рассматривают перевод не как простую конверсию текста, а как многоэтапный когнитивный процесс, включающий анализ контекста, стиля, намерения автора и культурных особенностей.

LRMs интегрируют механизм Chain-of-Thought (CoT) – пошаговое рассуждение, при котором модель последовательно строит промежуточные логические выводы для обоснования конечного перевода. Кроме того, они способны к саморефлексии, то есть пересмотру и корректировке собственного перевода на этапе инференса, особенно в случаях неоднозначного или текста с большим количества шума.

Концептуальный обзор “New Trends for Modern Machine Translation with Large Reasoning Models” выделяет три фундаментальных сдвига, вносимых LRM в машинный перевод:

-

Контекстуальная связность – учет межфразовых связей, анафоры и неполного контекста для документного перевода.

-

Культурная интенциональность – способность выводить намерение говорящего и учитывать социолингвистические нормы и ожидания аудитории.

-

Механизм саморефлексии – возможность пересматривать и корректировать собственные переводы на этапе инференса.

LRMs представляют собой парадигмальный сдвиг в машинном переводе.Они превращают системы из инструментов автоматической конверсии текста в многоязычные когнитивные агенты, способные рассуждать о значении, контексте и намерении текста.

Глубокий многоязычный перевод с использованием LRM и RL

В последние годы нейронный машинный перевод активно развивается благодаря интеграции больших моделей рассуждений LRM, таких как OpenAI-o1 и DeepSeek-R1. Эти модели демонстрируют впечатляющие способности к решению сложных задач благодаря длинным цепочкам рассуждений (chain-of-thought). Исследование “Multilingual Deep Reasoning Translation via Exemplar-Enhanced Reinforcement Learning (2025) показало, что использование LRM в сочетании с обучением с подкреплением позволяет существенно повысить качество перевода, особенно в литературных текстах с метафорами и идиомами. Ключевым элементом подхода является применение продвинутой модели в роли “экземпляра” (LLM-as-an-exemplar), которая задает эталон перевода для обучения основной модели, создавая механизм сравнения и генерации вознаграждения. Такой метод позволяет не только улучшить точность и читаемость перевода, но и адаптировать модель к различным стилям текста.

Особое внимание в исследовании уделено многоязычному машинному переводу. Авторы предложили легкий метод обобщения, который использует возможности LRM для языков с большим количеством ресурсов и проверяет корректность формата и языка для остальных направлений. Такой подход позволяет переносить навыки перевода на 90 языковых пар без существенных затрат ресурсов и без снижения качества.

Мультимодальный машинный перевод текста и изображений с многозадачным RL

Современные подходы к машинному переводу текста, встроенного в изображения (TIMT), активно развиваются с применением мультимодальных больших языковых моделей (MLLM) и обучения с подкреплением (RL). Исследование “Scaling MLLM-based Text Image Machine Translation via Multi-Task Reinforcement Learning” (2025) демонстрирует инновационный подход, в котором TIMT формулируется как многозадачная проблема, объединяющая три ключевые подзадачи: распознавание текста (OCR), контекстно-ориентированное рассуждение и собственно перевод. Модель обучается с использованием нового механизма многовариантного вознаграждения, который учитывает правильность формата ответа и качество каждого подзадачного результата, обеспечивая более гибкую и детализированную обратную связь. Такая структура обучения позволяет MLLM не только точно распознавать текст на изображениях, но и учитывать визуальный контекст, объекты, цветовые схемы и пространственные связи для более корректного и связного перевода. Это исследование подчеркивает потенциал многозадачного RL в мультимодальном машинном переводе и открывает возможности для его применения в реальных сценариях, где текст и визуальный контекст тесно интегрированы.

Потоковый on-device перевод речи с модулем read/write

Одним из ключевых современных направлений в машинном переводе является потоковый перевод речи в реальном времени, особенно на мобильных и встроенных устройствах, где критически важна минимальная задержка. Исследование “Overcoming Latency Bottlenecks in On-Device Speech Translation: A Cascaded Approach with Alignment-Based Streaming MT” (2025) представляет архитектуру AliBaStr-MT, которая сочетает каскадный подход ASR+MT с новым модулем read/write. Такой модуль позволяет динамически решать, когда начать генерацию перевода на основе текущих входных токенов. Система использует мультиканальную многоязычную RNN-T ASR модель, способную распознавать речь нескольких говорящих, определять смену языка и фильтровать фоновые шумы. Для управления памятью устройства и ограниченным контекстом применяется сегментация предложений с предсказанием пунктуации, что позволяет своевременно сбрасывать кэш состояния и предотвращать потерю качества перевода при ограниченных ресурсах. Такой подход решает проблему несоответствия между короткими предложениями в обучающих данных и длинными потоками речи во время реального использования. Исследование иллюстрирует тенденцию 2025 года к реальному применению MT в условиях ограниченных ресурсов и потоковых данных, расширяя возможности каскадных и гибридных архитектур для задач перевода речи.

Агентный машинный перевод с обучением с подкреплением и внешними знаниями

Одним из наиболее актуальных направлений развития машинного перевода в 2025–2026 является переход от статических нейронных моделей к агентным системам перевода. Эти системы сочетают рассуждение, поиск внешних знаний и обучение с подкреплением. В рамках этого подхода модели рассматриваются не как замкнутые генераторы перевода, а как активные агенты, способные итеративно анализировать текст, выявлять проблемные элементы и обращаться к внешним источникам информации. Исследование “Neologism-Aware Agentic Machine Translation with Reinforcement Learning” демонстрирует данный тренд на примере задачи перевода предложений, содержащих неологизмы – единицы, знание которых отсутствует во внутренней параметрической памяти LLM. Авторы предлагают агентный механизм, в котором модель чередует этапы рассуждения и поиска в словарной базе, а затем оптимизируется с помощью обучения с подкреплением с использованием специализированных вознаграждений, ориентированных на точность передачи неологизмов и общее качество перевода. Такой подход позволяет преодолеть ограничение “замороженных” знаний больших языковых моделей и отражает общий вектор развития машинного перевода – интеграцию LLM, RL и внешних источников знаний для решения лингвистически сложных и динамичных задач.

Эффективное создание корпусов MT с использованием LLM и human-in-the-loop

Одним из актуальных направлений развития машинного перевода в 2025–2026 годах является интеграция больших языковых моделей (LLM) с человеком в цикле постредактирования для формирования качественных параллельных корпусов. Исследование “Efficient Machine Translation Corpus Generation: Integrating Human-in-the-Loop Post-Editing with Large Language Models” (2025) демонстрирует систему, в которой LLM генерируют первичные переводы и оценивают их качество, а эксперты выполняют постредактирование только в наиболее сложных случаях. Такой подход позволяет оптимизировать распределение человеческих ресурсов, концентрируя усилия лингвистов там, где это действительно необходимо, и одновременно ускоряет расширение корпусов для обучения MT-систем.

Система использует механизмы псевдоразметки, где LLM автоматически создают метки для необработанных данных, которые затем могут проверять или корректировать специалисты. Кроме того, LLM участвуют в выборе наилучшего перевода среди нескольких гипотез, что повышает начальную точность и качество постредактирования. Для оценки качества перевода применяются метрики вроде COMET-QE и GEMBA, интегрированные с предсказаниями LLM, что позволяет получать более детализированную и объективную обратную связь.

В результате такой методологии достигается сокращение объема ручной работы, повышение качества и согласованности корпуса и ускорение цикла обучения MT-моделей. Этот подход отражает общий тренд 2025–2026 годов: переход от статических моделей к гибридным решениям, где LLM и эксперты работают совместно для эффективного создания данных и улучшения качества перевода.

Адаптация и оптимизация моделей машинного перевода под предметные ниши

Fine-tuning моделей машинного перевода под предметные ниши

В 2025 году на WMT Terminology Shared Task была представлена работа MULTITAN. В ней сравнивалась эффективность тонкой настройки нейронных моделей машинного перевода (NMT) и больших языковых моделей (LLM) для специализированного перевода EN-ES. Для обучения использовались выровненные корпуса, глоссарии и синтетические данные. Этот кейс интересен тем, что он позволяет детально рассмотреть, как разные стратегии доменной адаптации влияют не только на терминологическую точность, но и на общее качество перевода.

В эксперименте использовались:

-

доменно-специфические параллельные корпуса;

-

глоссарии терминов, встроенные в процесс декодирования;

-

синтетические данные, сгенерированные с помощью LLM и примененные для расширения обучающей выборки (data augmentation).

Fine-tuning выполнялся как для классических NMT-моделей (Marian MT), так и для LLM-подобных архитектур (EuroLLM), а также для гибридных систем (Systran_SEG_AUG), использующих LLM-сгенерированные данные при обучении.

Эксперимент показал, что fine-tuning под терминологию действительно повышает точность передачи специализированных термино. Но, к сожалению, это не всегда приводит к росту общего качества перевода. Чаще всего, для классических NMT-моделей жесткое использование глоссариев и декодирования с ограничениями (constrained decoding) улучшило терминологическое соответствие, но могло снижать общую адекватность перевода по автоматическим метрикам. В то же время LLM оказались более устойчивыми к таким ограничениям и лучше адаптировались к структурированным инструкциям и терминологическим подсказкам.

Наиболее сбалансированные результаты продемонстрировали гибридные подходы, в которых для fine-tuning использовались синтетические данные, сгенерированные LLM. Такие системы показали более стабильную передачу информации и меньший разрыв с референсным переводом по сравнению с чистыми NMT- или LLM-решениями.

Ключевой практический вывод заключается в том, что fine-tuning под предметные ниши представляет собой задачу оптимизации компромиссов. Усиление терминологической точности почти всегда сопровождается риском деградации общей беглости и связности перевода, особенно при ограниченных данных и жестких правилах декодирования. В практических сценариях наиболее эффективными оказываются гибридные стратегии, сочетающие данные, подходы и сильные стороны как NMT, так и LLM.

Instruction-tuning LLM для машинного перевода в медицинском домене

Instruction-tuning – это разновидность fine-tuning, при которой LLM обучается следовать инструкциям в формате промтов, включая терминологические правила. В работе “Instruction-tuned Large Language Models for Machine Translation in the Medical Domain” (2025) авторы исследуют, может ли instruction-tuning с использованием терминологических правил улучшить качество машинного перевода LLM в медицинской отрасли. Актуальность задачи обусловлена тем, что, несмотря на сильные результаты LLM в общих доменах, в специализированных областях (в частности, медицине) они часто уступают классическим NMT по точности и терминологической консистентности.

Ключевая идея подхода заключается в том, чтобы представить терминологические ограничения не как жесткие правила декодирования, а как инструкции в формате промтов, используемых при тонкой настройки модели. Для этого авторы автоматически формируют instruction-tuning датасет на основе параллельного корпуса EMEA (European Medicines Agency) и медицинских словарей IATE (Interactive Terminology for Europe), встраивая пары терминов непосредственно в текст инструкции (например, в виде глоссариев внутри промта).

Fine-tuning выполняется с использованием parameter-efficient fine-tuning (PEFT) и QLoRA (4-bit quantization), что делает настройку LLM возможной даже при ограниченных вычислительных ресурсах. В экспериментах используются FLAN-T5, Llama-3 и Tower для языковых пар en-es, en-de и en-ro.

Результаты показывают, что instruction-tuning:

-

статистически значимо улучшает качество перевода по BLEU, chrF и COMET по сравнению с базовыми моделями;

-

повышает точность передачи терминологии во всех языковых парах;

-

снижает количество критических и серьезных ошибок по MQM-аннотации;

-

особенно эффективно работает в сочетании с моделями, изначально ориентированными на MT-задачи (Tower).

Интересно, что encoder-decoder модель FLAN-T5 демонстрирует наивысшую терминологическую точность, но уступает LLM по общему качеству перевода. Instruction-tuned LLM (особенно Tower) обеспечивают более сбалансированное качество текста. При этом Llama-3 страдает от чрезмерной генерации текста, что подчеркивает важность аккуратного контроля inference-поведения модели.

Основной вывод работы заключается в том, что instruction-tuning с терминологическими подсказками является эффективной альтернативой жесткому декодированию с ограничениями. Такой подход лучше вписывается в реальные рабочие процессы постредактирования, где переводчик взаимодействует с моделью через инструктивный интерфейс.

Особенности тренировки и дообучения моделей в доменных задачах

При адаптации моделей машинного перевода к специализированным предметным нишам важны не только данные, но и методы обучения. В доменных задачах, таких как медицина, финансы или IT, ключевыми аспектами являются:

-

Выбор корпуса и терминологическая точность.Для обучения используются специализированные параллельные корпуса (например, EMEA для медицины) и терминологические словари (например, IATE), а также внутренние корпоративные данные, такие как UI-строки и корпоративные тексты. Они позволяют модели корректно переводить узкоспециализированные термины, повышают точность перевода критических сегментов и сохраняют стиль текста, характерный для домена.

-

Использование синтетических данных и расширение обучающей выборки. С помощью LLM можно генерировать дополнительные сегменты текста, расширяя обучающую выборку и компенсируя нехватку реальных доменных данных. Это особенно полезно для низкоресурсных языковых пар и редких терминов, а также позволяет лучше подготовить модель к редким или новым явлениям в домене.особенно полезно для низкоресурсных языковых пар и редких терминов.

-

Fine-tuning и instruction-tuning. Тонкая настройка моделей позволяет адаптировать как NMT, так и LLM к конкретной предметной области. Instruction-tuning формирует для LLM “инструкции” или промты, указывающие на правильный перевод терминов, длину сегмента и стиль текста. Этот подход помогает контролировать корректность перевода сложной терминологии, снижает вероятность ошибок и over-generation и улучшает согласованность текста.

-

Parameter-efficient fine-tuning (PEFT) и квантование. Для крупных LLM полное дообучение может быть ресурсоемким. PEFT и методы квантования (например, LoRA, QLoRA) позволяют дообучать модель с минимальными затратами памяти и вычислений, сохраняя при этом высокое качество перевода. Однако такие методы могут уступать полной настройке по усвоению сложной доменной терминологии и синтаксических паттернов, особенно при низком ранге адаптера или сильной квантизации.

-

Контроль генерации на этапе inference. В доменных задачах критично не только обучение, но и корректное поведение модели при генерации перевода. Контроль over-generation, соблюдение терминологии, корректная сегментация и предотвращение пропусков сегментов обеспечивают более стабильный и точный перевод. Особенно это важно для технических документов и UI-текстов, где последовательность и точность перевода имеют критическое значение.

В целом, успешная адаптация моделей машинного перевода к доменным задачам требует комбинации качественных данных, продуманных методов обучения и контроля поведения модели, а также постепенного увеличения объема данных и тестирования на разных языковых парах и типах текстов.

Inference-стратегии в доменно-ориентированном машинном переводе

При использовании моделей машинного перевода в специализированных доменах, таких как медицина, финансы или IT, не менее важным этапом, чем обучение, является стратегия генерации перевода на этапе inference. Даже хорошо дообученная модель может демонстрировать ошибки без правильного контроля при генерации.

-

Контроль качества генерации и предотвращение over-generation. В LLM часто наблюдается over-generation — чрезмерная генерация текста за пределами исходного сегмента. В доменных задачах это может приводить к лишним фразам или некорректному расширению терминологии. Для снижения таких эффектов применяют методы постобработки, ограничение длины выхода, правильную сегментацию и truncation.

-

Prompting и few-shot retrieval. Для LLM полезно предоставлять модели примеры перевода из той же предметной области. Few-shot prompting с отобранными релевантными сегментами помогает модели ориентироваться на правильный стиль и терминологию, повышает согласованность перевода и уменьшает ошибки, особенно в низкоресурсных языковых парах.

-

Выбор стратегии генерации. Разные подходы, такие как greedy decoding, beam search или sampling, по-разному влияют на качество перевода. В доменных задачах чаще используют beam search с ограниченной шириной, чтобы сохранить точность терминологии и избежать случайных вставок, характерных для вероятностной генерации.

-

Адаптация под ресурсы и скорость. Для крупных моделей LLM inference может быть дорогим и медленным. Методы вроде QLoRA или динамической адаптации позволяют сократить вычислительные затраты, сохраняя точность перевода, что особенно важно для production-систем с ограниченным временем отклика.

-

Обратная проверка и пост-редактирование. В критичных доменных областях применяется дополнительная проверка перевода: терминологическая сверка, сегментация и сопоставление с справочными словарями или корпоративными глоссариями. Это позволяет выявлять ошибки, которые не уловить метриками BLEU или COMET, и гарантировать соответствие стандартам домена.

Эти стратегии вместе формируют эффективный комплекс методов оптимизации: повышают терминологическую точность, минимизируют ошибки, сокращают ручное редактирование и обеспечивают стабильность перевода на разных языковых парах.

Общие выводы

Мы с вами и прошли этот длинный путь, от первых экспериментов в области машинного перевода до современных LLM и самых актуальных трендов. И все же, несмотря на колоссальный прогресс, остаются вопросы. Смогут ли LLM-переводчики полностью заменить человеческий перевод в ближайшие 10 лет? Каким должен быть “идеальный переводчик будущего” – универсальным, или узко настроенным под домен? Готовы ли вы полностью доверить перевод машинам?

Пишите в комментариях, что думаете.

Источники и материалы

-

Бутусова А. С., Бец Ю. Машинный и автоматизированный перевод. Ростов-на-Дону – Таганрог, 2022.

-

Koehn Ph. Statistical Machine Translation. Cambridge University Press, 2010. PDF

-

Ревзин И. И., Розенцвейг В. Ю. Основы общего и машинного перевода. Москва: Высшая школа, 1964. PDF

-

Karlbom H. Hybrid Machine Translation. Uppsala University, 2016. PDF

-

Koehn Ph. Neural Machine Translation. Johns Hopkins University, 2017. PDF

-

Gu J. et al. A Survey on LLM-as-a-Judge. arXiv, 2025. PDF

-

Xu Y. et al. A Survey on Multilingual Large Language Models: Corpora, Alignment, and Bias. Science China Information Sciences, 2025. PDF

-

Xiao T., Zhu J. Foundations of Large Language Models. NLP Lab, Northeastern University, 2025. PDF

-

Wu G., Cohen S. B., Sennrich R. Evaluating Automatic Metrics with Incremental Machine Translation Systems. Findings of ACL: EMNLP 2024. PDF

-

Zhang R., Zhao W., Macken L., Eger S. LiTransProQA: An LLM-based Literary Translation Evaluation Metric with Professional Question Answering. arXiv, 2025. PDF

-

Lommel A., Uszkoreit H., Burchardt A. Multidimensional Quality Metrics (MQM): A Framework for Declaring and Describing Translation Quality Metrics. German Research Center for Artificial Intelligence (DFKI), Language Technology Lab, December 14, 2014. PDF

-

Lommel A., Burchardt A., Uszkoreit H. Multidimensional Quality Metrics: A Flexible System for Assessing Translation Quality. // Proceedings of the QTLaunchPad Workshop, London, UK, November 28-29, 2013. PDF

-

Proceedings of the Tenth Conference on Machine Translation (WMT25). EMNLP, Suzhou, China, November 8-9, 2025. URL: https://www2.statmt.org/wmt25/

-

Huang L., Yu W., Ma W., Zhong W., Feng Z., Wang H., Chen Q., Peng W., Feng X., Qin B., Liu T. A Survey on Hallucination in Large Language Models: Principles, Taxonomy, Challenges, and Open Questions. arXiv, 2024. PDF

-

Bang Y., Ji Z., Schelten A., Hartshorn A., Fowler T., Zhang C., Cancedda N., Fung P. HalluLens: LLM Hallucination Benchmark // Proceedings of the 61st Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers). July 2025. P. 1–22. PDF

-

Kalai A. T., Nachum O., Vempala S. S., Zhang E. Why Language Models Hallucinate. arXiv, 2025. PDF

-

Wu Z., Wei D., Li Z., Shang H., Guo J., Li S., Rao Z., Luo Y., Xie N., Yang H. Choose the Final Translation from NMT and LLM Hypotheses Using MBR Decoding: HW-TSC’s Submission to the WMT24 General MT Shared Task // Proceedings of the Ninth Conference on Machine Translation (WMT24). November 2024. PDF

-

Enis M., Hopkins M. From LLM to NMT: Advancing Low-Resource Machine Translation with Claude. arXiv, 2024. PDF

-

Sizov F., España-Bonet C., Van Genabith J., Xie R., Chowdhury K. D. Analysing Translation Artifacts: A Comparative Study of LLMs, NMTs, and Human Translations // Proceedings of the 2024 Conference on Empirical Methods in Natural Language Processing. November 2024. PDF

-

Wu Z., Wei D., Chen X., Shang H., Guo J., Li Z., Luo Y., Yang J., Rao Z., Yang H. Combining the Best of Both Worlds: A Method for Hybrid NMT and LLM Translation. arXiv, 2025. PDF

Автор: Aliaksei_Rudak