В марте 2023 я написал статью «ChatGPT: новый инструмент в борьбе с багами». Показал как нейросеть генерирует тест-кейсы, ищет XPath-локаторы и пишет SQL-запросы. 40 000+ просмотров. Первая статья на эту тему в рунете.

Ты сейчас подумал «ну и что, таких статей теперь тысячи». И ты прав. Но подожди.

За 3 года я прошёл путь от «вау, ChatGPT написал мне 10 тест-кейсов» до «я один собрал образовательную платформу за неделю». И это НЕ кликбейт.

В этой статье — мой путь, мой стек, мой workflow, конкретные цифры по деньгам и времени, и ошибки, которые я сделал, чтобы ты их не повторял.

Перечитал свою статью.

Открыл ту статью сейчас — и вот что увидел:

«Всем привет! Я QA Engineer и недавно открыл для себя ChatGPT…»

Дальше шли скриншоты промптов. «Напиши 10 тест-кейсов для формы авторизации». «Составь матрицу компетенций для Senior QA». «Найди XPath-локаторы на GitHub».

Знаешь что самое смешное? Я РЕАЛЬНО был в восторге от того, что нейросеть умеет писать тест-кейсы. Это казалось магией.

Сейчас AI пишет за меня целые модули и проверяет код студентов — а я сижу и вспоминаю как радовался 10 тест-кейсам.

(но именно с этого всё и началось)

Что было: 2023

Я был QA-инженером. Ручное тестирование, документация, тест-кейсы. Стандартный набор.

ChatGPT тогда был игрушкой. Ты кидал ему промпт, он отвечал что-то более-менее адекватное, ты скринил и постил в чатик «гляньте чо умеет». Все делали вид что это изменит мир, но по факту максимум — экономил 20 минут на рутине.

Моя статья была ровно про это: вот промпт, вот результат, вот ещё промпт. Никакой глубины. Просто «смотрите, оно умеет штуки».

И это набрало 40К просмотров. Потому что тогда НИКТО в рунете про это не писал.

Мой путь: от тест-кейсов к продуктам

2022 — начал писать код (автотесты на питоне).

2023 — написал ту самую статью. 40К просмотров. Дорос до лида тестирования в бигтехе.

2024–2025 — работаю в командах, которые разрабатывают продукты на базе AI. Тестирую их. Параллельно делаю свои подпроекты — но ничего не релижу, всё складываю в стол. Куча экспериментов, ни одного продакшена.

2026 — решил: хватит складывать в стол. bonaqa стала первым проектом, который я довёл до прода и показал миру. Открылся, начал строить публично.

Один + AI = целая команда

Я сел и за НЕДЕЛЮ собрал полноценную образовательную платформу. Один. Без команды, без дизайнера, без бэкендера, без девопса.

bonaqa — платформа для подготовки QA-автоматизаторов. Вот что внутри:

-

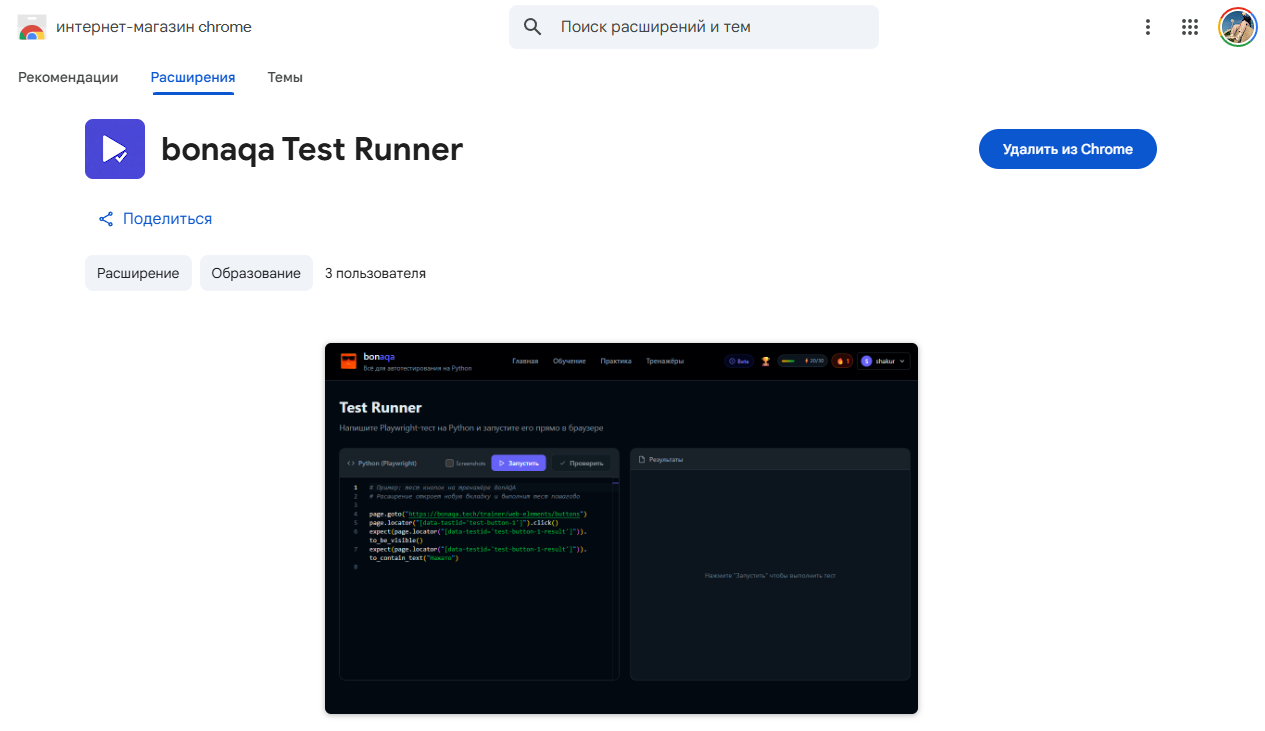

Test Runner — Chrome-расширение: студент пишет Playwright-тест на Python и запускает прямо в браузере на тренажёрах. PASSED/FAILED с деталями по каждому шагу. Закодил с AI, опубликовал в Chrome Web Store — даже заявку на публикацию Claude составил

-

AI-проверка кода — студент пишет код, GPT-4o анализирует, даёт фидбэк и оценку. ~$0.02 за проверку

-

13 тренажёров с реальными веб-элементами — select, drag & drop, модалки, таблицы + 3 комплексные формы

-

Геймификация — XP, 10 уровней, streak, лидерборд с 6 лигами, combo-система с конфетти, маскот Bonnie

-

4 типа упражнений + Practice API со Swagger UI + админка + email-уведомления + Docker, CI/CD, PostHog

Стек: React + Vite, Node.js + Express, PostgreSQL + Prisma, OpenAI GPT-4o, Docker.

Сколько бы это стоило в студии? 400–700 тысяч рублей и 3 месяца работы. Я потратил неделю и много токенов.

Ты сейчас подумал «ну значит качество — херня». Нет. Платформа работает. Есть своя регистрация и авторизация, привязка Telegram к аккаунту, email-уведомления через Resend, rate limiting на AI-проверки (чтобы бюджет не улетел), нормальная архитектура с Prisma ORM, а не «всё в одном файле».

Это не демка. Это production.

Честная часть

Сейчас будет то, что обычно прячут.

Доход с bonaqa: 0 рублей.

Ноль. Платформа собрана, работает, Premium-подписка подключена (390 руб/мес через ЮKassу), но платящих пользователей пока нет. Кнопка «Купить» есть — покупателей нет. Это ранняя стадия, и я не буду делать вид что у меня «всё получилось».

Я НЕ уволился. Продолжаю работать в найме. Это мой основной доход. Продукты строю по вечерам и выходным.

Почему я это пишу? Потому что в 2026 году половина контента в интернете — это люди, которые заработали $0, но рассказывают как зарабатывать миллионы. Я не хочу быть одним из них.

Я строю в открытую: что получается, что не получается, сколько трачу, сколько зарабатываю. Всё как есть.

Мой workflow: как я РЕАЛЬНО работаю с AI

Давайте без иллюзий. «Один человек собрал платформу за неделю» звучит как реклама курса по промпт-инженерии (спойлер: у меня нет курсов кроме тех что на бонакве). Разбираю по шагам, как это устроено на практике.

Инструменты

|

Задача |

Что использую |

Зачем |

|---|---|---|

|

Код + интеграция |

Claude Code (терминал) |

Пишет код в проекте, видит всю кодовую базу, сам интегрирует |

|

Планирование |

Claude Code (режим плана) |

Составляю план, вычитываю, корректирую — потом приступаю |

|

Ревью |

Агент-ревьюер + |

Два раунда: кастомный агент ищет баги, |

|

Тестирование |

MCP Playwright + ручное |

AI проходит сценарии в браузере, я протыкиваю глазами |

|

Архитектура |

Claude (отдельный чат) |

Обсуждаю как с коллегой, миксую агентов для разных точек зрения |

|

DevOps |

Claude Code |

Docker Compose, Nginx, CI/CD, деплой на сервер по SSH |

MCP — когда AI выходит за пределы редактора

Самый мощный сдвиг в моём workflow за последний год — MCP (Model Context Protocol). Это когда AI не просто пишет код в терминале, а подключается к внешним сервисам напрямую.

|

MCP-сервер |

Зачем |

|---|---|

|

Context7 |

Актуальная документация по библиотекам. Claude не галлюцинирует про устаревший API — он лезет в свежие доки |

|

Playwright MCP / Claude in Chrome |

Claude сам открывает браузер, ходит по страницам, проверяет UI. Я говорю «протестируй форму регистрации» — он открывает Chrome и тестирует |

|

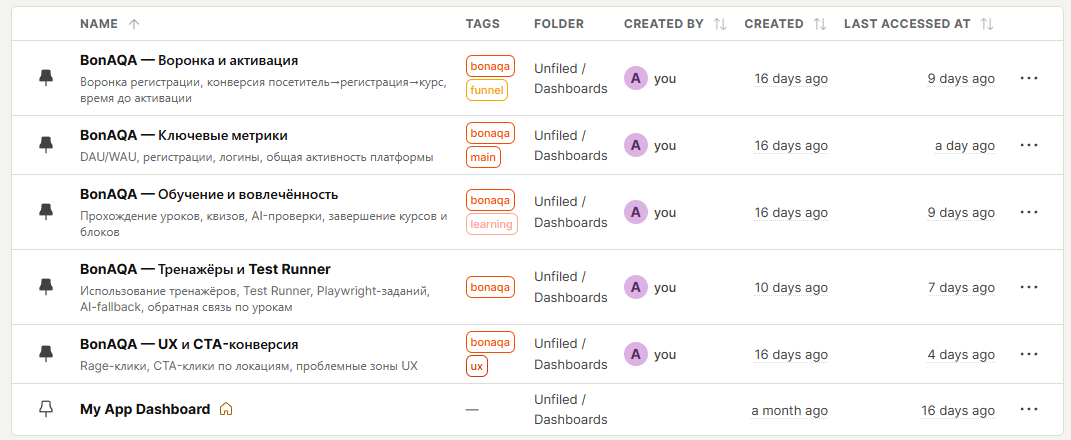

PostHog MCP |

Claude сам смотрит аналитику, строит дашборды, анализирует поведение пользователей. Я спрашиваю «какие страницы чаще всего закрывают?» — он идёт в PostHog и отвечает с цифрами |

|

Docker MCP |

Управление контейнерами. Хотя, честно, Claude и через терминал с Docker справляется нормально |

А вот момент, который меня РЕАЛЬНО удивил. Когда я впервые настраивал сервер для bonaqa — я просто дал Claude креды от SSH. Он подключился к серверу, настроил окружение, раскатил приложение, поднял Nginx — и всё заработало. Я сидел и смотрел как терминал сам печатает команды. Вот в этот момент я понял: это уже НЕ автодополнение кода. Это напарник, который умеет делать то, что раньше делал девопс.

Как выглядит типичная задача

Допустим, мне нужна система геймификации: XP за упражнения, уровни, лидерборд.

Шаг 1. Архитектура (я думаю, AI помогает)

Я описываю что хочу: «нужна XP-система. Пользователь получает очки за упражнения, квизы, streak. Есть уровни от 1 до 10 с разными порогами. Есть лидерборд с 6 лигами.»

AI предлагает схему БД, API-эндпоинты, формулы расчёта XP. Я корректирую: «лиги пересчитываются раз в неделю, не в реальном времени» — потому что я ПОНИМАЮ что real-time лидерборд на ранней стадии — оверинжиниринг.

Шаг 2. Код (AI пишет, я контролирую)

AI генерирует:

-

Prisma-схему для таблиц

user_xp,levels,leagues -

Express-эндпоинты:

POST /xp/add,GET /leaderboard,GET /user/level -

React-компоненты: прогресс-бар уровня, лидерборд с лигами, combo-анимации

Я НЕ беру это как есть. Проверяю edge cases: что будет если юзер наберёт XP больше максимума? Что если два юзера с одинаковым XP (тут про лидерборд)? Что если streak прерывается ровно в полночь по UTC?

(QA-мозг не выключается никогда)

Шаг 3. Интеграция (AI делает, я контролирую)

Модуль написан — теперь его надо вписать в существующую систему. И тут тоже работает AI. Claude Code читает всю кодовую базу, понимает структуру проекта и сам интегрирует новый код: подключает роуты, обновляет импорты, добавляет PostHog-события. Мне остаётся сказать «встрой это в проект» и проверить результат.

Шаг 4. Тестирование (я протыкиваю, AI ревьюит)

Сначала я прохожу базовые сценарии руками — протыкиваю основной flow, смотрю глазами, проверяю мобильную версию. Визуальная проверка — это то, что AI пока умеет плохо.

Но иногда я иду дальше. Прошу агента запустить MCP Playwright — и он сам заходит на сайт и проходит сценарии по моим инструкциям. Важный момент: я явно говорю ему «будь объективен, не льсти, твоя задача — найти недочёты, будь честен». Без этого AI склонен хвалить и говорить что всё отлично. С этим — выдаёт полезный фидбэк.

Ещё один приём, который я использую постоянно — миксовать агентов. Пишу код в Claude Code, а потом открываю отдельный чат в Cowork и говорю: «Представь что ты ученик, который выучил Python и хочет научиться автоматизации. Зайди на bonaqa.tech, пройди курс и дай мне честный фидбэк как пользователь». И получаю подробный разбор: что непонятно, где застрял, что бесит. Потом этот фидбэк закидываю обратно в Claude Code — мы разбираем его, составляем план, я валидирую, и дальше улучшаем.

Два разных AI в разных ролях дают результат лучше, чем один.

А дальше — два раунда AI-ревью кода:

-

Кастомный агент-ревьюер — мой собственный агент, который проводит код-ревью. Ищет баги, проблемы с безопасностью, edge cases.

-

/simplify— встроенная команда Claude Code. Ещё один проход: упрощение конструкций, поиск дублирования, рефакторинг.

Только после двух раундов ревью — коммит и пуш. Не раньше.

Итого по времени:

|

Этап |

Доля |

Кто делает |

|---|---|---|

|

Архитектура, проектирование |

20% |

Я + AI как собеседник |

|

Написание кода |

30% |

AI пишет, я направляю |

|

Интеграция |

15% |

AI интегрирует, я контролирую |

|

Тестирование + ревью |

35% |

Я протыкиваю + 2 раунда AI-ревью |

Если бы AI просто «писал код по промпту» — ничего бы не работало. Весь фокус в том, что я управляю процессом, а AI ускоряет исполнение.

Экономика: сколько стоит собрать продукт с AI

Все любят говорить «AI экономит время и деньги». Окей. Вот конкретные цифры.

Ежемесячные расходы

|

Статья |

Сумма |

|---|---|

|

Claude Max подписка |

$200/мес |

|

API OpenAI (AI-проверка кода студентов) |

~$0.02 за проверку |

|

Хостинг VPS |

1–3 тыс. ₽/мес |

|

Домен |

1 000–1 500 ₽/год |

Да, 200 в месяц за Claude Max — это не копейки. Но это цена ЦЕЛОЙ команды разработки: фронт, бэк, девопс, тестирование, копирайтинг. За 200. Студия за аналогичный проект берёт 400–700 тысяч рублей. Фрилансер — от 150–200К.

Время

|

Что |

Сколько |

|---|---|

|

MVP (основная функциональность) |

5 дней |

|

Геймификация + лидерборд |

1 день |

|

Админ-панель |

1 день |

|

DevOps (Docker, CI/CD, деплой) |

0.5 дня |

|

Итого |

~7 дней |

Это при условии, что я работал полный день (по вечерам/выходным реально 2–3 недели).

Скрытые расходы, о которых молчат

-

Твоё время. Подписка и хостинг — копейки по сравнению со студией, но я потратил неделю. Если считать по рыночной ставке, это тоже деньги.

-

Навыки. Я 4 года учился: тестирование, код, архитектура, DevOps. AI ускорил разработку в 3–5 раз, но без базы я бы не смог даже понять, что AI мне сгенерировал.

-

Ревью и контроль качества. AI пишет код, но нужен контроль — агент-ревьюер,

/simplify, ручное тестирование. Автоматизировал, но время всё равно уходит.

8 уроков, которые я вынес из разработки с AI

Это то, что я бы хотел знать до того как начал. Конкретные вещи, которые сэкономят тебе дни.

1. Не пытайся сделать всё сразу — начни с MVP

Если ты скажешь «напиши мне EdTech-платформу со всеми фичами» — AI утонет. Но если ты обсудишь с ним идею, вместе урежешь до MVP и скажешь «давай начнём с этого» — он соберёт рабочую версию.

Дальше — тестируешь, проверяешь, и потихоньку добавляешь фичи. Можно большими кусками. Но всё сразу, как ты представляешь в голове — пока не получится.

(Кстати, буквально на днях в Claude Code добавили контекст в 1 миллион токенов для подписчиков MAX. Это сильно меняет дело — AI держит в голове намного больше.)

2. Всегда начинай с плана

Самая дорогая ошибка — начать кодить без плана. AI с радостью напишет тебе 500 строк, которые потом придётся выбросить, потому что ты не подумал о структуре.

Мой подход: в Claude Code есть режим планирования. Прошу составить план, вычитываю его, корректирую — и только потом нажимаю «приступить к работе». Это занимает 10 минут, но экономит часы переделок.

3. AI галлюцинирует. Уверенно. С улыбкой.

AI не столько врёт, сколько галлюцинирует — может уверенно написать код с несуществующим API или устаревшим синтаксисом. Выглядит убедительно, работает — нет.

Что помогает: в сложных задачах просить AI сначала поискать актуальную информацию в интернете. Ещё лучше — скинуть ему ссылку на документацию. Он прочитает доку и сделает правильно. Без доки — может нафантазировать.

Правило: НИКОГДА не пускай код AI в прод без проверки. У меня для этого два раунда AI-ревью (кастомный агент + /simplify) и ручное протыкивание. Один AI пишет, другой проверяет — и даже после этого баги находятся.

Тут мой QA-бэкграунд — суперсила. Я знаю ГДЕ искать и ЧТО ломать.

4. AI сильнее в бэкенде, чем во фронтенде

Вот чего я не ожидал. AI ОТЛИЧНО пишет бэкенд — API, базы данных, бизнес-логику, авторизацию. Там всё чётко: входные данные → обработка → результат. AI это понимает.

А вот с фронтендом — сложнее. AI может сверстать компонент, но он не понимает что такое хороший UX. Не чувствует, что кнопка слишком далеко от поля ввода, что анимация отвлекает, что на мобильном всё поехало. Он не «видит» интерфейс глазами пользователя.

Ты можешь скормить ему макет из Figma — и он соберёт что-то похожее. Но «похожее» и «удобное» — это разные вещи. Фронтенд после AI всегда требует ручной доводки: spacing, адаптив, микроанимации, тактильные ощущения от интерфейса.

Правило: бэкенд AI-у можно доверить на 70–80%. Фронтенд — на 40–50%, остальное доводишь руками и глазами.

5. Prisma + PostgreSQL — комбо для соло-разработчика

Если ты строишь продукт один — Prisma решает проблему «мне лень писать SQL». Типизированные запросы, автоматические миграции, визуальная студия для БД. AI отлично генерирует Prisma-схемы, лучше чем сырой SQL.

6. Rate limiting на AI-эндпоинты — ставь СРАЗУ

Я встроил GPT-4o для проверки кода студентов. Каждая проверка — ~$0.02. Звучит дёшево, пока кто-нибудь не начнёт дёргать эндпоинт 1000 раз.

Реализация: лимит проверок на пользователя в день + debounce на фронте + серверный rate limit. Ставь ДО продакшена, не после.

7. Геймификация — это не «добавить XP»

Я думал: «кину XP за упражнения и будет вовлечение». Нет. Геймификация работает когда есть петля обратной связи: действие → награда → мотивация → действие.

В bonaqa это:

-

Combo-система — серия правильных ответов даёт множитель XP + конфетти + звук

-

Streak — заходи каждый день, не теряй серию (привет, Duolingo)

-

Лиги — соревнуйся с другими, пересчёт каждую неделю

-

Маскот Bonnie — реагирует на твои действия (хвалит, подбадривает, расстраивается)

Каждый элемент по отдельности — ерунда. Вместе — система.

8. Релизь сырое. Дорабатывай в проде.

bonaqa v1 была корявая. Дизайн поехал на мобильных, пара багов в лидерборде, тексты сырые. Я ЗАПУСТИЛ. Потому что идеальный продукт, который живёт только на localhost — это не продукт, а хобби.

Собери MVP → покажи людям → собери фидбэк → улучшай. Не наоборот.

Манифест

Вот во что я верю после 5 лет в IT и 3 лет с AI:

1. Решай свою боль. Все мои продукты начинаются с личной проблемы. bonaqa появилась потому что я сам когда-то искал платформу для обучения автоматизации — и не нашёл нормальной. Не исследование рынка, не «анализ ниши» — конкретная боль, которую решаю для себя.

2. Запускай быстро. Один человек с AI может выпускать продукты с невероятной скоростью. Образовательная платформа за неделю — это не предел. Но скорость имеет смысл только если ты ЗАПУСКАЕШЬ. Идеальный продукт в голове стоит ровно ноль.

3. Строй открыто. Весь процесс на виду: что строю, как строю, где облажался. Прозрачность = доверие. И это НЕ маркетинговая стратегия — мне реально проще строить, когда кто-то наблюдает.

4. Вайбкодинг — это не промпт-инженерия. Это инженерия с AI как вторым мозгом. Ты должен понимать архитектуру, паттерны, тестирование, деплой. AI ускоряет в 3–5 раз то, что ты и так умеешь делать. Он не даёт тебе навыки, которых у тебя нет.

Что делать, если хочешь попробовать

Конкретный план. Без воды.

Неделя 1: Выбери боль

У тебя есть проблема, которую ты решаешь руками / скриптами / Excel-таблицами? Вот это и строй. Не ищи «перспективную нишу». Строй то, чем будешь пользоваться сам.

Неделя 2: План за вечер

Открой Claude Code. Опиши продукт в 5 предложениях. Попроси составить план в режиме планирования — схему БД, API-эндпоинты, стек. Вычитай, скорректируй, зафиксируй. Только потом — код.

Неделя 3–4: Собирай MVP

Минимум функций, которые решают задачу. Не добавляй авторизацию, пока нет основной логики. Не делай дизайн, пока нет функционала. Каждый вечер — одна фича.

Неделя 5: Запускай

Деплой на VPS (1–3 тыс. ₽/мес) или Vercel (бесплатно). Я сам тестирую оба подхода: bonaqa целиком на VPS через GitLab CI/CD, а oboje.dev целиком на Vercel. Покажи друзьям. Покажи в комьюнити. Собери первый фидбэк.

Стартовый стек для соло-разработчика (мой выбор):

|

Слой |

Технология |

Почему |

|---|---|---|

|

Фронт |

React + Vite |

Быстрый, AI отлично знает React |

|

Бэк |

Node.js + Express |

Один язык для фронта и бэка |

|

БД |

PostgreSQL + Prisma |

Типизация, миграции, AI хорошо генерирует схемы |

|

БД (альтернатива) |

Supabase |

Все советуют для вайбкодинга: БД + auth + аналитика из коробки. Сам пока не пробовал, но слышу про него отовсюду |

|

AI |

Claude Code (+ MCP) |

Код прямо в проекте, с контекстом, подключение к внешним сервисам |

|

Деплой |

GitLab CI/CD + VPS или Vercel |

bonaqa — Docker на VPS через GitLab. Сайт oboje.dev — Vercel. Тестирую оба подхода |

|

|

Resend |

Транзакционные письма без боли |

|

Аналитика |

PostHog (бесплатный тир) |

Понимать что юзеры делают |

Что дальше

3 года назад я написал первую статью про ChatGPT в тестировании. Она была наивная, но честная.

Эта статья — тоже честная. Только теперь ставки выше.

Я строю свои продукты. Пока без дохода. Пока параллельно с наймом. Пока на ранней стадии. Но я строю — и делюсь процессом.

Если тебе близко — я веду Telegram-канал, где выкладываю всё: цифры, код, факапы, хот-тейки. Без инфобизнеса. Без «купи мой курс». Просто разработчик, который строит своё и рассказывает как есть.

@obojedev — в Telegram, Threads, везде.

А статья 2023 года пусть остаётся. Как напоминание, с чего всё начиналось.

Если понравилось — поддержите статью. Если не понравилось — напишите почему.

Автор: obojealexander