Хабр, привет! Меня зовут Вика Дочкина, я работаю в Сбере и пишу диссертацию на тему автономных AI-систем.

Роли, отделы, департаменты, иерархии, должностные инструкции, процессы — всё это придумано для людей. Для нас: с одной специализацией (реже – несколькими), 8 часами продуктивности в день, невозможностью удержать в голове контекст всей организации и месяцами на смену профессии.

У LLM-агента ни одного из этих ограничений нет. Он мгновенно меняет специализацию. Он видит полный контекст. Он не потребляет ресурсы, когда не работает. Зачем тогда переносить на него человеческую оргструктуру?

Мы 6 месяцев проверяли эту гипотезу. 25 000 задач. 8 моделей. До 256 агентов. Больше миллиарда токенов.

Результат: назначать роли и выстраивать иерархии для ИИ-агентов — антипаттерн. Система, где агенты сами решают кем быть, превосходит систему с внешним координатором на 14% (p < 0.001). И чем сильнее модель — тем больше автономии она может себе позволить. Мы наблюдаем начало тренда, который может изменить сам подход к проектированию AI-организаций будущего.

Что вы узнаете из этой статьи:

-

Почему система без назначенных ролей работает лучше, чем с координатором

-

Как 8 агентов изобрели 5 006 уникальных специализаций — и ни одна не повторилась дважды в 54% случаев

-

Зачем агенты добровольно отказываются от задач — и почему это повышает качество

-

Какие свойства модели определяют, способна ли она к самоорганизации

-

Что это значит для тех, кто строит мультиагентные системы прямо сейчас

Препринт: arXiv:2603.28990

Масштаб эксперимента

|

|

|

|---|---|

|

Задач |

25 000+ |

|

Моделей |

8 — Claude, GPT-5.4, GPT-4o, GPT-4.1-mini, DeepSeek v3.2, GLM-5, Gemini-3-flash, GigaChat 2 Max |

|

Агентов |

от 4 до 256 |

|

Протоколов |

8 (4 основных + 4 биоинспирированных) |

|

Сложность задач |

4 уровня — от «проверь API» до «CEO vs Legal vs CFO» |

|

Токенов |

>1 млрд |

Качество каждого решения оценивала независимая модель-судья по 5 критериям (точность, полнота, связность, применимость, соответствие миссии). Итоговая метрика Q — от 0.25 до 1.0. Чем выше, тем лучше.

Как улучшать AI-агентов: вертикально и горизонтально

Сейчас в области AI-агентов активно развиваются два направления:

Вертикальное — как сделать каждого агента сильнее. Сюда относятся самосовершенствующиеся системы вроде Hyperagents, Ouroboros, EvoAgent, ADAS — агент рекурсивно улучшает сам себя.

Горизонтальное — как группа агентов координируется вместе. Не один агент становится умнее, а многие агенты начинают работать как единое целое.

Наше исследование затрагивает оба направления — мы тестировали в том числе эволюционные алгоритмы и биоинспирированные протоколы — но основной фокус на горизонтальной координации. Направления дополняют друг друга: чем сильнее каждый агент, тем больше он выигрывает от самоорганизующихся протоколов.

Четыре способа организовать команду агентов

Главная переменная — как агенты общаются. Модель, задачи, количество — одинаковые.

🏢 Coordinator (координатор): Агент-0 анализирует задачу, назначает роли остальным, они выполняют параллельно.

🔗 Sequential (конвейер): Агенты работают по очереди. Каждый видит, что конкретно сделали предыдущие, и сам решает — кем быть и стоит ли вообще участвовать.

📡 Broadcast (сигнальный): Все объявляют намерения, потом корректируют с учётом друг друга.

🌊 Shared (независимый): Общая память, полная независимость, одновременные решения.

GIF: Слева — самоорганизация (Sequential, Q=0.938): агенты формируют распределённую сеть. Справа — координатор (Q=0.812): Agent 0 — центральный хаб, единая точка отказа

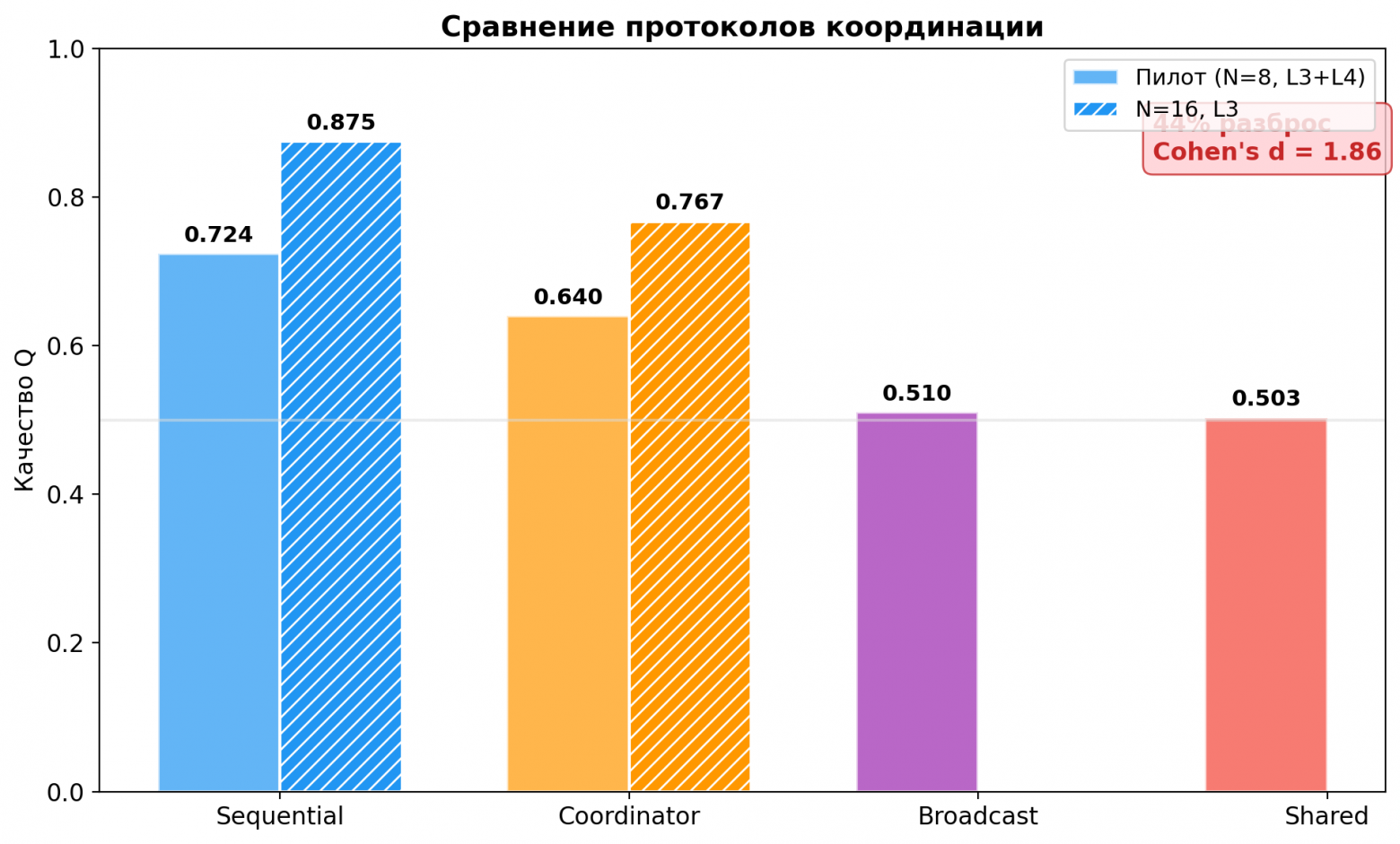

Результат: самоорганизация уже работает

|

Протокол |

Качество Q |

|---|---|

|

🔗 Sequential |

0.724 |

|

🏢 Coordinator |

0.640 |

|

📡 Broadcast |

0.510 |

|

🌊 Shared |

0.503 |

N=8, GPT-4.1-mini. Разница между лучшим и худшим: 44%, Cohen’s d = 1.86

При масштабировании (N=16, Claude, сложные задачи):

-

Sequential: Q = 0.875

-

Coordinator: Q = 0.767 (+14%, p < 0.001)

Сравнение качества по четырём протоколам: пилот (N=8) и масштаб (N=16, Claude)

А вот как это выглядит изнутри — гифка Sequential-протокола на задаче L3:

GIF: Самоорганизация (Sequential) — агенты формируют роли, распределяют задачи, 15 из 16 участвуют, 1 воздержался

Для сравнения — тот же эксперимент с координатором:

GIF: Координатор (Coordinator) — Agent 0 раздаёт роли, все связи идут через него

Почему Sequential побеждает?

Дело в типе информации. Каждый агент видит факт — что конкретно уже сделано. Не чьи-то намерения (Broadcast — могут измениться). Не историю прошлых задач (Shared — может быть нерелевантна). Не план одного координатора (Coordinator — может ошибиться). А реальные завершённые результаты предшественников.

5 006 уникальных ролей у 8 агентов

Это число, которое удивило нас больше всего.

8 агентов. Несколько сотен задач. И они изобрели 5 006 уникальных названий ролей. При 64 агентах — 5 010 (разница 0.1%!). 54% ролей использованы ровно один раз.

Агенты не «специализируются». Они каждый раз заново определяют свою функцию исходя из контекста задачи.

GIF: Слева — Sequential (каждый цвет = уникальная роль, Q=0.938). Справа — Coordinator (Agent 0 всегда красный «координатор», Q=0.812). Роли в Sequential меняются каждую задачу

LLM-агент не ограничен телом, фиксированными навыками, когнитивными лимитами. Зачем ограничивать его назначенной ролью?

Умный агент знает, когда промолчать

В Sequential 38 из 60 неактивных агентов отказались от участия добровольно: «Всё ключевое уже покрыто, я не могу добавить ценности». В Coordinator все 60 были отстранены решением координатора.

И вот что важно: система, где агенты сами молчат, работает лучше (Q = 0.875), чем система, где за них решает координатор (Q = 0.767).

*Система сама определяют необходимое количество и состав агентов для решения задачи

Claude отказывается от 8.6% задач — осознанно. Это оптимальный уровень.

В обычной компании сотрудник в простое продолжает получать зарплату. Или, что хуже, «придумывает себе работу». Агент, решивший не участвовать, не тратит ни одного токена.

Масштабирование: 256 агентов, качество не падает

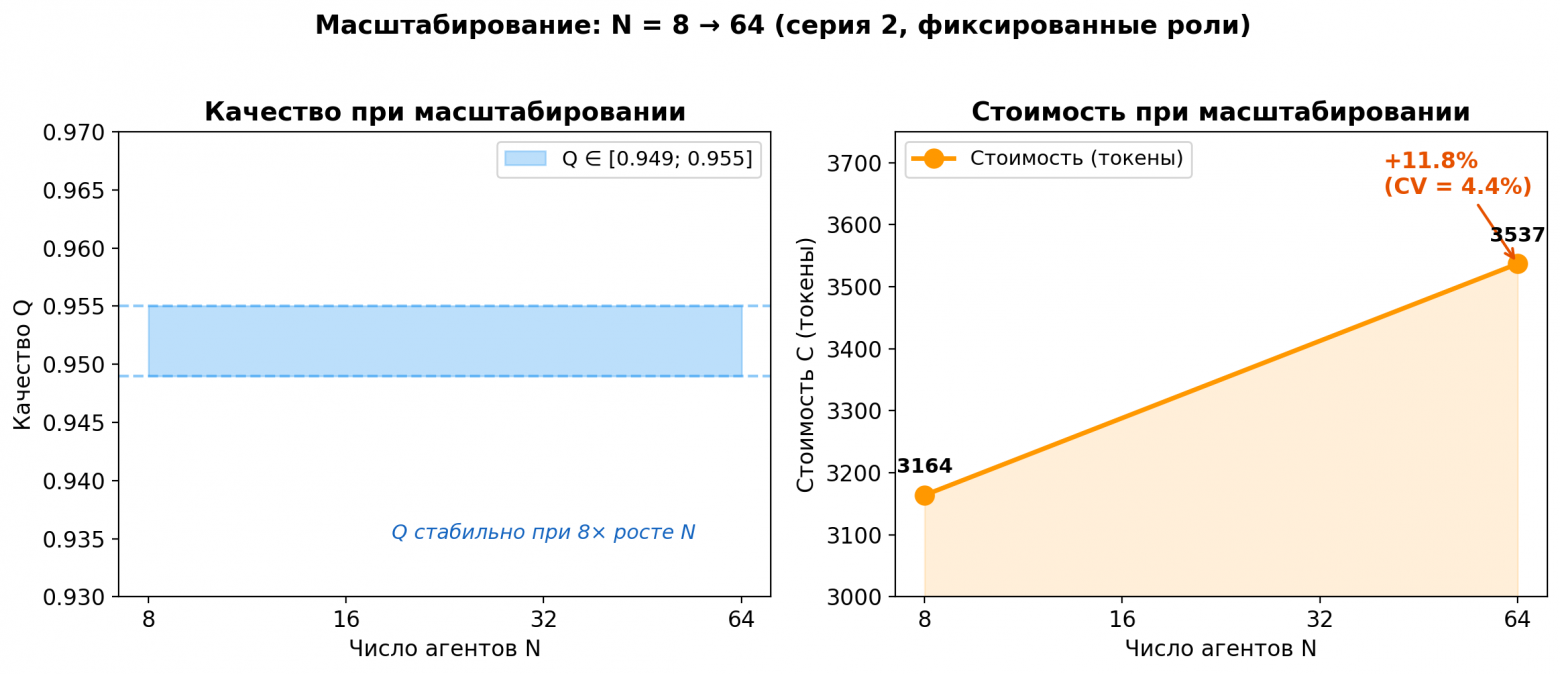

|

N |

Качество Q |

Стоимость |

|---|---|---|

|

8 |

0.954 |

3 164 токена |

|

64 |

0.949 |

3 537 токенов |

|

256 |

0.967 |

— |

При 8-кратном росте стоимость выросла на 11.8%. Качество — в пределах шума (p=0.61 для 64→256). При N=256 ~45% агентов уходят в самоотвод — система сама оптимизирует расходы.

Качество стабильно при росте от 8 до 64 агентов, стоимость растёт лишь на 11.8%

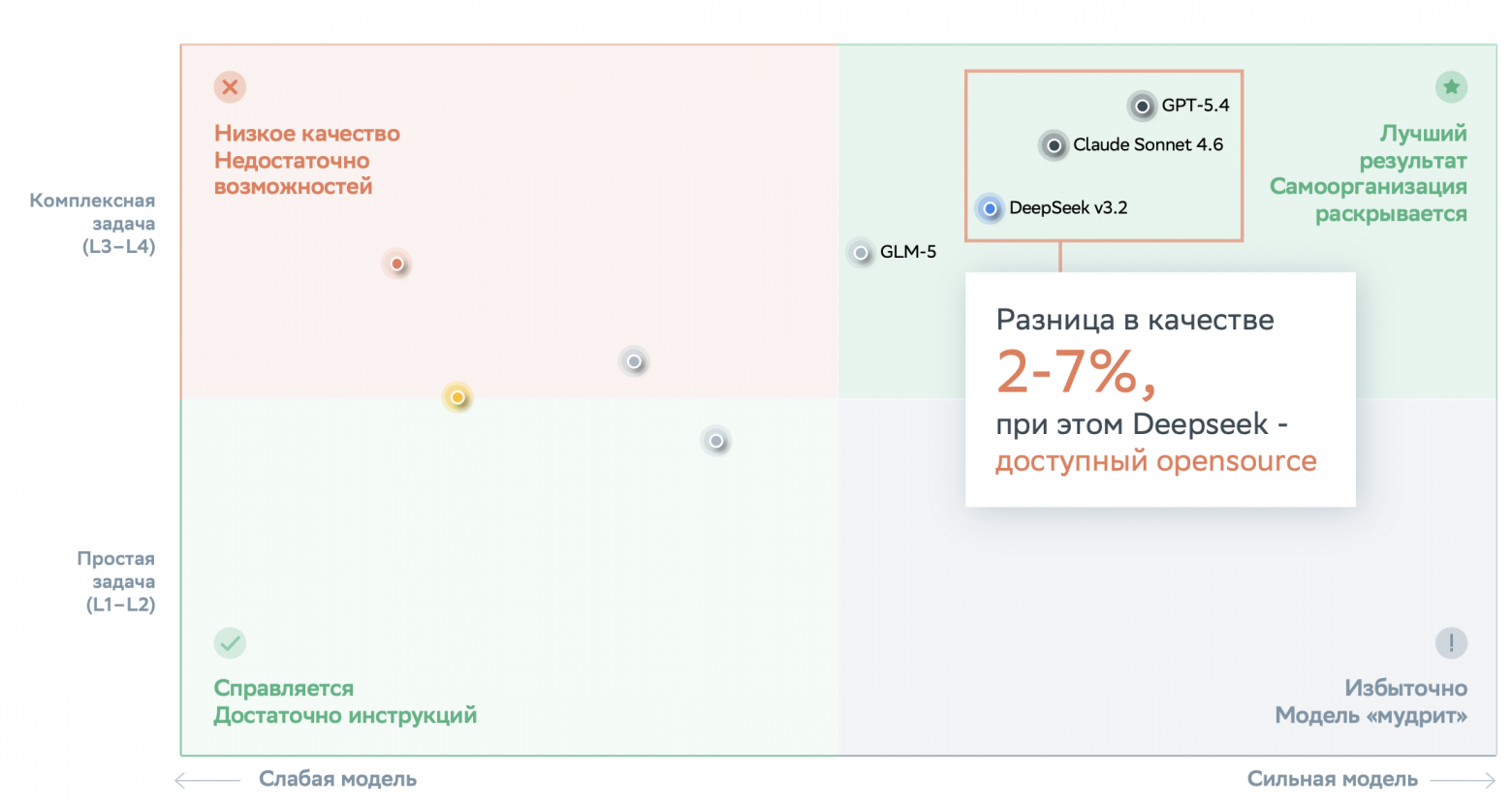

DeepSeek = 95% Claude за 1/24 цены

|

Модель |

Q (сложные задачи) |

Стоимость |

|---|---|---|

|

Claude Sonnet 4.6 |

0.875 |

$$$ |

|

DeepSeek v3.2 |

0.829 |

~$$$/24 |

|

GLM-5 |

0.800 |

~$$$/20 |

На состязательных задачах (CEO vs Legal vs CFO) DeepSeek даже обгоняет Claude: +6.0%.

Соответствие миссии: 4.00 из 4.00 у обоих. Агенты работают на цель.

*сложность задачи vs сила модели

Чем сильнее модель — тем больше автономии

Мы наблюдаем чёткий тренд: степень автономии, которую система может себе позволить, растёт вместе со способностями модели.

|

Модель |

При автономии |

При фиксированных ролях |

Тренд |

|---|---|---|---|

|

Claude |

Q = 0.594 (лучше +3.5%) |

Q = 0.574 |

Автономия уже помогает |

|

GLM-5 |

Q = 0.519 |

Q = 0.574 (лучше +10.6%) |

Пока нужна структура |

Claude уже выигрывает от свободы. GLM-5 пока нет — но с каждым поколением моделей порог самоорганизации снижается. Sequential — это не потолок автономии, а ступенька: минимальный каркас (очерёдность), внутри которого агенты уже полностью свободны в выборе ролей, участия и стратегии.

Какие свойства модели определяют способность к самоорганизации?

-

Reasoning — способность выстраивать цепочки рассуждений, а не давать поверхностный ответ

-

Self-reflection — способность оценить собственную компетентность и вовремя отказаться от задачи (Claude: 8.6% осознанных самоотводов, GLM-5: 0.8%)

-

Instruction following — точное следование протоколу координации на каждой итерации

-

Structured output — стабильная генерация в заданном формате без потери структуры после нескольких раундов

Модели, у которых эти свойства развиты (Claude, DeepSeek), успешно самоорганизуются. Модели без них — нуждаются во внешней структуре.

По мере того как модели становятся сильнее по всем четырём осям, им нужно всё меньше внешней структуры. Sequential — первый работающий протокол самоорганизации. Следующие поколения моделей смогут больше.

Сложность задач: система сама углубляет иерархию

Качество падает от L1 к L4 (−37.7%), но иерархия спонтанно углубляется: 1.22 → 1.56

GIF: Как выглядит Sequential на задачах разной сложности — L3 (многоэтапная) vs L4 (состязательная)

Чем сложнее задача, тем глубже структуру выстраивают агенты — без внешних инструкций. Система адаптируется к сложности сама.

Три ингредиента

25 000 задач. 8 моделей. 256 агентов. 8 протоколов. Рецепт:

① Миссия — зачем система существует. Mission Relevance = 4.00/4.00 у лучших моделей при самоорганизации.

② Протокол — как агенты обмениваются информацией. Sequential побеждает Coordinator на 14%.

③ Сильная модель — без неё протокол не раскрывается. Разрыв между моделями — до 174%.

Ни один из трёх пунктов — не «назначь агенту роль». Агент в самоорганизующейся системе — не сотрудник с должностью, а инструмент, который система создаёт, настраивает и использует (или не использует) под конкретную задачу.

Конституция AI-организации

Самоорганизация работает лучше всего с минимальными, но чёткими границами. Sequential — пример: одно простое ограничение (очерёдность) раскрывает полный потенциал автономии агентов (Q=0.875).

🔴 Ядро — миссия, ценности. Только человек. 🟡 Стандарты — метрики, аудит. Человек + система. 🟢 Протоколы — тактические параметры. Полная автономия с A/B тестами.

Принцип: чем ближе к «зачем» — тем больше человека. Чем ближе к «как» — тем больше автономии.

Что делать прямо сейчас

-

Не назначайте роли. 5 006 уникальных ролей у 8 агентов — агенты находят лучшие роли, чем вы можете придумать.

-

Используйте Sequential. Агенты по очереди, каждый видит результаты предыдущих. ~50 строк кода. +14% качества.

-

Масштабируйте моделью, не агентами. 64→256 не даёт прироста. Разница между моделями — до 174%.

-

Комбинируйте модели. DeepSeek для L1–L2, Claude для L3–L4. 95% качества за 1/24 цены.

-

Разрешите агентам отказываться. Агент, который знает, когда промолчать — ценнее, чем тот, кто всегда отвечает.

Что дальше

Прямо сейчас мы тестируем результаты этого эксперимента на реальной бизнес-задаче — переносим Sequential-протокол и принципы самоорганизации из лаборатории в рабочий контур. Через 3 месяца расскажем: какие из этих выводов подтвердились «в бою», что пришлось адаптировать, и что нового мы обнаружили, когда агенты встретились с настоящими данными и реальными ограничениями.

Подписывайтесь, чтобы не пропустить продолжение.

Ссылки

-

Препринт: arXiv:2603.28990*

Это часть кандидатской диссертации в МФТИ. Вопросы, критика, запросы на код — в комментарии.

Теги: машинное обучение, искусственный интеллект, LLM, мультиагентные системы, самоорганизация, AI agents, DeepSeek, Claude, GPT, координация

Автор: dochkinavika