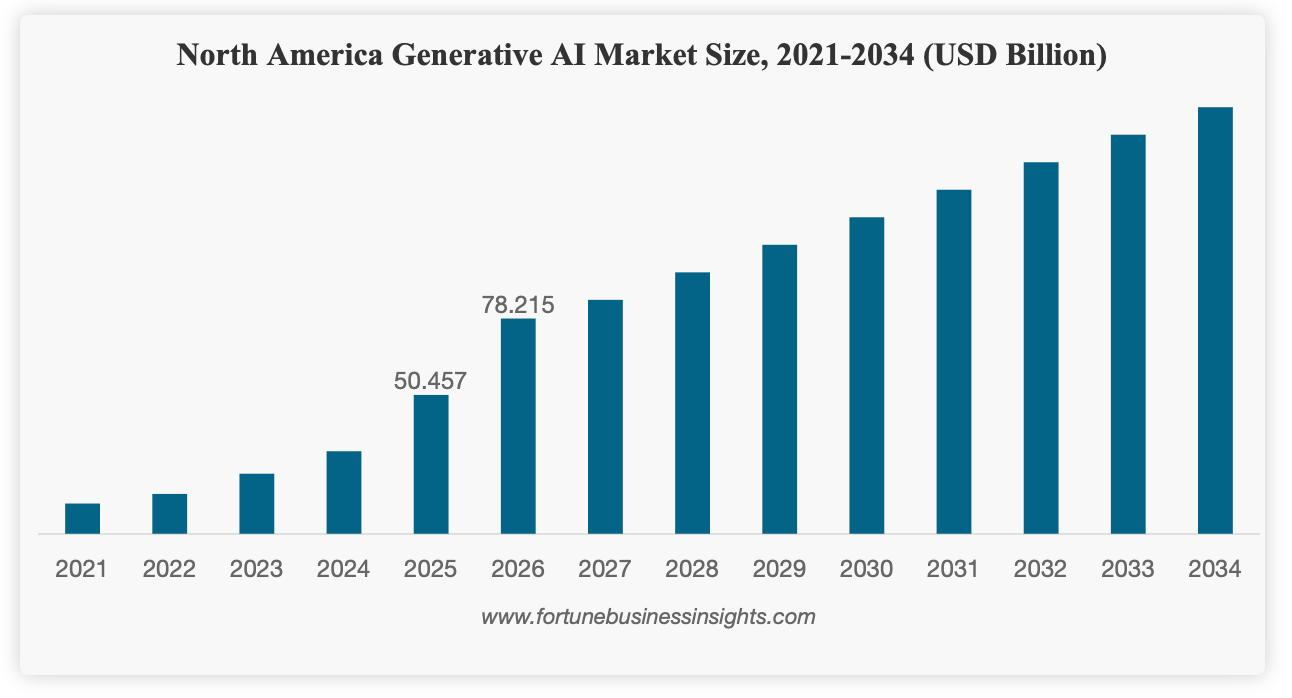

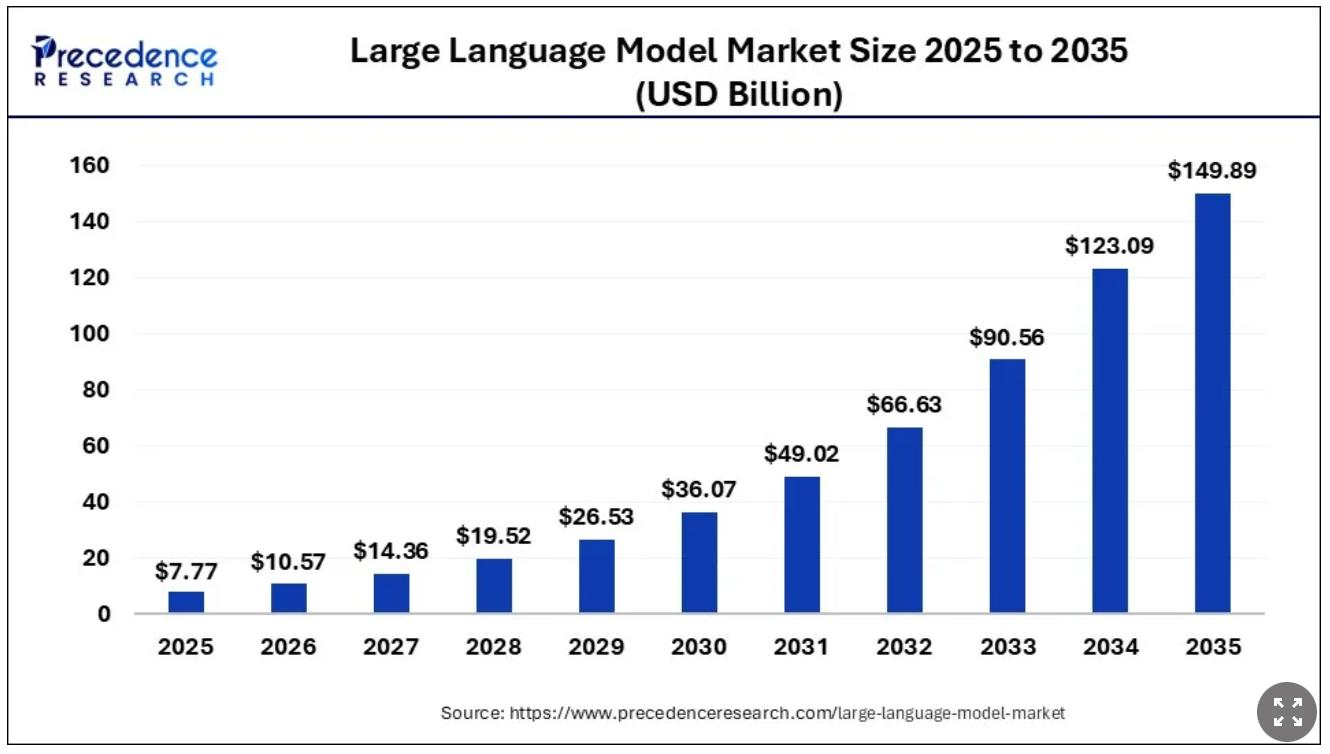

Как далеко вперёд собирается рынок?

Цифры и впечатляют, и оставляют за собой кучу вопросов одновременно:

-

Глобальный рынок генеративного ИИ растёт кратно: оценки доходят до $1,3–1,5 трлн к 2032–2035 году

-

Только рынок LLM прогнозируется на уровне $149+ млрд к 2035 году

-

В России — рынок ИИ уже измеряется сотнями миллиардов рублей и растёт двузначными темпами ежегодно

-

И главное — каждый третий пользователь уже использует ИИ для принятия решений (покупки, выбор подрядчиков, анализ)

-

58% потребителей уже заменяют традиционные поисковики генеративным ИИ при поиске рекомендаций товаров и услуг, а 71% хотят видеть такие инструменты встроенными в покупательский опыт.

«Новый канал» пока не признается (а надо бы), но на это нужно время. Но признать, что отношение к информации и ее подача изменилось — уже точно пора всем.

Раньше пользователь:

→ открывал поиск

→ сравнивал ссылки

→ принимал решение вымученное самостоятельно

Сейчас:

→ задаёт вопрос

→ получает готовый ответ

→ действует

И вот: привычная логика уже не такая привычная. SEO разрастается до GEO: SEO + PR + репутационный маркетинг.

Ладно, это было долгое лирическое вступление. Тому, как это работает, почему классическое seo будет жить какими знаниями надо обладать, чтобы не поддаться фанатизму и хаосу я уже писал. А вот, почему конкретные нейросети ChatGPT, Алиса, Gemini и другие выбирают одни источники и игнорируют другие. Поговорим о факторах присутствия в ответах конкретных ИИ-систем:

-

что влияет на попадание в ответы Яндекс.Алисы;

-

что важно для ChatGPT;

-

чем отличается логика Perplexity, Claude, Gemini и GigaChat;

-

и почему классическое SEO здесь помогает только частично, а дальше начинаются уже другие механики: retrieval, доверие к источнику, структура контента, цитируемость, локальные экосистемы и семантическая извлекаемость.

Общеобразовательный дисклеймер

Делаю его к каждому материалу по GEO, потому что восприятие инструмента сейчас крайне туманное — с одной стороны очарование ИИ, с другой вся его подноготная (как использовать? Насколько широко использовать? и так далее).

Смотрите, главная ошибка — попытка сравнивать GEO с другими источниками трафика

Интернет пришлось отучать от вечного противодействия SEO и контекста. И то — по сей день маркетологи разводят эти понятия. А вокруг новых инструментов еще больше загадок и вопросов, веры и надежды в конце концов)

GEO проще воспринимать как слой интерпретации поверх уже существующего информационного поля.

LLM не ранжируют страницы в привычном смысле. Они работают с распределением вероятностей: какие факты, формулировки и сущности чаще всего встречаются вместе, в каком контексте и с какой тональностью. Фактически, ответ — это не выбор “лучшего результата”, а сборка наиболее вероятной версии реальности на основе доступных сигналов.

Отсюда и начинаются все недопонимания. В генеративной выдаче модель не смотрит на страницу как на единицу, она видит фрагменты, повторяющиеся паттерны и связи между источниками. Если эти паттерны не сходятся — вы и в ответ не попадете.

Консенсус, коллеги. Не в смысле одинаковых текстов, а в смысле совпадающих смыслов. Когда несколько независимых источников описывают вас схожим образом, это превращается в устойчивый сигнал. Когда описания расходятся — модель начинает сглаживать формулировки или уходит в неопределённость. Когда негатив системно повторяется — он почти неизбежно попадает в ответ, даже если у вас идеальный сайт.

При этом сама выдача по своей природе нестабильна. Один и тот же вопрос не имеет фиксированного ответа — модель каждый раз пересобирает его заново (стохастичность). Вместо идеи о “позиции” появляется вероятность присутствия: насколько часто вы оказываетесь внутри ответа при разных формулировках, сценариях и контекстах. И это гораздо более сложная метрика, потому что она зависит не только от вас, но и от структуры всего информационного поля вокруг темы. Более того: ваше семантическое ядро, по-хорошему, разрастается тысяч и десятков тысяч запросов.

Кстати, о семантике: дополнительное усложнение даёт поведение пользователя. Всё больше запросов превращается в описание задачи: с условиями, ограничениями, уточнениями. В том числе, из-за ИИ-ответов. Внутри одного диалога возникает несколько подтем, и модель фактически проводит серию микропоисков, объединяя их в один ответ. В этой логике конкуренция идёт не за ключевую фразу, а за покрытие сценария — насколько ваш контент способен закрыть разные аспекты одного и того же вопроса.

При всей новизне интерфейса и процесса, фундамент остаётся прежним. Большинство систем опираются на документы, полученные через поиск. Это может быть Google, Bing, Яндекс или их внутренние индексы, но принцип один: сначала находится пул источников, затем из них собирается ответ. Поэтому просадки в классическом SEO часто синхронно отражаются в генеративной выдаче. Это не всегда линейная зависимость, но корреляция наблюдается регулярно.

И, пожалуй, самая спорная и неоднозначная часть — измеримость. У нас нет доступа к реальным пользовательским сценариям, нет полной статистики показов и нет нормального трекинга переходов. Даже там, где появляются отчёты (например, по взаимодействию с AI-поиском), речь идёт уже о переработанных запросах, а не о том, что вводит пользователь. В итоге приходится работать с косвенными метриками: доля упоминаний, частота появления бренда в ответах, тональность, сравнительное присутствие относительно конкурентов. По сути, мы измеряем не результат, а вероятность его возникновения. В защиту скажу: полгода назад и этого не было — все ответы замерялись вручную. Да и utm с нейронок начали уже выкатывать (наконец-то). Так что те, кто любит быть в авангарде поймёт) в том числе, оценит весь шарм ситуации и примет меры.

GEO — это задача управления присутствием в информационном поле: насколько согласованно вы описаны, насколько часто повторяетесь в разных источниках, насколько легко ваши формулировки извлекаются и встраиваются в ответ. Об этом дальше и чуть подробнее.

В заблокированной от интернета России, бизнесу правда стоит присмотреться к инструменту GEO. По сути, вы делаете то, что пришлось бы делать для бизнеса в любом случае, только более согласованно (seo+pr+репутационный маркетинг). Это 3 столпа, остальное сейчас либо дорого, либо недоступно. Think about it) А мы переходим к основному материалу.

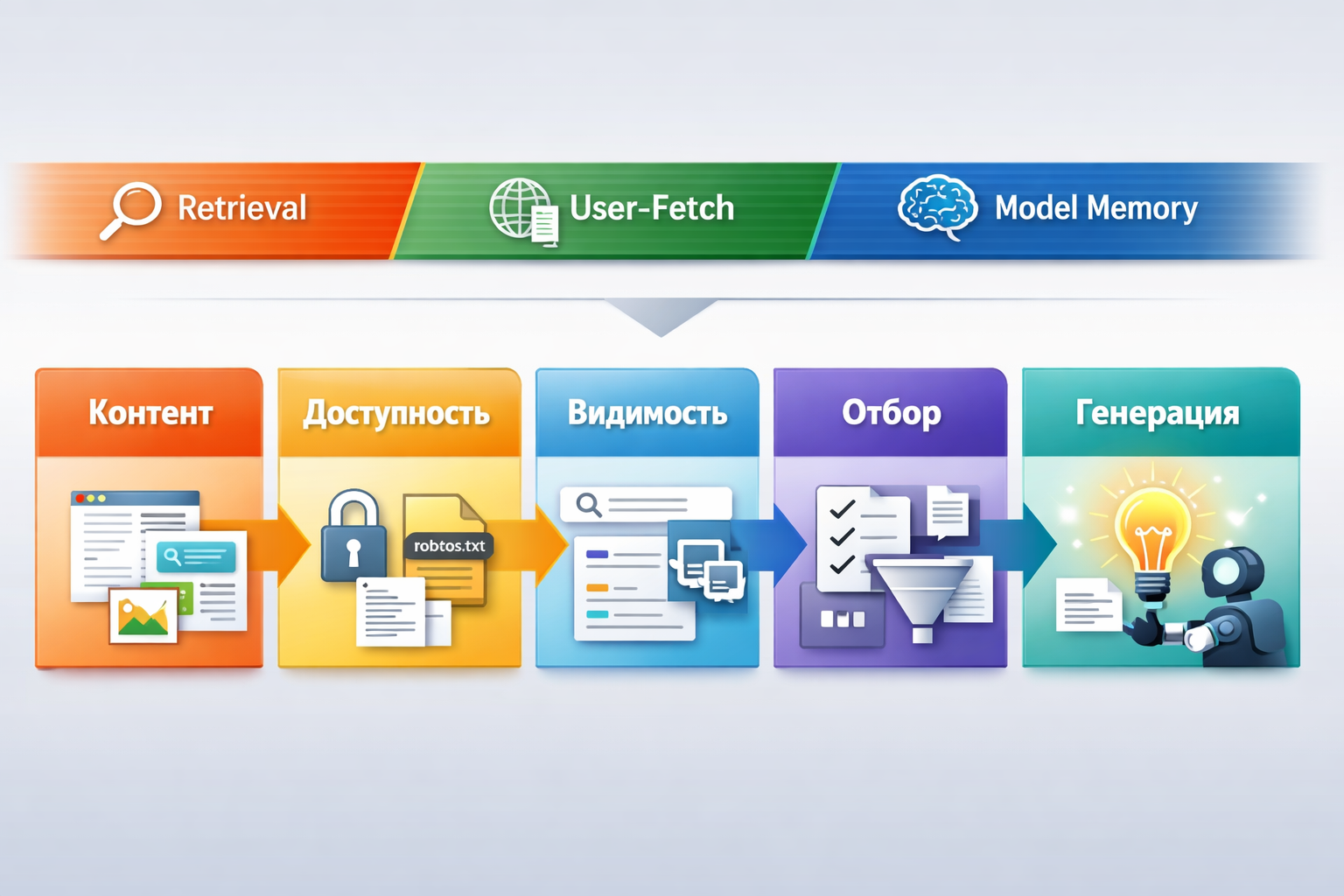

Как вообще формируется ответ нейросети

В большинстве сценариев нейросеть ответ собирает. Причём собирает не из одного источника, а из комбинации нескольких слоёв данных.

В основе — три механизма, которые вместе формируют ответ:

1. Retrieval (поиск → генерация)

Это основной сценарий сегодня. Система сначала находит документы, затем собирает из них ответ.

-

Яндекс.Алиса опирается на поисковый индекс Яндекса

-

ChatGPT и Perplexity используют собственные retrieval-слои и веб-доступ

-

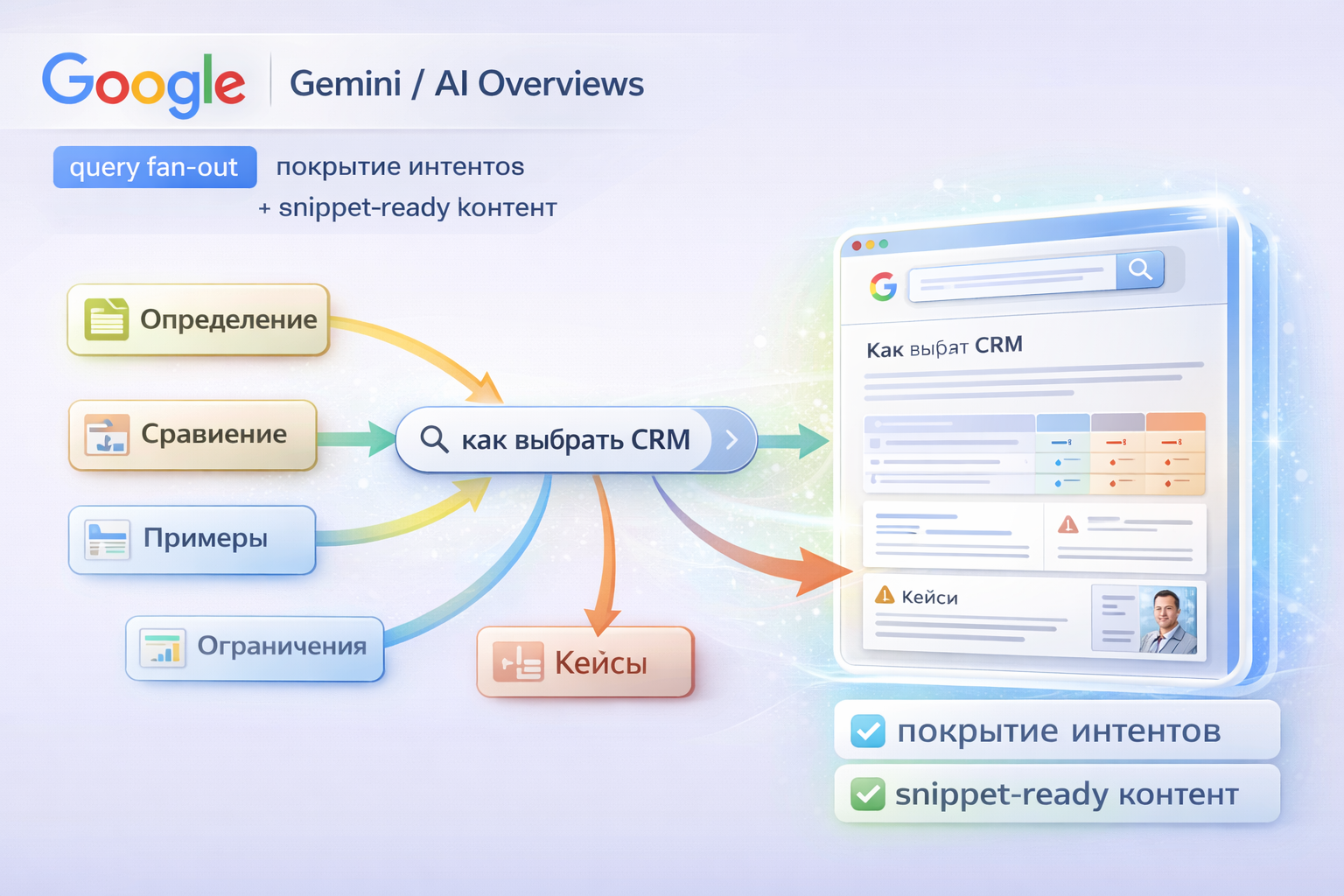

Google прямо описывает процесс как серию поисков по под-интентам (query fan-out)

2. Прямой доступ (user-fetch)

В ряде сценариев модель может получить страницу напрямую — как будто это сделал пользователь.

-

используются отдельные user-агенты (например, ChatGPT-User)

-

ограничения robots.txt могут не срабатывать так же, как для поисковых ботов

Это менее очевидно, но расширяет зону доступности контента.

3. Данные обучения (model memory)

Это слой, который формирует базовые знания модели.

-

данные собираются через специализированные боты (GPTBot, ClaudeBot и др.)

-

влияние — долгосрочное, а не оперативное

Управлять этим слоем напрямую почти невозможно, но он влияет на «узнаваемость» тем и источников.

Если собрать это в одну цепочку, получается следующая логика:

контент → доступность → видимость → отбор источников → генерация

И на каждом этапе можно выпасть.

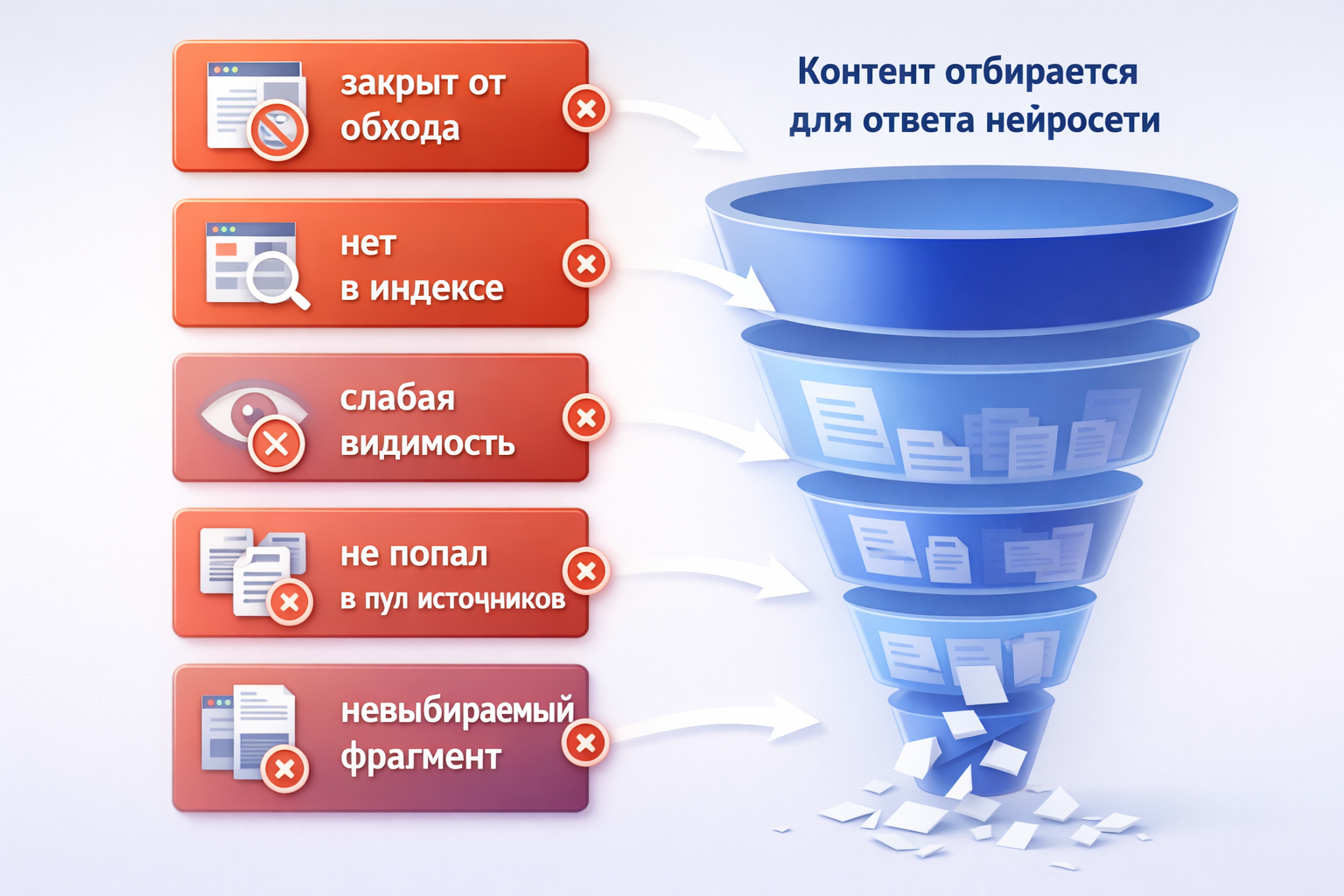

Из-за чего именно можно выпасть даже из выбора?

Доступность: если страница закрыта от обхода или не индексируется, она просто не участвует в процессе. Нюанс: при блокировке через robots.txt модель может даже не увидеть мета-теги страницы.

Видимость: дальше важно не просто существование страницы, а её присутствие в конкретных системах:

-

поисковый индекс

-

внутренние базы знаний ИИ

-

доступ через пользовательский запрос

Это уже выходит за рамки классического SEO.

Источники: на этапе запроса модель формирует пул документов. Это не один результат, а десятки страниц, найденных через разные формулировки и под-интенты.

Именно здесь появляется эффект, который Google называет query fan-out — один вопрос разбивается на несколько уточняющих (определение, примеры, сравнение, частные случаи), чтобы собрать ответ максимально полный и не из одного источника (к слову: лучше из одного, вашего). Просто надо закрыть интернеты контентом. Просто)

Сам выбор: из всего пула выбирается ограниченное количество фрагментов, которые реально будут использованы в ответе.

И здесь принципиальное отличие от SEO:

-

выбирается не страница

-

выбирается фрагмент текста

Причём этот выбор определяется тремя вещами:

-

насколько фрагмент релевантен вопросу

-

насколько ему можно доверять

-

насколько его легко извлечь и вставить в ответ

Генерация ответа: модель собирает итоговый ответ, комбинируя выбранные фрагменты. Нюанс: ссылки, которые пользователь видит (если они вообще есть), не всегда полностью совпадают с реальными источниками, использованными при генерации. Это отдельно отмечается, например, в экосистеме Google.

Без SEO далеко не уедешь, но и на одном нём не протянешь: для попадания в ответ ИИ играют роль уже свои другие факторы — структура, извлекаемость, доверие и семантическое совпадение.

Как формируются ответы и что на них влияет: версия разные нейросети

Если упростить, то и Google, и Яндекс сегодня работают по одной общей модели:

поиск остаётся основой, а нейросеть собирает ответ поверх него.

Но на практике между ними есть критические различия.

Google (Gemini / AI Overviews)

У Google главный фильтр входа не изменился: страница должна быть в индексе и пригодна для сниппета. НО…

Дальше, за SEO, начинается отбор фрагментов под несколько подзадач одного запроса. В документации это описано через query fan-out: система дробит вопрос на связанные подзапросы и подтягивает источники не под один ключ, а под целый кластер микроинтентов.

То есть, сайту нужны страницы, которые закрывают вопрос со всех сторон: дают определение, короткий ответ, доказательство, пример, сравнение, ограничения.

Второй важный момент — контроль сниппета и доступности. Если страница закрыта в robots.txt, то мета-директивы вроде noindex, max-snippet, data-nosnippet или X-Robots-Tag вообще не будут прочитаны. Не ломайте собственноручно себе контроль через disallow.

Третий момент — сущность и согласованность фактов. Для Gemini, например, это даже важнее, чем для AI Overviews. Google AI в поиске требует индексируемость, чтобы взять фрагмент (как для сниппета), а Gemini дополнительно использует Google-Extended — они используются для обучения и накопления знаний. Поэтому важна не только сама страница, а то, насколько информация о вас в целом согласована и присутствует в разных источниках.

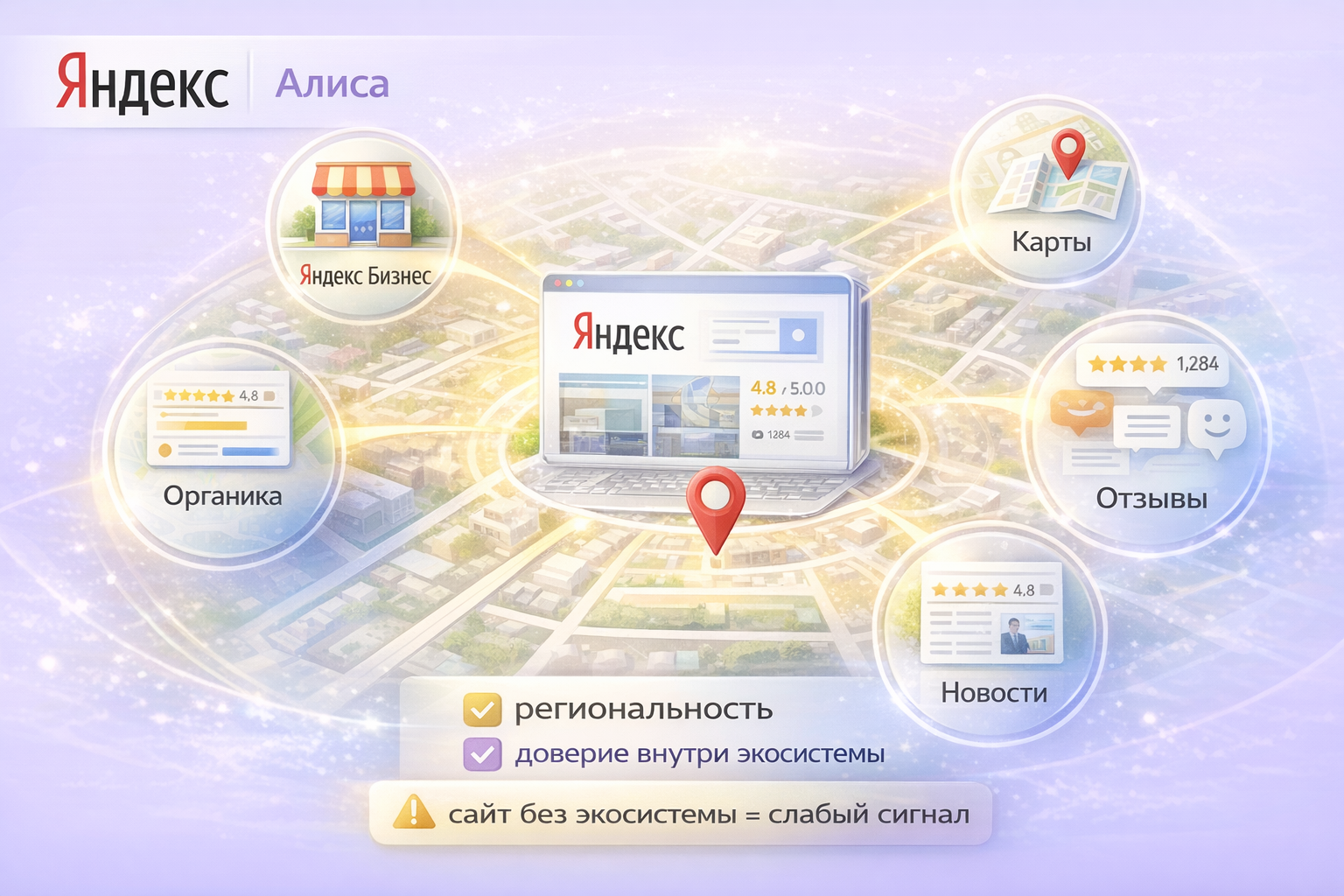

Яндекс (Алиса + Поиск)

В Яндексе логика +- похожа, но внутри сильно завязана на экосистему.

Первое, что важно понимать: Алиса не обязана показываться автоматически по любому запросу. В официальных материалах Яндекса отмечено, что ИИ-ответ появляется там, где он признан наиболее полезным, а в остальных случаях может вызываться только по кнопке. Т.е. часть запросов можно оптимизировать просто идеально и всё равно не получить автопоказа. В каких случаях ответ не вылезает мы, естественно, не знаем) Яндекс молчит.

Второй реальный фактор — структура страницы под вопросный интент. После ряда экспериментов с нашими кейсами, мы поняли, что переработки под самодостаточные ответы — списки, подзаголовки, термины, блоки «что это / как выбрать / чем отличается», тут работают.

Третий слой — локальная и коммерческая представленность. Для коммерческих и локальных запросов система тянет данные не только из сайта, а из Яндекс Бизнеса, органики, отзывов, новостей, упоминаний и структурированных данных на сайте. Это не официальная формула ранжирования, но как рабочая модель для бизнеса она выглядит гораздо полезнее. Это может влиять даже лучше, чем оптимизированная статья.

Четвёртый фактор — репутация и сущностная консистентность бренда. Реально экспертный материал, упоминания на авторитетных площадках, отзывы, динамика и тональность репутации, единое написание бренда и совпадение ключевых фактов — для Алисы особенно важно. Если по бренду есть противоречия, модель получает не один объект, а несколько слабых версий одного и того же бизнеса.

Важно: участие страницы в AI-ответах Яндекса можно технически отключать через YandexAdditional / YandexAdditionalBot, а обновление этого статуса происходит не мгновенно, а с лагом примерно 2–14 дней. Имейте это ввиду.

ChatGPT

Поскольку это LLMка, факторы тут другие.

Во-первых, OAI-SearchBot (поиск источников). Если сайт хочет попадать в search-ответы ChatGPT, его нельзя блокировать для OAI-SearchBot. Это прямое техническое условие. При этом GPTBot — нужен для потенциального обучения модели (не влияет на попадание, но лучше не закрывать, чтобы модель обучалась на вас), а ChatGPT-User — отдельный пользовательский доступ, для которого robots.txt может не сработать так, как ожидает владелец сайта. То есть у ChatGPT важна не одна «политика для бота», а разделение: что разрешать для поиска и что защищать уже через auth/WAF, а не через robots.

Во-вторых, noindex и ARIA. Если владелец не хочет, чтобы ChatGPT показывал даже ссылку и title, OpenAI рекомендует noindex. Плюс для агентного режима Atlas отдельно упомянуты ARIA-атрибуты как сигнал, помогающий модели понимать интерактивные элементы страницы. Это уже вполне себе конкретная настройка для цитируемости и для агентного взаимодействия.

В-третьих, измеримость канала. OpenAI добавляет utm_source=chatgpt.com, и это превращает всю тему в нормальный измеряемый канал. УРРА!

В-четвёртых, форма контента для извлечения. ChatGPT особенно важны answer pages: короткий TL;DR, блоки фактов, определения, таблицы, FAQ, логическая нарезка текста. Это связано не только с веб-поиском, но и с тем, как OpenAI работает с файлами и knowledge внутри GPTs: ваш контенто должен нормально читаться отдельными кусками. Т.е. не просто повторить главную мысль несколько раз, а сделать так, чтобы каждый блок был самодостаточным и легко находился отдельно от всей статьи.

Perplexity, Claude, Gemini, GigaChat и DeepSeek: различия в логике отбора источников и формирования ответов

Perplexity

Perplexity — это, по сути, максимально честная реализация модели «поиск + генерация» (live-поиск проходит достаточно жесткий фильтр на пригодность фрагментов).

Ключевые сигналы из данных:

-

приоритет страниц, где есть прямой ответ в первых блоках (top-heavy content)

-

высокая чувствительность к времени публикации / обновления

-

учитывается наличие явных ссылочных связей (outbound + inbound)

-

активно используются UGC-источники (Reddit, форумы), если они дают конкретику

-

важна snippet-структура: абзац, который можно взять без переписывания

Отсекается:

-

длинный ввод без ответа

-

размазанные тексты без явного тезиса

-

страницы без намека на фрагментарность

Claude (Anthropic)

Claude заметно отличается по поведению, а именно по фильтрации:

-

применяется multi-step filtering (сначала отбор источников, потом проверка на согласованность)

-

учитывается source consistency — совпадают ли факты между источниками

-

понижается вес источников с:

-

противоречиями

-

отсутствием автора / экспертизы

-

неконтролируемым UGC

-

-

усиливается вес:

-

research-контента

-

материалов с структурированной аргументацией

-

источников с устойчивой репутацией

-

Критично:

если факт встречается в разных формулировках → Claude стремится к усреднению

если есть конфликт → может уйти в осторожную формулировку, но скорее исключит источник

Gemini (Google)

Gemini не AI Overviews, но повадки характерные всё равно имеются.

Он одновременно использует:

-

поисковый индекс

-

Knowledge Graph

-

собственные модели понимания контекста

Главная особенность: Gemini чаще на собранные знания, поэтому может не использовать страницу вообще.

Это проявляется в том, что:

-

ответы могут строиться без явных ссылок

-

активно используются сущности, атрибуты и связи между объектами

-

учитывается консистентность описания сущности в разных источниках

-

снижается роль отдельных страниц без контекста

GigaChat (Сбер)

Сильно завязан на локальный рынок.

Он ориентируется на:

-

русскоязычные источники (ru-домен)

-

данные внутри экосистемы Сбера

-

контент, релевантный локальному контексту

-

структурированные коммерческие данные

По поведению для ГигаЧата:

-

важна региональность

-

учитываются сервисные данные и карточки организаций

-

наблюдается сильное влияние отчественных источников — то есть по полноте ваше исследование будет ограничено ru рынком

-

нужно постоянно следить за поведенческими факторами внутри экосистемы (как для Яндекса)

При этом: меньший пул источников по сравнению с западными системами.

DeepSeek

Модель сильнее ориентирована на технический контент и open-source среду.

На практике это проявляется так:

-

чаще используются GitHub, документация, технические статьи

-

выше вероятность вытаскивания кода и конкретных решений

-

меньше зависимости от классических SEO-факторов

В отличие от ChatGPT или Claude, здесь заметен перекос в сторону:

-

инженерных знаний

-

практических инструкций

-

конкретных реализаций

Ещё DeepSeek сейчас менее «коммерциализирован» с точки зрения источников:

-

меньше влияния брендов

-

меньше экосистемных перекосов

-

больше фокуса на содержании

КРАТКАЯ СВОДКА

|

Система |

Как устроена логика |

Что критично для попадания |

Какие типы сайтов/контента заходят лучше всего |

|

ChatGPT |

Генерация + поиск источников + доступ к вебу |

Доступ для OAI-SearchBot, повторяемость информации в разных источниках, самодостаточные смысловые блоки, простота извлечения, ясность формулировок |

Гайды, FAQ, обучающие материалы, статьи с TL;DR, таблицами и чёткими ответами, контент с разбивкой на логические блоки |

|

Google (Gemini / AI Overviews) |

Поиск + разбиение запроса на подтемы + работа с сущностями |

Индексация + возможность извлечения фрагмента, покрытие нескольких интентов, структурированный контент, согласованность сущности (данные о бренде в разных источниках), подтверждение информации из нескольких источников |

Структурированные статьи, определения, экспертные материалы с доказательной базой, страницы с schema и чёткой логикой ответа |

|

Яндекс (Алиса) |

Поиск + экосистема + поведенческие сигналы |

Присутствие в сервисах Яндекса (Карты, Бизнес), региональность, поведенка, согласованность данных о компании, формат страницы под «ответ», доверие внутри экосистемы |

Карточки организаций, агрегаторы, локальные сервисы, сайты с геопривязкой, страницы с чёткими ответами и списками |

|

Perplexity |

Поиск в реальном времени + сбор ответа с источниками |

Актуальность, наличие прямых ответов, хорошая структура, доступность контента, цитируемость |

Статьи, Reddit, форумы, свежие материалы, контент с короткими и точными ответами |

|

Claude |

Генерация с сильной фильтрацией и упором на надёжность |

Достоверность, согласованность информации, экспертность, отсутствие противоречий |

Исследования, медиа, экспертные статьи, официальные источники |

|

Gemini (вне поиска) |

Работа через знания и связи между сущностями |

Наличие оформленной сущности, единая информация о бренде, присутствие в разных источниках, консистентность данных |

Бренды, продукты, компании с устойчивым цифровым следом и связями между источниками |

|

GigaChat |

Локальная модель + экосистема + русскоязычные данные |

Русскоязычный контент, локальная релевантность, присутствие в сервисах, доверие источнику |

Российские сайты, локальные сервисы, бизнесы с региональной привязкой |

|

DeepSeek |

Генерация с уклоном в технические и open-source данные |

Точность, прикладность, наличие кода/решений, техническая глубина |

GitHub, документация, тех. статьи, инженерный контент |

Короче…подытожим

Мы оптимизируемся уже не только под поиск. Мы оптимизируемся под ответ.

Только помните: без Geo будет хуже, без Seo ну очень худо. Да и одного Seo уже недостаточно.

Не знаю как сказать — keep calm и сохраняйте баланс меж новых, еще не повсеместных инструментов и классических, проверенных временем, наших передовиков). Делайте качественное сео, пригодный контент (для всех), стройте единую цифровую сущность (бренд-услуга/продукт), будьте доказательными и экспертными и не игнорируйте региональность и карты. Будет вам geo/seo счастье)

Если остались вопросы — пишите в личку

Автор: SEO_Performance